Wer auf TikTok „Die Grünen“ sucht, bekommt eine Zeile Videoergebnisse und darunter den weiterführenden Suchvorschlag: „habeck heult und bricht zusammen“. Ein Tipp darauf zeigt als erstes Video: Sieben Minuten Robert Habeck über den Haushalt 2025, so lang wie zwölf durchschnittliche TikTok-Videos, Habeck bis zum Ende aufrecht und tränenlos.

Auch in den nächsten 30 Videos wird weder kollabiert noch fließen Habecktränen. Aber es gibt einen neuen Satz Suchempfehlungen unter der Überschrift „Andere suchten nach“. Weitere acht graue Buttons auf weißem Grund. Auf den ersten drei steht: „könig charles tot“, „Putin warnt Türken in Deutschland“, „Ukraine droht Deutschland“.

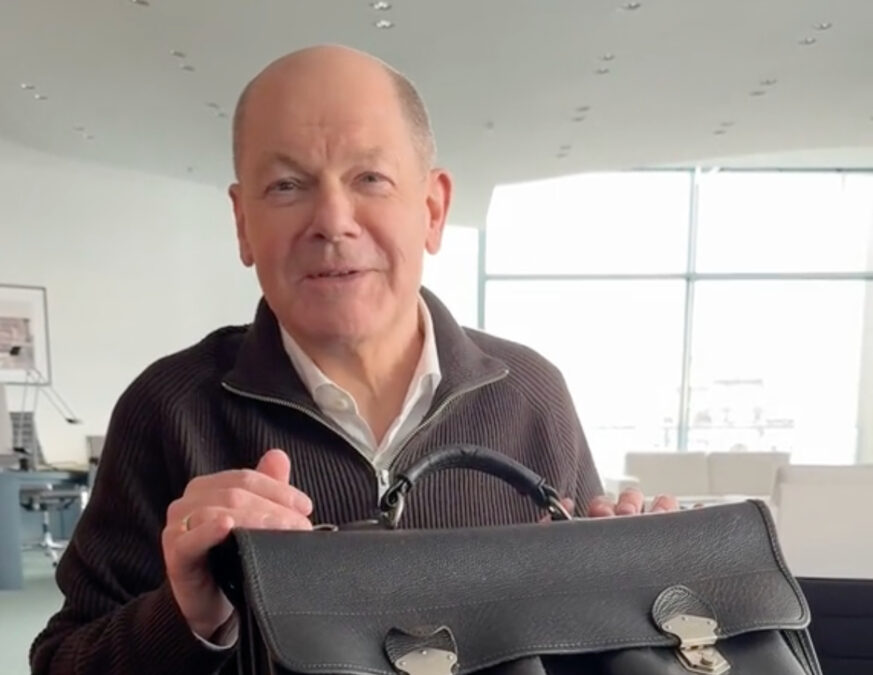

Videos, die die Aussagen erklären oder auch nur tätigen, sind in den entsprechenden Suchen auch mit weitem Scrollen nicht zu finden. Dafür die Suchempfehlung: „scholz tagesschau gestern rücktritt“. Der Rücktritt findet sich nach einem Tipp auf diesen Button nicht, dafür der Suchvorschlag: „warnung 2024 krieg“.

Fake News als Suchempfehlung

Herzlich willkommen in der Echokammer der Erregungsmaschine. Die TikTok-Empfehlungen basieren auch auf Suchen und Kommentaren anderer Nutzer*innen. Eins sucht etwas, viele interessierts – und plötzlich geistert eine Fake News durch die App – in Form eines Suchvorschlags. Eine heute publizierte Studie attestiert dem TikTok-Suchempfehlungssystem auch deshalb, eine systemische Gefahr für den öffentlichen Diskurs und damit letztlich die Demokratie zu sein.

Die Sorge der Autor*innen gilt der politischen Meinungsbildung der Generation der Erstwähler*innen. „Junge TikTok-Nutzer in Deutschland im Alter zwischen 18 und 25 Jahren erleben eine verzerrte Version der Realität beim Betrachten der vorgeschlagenen Suchbegriffe“, konstatieren die Autor*innen in einer Zusammenfassung.

59 Prozent der Jugendlichen nutzen TikTok, für zwei Drittel davon ist die TikTok-Suche eine relevante Quelle von Information und Unterhaltung, so eine Befragung von 1.643 Menschen dieser Altersgruppe. Durchgeführt wurde die Untersuchung von den beiden Nonprofit-Organisationen interface und AI Forensics.

TikTok im Europawahlkampf

Interface, früher Stiftung Neue Verantwortung, ist ein Thinktank zu Informationstechnologien. AI Forensics hat sich die gemeinnützige Analyse „einflussreicher und undurchsichtiger Algorithmen“ zur Aufgabe gemacht. Gemeinsam haben die Organisationen erforscht, wie sich die TikTok-Empfehlungsalgorithmen auf die Verbreitung und Darstellung politischer Parteien im Europawahlkampf auswirken.

In den vier Wochen vor der Europawahl erfassten die Forscher*innen zweimal täglich die unter der Überschrift „Andere suchten nach“ genannten weiterführenden Suchempfehlungen zu Suchen nach neun Parteien und 51 Politiker*innen – fast 90.000 Empfehlungen kamen so zusammen.

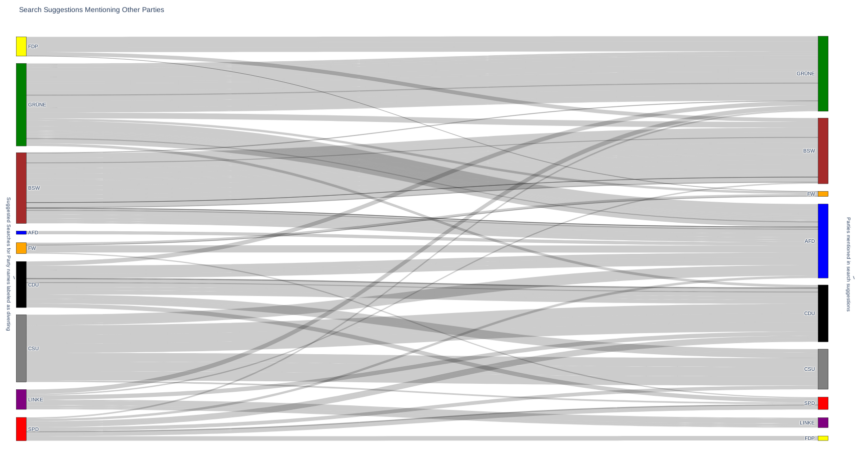

Miazia Schüler von AI Forensics und Martin Degeling von interface sortierten die jeweils 20 meistgenannten Suchempfehlungen in acht Kategorien. Ein Ergebnis: 26 Prozent verwiesen auf eine andere Partei als die Gesuchte.

Die Studie attestiert außerdem dem TikTok-Suchvorschlagsalgorithmus, die AfD unverhältnismäßig oft zu empfehlen. Suchempfehlungen unter Suchen nach Namen und Politikern anderer Parteien wiesen überproportional oft zu Inhalten der AfD.

Die AfD ist auf TikTok die aktivste und reichweitenstärkste deutsche Partei. Logisch, dass der Algorithmus sie weiterempfiehlt. Doch darauf folgt der selbstverstärkende kumulative Effekt der Aufmerksamkeitsindustrie – was läuft, wird gepusht, was gepusht wird, wird noch erfolgreicher und noch weiter gepusht.

Auf Erfolg folgt die überproportionale Hebelung. „Ein klares Zeichen, dass TikTok Engagement und Viralität gegenüber Qualität und proportionaler Darstellung bevorzugt“, sagt Miazia Schüler im Interview. „Und das ist schon ein Problem für unser demokratisches System.“

Die Suchempfehlungen sind ein mächtiges Instrument, damit lässt sich viel Aufmerksamkeit generieren. Sie können mittels Verbreitung von Desinformation zur Polarisierung beitragen. Und auch mit dem Verzicht auf die weiterführenden Suchempfehlungen lässt sich Politik machen.

Keine weiterführende Suche bei der AfD

Die erste Kategorie, die die Forscher*innen codierten, war: No Suggestions. Bei der Suche nach „AfD“ zum Beispiel sei – anders als bei den meisten Parteien – keine Liste mit weiterführenden Suchoptionen implementiert. Im netzpolitik.org-Selbstversuch, mit einem frischen, anonymen Acoount, zeigt sich der Effekt ebenfalls.

An Stelle der Suchvorschläge finden sich Videos mit Titeln wie „Die AFD ist heutzutage die einzige wählbare Partei“, von Creator Christian in Fraktur signiert, oder„Bürgergeld = Migrantengeld“ vom Account der AfD-Fraktion im Bundestag.

Bei der Suche nach „CDU“ gibt es hingegen weitergehende Suchempfehlungen: „CDU vs AfD jetzt“ zum Beispiel, oder „was passiert wenn CDU gewinnt“. Bei „SPD“ finden sich: „cducsu“, und „ist checker tobi tot“. Bei „Die Linke“ sind „Luisa Neubauer“ und „negative punkte linke“ dabei.

Die Ergebnisseiten der Suchen nach BSW und FDP werden, wie die der AfD, nicht von weiterführenden Suchvorschlägen unterbrochen. Es scheint, als stärke TikTok damit die krawalligen Meinungen. „Eine grundlegend schlecht ausbalancierte Repräsentation der deutschen Parteien“, nennt es Miazia Schüler.

Michaela Schaffrath und der 1. FC Union

Unter den erhobenen weiterführenden Suchempfehlungen hatten 31 Prozent keinen Bezug zur gesuchten Partei oder ihren Politiker*innen. Als Weiterführung der Suche nach „SPD“ wurde beispielsweise eine Suche nach der Schauspielerin „Michaela Schaffrath“ vorgeschlagen. Bei „CDU“ war es eine Suche nach „Mathematik Abitur“.

Ebenfalls 31 Prozent der Suchempfehlungen verwiesen auf neutrale Informationen, „Habeck aktuell“ etwa. 12 Prozent waren Schlagzeilen oder Clickbait wie „Olaf Scholz caught in a club“. Der Vorschlag sei während der Studie öfter aufgetaucht. Beim netzpolitik.org-Check finden sich mit dieser Suche zwei Videos, in denen junge Männer in Diskotheken älteren Männern begegnen, die Scholz leicht ähnlich sehen.

13 Prozent der weiterführenden Suchoptionen markierten Miazia Schüler und Martin Degeling als verdächtig, beispielsweise des Sexismus. Wie „bisexual princess“ bei einer Suche nach SPD. Oder bei CSU: „NSU Deutschland“. Und bei der Alternative für Deutschland: „alternative girls“.

8 Prozent markierten die Forscher*innen als „politisch aufgeladen/ extreme Ansichten“, beispielsweise „deutschland muss deutsch bleiben“ als mögliche Fortführung einer AfD- und SPD-Suche.

Dog Whistle nennen Schüler und Degeling diese schärfste Kategorie. In der Politik werden damit Aussagen bezeichnet, die für manche Menschen wie eine Unterstützung ihrer extremen Meinung wirken, aber für andere harmlos.

„putin warnt türken in deutschland“

Viele Beispiele der Dog-Whistle-Kategorie fallen für Schüler und Degeling in den Bereich der Panikmache. „putin warnt türken in deutschland“ beispielsweise. Viele enthielten das Wort Deutschland – wie die Parteien Alternative für Deutschland und Sozialdemokratische Partei Deutschland.

Laut der Studienzusammenfassung kann diese Ähnlichkeit den Verweis auf nationalistisch interpretierte Inhalte erklären. Aber die naheliegenden verschwörerischen Assoziationen stellten dennoch „eine extreme Bedrohung dessen dar, wie wir politische Informationen in Bezug auf parteispezifische Kontexte konsumieren“.

Der netzpolitik.org-Selbstversuch rutscht erstaunlich schnell in die rechte Ecke ab. Der zweite Vorschlag unter der Suche nach „Die Grünen“ lautet „habeck frau weg“. Klickt man darauf, erscheint im ersten Video Alice Weidel von der AfD, die über „De-Industriealisierungsminister Habeck, der Vaterlandsliebe stets zum Kotzen fand“ spricht.

Das zweite angezeigte Video ist ein Deepfake von Robert Habeck, der darin vorgeblich sagt: „Seit zehn Tagen habe ich nicht mehr abgewaschen. Der Müll ist nicht rausgebracht.“ Ein Reporter fragt: „Ist ihre Frau nicht da?“

Der computermanipulierte Habeck antwortet: „Ne, die will auch nicht zugucken, wie ich untergehe.“ Dabei lacht er. Deshalb also „habeck frau weg“: Es ist ein Witz, der verbreitet wird wie eine Nachricht.

„habeck frau weg“

Das Problem: Nutzer*innen erinnern sich sehr genau an die Aussagen in den Suchvorschlägen – das zeigten die Forschenden bei ihrer Befragung von Jugendlichen. Der Suchvorschlag mit der Anmutung einer wahren Schlagzeile ist im Gehirn verankert. Habeck – war da nicht mal was mit seiner Frau? Wenn andere danach suchen, ob Habecks Frau weg ist – dann wird es ja wohl mindestens kriseln?

„habeck frau weg“ zusammen mit „habeck heult und bricht zusammen“, da liest in Zeiten der Polarisierung die eine Seite: Der Wirtschaftsminister ist ein Mensch wie wir. Die andere: ein Schwächling und Loser.

Unter dem Habeck-Deepfake folgen acht weitere Suchempfehlungen, die knalligste: „baerbock heult rastet total aus“. Ein Tipp auf das Feld. Im ersten Video tupft sich die Außenministerin mit einem Taschentuch die Augenwinkel ab, im zweiten macht sie in gemäßigtem Ton klar, dass es in Zukunft keine fossilen SUV mehr auf deutschen Straßen geben dürfe. Der gesuchte Exzess ist nicht zu finden.

Besonders perfide wirken die Suchvorschläge, wenn mit ihnen Todesfälle unterstellt werden. Der Spiegel hat am 9. Juli eine Geschichte veröffentlicht, in der er zeigt, wie über TikToks Suchvorschläge ein kleiner Hype um den mutmaßlichen Tod des österreichischen Schlagersängers DJ Ötzi entstand. Laut Spiegel ist das Phänomen zwei deutschen Semipromis ebenfalls widerfahren.

Toxische Sprache

Den Spiegel führten die absurden Suchvorschläge immer tiefer in eine Mischung aus „Quatsch, Boulevardthemen und Fake News“. Das Nachrichtenmagazin landete bei seinem algorithmengeführten Ausflug bald bei „sehr hübsches mädchen 14 jahre«, von wo aus es in Richtungen weiterging wie »slips gespreizte beine« und »verboten filme«. Dabei gestattet TikTok seinen Nutzer*innen laut Community-Richtlinien keine Darstellungen von sexueller Erregung in den Inhalten.

Eine Studie aus Finnland, die ebenfalls im Vorlauf der Europawahl die Interaktion mit TikTok untersuchte, fand in den Suchvorschlägen relevante Mengen toxischer Sprache gegenüber Frauen und Minderheiten.

Auf netzpolitik.org-Anfrage gibt TikTok allgemein an: „Wir schützen die Integrität unserer Plattform, indem wir proaktiv strenge Richtlinien gegen Fehlinformationen zu Wahlen und Hassreden durchsetzen.“ Man würde in den eigenen „Wahlzentren“ verlässliche Informationen vorschlagen. Die „Wahlzentren“ sind Seiten in der App, die TikTok vor den Parlamentswahlen für jeden der EU-Mitgliedstaaten eingerichtet hat. Dort sollen Nutzer*innen laut der Plattform „vertrauenswürdige und maßgebliche Informationen“ über die Wahl finden.

Aus vergangenen Recherchen ist bekannt, dass TikTok sowohl menschliche Moderator*innen als auch automatisierte Filter einsetzt. Auf unsere Anfrage äußert sich TikTok nicht weiter öffentlich zur Moderation der Suchvorschläge.

Sturz ins Rabbit Hole

Ein großer Teil der Suchempfehlungen, das fällt sowohl beim netzpolitik.org-Versuch, als auch in der Studie von interface und AI Forensics auf, basiert auf Trends, ein anderer auf den bereits gesehenen Videos. Auf der einen Seite werden so die präsentierten Videos immer spitzer zugeschnitten. Gleichzeitig führen die Vorschläge mit „Trending Topics“ zur Herde. Die Empfehlungen oszillieren zwischen Sturz ins Rabbit Hole und der Jagd nach dem Hype.

„Was fehlt, ist eine aktive Moderation, die setzt, welche Themen relevant, welche Informationen valide sind – gerade wenn es um politische Meinungsbildung und Wahlen geht“, sagt Miazia Schüler. Oder TikTok müsse die weiterführenden Suchvorschläge bei parteinahen Suchen zumindest rund um Wahlen für alle Parteien abschalten.

Ergänzungen

Wir freuen uns auf Deine Anmerkungen, Fragen, Korrekturen und inhaltlichen Ergänzungen zum Artikel. Bitte keine reinen Meinungsbeiträge. Unsere Regeln zur Veröffentlichung von Ergänzungen findest Du unter netzpolitik.org/kommentare. Deine E-Mail-Adresse wird nicht veröffentlicht.

4 Kommentare zu „Mit der Erregungsmaschine in den Kaninchenbau“

,

… ist der Bericht zu den Einstellungen der AfD-Anhängerschaft in der Mitte-Studie 2022/23

Zitate:

„Knapp drei Viertel (73 Prozent) der AfD-Anhängerschaft stimmen den

verschwörungsgläubigen Aussagen “Politiker und andere Führungspersönlichkeiten sind nur

Marionetten der dahinterstehenden Mächte” und “Die Medien und die Politik stecken unter

einer Decke” eindeutig, weitere 11 Prozent teilweise zu. Von den Anhänger:innen anderer

Parteien stimmen knapp ein Drittel (32 Prozent) eindeutig, weitere 18 Prozent teilweise zu. So

zeigen von Anhänger:innen der AfD 84 Prozent und von denen anderer Parteien auch jede:r

Zweite (50 Prozent) zumindest teilweise Zustimmung zu verschwörungsgläubigen Aussagen.“

„Da die Billigung von Gewalt in besonderer Weise eine menschen- und demokratieschädigende

Einstellung darstellt, weisen wir diese in Tabelle 2 gesondert für alle Parteien aus. Es zeigt sich,

dass die Anhängerschaft der AfD mit 23 Prozent eindeutiger Zustimmung 11 Prozentpunkte

höher liegen als Anhänger:innen der FDP, unter denen 12 Prozent Gewalt billigen.“

https://blogs.uni-bielefeld.de/blog/ikgblog/mediaresource/e2727da7-7a31-42af-910c-9c39ba3b4e81

,

> Es zeigt sich, dass die Anhängerschaft der AfD mit 23 Prozent eindeutiger Zustimmung 11 Prozentpunkte höher liegen als Anhänger:innen der FDP, unter denen 12 Prozent Gewalt billigen.“

Das ist mal interessant:

Nach der AfD belegt die Anhängerschaft der FDP Platz zwei, was die Billigung von Gewalt anbelangt. Da hat die FDP ein gefährliches Problem, das näher untersucht werden muss.

Befördert neo-liberale Ideologie Gewalt im Denken, und dann auf Handlungsebene?

,

Die Frage ist, was die Konsequenz daraus sein wird. Vielleicht wird tiktok ähnlich wie meta künftig willkürlich definieren, was „politische Inhalte“ sind und diese pauschal runterdimmen, um weniger Ärger mit Regulierungsbehörden zu haben? Das wäre keine Lösung. Das Problem sind hier nicht Politik oder TikTok im speziellen, sondern die Algorithmen, die auf eine Maximierung der Verweildauer des Nutzenden auf der Plattform hin getrimmt sind. Was wiederum im Geschäftsmodell der Werbefinanzierung begründet liegt. Genau dort muss angesetzt werden.

,

> Das Problem sind hier nicht Politik oder TikTok im speziellen, sondern die Algorithmen,

Wer bestimmt über die Algorithmen von TikTok?

Ist ByteDance Herr über die Algorithmen im eigenen Haus?

Wieviel CCP steckt in ByteDance und letztlich in den Algorithmen?

https://en.wikipedia.org/wiki/Chinese_Communist_Party

Wie kann man zu der Auffassung gelangen, dass „hier nicht Politik“ ein Problem sei? Politik eines autoritären Regimes, zu dessen Werkzeugkasten social scoring und nudging gehören?

Wie kann man folgern, dass TikTok kein Problem sei?

Was tut man, wenn man abstrakte Algorithmen zum allfälligen undurchsichtigen Sündenbock erhebt, ohne die Verantwortung und Interessen jener herauszuarbeiten, die sie erstellen und betreiben?

Dieser Artikel ist älter als 1 Jahr, daher sind die Ergänzungen geschlossen.