Keine App wurde im vergangenen Jahr so oft herunter geladen wie TikTok. Die Videosharing-Plattform wächst rasant. Im November 2019 durchbrach TikTok die 1 Milliarde-Nutzer:innen-Schallmauer – so schnell wie kein anderes soziales Netzwerk je zuvor. Die Video-App und ihre Kultur ist bei Kindern und Jugendlichen derzeit so angesagt, dass selbst die Tagesschau inzwischen einen eigenen Account dort betreibt.

Recherchen von netzpolitik.org zeigen jedoch: TikTok kann bis heute Videos von politischen Protesten und Demonstrationen unterdrücken und darüber hinaus auf vielfältige Weise bestimmen, welche Inhalte sichtbar und welche unsichtbar sind.

Exklusiver Einblick in die Moderation

Für diese Recherche hat netzpolitik.org mit einer Quelle bei TikTok gesprochen, Moderationskriterien und Kommunikationen eingesehen sowie mit eigens dafür erstellten Accounts Versuche gemacht, wie gut Videos mit chinakritischen Inhalten auf der Plattform sichtbar sind.

TikToks Moderationsregeln, von denen netzpolitik.org unterschiedliche Versionen einsehen konnte, sind bemerkenswert dünn und weit interpretierbar – auch für die Moderator:innen selbst. Die Strategie ist jedoch klar: Bestimmte Inhalte bekommen eine möglichst große Reichweite, während andere systematisch unterdrückt werden.

Die Erfolgsplattform gehört dem chinesischen Technologieunternehmen ByteDance. Bereits im September hatte der Guardian aus geleakten Dokumenten berichtet, wie TikTok politische Äußerungen zum Tiananmen-Massaker oder der Unabhängigkeit Tibets zensiert. Auch die Proteste in Hongkong, die derzeit weltweit mediale Aufmerksamkeit erregen, sind auf TikTok zwischen Selfies und Duetten so gut wie unsichtbar. Dabei ist die App auch in Hongkong verfügbar.

Nachts moderiert Peking

Die deutschsprachigen Videos auf TikTok werden von drei Standorten aus moderiert, berichtet die Quelle: Berlin, Barcelona und Peking. Am deutschen Standort sei die Führung chinesisch. Gearbeitet wird in 8‑Stunden-Schichten, während denen um die 1.000 Tickets abgearbeitet werden sollen. Das ist knapp eine halbe Minute pro Ticket, für Videoinhalte ist das sehr wenig Zeit. Die Löhne sind sehr unterschiedlich, der Druck auf einzelnen Moderator:innen hoch, die Stimmung im Team sei „toxisch“, berichtet die Quelle.

Moderiert wird laut der Quelle in drei Review-Stufen. Der erste Review findet schon nach 50 bis 150 Videoansichten in Barcelona statt. Berlin ist für den zweiten Review bei 8.000 bis 15.000 Ansichten und den dritte Review bei etwa 20.000 Ansichten zuständig. Nachts moderieren deutschsprachige Chines:innen von Peking aus Inhalte. Das bestätigt auch TikTok gegenüber netzpolitik.org.

Im Gegensatz zu Facebook sind die Moderationsregeln sehr knapp gehalten: Sie passen nach Auskunft der Quelle in eine wenige Seiten lange Tabelle. Die Anweisungen, die netzpolitik.org einsehen konnte, sind verwirrend vage. Das lässt viel Spielraum für Interpretationen, die Einschränkung von Inhalten kann sehr weit ausgelegt werden, weil das Regelwerk nicht den in vielen Fällen deutlich klareren Charakter von Facebooks-Moderationskriterien hat.

Löschen, Bremsen, Pushen

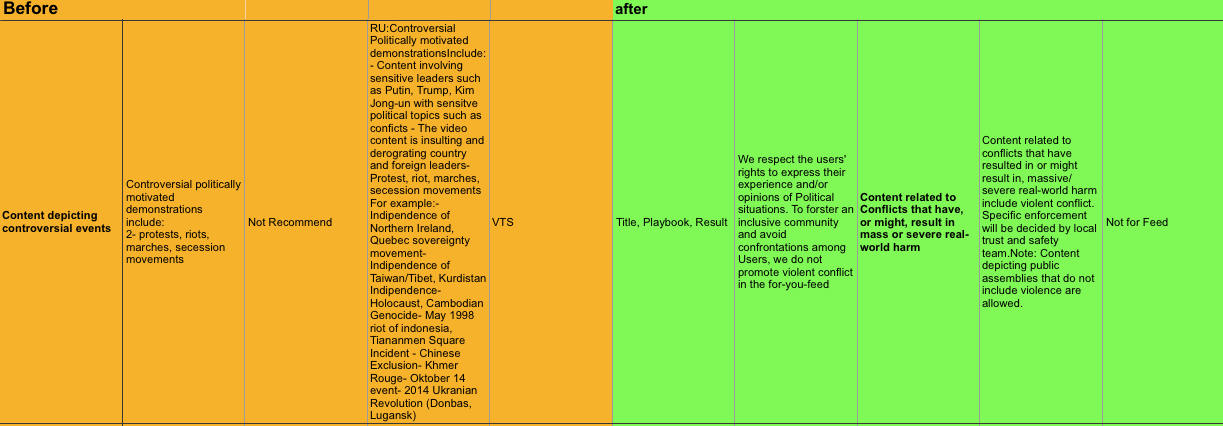

Die Regeln unterteilen unliebsame Inhalte in vier Kategorien. Das berichtet die Quelle und zeigen die Moderationsregeln, die netzpolitik.org einsehen konnte. Videos, die komplett gegen die Auflagen der Plattform verstoßen, werden gelöscht („Deletion“). Andere Inhalte werden als „visible to self“ markiert. Dadurch kann eine Nutzerin das Video selbst noch sehen, andere aber nicht mehr.

Eine Markierung als „not for feed“ oder „not recommend“ bedeutet, dass das Video nicht mehr im algorithmisch kuratierten Newsfeed auftaucht, den die Nutzer:innen beim Öffnen der App sehen. Die Markierung kann auch zu einer Benachteiligung bei der Suche und Auffindbarkeit in Hashtags führen, sagt die Quelle. Solche Beiträge werden also streng genommen nicht gelöscht – sie haben aber faktisch kein Publikum mehr.

Für die nicht eingeschränkten Videos gibt es hingegen zwei Stufen. Die meisten werden als „General“ bezeichnet, hier können allerdings über die Markierung von „Risks“ die Inhalte regional gesperrt oder heruntergedrosselt werden.

Videos, deren Verbreitung die Marketingabteilung extra verstärken will, kann sie mit der Markierung „Featured“ pushen. TikTok bestätigte netzpolitik.org gegenüber nur die Existenz von „Deletion“, „visible to self“ und „Risks“. Die „Risks“ seien notwendig, damit die Videos nicht gegen lokale Gesetze in bestimmten Ländern verstoßen.

Nicht nur Inhalte können ausgebremst werden, auch ganze Hashtags, erzählt uns die Quelle. Überhaupt scheint TikTok ein System des Promotens und Ausbremsens zu fahren, bei dem bestimmte Inhalte sichtbar und viral sind, andere hingegen nie durchstarten und keine Sichtbarkeit erhalten. Die Kontrolle über das, was Menschen auf TikTok sehen, liegt vor allem in der Hand des Unternehmens.

Gelenkte Inhaltspolitik

Proteste seien generell nicht gerne gesehen auf der Plattform, sagt die Quelle. Grundsätzlich gäbe es aufgrund der Ausrichtung von TikTok weniger Protest-Inhalte als auf anderen Plattformen, aber oftmals schafften es solche Videos gar nicht erst bis ins Marketing, sondern würden vorher schon beim ersten Sichten in der Moderation an anderen Standorten wie Barcelona gelöscht. Dabei sehen die „Löschteams“ gar nicht die Videos, sondern nur einzelne Frames an, der Ton wird nur auf Verdacht angehört. Tiktok bestreitet, dass es Inhalte aufgrund ihrer politischen Ausrichtung moderiere.

Kommt ein Inhalt zum Marketing-Team durch, bestimmt dieses über die Zusammenstellung des kuratierten For-You-Feeds, der den Nutzer:innen algorithmisch zugeschnitten ausgespielt wird.

Während der Moderation markieren die Moderator:innen Inhalte nicht nur für Löschung oder Bremsung, sie klassifizieren auch, was sie sehen. „Das soll beim Aufbau einer maschinellen Moderation helfen“, erzählt uns die Quelle, die Einblick in die Moderation hat. Tiktok dementierte gegenüber netzpolitik.org eine Verschlagwortung zum Anlernen von Künstlicher Intelligenz, algorithmische Systeme würden aber „zur Überprüfung beim Einstellen von Inhalten“ eingesetzt.

Kritik an Politik war früher aus Feed ausgeschlossen

Laut der Quelle habe TikTok nach der der Berichterstattung des Guardian im September und der darauf folgenden Kritik seine Moderationsregeln geändert. Dabei habe das Unternehmen gegenüber Mitarbeiter:innen explizit auf die schlechte Presse verwiesen, erzählt die Quelle. Das Ausmaß der Änderungen im September sei bis heute einzigartig gewesen, kleinere Modifikationen gebe es hingegen häufiger.

Tiktok hatte dem Guardian gegenüber von Mai gesprochen, gegenüber netzpolitik.org sagt das Unternehmen nun die signifikanten Änderungen seien „deutlich früher“ vorgenommen worden.

Bis zu dieser großen Änderung haben die Moderationsregeln Kritik an Politik und politischen Systemen quasi komplett ausgeschlossen. Ausgebremst wurde etwa, wer die konstitutionelle Monarchie, parlamentarische Systeme, Gewaltenteilung oder sozialistische Systeme kritisierte. Erst mit der großen Änderung wurde dieses „Politikverbot“ aus den Moderationsregeln getilgt.

Einen Ausschnitt aus der Moderationspolicy von TikTok (PDF), in dem mehrere Regeln vor und nach der Änderung festgehalten sind, veröffentlichen wir an dieser Stelle. Es handelt sich aus Quellenschutzgründen nicht um das Originaldokument, sondern um eine Abschrift.

Demonstrationen weiterhin einfach zensierbar

Geändert wurde auch das Ausbremsen der Darstellung so genannter „kontroverser Ereignisse“. Bis dahin zählten dazu generell Proteste, Ausschreitungen und Demonstrationen. Eine Liste zählte zusätzlich Beispiele auf wie die kurdische, tibetische oder taiwanesische Unabhängigkeitsbewegung. Nach der Änderung ist die Darstellung von Demonstrationen und Protesten nicht mehr per se eingeschränkt.

Allerdings können Demonstrationen mit dem Hinweis auf „mögliche gewalttätige Konflikte“ nach den aktuellen Regeln nach wie vor mit „not for feed“ markiert und heruntergeregelt werden. TikTok sagt, dass es keine solchen Inhalte enferne. Das allerdings war keine Antwort auf die gestellte Frage. Netzpolitik.org hatte nach der drosselnden Klassifizierung „not for feed“ gefragt, eine komplette Entfernung sahen die uns vorliegenden Versionen der Moderationspolicy sowieso nicht vor.

Aus dem Feed verbannt waren früher auch Kritik an öffentlichen politischen Figuren, der Polizei und am Militär. Diese Regeln hat TikTok in Deutschland mittlerweile gestrichen, was das Unternehmen auch bestätigt.

LGTBQI-Inhalte werden in vielen Ländern nicht ausgespielt

Zudem wurden früher bestimmte Dinge als „Islam Offence“ markiert. Inhalte, die mit diesem Schlagwort markiert wurden, beispielsweise zwei küssende Männer, lösten einen Geoblock für bestimmte Regionen aus. Betroffen gewesen seien vor allem LGTBQI-Inhalte. Diese Regelung wurde nach Berichterstattung des Guardian abgeschafft. Oder besser gesagt: umbenannt.

Inhalte, die sich mit der sexuellen Orientierung beschäftigen, erhalten heute das Schlagwort „Risk 3.4“ – die Folge ist, wie auch beim „Islam Offence“ zuvor, dass diese Inhalte in islamischen Ländern ausgebremst werden. Die Markierung mit einem Risk, es gibt viele weitere, führten zu Geoblocking, sagt die Quelle. TikTok argumentiert, dass man sich an lokale Gesetze halten müsse.

Proteste in Hongkong sind kaum sichtbar

Da TikTok einem chinesischen Unternehmen gehört, ist besonders der Umgang mit den Demokratie-Protesten in Hongkong ein guter Gradmesser für Zensurversuche.

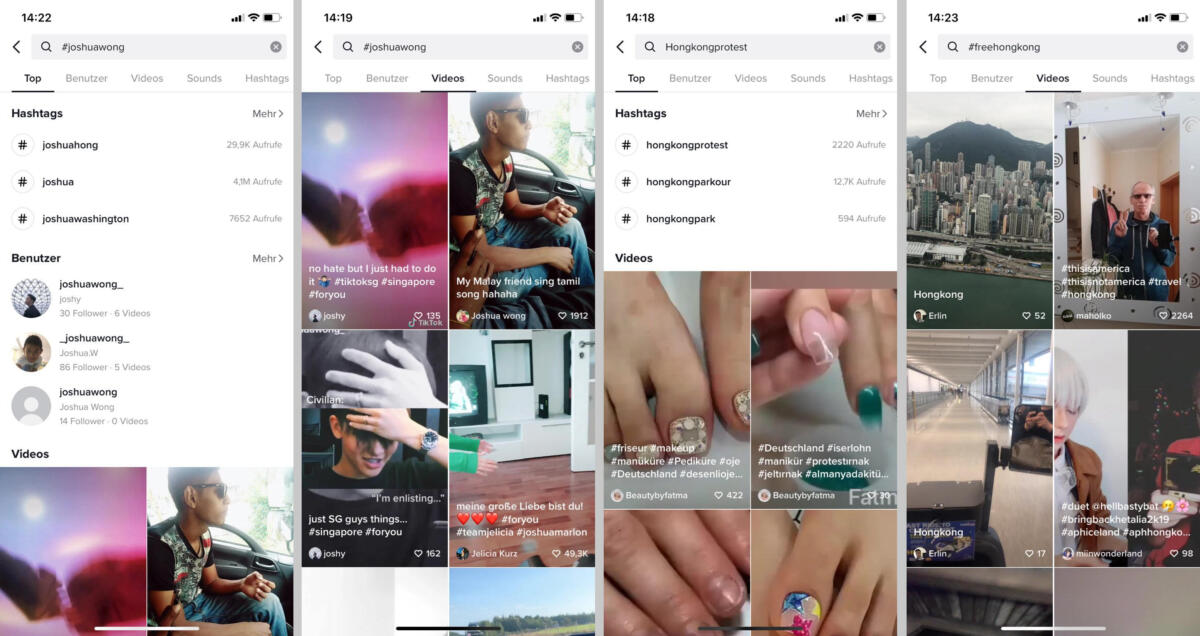

Schon im September hatten wir in der App und in der Webversion nach bestimmten auf anderen Netzwerken prominenten Hashtags wie #hongkongprotest, #freehongkong oder #antielab gesucht und keine oder nur sehr wenige Ergebnisse gefunden. Stattdessen wurden unter den Hashtags in der App Videos gezeigt, die nichts mit den Protesten zu tun hatten. Erst nach einer Presseanfrage bei TikTok in Deutschland wurden einige Videos sichtbar, auch solche, deren Upload wir mit einem eigens dafür erstellten Account versuchten.

Gegenüber netzpolitik.org sagte die Sprecherin des Unternehmens damals:

Nutzer sind auf TikTok, da die App ihnen eine positive, lustige Erfahrung bietet, bei der sie ihre Kreativität einbringen können. Kurzformatige, unterhaltsame Videos sind, was unsere Nutzer überwiegend auf TikTok hochladen und ansehen. TikToks Moderation folgt unseren Community Richtlinien und Nutzungsbedingungen und entfernt keine Videos rund um die Proteste in Hongkong.

Dieses überspezifische Statement kann heißen: Unsere Nutzer:innen laden gar nichts politisches hoch, es gibt kaum Videos zu den Protesten in Hongkong und wir löschen die auch nicht. Das Statement lässt aber komplett offen, ob TikTok Videos zu Hongkong mittels der unterschiedlichen Sichtbarkeitsstufen systematisch benachteiligt und so für die Öffentlichkeit unsichtbar macht oder gemacht hat. Die Suche nach dem Hashtag #JoshuaWong führte im September in der TikTok-App beispielsweise zu keinem Ergebnis. Es gab den Hashtag überhaupt nicht.

TikTok sagt gegenüber netzpolitik.org, dass es heute keine Inhalte zu den Protesten in Hongkong und auch zu Joshua Wong einschränke.

Die Welt am Sonntag hatte kürzlich bei einem Test festgestellt, dass die Suche nach aus Sicht der chinesischen Regierung brisanten Stichworten wie „falungong“, „tiananmenmassacre“ und „Tiananmensquare“ keine oder nur sehr wenige passende Beiträge liefere. Zahlreiche Suchen von netzpolitik.org in der App kommen zu einem ähnlichen Ergebnis.

„Handzahm und gelenkt“

Für Christian Mihr von Reporter ohne Grenzen bestätigen die Recherchen von netzpolitik.org die Befürchtungen, dass TikTok unter dem Einfluss des chinesischen Staates steht – obwohl es ein privates Unternehmen sei. Es sei Teil der Medienstrategie Pekings, seine totalitäre Vision handzahmer, gelenkter Medien auch international durchzusetzen.

„Wenn auf TikTok die Reichweite von Inhalten etwa über Proteste gedrosselt werden, passt das genau ins Bild, da Proteste in Hongkong oder Xinjiang, genauso wie im Ausland ein Tabuthema für Medien in China sind“, sagt Mihr. Er kritisiert das Vorgehen von TikTok als ein „Zeichen von großer Intransparenz“.

Update, 25.11.2019:

Nach Veröffentlichung des Artikels beharrt TikTok darauf, folgendes Statement zu ergänzen:

TikTok moderiert keine Inhalte basierend auf politischen Ausrichtungen oder Sensitivitäten. Unsere Moderationsentscheidungen sind durch keine fremde Regierung beeinflußt,was die chinesischen Regierung einschließt. TikTok entfernt weder Videos rund um die Proteste in Hongkong noch werden Videos rund um die Proteste in Hongkong in ihrer Reichweite unterdrückt. Das umschließt Inhalte zu Aktivisten.

Über diese Recherche und die Quellen:

Unser Wissen über die Moderation bei TikTok in Deutschland beruht auf einem mehrstündigen Gespräch von netzpolitik.org mit einer Quelle, die Einblick in die Moderationsstrukturen und die Policy hat. Wir haben die Identität der Quelle und ihren Arbeitsvertrag überprüft. Wir können und wollen die Quelle aus Gründen des Informantenschutzes nicht näher beschreiben.

—

Sollten Sie Informationen oder Hinweise zu diesem oder anderen Themen haben, freuen wir uns über eine Kontaktaufnahme – gerne verschlüsselt. Nutzen Sie dafür keine beruflichen Mailadressen, Telefonnummern, Netzwerke und Geräte.