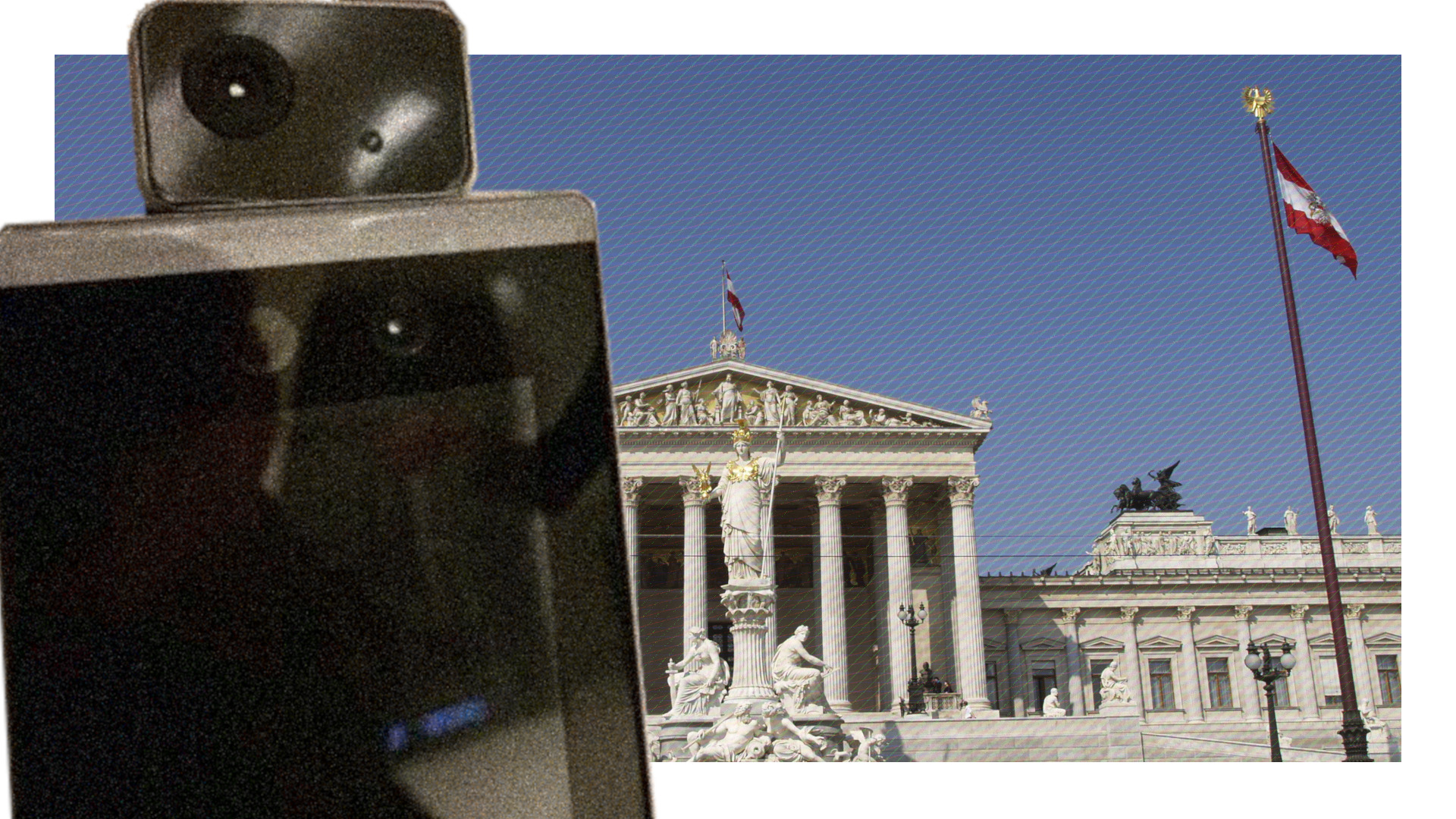

Wenn die österreichischen Abgeordneten und ihre Mitarbeitenden nächste Woche zu ihrer Wirkungsstätte zurückkehren, treffen sie auf ein überarbeitetes Sicherheitskonzept. Denn für „dauerzugangsberechtige Personen“ ist der Zugang zum Parlament künftig auch auf der sogenannten „Fast-Lane“ möglich. So heißt das Konzept für die neue Sicherheitsschleuse am Haupteingang, das einen schnelleren Zugang via Gesichtserkennung ermöglichen soll.

Zumindest am Haupteingang wird der Zutritt aber auch wie bisher mit Zugangskarte möglich sein. An den vier Nebeneingängen des Parlaments soll in Zukunft der Zugang mit Venenscannern kontrolliert werden – ohne dass dabei Personal eingesetzt würde. Wer die Biometrie seiner Venen nicht dauerhaft speichern lassen möchte, muss daher den Haupteingang nutzen, heißt es in einem Artikel bei futurezone.at.

Das Parlament betont die zumindest am Haupteingang freiwillige Umsetzung des neuen Sicherheitskonzepts. Zudem versichert die Parlamentsdirektion, dass keine Daten erhoben würden, sollte man sich gegen die Nutzung des biometrischen Zugangs entscheiden.

Geschwindigkeit als Argument

Die biometrische Sicherheitskontrolle wird von Parlamentsseite mit Geschwindigkeitsgewinnen begründet. So könne nach einmaliger Verknüpfung des Gesichts mit dem System der Zugang zum Parlament ohne weitere Kontrolle stattfinden. Eintretende Personen müssten dann nur noch durch die mit Sensoren und Kameras bestückte Sicherheitsschleuse am Haupteingang laufen. Das ermögliche einen „doppelten Personendurchsatz“, so Thomas Tauscher von der Sicherheitstechnik des Parlaments gegenüber futurezone.

Es gibt aber auch Kritik, beispielsweise von epicenter.works. Die Bürgerrechtsorganisation führt gegenüber futurezone an, dass „biometrische Daten […] besonders schützenswert (sind), da sie personenbezogen, einzigartig und unabänderbar sind“. Die biometrische Eingangskontrolle tausche daher „Sicherheit gegen eine angebliche Vereinfachung und denkt mögliche Folgen nicht mit“. Allerdings begrüßt auch epicenter.works, dass die biometrische Identifikation zumindest am Haupteingang freiwillig sein wird.

Missbrauchsrisiken enorm

Biometrische Daten wie Scans von Gesicht oder Handvenen sind einzigartig: im Gegensatz zu einer PIN oder Passwort können sie nicht einfach zurückgezogen oder verändert werden. Sind sie also erst mal im Umlauf, lässt sich wenig dagegen tun. Betroffene Personen können auch Jahrzehnte später eindeutig anhand dieser unabänderlichen Merkmale identifiziert werden.

Das aber ist eine der möglichen Folgen dieser Technik. Die Daten können gestohlen werden oder durch Umwege in den Händen anderer landen. Die Szenarien für einen möglichen Missbrauch sind offensichtlich. Jüngst verdeutlichte etwa die Debatte über die umstrittenen Plattformen PimEyes und ClearView AI, welche Folgen große Mengen frei verfügbarer biometrischer Daten in den Händen kommerzieller Unternehmen und ihrer Kunden haben kann.

Das Parlament in Wien beteuert hingegen, dass die Daten sicher sind. So verweist man darauf, dass die Daten ohne Anbindung ans Netz, also ausschließlich lokal, gespeichert würden. Angreifende müssten also zum gesicherten Rechenzentrum vordringen und dort den verschlüsselten Rechner knacken. Zudem habe auch die parlamentarische Datenschutzbeauftragte das System abgesegnet.

Systeme sind fehleranfällig

Neben diesen potenziellen Missbrauchsrisiken der gesammelten Daten sind biometrische Erkennungssysteme darüber hinaus fehleranfällig. So hört man laut futurezone auch von Parlamentarier:innen, dass es im Probebetrieb des Systems zu Fehlern kam – wenn beispielsweise nach dem Wochenende ein Dreitagebart das sonst glatte Gesicht zierte. Diese Fehleranfälligkeit ist nichts Neues. So funktionieren Gesichtserkennungssysteme bei People of Colour oft schlechter, weil die zugrundeliegende Technik überdurchschnittlich von weißen Männern entwickelt wird, sowie die Systeme überwiegend mit Bildern weißer Personen trainiert werden. Teilweise werden die Systeme sogar mit den biometrischen Daten von unzähligen Unfreiwilligen zur Marktreife entwickelt.

Zudem konnte der Chaos Computer Club – besonders in Person des Sicherheitsforschers „starbug“ – immer wieder zeigen, dass biometrische Technik nicht nur gefährlich, sondern auch kompromittierbar ist – und gehackt werden kann. Das demonstrierte er unter anderem 2017 an einem von Samsung verbauten Iris-Scanner. 2018 führten starbug und Julian Albrecht auf dem CCC-Kongress sogar vor, wie man Venenscanner austricksen kann. Diese galten bis dahin als die sicherste Form biometrischer Erkennungssysteme.

Gewöhnungseffekt für Biometrie

Das neue System soll dem Parlament ab Eröffnung zur Verfügung stehen. Derzeit sei es noch in Feinabstimmung, wie das Parlament gegenüber futurzone mitteilte. Die Kosten für die Einführung sowie den Hersteller will man allerdings nicht preisgeben.

Auf Seiten der Parlamentarier:innen äußerte man sich bisher eher zurückhaltend oder zustimmend; Süleyman Zorba, Netzpolitik-Sprecher der Grünen, betonte, dass hier auch keine fremden Personen gescannt würden. Die Partei NEOS begrüßt das System in seiner derzeitigen Umsetzung, verweist aber auf die Gefahren von unfreiwilliger Massenüberwachung im öffentlichen Raum. Genau das aber könnte in der Europäischen Union (EU) drohen. So will die Kommission sowie auch die Mitgliedstaaten automatisierte Gesichtserkennung innerhalb der EU erlauben. Folglich droht im anstehenden AI Act der EU kein eindeutiges Verbot von biometrischer Massenüberwachung verankert zu werden.

Edward Snowden warnte schon 2017 dass der Einsatz von automatisierter Gesichtserkennung, egal in welchen Kontext, zu einem gefährlichen Gewöhnungseffekt an diese Technik führen könnte. Ob man diese Technik daher nur für diffuse Effizienzgewinne etablieren sollte, die im besten Fall einige Mitarbeiter:innen an der Sicherheitsschleuse ersetzt, kann zumindest infrage gestellt werden.