Die Gesichtserkennungsfirma Clearview AI wehrt sich juristisch gegen die Auflagen kanadischer Datenschutzbehörden, ihren Dienst in dem Land einzustellen und die Fotos kanadischer Bürger:innen aus ihrer Datenbank zu löschen. Wie Heise Online berichtet, hat das US-Unternehmen jüngst einen Antrag vor dem obersten Gericht der Provinz British Columbia eingebracht. Demnach sei das Verbot „unangemessen“ und zudem verfassungswidrig.

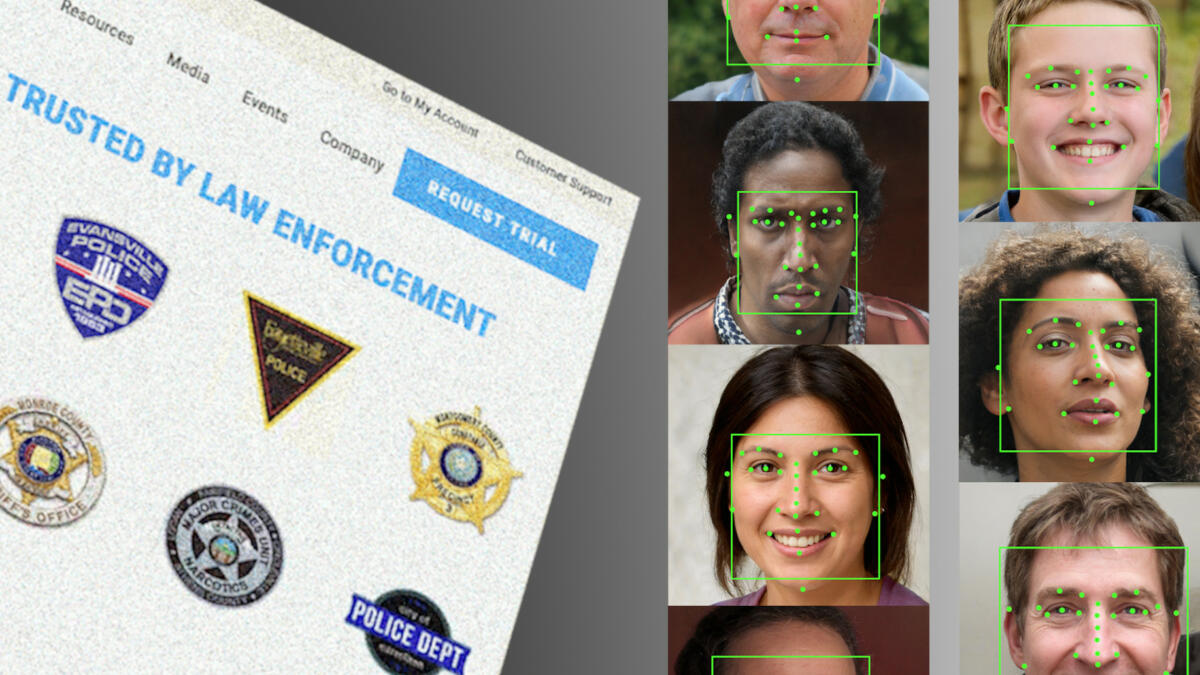

Das Start-up Clearview AI ist vor zwei Jahren nach einer Recherche der New York Times schlagartig international bekannt geworden. Eigenen Angaben zufolge hat das Unternehmen über zehn Milliarden Fotos mit Gesichtern aus dem Internet heruntergeladen, sie biometrisch vermessen und in eine durchsuchbare Datenbank gepackt.

Anhand nur eines Fotos lassen sich dann weitere Aufnahmen des gleichen Menschen ausfindig machen, die beispielsweise in sozialen Medien gepostet wurden. Zu den Kund:innen zählen vor allem Ermittlungsbehörden in aller Welt. Sie versuchen damit Verdächtige zu identifizieren, selbst wenn die Technik nicht restlos zuverlässig funktioniert.

„Massenüberwachung und illegal“

Datenschützer:innen warnten vor dem Ende der Privatsphäre, während viele Behörden gegen den oftmals rechtlich fragwürdigen Dienst vorgingen. „Was Clearview macht, ist Massenüberwachung und ist illegal“, sagte Kanadas oberster Datenschützer, Daniel Therrien. Nach einer Untersuchung verlangte er im Dezember von Clearview AI, keine Bilder mehr von kanadischen Bürger:innen zu sammeln sowie bereits vorhandene Daten zu löschen.

Clearview AI macht nun geltend, nicht mehr in Kanada tätig zu sein, weshalb die dortigen Datenschutzgesetze nicht anwendbar seien. Sollte dies doch der Fall sein, würden bestimmte Abschnitte des Gesetzes das Grundrecht des Unternehmens auf freie Meinungsäußerung einschränken. Zudem seien die abgezogenen Bilder öffentlich verfügbar und damit beliebig nutzbar. Letzteren Punkt sehen die großen Online-Dienste wie Google oder Facebook freilich anders. Für sie ist das Vorgehen von Clearview AI ein Verstoß gegen ihre Nutzungsbedingungen, mehrere Klagen werden derzeit verhandelt.

Schließlich führt Clearview AI aber auch an, die Anordnung gar nicht umsetzen zu können. Um ihr nachzukommen, müsste das Unternehmen in der Lage sein herauszufinden, ob es sich um Einwohner:innen British Columbias handelt. Dies sei nicht möglich. Etwaige in den Fotos gespeicherte Metadaten würden nicht weiterhelfen, da sich daraus nicht auf den Wohnort schließen lasse.

Datenschutz ohne Durchsetzung

Das gleiche grundsätzliche Problem stellt sich auch in Europa. Hier sind biometrische Daten spätestens seit der Datenschutzgrundverordnung (DSGVO) zwar besonders geschützt, das Geschäftsmodell von Clearview AI ist also nicht ohne weiteres möglich. Allerdings gelang es bislang nicht, die Geschäftstätigkeit des Unternehmens wirksam einzuschränken oder gar die Daten aller EU-Bürger:innen löschen zu lassen.

Einzelpersonen müssen sich individuell an Clearview AI wenden und um die Löschung ihrer Daten bitten. Selbst dann werden aber möglicherweise nicht die Bilder aus der Datenbank entfernt, sondern lediglich der sogenannte Hashwert, also das mathematische Modell des jeweiligen Gesichts. Hinweise dafür liefert der konkrete Fall des deutschen Informatikers Matthias Marx, der selbst gegen seinen Willen in der Datenbank von Clearview gelandet ist.

Die Datenschutzbehörde Hamburg, die mit Bescheiden gegen Clearview AI vorgegangen war, bezweifelt, dass das Geschäftsmodell des Unternehmens in der EU legal ist. Zu einem europaweiten Verbot reicht es dennoch nicht – auch nicht zu einem Verbot auf nationaler oder Länderebene. Gründe dafür teilte die Behörde etwa dem Spiegel mit: Demnach wäre eine Anordnung zum Löschen von Daten etwa für alle Betroffenen in Hamburg wohl nicht umsetzbar. Clearview bräuchte dafür Informationen über den gewöhnlichen Wohnort der Betroffenen. „Davon ist nicht auszugehen“, heißt es.

Gegenüber netzpolitik.org sagte ein Sprecher der Behörde im Dezember:: „Nur über eine koordinierte Aktion aller oder mehrerer Aufsichtsbehörden in Europa wäre ein gemeinsamer Vollzug möglich“.

Clearview AI ist nicht das einzige Unternehmen dieser Art. Unter anderem sammelt das ursprünglich aus Polen stammende PimEyes massenhaft Gesichtsdaten, entzieht sich seit der Flucht auf die Seychellen aber europäischen Datenschutzbehörden. Dem werden auch die zaghaften Versuche, den Einsatz automatisierter Gesichtserkennung nur unter Auflagen zuzulassen, nur wenig entgegensetzen können. Selbst wenn sich die EU zu einem rigorosen Verbot durchringen könnte, wie es etwa das EU-Parlament gefordert hatte, würde das nicht sicherstellen, dass sensible Daten nicht in undurchsichtigen Datenbanken landen und auf schwer nachvollziehbare Weise eingesetzt werden.