Die vergangenen Wochen brannten vor Beschwerden über das angebliche „europäische Bürokratiemonster“ EU-Datenschutz-Grundverordnung (DSGVO), Seehofers Machtspiele um die Asylpolitik sowie die EU-Urheberrechtsreform, die Online-Plattformen zum Einsatz so genannter Upload-Filter verpflichten könnte. Das alles sind natürlich wichtige Themen. Und sie hängen enger zusammen, als der erste Blick vermuten lässt. Dennoch gingen – und gehen – in den Debatten wesentliche Aspekte verloren, vernachlässigt man bei der Betrachtung die Entwicklung von „Algorithmen“ und „Künstlicher Intelligenz“.

Längst haben diese „KI-Technologien“ praktische Relevanz erlangt – unabhängig davon, ob man maschinelle Lernverfahren, Big Data und Quantencomputer als Lösung aller großen Probleme der Menschheit betrachtet oder eine sich verselbständigende Intelligenz und das Ende der Menschheit fürchtet. Es kommt bereits auf die richtige Gestaltung an und die wartet leider nicht auf das Ende der geplanten Enquete-Kommission des deutschen Bundestages, sondern steht bereits jetzt zur Debatte.

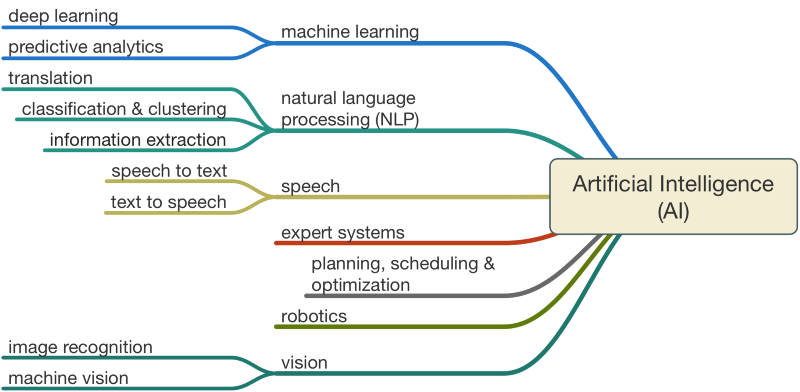

Algorithmen und Künstliche Intelligenz: Wo stehen wir?

Durchbrüche in einer Reihe an Analysesystemen haben im Zusammenhang mit weltweiter Vernetzung, der massiven Verfügbarkeit von Daten und der exponentiell gewachsenen Rechnerleistung dazu geführt, dass langsam möglich wird, wovon Menschen seit Jahrzehnten träumen: Lernfähige Maschinen. Also smarte Software, die in Verbindung mit steuerungsfähiger Hardware immer mehr Arbeit (Entscheidungen) übernehmen kann, die bislang Menschen vorbehalten war, etwa bei der Analyse komplexer Sachverhalte wie der Identitätsfeststellung eines Menschen, der Bewertung von nationalen Sicherheitsniveaus oder der Steuerung autonomer Waffensysteme. Hoffnungsvoll stimmt natürlich das Versprechen, dass Künstliche Intelligenz dazu beitragen kann, Krankheiten frühzeitig zu identifizieren und zu therapieren. Einen Schreck bekommen die meisten beim Thema „Todesalgorithmus“ – wenn algorithmische Entscheidungssysteme darüber bestimmen sollen, welcher krebskranke Patient welche Therapie erhalten soll. All diese Themen werden an anderer Stelle gerade ausführlich debattiert, aber was hat das Ganze mit der DSGVO, Seehofer und Upload-Filtern zu tun?

Warum die EU-Datenschutz-Grundverordnung von äußerster Bedeutung ist

Bekanntermaßen stellen diese Technologien gesellschaftliche Transparenz und Kontrolle vor große Herausforderungen, in Abhängigkeit von ihrer Komplexität und Dynamik (Übersicht Lösungsansätze). Experten debattierten die Möglichkeiten der so genannten sich-selbst-erklärenden Algorithmen etwa jüngst auf der Cebit. Bei diesen technischen Debatten geht jedoch regelmäßig der Blick für den politisch-ökonomischen Gesamtzusammenhang verloren. Denn es sind eben nicht die Algorithmen, die in neuronalen Netzen ganz unbestimmt nach Zusammenhängen suchen. Sondern Menschen beziehungsweise Unternehmen, die über die Daten verfügen, in denen Suchalgorithmen nach Zusammenhängen suchen – und die vorgeben, welche Daten für welchen Zweck in welcher Breite oder Tiefe durch welche Algorithmen durchforstet werden sollen (Hintergrund). Und die natürlich auch über die Daten verfügen, mithilfe derer algorithmische Systeme geprüft und erklärt werden können. Politisch betrachtet führt das Ganze zu zwei wesentlichen Fragen:

- Wer soll mit welchen Daten KI-Technologien entwickeln, anwenden und überprüfen dürfen?

- Wie lässt sich gewährleisten, dass KI-Technologien auf den „richtigen“ Daten lernen – beispielsweise korrekten, aktuellen, repräsentativen und dem jeweiligen Zweck entsprechende Daten? (Um im Bild von Angela Merkel zu bleiben: Welches Futter braucht die KI-Entwicklung, damit aus den erwünschten Rindern keine Frösche erwachsen?)

Bei beiden Fragen bietet die DSGVO zwar keine erschöpfende Antwort, aber erste Ansätze: Denn einerseits verpflichtet sie Betreiber algorithmischer Entscheidungssysteme in Art. 22 dazu, den so genannten Datensubjekten im Falle einer automatisierten Entscheidungsfindung (inklusive Profiling) Information bezüglich der involvierten Logik eines Entscheidungssystemen, seiner Tragweite und angestrebter Auswirkungen zu geben. Dazu zählt auch das Recht auf menschliche Intervention. Ohne die Kenntnis der Betroffenheit von algorithmischer Entscheidungsfindung und ihrer Logik kann keiner überlegen, ob die Entscheidung korrekt ist oder überprüft oder in Frage gestellt werden muss. Andererseits beinhaltet sie in Art. 13–16 die Rechte, personenbezogene Daten einzusehen, sie zu korrigieren und der Nutzung zu widersprechen – und bietet so eine erste Form der Qualitätssicherung: dass Künstliche Intelligenz auf den “richtigen Daten” lernt. Darüber hinaus verpflichtet sie in Art. 35 die Betreiber algorithmischer Entscheidungssysteme dazu, in Abhängigkeit von den Risiken der Datenverarbeitung eine Datenschutz-Folgeabschätzung zu erstellen – und ein Sicherheitskonzept zu entwickeln, insbesondere für Worst-Cases. Auch das ist sinnvoll, denn jedes algorithmische System kann manipuliert oder gehackt werden.

Nun haben diese positiven Verpflichtungen aber einige Haken: Art. 22 und 35 erstrecken sich beispielsweise nur auf voll-automatisierte Entscheidungen, die meisten Systeme sind jedoch semi-autonom konzipiert. Zudem nutzen neuere Formen des Profiling eher die Daten, die sich aus der Kommunikation und Interaktion von Menschen mit Geräten ergeben als personenbezogene Daten. Dazu gehören etwa Suchanfragen oder Gesprächsinhalte von Messengern – Daten, die nicht von der DSGVO gedeckt sind. Allein deshalb brauchen wir ergänzend die E‑Privacy-Verordnung und eine kluge Regulierung von Datenzugangsrechten. Dennoch beinhaltet die DSGVO wesentliche Grundlagen, um die Gestaltung künstlich intelligenter Systeme anzugehen. Sie ist wegweisend.

Warum Seehofer die falsche Sicherheitsdebatte vom Zaun bricht

Während unser Minister für Inneres und Heimat die x‑te Asyldebatte vom Zaun bricht und die gesamte Regierung riskiert, scheinen die Risiken von Künstlicher Intelligenz völlig unbeachtet. Dabei berühren sie zentral die nationale Souveränität und Sicherheit der Bevölkerung: Wie etwa eine Schriftliche Anfrage zu Algorithmen in der Bundesverwaltung durch die SPD-Politikerin Saskia Esken im Januar 2018 ans Licht brachte, gibt es laut Bundesregierung keine Kenntnisse darüber, auf Basis welcher Daten die Gesichtserkennungssoftware trainiert wurde, die am Berliner Südkreuz als Gemeinschaftsprojekt des BMI, der Bundespolizei, des Bundeskriminalamts und der Deutschen Bahn AG erprobt wird. Mit dem Verweis auf „Mustererkennung“ scheint alles gesagt – wobei es viele Verfahren gibt, Muster zu erkennen und gravierende Identifikationsfehler.

Leider betrifft die mangelnde Übersicht über eingesetzte Technologien nicht nur den Einzelfall. Sie betrifft auch die Frage, wie weit die gesellschaftliche Steuerung durch Algorithmen bereits entwickelt und in Anwendung ist: Sie ziele auf eine Kontextsteuerung, so der Verwaltungswissenschaftler Klaus Lenk. Statt Zwang und Anreizen soll der Kontext von Menschen technologisch so gestaltet sein, dass sie möglichst automatisch das Richtige tun. Hier wirkten prospektiv verschiedene Technologien zusammen:

- Personalisierung der informationellen Umgebung von Menschen und Organisationen

- Profilbildung für die Zuweisung von Positionen und Lebenschancen

- Verhaltenssteuerung durch technische Architekturen („Nudging“)

Im Endeffekt bekäme man nur das angeboten und zu sehen, was der individuellen Position und ihrer vermeintlichen Bedürfnisse entspricht. Die Beschreibung klingt zwar sehr einleuchtend. Allerdings ist unklar, wo wir stehen: Welche Systeme funktionieren und interagieren wie miteinander? Welche Rolle nehmen hier die Plattformen ein? Wo haben wir es mit Steuerung und wo mit Selbst-Steuerung zu tun? Welche Risiken ergeben sich daraus? Und letztlich: Funktioniert’s überhaupt?

Hintergrund für dieses undurchsichtige Dickicht ist die Tatsache, so der KI-Forscher Matthew Scherer, dass ein Großteil der Entwicklung von Einzelkomponenten (Datensets, Algorithmen, algorithmischen Entscheidungssystemen, Schnittstellen, etc.) in einem bislang unregulierten, internationalen Setting stattfindet, das von einer unüberschaubaren Anzahl von Akteuren bestimmt wird. Da das Potenzial algorithmischer Entscheidungssysteme oft erst im Zusammenwirken dynamischer Technologien zutage tritt, sind Risiken hinsichtlich der Funktionalität und Kontrolle gegeben, die durch mangelnde Verantwortlichkeiten infolge unterschiedlicher territorialer Rechtsbereiche befördert wird. Hier Übersicht herzustellen über sich in der Entwicklung und Anwendung befindliche Technologien, inklusive involvierter Akteure und angemeldeter Patente, scheint wesentliche Voraussetzung für eine adäquate Risikoanalyse – und darauf aufbauend – Strategien der Risiko-Bewältigung.

Vermutlich sollte eine solche Übersicht zu Künstlicher Intelligenz Maßnahmen wie dem staatlichen „Hackback“ oder der Förderung der Interoperabilität von EU-Informationssystemen voraus gehen, zumindest solange EU-Identifikationssysteme 33% Sicherheitsrisiken aufweisen. Sie könnte moderne Formen des E‑Government vielleicht sogar unterstützen.

Aber man kann stattdessen auch mit Asylpolitik Stimmung machen.

Warum Upload-Filter eine schlechte Idee sind

Die Debatte um Upload-Filter – um Softwaresysteme, die auf großen Plattformen eingesetzt werden sollen, um die Veröffentlichung von strafbaren Materialien zu verhindern – ist aktuell Gegenstand der EU-Urheberrechtsreform. Auch für die Bekämpfung von terroristischen oder extremistischen Inhalten werden Upload-Filter als scheinbar passables Werkzeug regelmäßig ins Spiel gebracht. Für so manchen Politiker scheint es attraktiv zu sein, unliebsame Inhalte oder Hate Speech schon vor ihrer Veröffentlichung herauszufiltern. Technik wirkt natürlich immer viel neutraler und sauberer als lange Debatten in der Öffentlichkeit.

Aber das Ganze ist nicht unproblematisch: Einerseits können vielfältige Fehler auftauchen, die beispielsweise von Julia Reda im Bereich vermeintlicher Urheberrechtsverletzungen gesammelt und veröffentlicht werden (ganz zu schweigen von den Problemen mit Memes und Satire). Andererseits scheint es gerade im Angesicht dieser Fehler bedenklich, die Meinungs- und Informationsfreiheit schon vor Veröffentlichung und möglicher Beschwerde zu beschränken. Zudem würden durch eine Verpflichtung der Online-Plattformen auf den Einsatz von Upload-Filtern kleinere benachteiligt, welche die hohen Entwicklungskosten entsprechender Software nicht tragen können – und alternativ höchstens durch den Kauf von Software-Lizenzen rechtskonform arbeiten könnten. Das käme einer weiteren Monopolisierung der Plattformindustrie gleich.

Unterbeleuchtet bleibt auch hier die Rolle Künstlicher Intelligenz: Sie soll mit selbst-lernenden Algorithmen durch die Analyse großer Mengen an Daten dazu beitragen, neue Erkenntnisse zu generieren. Neue Erkenntnisse erlauben neue Strategien und tragen damit zu einem Wandel von Normen und Werten bei. Man muss nicht einmal den Sieg von Alpha Go! über den Menschen berücksichtigen, um die Bedeutung „maschineller Kreativität“ zu entdecken. Eigentlich reicht das logische Durchdenken aktueller Probleme: Wenn 10.000 Kommentare als Hate Speech gelabelt werden oder 10.000 Kommentare wie bei Jigsaw (Alphabet Inc.) in einer Toxizitätsskala danach verortet werden, wie hoch das Risiko ist, dass ein Teilnehmer die Debatte verlässt: Welche Zusammenhänge lernt eine Maschine, wonach entscheidet sie? Wahrscheinlich verschiebt sich der Fokus von der Idee hin zur Sprache, zum Ausdruck an sich. Möglicherweise kommen aber ganz andere Variablen ins Spiel – Variablen, über deren Angemessenheit Techniker und Geschäftsleute entscheiden anstelle von Richtern, Politikern oder Soziologen. Kann eine derart erwachsene maschinelle Entscheidung über Grundrechte legitim sein?

Die Gesellschaft als lebendiges Experimentierfeld

Alle großen Plattformen experimentieren derzeit mit Formen automatisierter Inhalte-Regulierung in verschiedenen thematischen und medialen Bereichen, die mitunter ganz neue Erkenntnisse über menschliche Debatten und Interventionsmöglichkeiten generieren dürfte. Aber wie gesagt: Zum gegenwärtigen Zeitpunkt ist all dies noch (hoch-)experimentell. So schätzte Facebook-Chef Mark Zuckerberg bei seinen Anhörungen zum Cambridge-Analytica-Skandal im US-Kongress gleichermaßen optimistisch wie unscharf, es dauere noch rund 5–10 Jahre, bis Facebook „Hassrede“ zuverlässig erkennen könne. Wie kann es dann sinnvoll oder gerechtfertigt sein, Online-Plattformen zum jetzigen Zeitpunkt auf Upload-Filter samt KI zu verpflichten – wo doch noch gar nicht klar ist, was deren Ergebnis ist? Wäre es nicht sinnvoll, die Plattformen zunächst zu Transparenz hinsichtlich ihrer Funktionsweise, Sicherheitsrisiken und Bewältigungsmaßnahmen zu verpflichten und in einen Dialog zu treten mit Legislative und Judikative, um die Chancen und Risiken automatisierter Inhalte-Regulierung zu eruieren? Und so lange beim altbewährten (und mittlerweile technisch gut unterstützen) Notice-and-Take-Down-Verfahren zu bleiben? Immerhin: Wir leben in einem Informationskrieg, der gerade durch fehlende Verantwortlichkeiten übelste Blüten trägt und durch falsche Reaktionen noch viel schlimmer werden kann. Ist die Urheberrechtsindustrie tatsächlich willens, die Zerstörung demokratischer Debatten und Nationalstaaten auf ihre Kappe nehmen? I wouldn’t.

Es ist längst überfällig, dass die drängenden Themen eine adäquate demokratische Bearbeitung finden durch die Bundesregierung, EU-Kommission, Bundestag und EU-Parlament. Dass überholte Machtkonflikte und kurzsichtige Wahlkampfmanöver mal beiseite gelegt werden könnten, damit die Themen Platz finden, die jetzt schon über das Schicksal zukünftiger Generationen bestimmen. Sicher gibt es mehr als Algorithmen und Künstliche Intelligenz. Aber sie wirken schon seit geraumer Zeit überall hinein und sollten entsprechende Berücksichtigung finden. Stellen wir die Weichen nicht rasch und gemeinsam, wird’s allein der Markt richten. Zu seinen Gunsten, nicht zu unseren.