Algorithmic Decision Making

-

Datenjournalismus: TikToks Algorithmus drängt zu Nischeninhalten

TikToks Algorithmus übt eine Sogwirkung auf die Nutzer:innen aus (Symbolbild). Datenjournalismus: TikToks Algorithmus drängt zu Nischeninhalten Der Algorithmus der Videoplattform basiert auf der Verweildauer der Nutzer:innen auf den einzelnen Videos. Eine Datenrecherche des Wall Street Journals deckt auf, wie TikTok so in kürzester Zeit Interessenprofile generiert und genau zugeschnittene Inhalte ausspielt.

-

Automatisierte Entscheidungen: Gerechtigkeit ist kein Plugin

Gerecht oder genau? Weil die Regeln im Leben nicht immer so klar sind wie auf dem Tennisplatz, kann diese Entscheidung nicht allein von Maschinen getroffen werden. Automatisierte Entscheidungen: Gerechtigkeit ist kein Plugin Faire maschinelle Entscheidungen werden immer dann zum Thema, wenn Ungleichbehandlung ans Tageslicht tritt. Dabei ist gar nicht so klar, was mit Fairness gemeint ist. Dieser Gastbeitrag erklärt, warum Gerechtigkeit nicht einfach als Plugin aktiviert werden kann und wie vielleicht dennoch faire Algorithmen entstehen können.

-

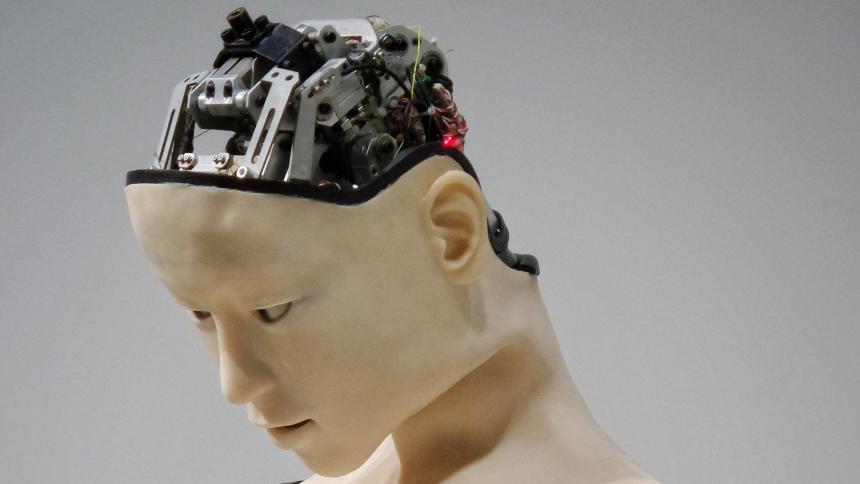

Algorithmen für Bewerbungen: Das Bücherregal im Hintergrund hat Einfluss darauf, ob Du den Job bekommst

Statt "zurückhaltend" plötzlich als "lebhaft" von der KI bewertet - wegen des Bücherregals. (Das Bild ist nicht aus der Recherche des Bayerischen Rundfunks.) Algorithmen für Bewerbungen: Das Bücherregal im Hintergrund hat Einfluss darauf, ob Du den Job bekommst Der Computer soll entscheiden, welche Bewerberin einen Job bekommt. Dass solche Systeme noch nicht funktionieren, zeigt eine Recherche des Bayerischen Rundfunks.

-

Algo.Rules: Mit 145 Fragen zu besseren Entscheidungssystemen

Technische Entscheidungen können soziale Auswirkungen haben und dürfen nicht dem Zufall überlassen werden. Ein neuer Praxisleitfaden soll helfen, möglichst früh die richtigen Fragen zu beantworten. Algo.Rules: Mit 145 Fragen zu besseren Entscheidungssystemen Mit ihren „Algo.Rules“ legt die Bertelsmann Stiftung einen Werkzeugkoffer für Entwickler:innen, Programmierer:innen und Designer:innen von automatisierten Entscheidungsregeln vor. Neben neun grundsätzlichen Regeln setzt der Leitfaden vor allem auf Orientierungsfragen für die Praxis.

-

Datenrassismus: Eine neue Ära

Technology is never neutral. Datenrassismus: Eine neue Ära Datenbasierte Technologien bringen nicht nur mehr Effizienz. Sie werden auch zur Gefahr für jene, die ohnehin schon strukturell am Rand stehen. In ihrem Gastbeitrag erklärt Sarah Chander, was Datenrassismus ist, wie er sich auf Betroffene auswirkt und was wir dagegen tun können.

-

Algorithmische Entscheidungen: Warum das Scoring polnischer Arbeitssuchender gescheitert ist

Algorithmische Entscheidungen beeinflussen zunehmend Lebenswege. (Symbolbild) Algorithmische Entscheidungen: Warum das Scoring polnischer Arbeitssuchender gescheitert ist Polen wollte Arbeitssuchende mit einem Algorithmus bewerten, musste den umstrittenen Versuch jedoch zurückziehen. Aus dem gescheiterten Anlauf lassen sich jedoch einige Lehren ziehen – um besser gegen ähnliche Maßnahmen in anderen EU-Ländern gewappnet zu sein. Die österreichische Digital-NGO epicenter.works sucht nun Betroffene, die womöglich algorithmisch diskriminiert wurden.

-

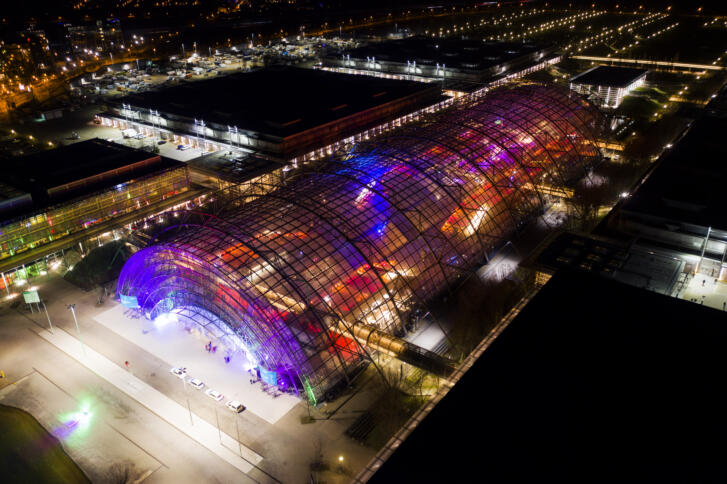

Chaos Communication Congress: Unsere Vorträge vom 36c3 zum Nachschauen

Der 36c3 aus der Luft Chaos Communication Congress: Unsere Vorträge vom 36c3 zum Nachschauen Wir haben für euch die Vorträge zusammengestellt, die von unseren Autorinnen und Autoren auf dem 36. Chaos Communciation Congress gehalten wurden. Es ging dabei unter anderem um Massenüberwachung, digitale Migrationskontrolle und algorithmische Entscheidungsstrukturen.

-

Konzernmacht: Der selbstgebaute Algorithmus

Wer oder was ist Donald Trump laut Google Autocomplete? In jedem Fall kein Idiot. Konzernmacht: Der selbstgebaute Algorithmus Bisher hatte Google stets behauptet, die Algorithmen seiner Suchmaschine seien objektiv und unbefleckt von menschlichen Interventionen. Jetzt zeigen Recherchen des Wall Street Journal: Der Konzern greift sehr wohl in die Suchergebnisse ein. Er gesteht nur nicht ein, mit welchen Mitteln.

-

: NPP 178: Wenn Algorithmen unabsichtlich diskriminieren

Du ja, du nein. Wenn Maschinen versehentlich diskriminieren, müssen Menschen das erkennen und eingreifen. : NPP 178: Wenn Algorithmen unabsichtlich diskriminieren Kein Kredit, weil du nicht oft genug bei Mama anrufst? Keine Versicherung, weil du in der falschen Facebook-Gruppe hängst? Gegen Diskriminierung aufgrund von Geschlecht, Herkunft, Alter oder Religion gibt es Gesetze. Aber was passiert, wenn Algorithmen in ihren Vorhersagen unabsichtlich diskriminieren? Wir sprachen mit Daniel Schwarcz über Gleichbehandlung im Zeitalter von Künstlicher Intelligenz.

-

: Facebook’s Algorithm Shapes Our Lives. This Hacker Wants to Find Out How.

Claudio Agosti in Berlin : Facebook’s Algorithm Shapes Our Lives. This Hacker Wants to Find Out How. Claudio Agosti wants to know what Facebook does with him. The programmer has developed a browser extension that collects data donations from users. He wants to decipher why we only get to see very specific political news – and what Facebook is hiding from us in their News Feed.

-

: NPP 175 mit Caroline Sinders: Wie trainiert man einen feministischen Algorithmus?

Achtung, Cinderella. Dieser Mann könnte deine "Discover Weekly"-Playlist gefährden. : NPP 175 mit Caroline Sinders: Wie trainiert man einen feministischen Algorithmus? Welche Daten-Zutaten kommen in meinen Algorithmus? Kann man in Songtexten von Beyoncé und Büchern von Virginia Woolf feministische Muster erkennen? Mit Fragen wie diesen will die Forscherin Caroline Sinders die Debatte um maschinelles Lernen ankurbeln. Ihr Ziel: Auch ihr Vater soll Algorithmen verstehen können.

-

: Warum Künstliche Intelligenz Facebooks Moderationsprobleme nicht lösen kann, ohne neue zu schaffen

Nicht maschinenlesbar: Meinungsfreiheit lässt sich nicht in Formeln übersetzen. : Warum Künstliche Intelligenz Facebooks Moderationsprobleme nicht lösen kann, ohne neue zu schaffen Der Datenkonzern Facebook setzt bei der Moderation von Inhalten zunehmend auf Automatisierung. Eine Quelle erklärt uns erstmals, wie sich die Maschinen auf die Moderationsarbeit auswirken. Auch wenn am Ende heute immer noch Menschen entscheiden: Die automatisierte Inhaltserkennung verändert die digitale Öffentlichkeit grundlegend.

-

: Hohes Diskriminierungspotential bei automatisierten Entscheidungen

Algorithmen sind immer häufiger an Entscheidungen beteiligt. : Hohes Diskriminierungspotential bei automatisierten Entscheidungen In vielen gesellschaftlichen Bereichen werden Entscheidungen bereits von Algorithmen getroffen. Doch das ist mit Risiken für den Menschen verbunden. Mit dem „Atlas der Automatisierung“ möchte AlgorithmWatch zu mehr Transparenz in der automatisierten Entscheidungsfindung beitragen.

-

: Gesichtserkennung: Kritik macht Algorithmen genauer, nicht nur für weiße Männer

Zu Testzwecken hielt MIT-Forscherin Joy Buolamwini ihr eigenes Gescht in die Kamera - und wurde von vielen Systemen erst erkannt, als sie sich eine weiße Maske aufsetzte. : Gesichtserkennung: Kritik macht Algorithmen genauer, nicht nur für weiße Männer Die MIT-Forscherin Joy Buolamwini hat untersucht, wie ihre Kritik an diskriminierender Gesichtserkennung zur Lösung des Problems beiträgt. Ein halbes Jahr nach ihrer Studie zeigt sich: unabhängige Beobachtung wirkt. IBM, Microsoft und andere Hersteller erkennen nun Gesichter von Schwarzen und Frauen besser.

-

: Fortschritt oder Mythos? Buch sammelt kritische Stimmen zur Mustererkennung

Softwaregestützte Vorhersagen werden oft als neutrale Beschreibung der Zukunft angesehen. Dabei können sie Anlass dazu geben, sich für eine andere Zukunft einzusetzen - und damit das Vorhergesagte selbst zu widerlegen. : Fortschritt oder Mythos? Buch sammelt kritische Stimmen zur Mustererkennung Von eingespeisten Daten bis zum Output: Technische und soziale Diskriminierung durchzieht alle Ebenen von sogenannten Mustererkennungsverfahren. Das Buch „Pattern Discrimination“ liefert dort spannende Einsichten, wo Fortschrittsglaube und Marktlogik die gesellschaftlichen Auswirkungen sonst verschleiern.

-

: Datenethik: Projekt #algorules will Richtlinien für Programmierer*innen

Der heilige Benedikt hat seine Regeln einfach heruntergereicht. #algorules will das etwas offener gestalten. : Datenethik: Projekt #algorules will Richtlinien für Programmierer*innen Die Bertelsmann Stiftung und das iRightsLab arbeiten an einem Ethik-Kodex für Entwicklerinnen und Entwickler von Algorithmen. Bis zum 21. Dezember können Interessierte Feedback zum aktuellen Stand der Entwicklung geben.

-

: Interview mit KI-Forscher Toby Walsh: „Wir müssen jetzt die richtigen Entscheidungen treffen“

Die Maschinen arbeiten und wir hängen ab? So sieht es im Bestfall aus, wenn wir Arbeit besser verteilt bekommen, sagt Toby Walsh. : Interview mit KI-Forscher Toby Walsh: „Wir müssen jetzt die richtigen Entscheidungen treffen“ Keine Panik, Künstliche Intelligenz wird uns nicht umbringen, sondern unser Leben besser machen. Das sagt Toby Walsh, einer der führenden Experten aus der KI-Forschung. Allerdings müssen wir uns dazu klar werden, was ein gutes Leben ausmacht. Ein Gespräch darüber, was wir an Maschinen delegieren sollten, welche Jobs für uns übrig bleiben und warum alte Werte auch für neue Technologien gelten.

-

: Enquête-Kommission Künstliche Intelligenz: Sachverständige und Abgeordnete klären Grundbegriffe

Die Enquête-Kommission des Deutschen Bundestages startete mit einem Crashkurs zu Künstlicher Intelligenz. : Enquête-Kommission Künstliche Intelligenz: Sachverständige und Abgeordnete klären Grundbegriffe Die Enquête-Kommission „Künstliche Intelligenz – Gesellschaftliche Verantwortung und wirtschaftliche, soziale und ökologische Potenziale“ hielt am Montag ihre erste Klausurtagung ab. Der Kommission gehören insgesamt 19 Abgeordnete sowie 19 externe Sachverständige an. Für einige der Abgeordneten dürfte die Klausurtagung ein KI-Crashkurs gewesen sein.

-

: Bundestag: Enquete-Kommission untersucht Künstliche Intelligenz

Eine Enquete-Kommission zu Künstlicher Intelligenz soll dem Gesetzgeber konkrete Handlungsempfehlungen erarbeiten. : Bundestag: Enquete-Kommission untersucht Künstliche Intelligenz Zwei Jahre lang soll eine Enquete-Kommission untersuchen, wie sich Künstliche Intelligenz und algorithmische Entscheidungssysteme auf unsere Gesellschaft auswirken. Ob der Bundestag aber die erhofften Handlungsempfehlungen annehmen wird, bleibt bis auf Weiteres offen.