Die Suchmaschine PimEyes bedeutet das Ende der Anonymität im öffentlichen Raum. Ein Foto von einem Handy oder einer Sicherheitskamera genügt, schon liefert PimEyes zahlenden Nutzer:innen Links zu ähnlichen oder identischen Gesichtern im Netz. Die verlinkten Seiten können dann den Namen, den Beruf oder mehr zu einer gesuchten Person verraten.

Nach kritischen Berichten von netzpolitik.org im Jahr 2020 floh die einst polnische Firma zuerst auf die Seychellen, dann nach Belize – und beantwortete keine Fragen mehr. Politiker:innen aus Deutschland und der EU haben die Suchmaschine scharf kritisiert. Der Datenschutzbeauftragte für Baden-Württemberg, Stefan Brink, hat ein Verfahren eingeleitet. Er wartet nach eigener Aussage weiterhin auf eine Antwort von PimEyes.

Seit Anfang des Jahres gehört PimEyes einem 34-jährigen Sicherheitsforscher aus Georgien. Im Interview mit netzpolitik.org erklärt Giorgi Gobronidze, warum ausgerechnet er die Suchmaschine gekauft hat – und er stellt sich der Kritik, dass PimEyes ein Werkzeug für Stalker:innen sein kann. Das Interview wurde auf Englisch geführt. (Englische Version lesen.)

netzpolitik.org: Herr Gobronidze, mitten in Ihrer akademischen Karriere haben Sie eines der umstrittensten Tech-Unternehmen der Welt gekauft. Was haben Sie sich eigentlich dabei gedacht?

Giorgi Gobronidze: Als Wissenschaftler war ich an der Technologie interessiert. Für mich ist das kein reines Business-Projekt. Ich wollte schon immer mehr über Künstliche Intelligenz, Datenanalyse und Gesichtserkennung lernen. Ich will nicht sagen, dass es eine Art Experiment für mich ist, aber mindestens die Hälfte meiner Motivation ist reine akademische Neugier.

netzpolitik.org: Gibt es eine Verknüpfung zwischen PimEyes und Ihrer akademischen Arbeit?

Giorgi Gobronidze: Ich unterrichte an zwei Universitäten Georgiens, der International Black Sea University und der University of Georgia. Vor der Ukraine wurde Georgien 2008 zum Ziel der russischen Armee. Seit der russischen Invasion in Georgien interessiere ich mich für Sicherheitsstudien. Ich lernte viel über Technologie, denn einer der Hauptaspekte der russischen Invasion war der massive Cyberangriff, der das Land für fast drei Tage lahmgelegt hat. Später begann ich zu erforschen, wie Künstliche Intelligenz nicht nur die Sicherheit betrifft, sondern auch unser tägliches Leben.

netzpolitik.org: Wie viel hat Sie der Kauf von PimEyes gekostet?

Giorgi Gobronidze: Ich kann den Betrag nicht nennen, dazu verpflichtet mich mein Vertrag mit den vorigen Eigentümern. Ich musste einige Immobilien verkaufen, und mein Bruder hat mir geholfen. Mein Vater, der auch Geschäftsmann ist, wollte mir kein Geld dafür geben. Er hat nicht einmal verstanden, wovon ich rede. Wenn ich von KI spreche, glauben meine Eltern immer noch, dass ich so etwas wie in dem Film „Matrix“ mache. Sie warten auf den Aufstand der Maschinen in meinem Büro.

Datenbank mit rund 2 Milliarden einzigartigen Gesichtern

netzpolitik.org: Warum stand PimEyes überhaupt zum Verkauf?

Giorgi Gobronidze: Es gehörte irgendeinem Team in Belize. Diese Leute hatten kein Händchen fürs Geschäftliche. Sie dachten, dass PimEyes einfach nur Geld bringen würde und keine zusätzliche Arbeit erfordert. Aber es ist ein Problem, wenn man keine Bugs beseitigt, sich nicht um Datensicherheit und Privatsphäre kümmert und sich nicht bemüht, Vorschriften zu erfüllen. Das Unternehmen ist jetzt viel wertvoller, weil wir den ganzen Schlamassel beseitigt haben.

netzpolitik.org: Sie bieten jetzt auch einen kostenpflichtigen Service an: Auf Wunsch fordern Sie Websites auf, Bilder zu entfernen, wenn Kund:innen der Veröffentlichung nicht zugestimmt haben. Wie groß ist das Team hinter PimEyes?

Giorgi Gobronidze: Bis zu zwanzig Leute im Kernteam. Um Inhalte zu entfernen, haben wir eine Gruppe von zehn Leuten. Die haben kaum Zeit für Pausen, das ist ein Fulltime-Job. Sie arbeiten mit unserem Team von Support und Datensicherheit zusammen. Mehrere Mitarbeiter:innen kümmern sich bei uns um Datensicherheit, weil wir nicht wollen, dass die Bilder unserer Kund:innen nach außen dringen.

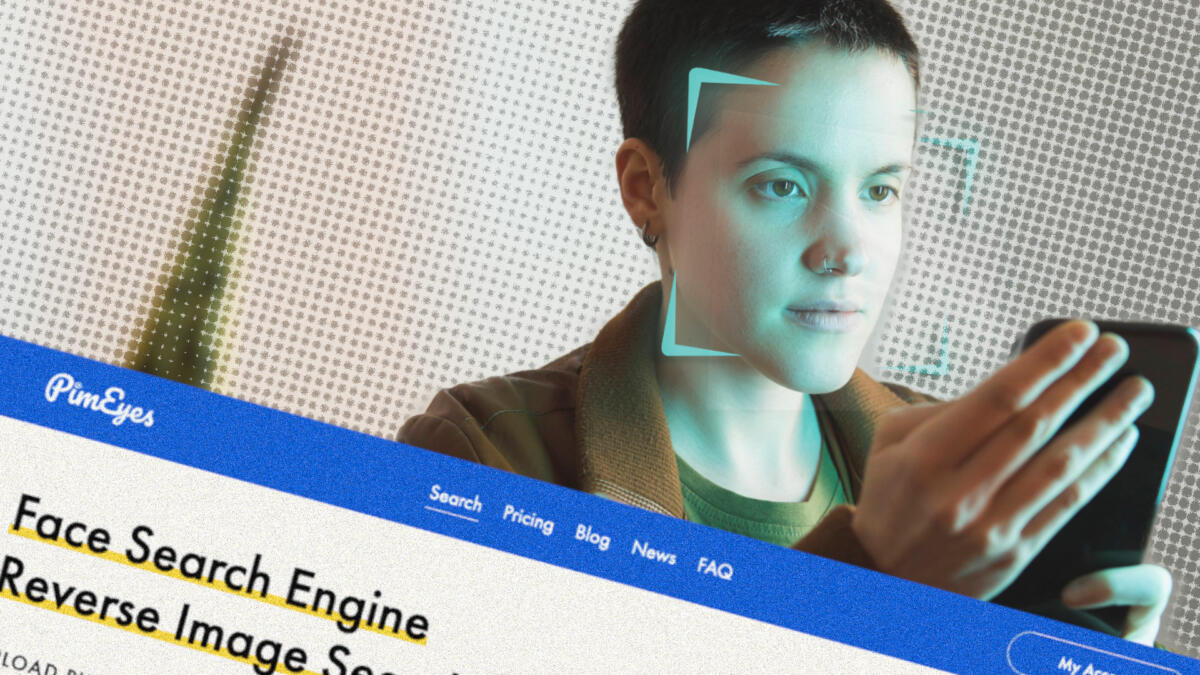

PimEyes-Nutzer:innen können Fotos hochladen und bekommen dann Links zu ähnlichen oder identischen Gesichtern im Netz angezeigt. Zahlende Nutzer:innen können auch Fotos hinterlegen und sich automatisch benachrichtigen lassen, wenn es dazu neue Suchergebnisse gibt. Die Datenbank von PimEyes besteht allerdings nicht aus Fotos, sondern aus Zahlencodes, sogenannten Hashes, die PimEyes aus den Gesichtern berechnet. Mithilfe der Hashes kann PimEyes blitzschnell Gesichter abgleichen. Lädt jemand ein Foto als Suchanfrage hoch, berechnet PimEyes den Hash des Gesichtes und sucht nach Übereinstimmungen mit der eigenen Datenbank. Um die Datenbank zu füttern, durchsucht PimEyes automatisch das Netz. Für nicht zahlende Kund:innen gibt es eine kostenlose Suchvorschau. – Alle Rechte vorbehalten: Screenshot Pimeyes.com

netzpolitik.org: Wie viele verschiedene Gesichter hat PimEyes in seiner Datenbank?

Giorgi Gobronidze: Ich kann die genaue Zahl nicht sagen, aber es sind maximal 2,1 Milliarden Gesichter. Ich möchte jedoch betonen, dass PimEyes kein so großes Unternehmen ist und nicht so viele Kund:innen hat, wie man aus dem Lärm in den Medien schließen könnte. Insbesondere in der Europäischen Union gibt es Länder, in denen wir nicht mehr als 15 Abonnent:innen haben. In Deutschland haben wir etwa 86 Abonnent:innen, wenn ich mich richtig erinnere.

netzpolitik.org: Über PimEyes berichteten Medien weltweit. Wie geht es Ihnen mit dieser Aufmerksamkeit?

Giorgi Gobronidze: Ich arbeite 17 Stunden am Tag, deshalb ist es nicht immer sehr angenehm, derart im Mittelpunkt zu stehen. Ich wüsste nicht, was ich in meiner zwölfjährigen akademischen Laufbahn hätte tun können, um so viel Aufmerksamkeit zu erregen.

„Ich war sehr besorgt“

netzpolitik.org: Ist PimEyes ein Werkzeug für Stalker:innen?

Giorgi Gobronidze: Es wird immer neugierige Menschen geben, die nach jemandem suchen. Wenn ich jemanden stalke, kann ich das mit oder ohne PimEyes tun. Der Mensch ist der Stalker, nicht die Suchmaschine. Wenn jemand eine andere Person mit einer Waffe tötet, ist nicht derjenige schuld, der die Waffe hergestellt hat – sondern derjenige, der sie für ein Verbrechen nutzt. Ja, wir müssen Risiken reduzieren, das ist unsere Verantwortung. Aber es gibt auch die Verantwortung der Nutzer:innen.

netzpolitik.org: Wie verringern Sie das Risiko, dass PimEyes für Stalking genutzt wird?

Giorgi Gobronidze: Wir sind ein kostenpflichtiger Dienst. Das bedeutet, jeder Account ist mit Zahlungsdaten verknüpft. Wird mit einem PimEyes-Account etwas Unrechtes begangen, werden wir das natürlich den Strafverfolgungsbehörden mitteilen. Das ist unser Hauptanliegen: Wir wollen unsere Suchmaschine für Stalker:innen weniger attraktiv machen.

Als wir das Unternehmen übernommen haben, war ich, gelinde gesagt, sehr besorgt, weil ich die Fähigkeiten der Technologie kenne. Die Suchmaschine schöpfte 60 Prozent ihrer Fähigkeiten aus, jetzt sind es 40 Prozent. Wir setzen der Suchmaschine Grenzen und schränken ihre Kapazitäten ein. Technologisch ist PimEyes in der Lage, das Dark Web zu durchforsten. Aber das tun wir nicht und werden es auch nie tun.

netzpolitik.org: Als PimEyes gegründet wurde, waren die Suchergebnisse noch für alle zugänglich. Heute sind sie hinter einer Bezahlschranke und es gibt keine Treffer aus sozialen Medien wie Facebook oder Instagram.

Giorgi Gobronidze: Nach unseren ersten Maßnahmen haben wir einen Teil unserer Kund:innen verloren. Und für mich war das absolut in Ordnung. Wir wurden für eine bestimmte Art von Publikum weniger attraktiv. Ich würde lieber auf einen Teil unserer Kund:innen verzichten, als dass etwas Schlimmes passiert.

netzpolitik.org: Auch Bots auf Telegram bieten an, mit PimEyes nach Gesichtern zu suchen. Zumindest einer von ihnen wird unseren Recherchen zufolge hauptsächlich von Männern genutzt, die versuchen, Frauen zu finden und zu stalken.

Giorgi Gobronidze: Diese Telegram-Bots verwenden unseren Namen und operieren aus dem Untergrund. Das ist illegal. Wir haben kürzlich fünf von ihnen abgeschaltet.

„Das bedeutet, dass ein Typ Frauen stalkt“

netzpolitik.org: PimEyes bietet einen „Advanced Plan“ mit einer unbegrenzten Zahl von Suchanfragen für etwa 370 Euro pro Monat an. Für wen ist das gedacht?

Giorgi Gobronidze: Wir haben nicht viele Nutzer:innen für den Advanced Plan, etwa 150. Darunter Investigativjournalist:innen und auch einige der führenden Medienagenturen. Wir arbeiten auch mit mehreren Organisationen zusammen, die gegen Menschenhandel und Gewalt gegen Kinder vorgehen – eine mit Sitz in Großbritannien, eine andere mit Sitz in den USA. Und wir arbeiten sehr gut mit mehreren Organisationen zusammen, die vermisste Personen suchen.

Wir haben auch Pornodarsteller:innen und Sexarbeiter:innen als Kund:innen. Eine unserer Kundinnen war Pornodarstellerin. Um ihre Bilder aus dem Internet zu entfernen, wollte sie sehen, wo sie verbreitet wurden. Seit Anfang 2022 haben wir mehr als 10.000 Bilder von Websites entfernen lassen. Die Pornoindustrie wächst wie eine Hydra. Wenn man einen Kopf abschlägt, wachsen zehn andere nach. Wir haben eine Datenbank mit mehr als 7.000 Websites, die solche Bilder veröffentlichen.

netzpolitik.org: Wie stellen Sie sicher, dass der „Advanced Plan“ nicht von Stalker:innen missbraucht wird?

Giorgi Gobronidze: Stalker:innen nutzen diesen Dienst nicht, denn niemand ist bereit, 370 Euro pro Monat für Informationen zu zahlen, die im Internet öffentlich zugänglich sind. Diese Angebote werden sehr genau überwacht. Kürzlich haben wir die Accounts von 25 Nutzer:innen des Advanced Plans dauerhaft gesperrt, weil wir verdächtige Aktivitäten festgestellt haben.

netzpolitik.org: Wie bemerken Sie verdächtige Aktivitäten von PimEyes-Nutzer:innen?

Giorgi Gobronidze: Wir haben mehrere Methoden, aber ich beginne mit der einfachsten: die Anzahl der Suchanfragen. Als normaler Mensch mit einem normalen Job ist es unmöglich, an einem einzigen Tag 1.200 Suchanfragen zu starten. In dem Fall bemerkt unsere Software, dass der Account mit anderen geteilt wird. Ein zweites Warnsignal ist, wenn sich die Bilder häufig ändern, die jemand für automatische Benachrichtigungen hinterlegt. Wenn zum Beispiel ein Kunde namens „David Nicolson“ innerhalb eines Tages Alarme für zehn Frauen einrichtet, bedeutet das, dass er sie stalkt.

Wir bemerken auch, wenn jemand Bilder von Kindern hinterlegt. Auch in diesem Fall schreiten wir ein, weil das gefährlich ist. Unser Team überprüft diese Art von Bildern wöchentlich, um Aufnahmen von Minderjährigen zu finden. Erst kürzlich haben wir 15 Accounts wegen verdächtiger Aktivitäten gesperrt.

„Warum sollten Sie überhaupt nach Ihrem Bild suchen, wenn Sie nichts finden wollen?“

netzpolitik.org: Ich verstehe das immer noch nicht ganz. Nehmen wir an, ein PimEyes-Account läuft auf meinen Namen, und ich suche nach drei meiner Freunde. Woher wissen Sie, ob sie mir das erlaubt haben?

Giorgi Gobronidze: Das wissen wir nicht, und wir überprüfen es auch nicht. Darüber haben wir auch schon intern diskutiert. Wenn wir anfangen, Ihre Identität zu überprüfen, dann müssten Sie viel mehr Informationen preisgeben als nur ein Foto, und das würde uns in ein Daten sammelndes Monster verwandeln. Das wollen wir nicht.

netzpolitik.org: Kurz gesagt: Solange ich Leute nicht allzu offensichtlich stalke, werden Sie es nicht merken.

Giorgi Gobronidze: Wir könnten es bemerken, wenn Sie zum Beispiel Kinder stalken. Wenn Sie Ihren Großvater oder ihren Nachbarn suchen, ist das kein Problem. Wir hatten einen Fall, in dem ein Ehemann Fotos seiner Frau aus dem Netz löschen wollte, nachdem sie von seinem Laptop geleakt wurden.

netzpolitik.org: Woher wissen Sie, ob ich gerade nach meinen eigenen Kindern suche?

Giorgi Gobronidze: Wir stellen Fragen.

netzpolitik.org: Jemand aus Ihrem Support-Team würde mir Fragen stellen?

Giorgi Gobronidze: Ja. In einigen Fällen wurden hinterlegte Bilder entfernt, nachdem wir uns gemeldet hatten. Es sind also nicht jedes Mal Eltern, die nach ihren Kindern suchen.

netzpolitik.org: Das Internet ist wie ein riesiger Heuhaufen. Ein Bild kann wie eine Nadel darin sein, die sehr schwer zu finden ist. Aber PimEyes ist wie ein Magnet. Trägt PimEyes nicht dazu bei, die Gefahr zu schaffen, vor der es seine Nutzer:innen schützen will?

Giorgi Gobronidze: Es kommt darauf an, wie man den Fall betrachtet. Ja, Sie können ein Bild jetzt über PimEyes finden. Aber warum sollten Sie überhaupt danach suchen, wenn Sie nichts finden wollen? Wenn Sie nicht vermuten, dass etwas nicht stimmt? Man könnte sagen: Das Leben war viel besser, bevor ich wusste, dass dieses Bild von mir existiert. Aber wir können eine Suchmaschine nicht fürs Suchen kritisieren. Die Menschen haben ein Recht darauf zu erfahren, ob ihre Bilder online sind – ob sie die Ergebnisse mögen oder nicht.

„Menschen haben ein Recht, nicht gefunden zu werden“

netzpolitik.org: Würden Sie sagen: Wenn mein Gesicht im Internet auftaucht, habe ich das Recht verloren, nicht von einer Suchmaschine wie PimEyes gefunden zu werden?

Giorgi Gobronidze: Nein, Menschen haben ein Recht darauf, nicht gefunden zu werden. Jedes Suchergebnis auf PimEyes kann aus der Suche entfernt und für künftige Suchvorgänge gesperrt werden. Wir erledigen das in weniger als einem Arbeitstag. Um alle Suchergebnisse zu einem Gesicht zu entfernen, gibt es ein Opt-out-Formular. Jede Person im Netz kann das nutzen, nicht nur unsere Abonnent:innen.

netzpolitik.org: PimEyes hat mehr Opt-out-Möglichkeiten als zuvor. Aber was ist, wenn ich einfach noch nie von PimEyes gehört habe – sollte ich nicht das Recht haben, im Voraus gefragt zu werden, ob mein Gesicht Teil einer biometrischen Gesichtssuchmaschine werden darf?

Giorgi Gobronidze: Gute Frage. Sollten alle gefragt werden, ob sie jeden Tag gegoogelt werden möchten? Die Daten sind im Internet. Unsere Suchmaschine informiert Menschen schlicht über ihre Online-Präsenz. EU-Behörden sagen immer gerne: Ihr sammelt Daten über europäische Bürger:innen. Aber Künstliche Intelligenz ist indeterministisch. Zum Beispiel findet sie auf einer japanischen Website eine weiße Person. Wie soll sie wissen, ob diese Person aus der EU, den Vereinigten Staaten oder sonst woher kommt? Das kann sie nicht.

netzpolitik.org: Das ist eine technische Erklärung. Ich habe auf den ethischen Aspekt abgezielt: Darf eine Suchmaschine Gesichter für eine biometrische Suche erfassen, wenn viele Nutzer:innen nicht einmal wissen, dass sie dem widersprechen können?

Giorgi Gobronidze: Ja, denn sobald Sie wissen, dass PimEyes existiert, können Sie sich dagegen entscheiden. Wenn man so etwas nur für Geld macht, wäre das unethisch. Aber wir haben bereits dabei geholfen, geleakte Bilder zu entfernen. Ich denke an all die Briefe von Kund:innen, die sich bei uns für unsere lebensrettende Arbeit bedanken. Aus ethischer Sicht halte ich es daher für besser, das offene Internet zu durchforsten und Menschen zu helfen.

Wir möchten bald auch unser offizielles Non-Profit-Programm vorstellen, das jeder Organisation zur Verfügung steht, die sich gegen sexuelle Gewalt an Kindern und Menschenhandel einsetzt. Wir glauben, dass diese Technologie zum Guten eingesetzt werden kann, um Menschen zu helfen – nicht nur, um Neugier zu befriedigen.

„Die absolute Mehrheit unserer Nutzer:innen ist weiblich“

netzpolitik.org: Unternehmen wie Amazon, Google, Microsoft und IBM könnten ebenfalls Suchmaschinen für Gesichter zu entwickeln. Aber sie bieten so eine Technologie nicht an. Macht Sie das nicht nachdenklich?

Giorgi Gobronidze: Unternehmen wie Amazon oder Google sammeln weitaus mehr Informationen über Personen, als PimEyes es sich jemals erträumen könnte. Sie nutzen die Informationen für Marketing. Wir machen sie öffentlich zugänglich. Und ich denke, das war die richtige Entscheidung. Gelangt Technologie in die Hände einer kleinen Gruppe, steigt das Risiko, dass sie sich in etwas sehr Gefährliches verwandelt. Ich glaube, es ist nichts Schlimmes daran, dass wir diese Technologie öffentlich zugänglich machen. Denn solange die Leute nur nach öffentlichen Websites und ihren Fotos suchen, kann die Technologie keinen Schaden anrichten.

netzpolitik.org: PimEyes ist ein Schutz für Betroffene und eine Waffe für Stalker:innen. Aber Betroffene gehören zu einer vulnerablen Gruppe. Wird PimEyes am Ende nicht immer nützlicher für Stalker:innen sein als für Menschen, die sich vor ihnen schützen wollen?

Giorgi Gobronidze: Das ist ein interessanter Gesichtspunkt. Vielleicht ist die offensive Seite von PimEyes in der Theorie stärker als die defensive. Aber in der Praxis kenne ich die Statistiken über meine Kund:innen. Ich kenne ihr Geschlecht, ihre Altersgruppe, ich weiß aus welchen Ländern sie kommen und an welchen Dienstleistungen sie interessiert sind. Die absolute Mehrheit unserer Nutzer:innen ist weiblich. Wir haben mehr als 10.000 Bilder entfernen lassen, 90 Prozent davon waren Rachepornos. Wie viele Straftaten werden über PimEyes begangen? Es gibt null Fälle. Denn wenn wir von Strafverfolgungsbehörden danach gefragt würden, würden wir die Informationen offenlegen.

netzpolitik.org: Haben Sie den Brief des Datenschutzbeauftragten Stefan Brink aus Baden-Württemberg erhalten? Der New York Times haben Sie gesagt, Sie seien „erpicht“ darauf, seine Fragen zu beantworten. Herr Brink sagte uns danach, er habe versucht, Sie zu erreichen, und keine Antwort erhalten.

Giorgi Gobronidze: Unsere Rechtsabteilung hat keine Nachricht erhalten. Sobald wir eine erhalten, werden unsere Anwält:innen umfassend darauf antworten. Ich habe alle Kritik gelesen, als ich das Unternehmen gekauft habe. Kritik hilft dabei, uns zu verbessern. In demokratischen Gesellschaften sollte es Kritik geben, und sie ist sehr willkommen. Wir haben nicht immer in allem Recht.

„Wir wollten nicht, dass Russland Bilder ukrainischer Soldat:innen sucht“

netzpolitik.org: Lassen Sie zu, dass PimEyes in autoritären Staaten eingesetzt wird?

Giorgi Gobronidze: Wir können nicht einfach den Bericht von Freedom House nehmen und sagen: Oh, das ist ein autoritäres Land, dort können wir nicht verfügbar sein. Das tun wir nur bei ausdrücklich despotischen Regimen und gefährlichen Ländern. Denn unsere Suchmaschine wird auch genutzt, um vermisste Personen zu finden, und das ist in vielen Diktaturen der Fall.

Nach dem Angriff auf die Ukraine haben wir den Zugang zu PimEyes aus Russland gesperrt. Wir hatten bemerkt, dass die Anfragen aus Russland nach Beginn des Krieges zunahmen, und wir wollten nicht, dass Russland Bilder ukrainischer Soldat:innen sucht.

Auch im Iran und in Syrien sind wir nicht verfügbar. Wir haben den Iran ausgeschlossen, weil er die Suchmaschine zur Verfolgung von politischen Dissident:innen nutzen könnte, und ich möchte der iranischen Regierung in keiner Weise helfen. Ich möchte auch Baschar al-Assad nicht helfen. Wir haben derzeit keine Kund:innen aus Belarus oder anderen ehemaligen Sowjetländern. Wenn wir das aber feststellen, könnten wir auch Belarus sperren.

netzpolitik.org: Eine andere Gesichter-Suchmaschine, Clearview AI, wird von Ländern wie Großbritannien und Kanada scharf kritisiert, es drohen Geldstrafen. Warum glauben Sie, dass PimEyes nicht dasselbe droht?

Giorgi Gobronidze: Ich bin kein Anwalt, meine Meinung ist also nicht juristisch valide, aber es gibt meiner Meinung nach mehrere wesentliche Unterschiede. Erstens sammelt Clearview AI Daten für Ermittlungsbehörden. Sie arbeiten offen mit dem FBI zusammen. Zweitens antworten sie nicht auf Opt-out-Anfragen. Clearview AI mag also Ihr Foto haben, aber Sie können es nicht entfernen lassen.

netzpolitik.org: Clearview AI bietet ein Opt-out-Formular an, aber die Kommunikation kann sehr holprig werden, wie der Fall eines Betroffenen aus Deutschland zeigt. Was würde passieren, wenn PimEyes abgeschaltet würde?

Giorgi Gobronidze: Wenn wir eine solche Suchmaschine erfinden konnten, warum sollten es nicht auch andere tun können? Die Technologie gibt es bereits, sie ist nichts Exklusives. Wir können vom Markt verschwinden, aber es wird Nachahmer geben.