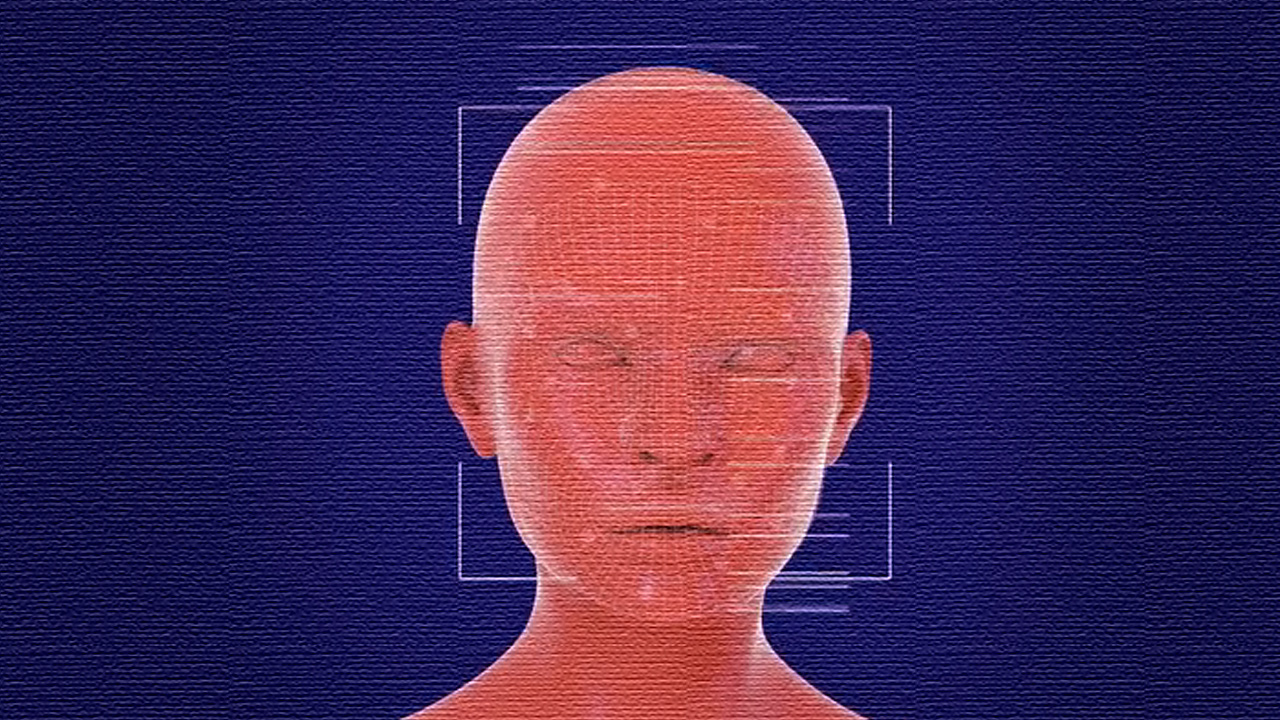

Nach IBM ändert nun auch Amazon sein Geschäft mit der Gesichtserkennung – allerdings nur für ein Jahr. Amazon hatte am Mittwoch angekündigt, dass es ein einjähriges Moratorium für die Nutzung seiner Gesichtserkennungstechnologie Rekognition bei der Polizei beschlossen habe. Gleichzeitig fordert das Unternehmen mehr Regulierung durch die Politik.

Amazons Gesichtserkennung „Rekognition“ wird in zahlreichen Polizeirevieren in den USA eingesetzt, mit mehr als 1000 Polizeirevieren ist das Unternehmen eine Partnerschaft bei seiner umstrittenen Überwachungstechnologie „Ring“ eingegangen. Beide Produkte haben nachweislich einen rassistischen Bias.

Verschiedene Organisationen kritisierten die Ankündigung als PR-Maßnahme. Das Anti-Amazon-Bündnis „Athena for all“ weist darauf hin, dass Amazon alleine seit dem Tod von George Floyd mit 30 Polizeirevieren eine neue Partnerschaft eingegangen sei. Wenn Amazon es ernst meine, solle das Unternehmen die Partnerschaft mit allen Polizeien beenden.

„Sollte gänzlich verboten werden“

Die digitale Bürgerrechtsorganisation „Fight for the Future“ moniert zwar einen PR-Stunt, sieht die Ankündigung Amazons aber als Zeichen, dass Gesichtserkennung politisch zunehmend schwer zu vermitteln sei. Evan Greer von Fight for the Future wendet sich gegen eine Regulierung, die Gesichtserkennung erlaubt: „Die Realität sieht so aus, dass die Gesichtserkennungstechnologie zu gefährlich ist, um überhaupt eingesetzt zu werden. Wie nukleare oder biologische Waffen stellt sie eine so tiefe Bedrohung für die Zukunft der Menschheit dar, dass sie gänzlich verboten werden sollte.“

Den jetzigen Entscheidungen von IBM und Amazon ist eine jahrelange Debatte über rassistischen Bias von Algorithmen und Gesichtserkennung vorausgegangen. Schwarze Wissenschaftlerinnen wie Joy Buolamwini oder Timnit Gebru hatten das Thema erforscht und in Projekten wie Gender Shades sowie Veröffentlichungen (PDF) darauf hingewiesen.

Dabei geht es unter anderem Fehler bei der Erkennung: Weil Gesichterkennungssysteme bei People of Color eine höhere Fehlerquote als bei weißen Personen haben, sind sie vom Einsatz der Technologie besonders betroffen. Jeder Fehlalarm kann dazu führen, dass eigentlich unverdächtige Personen überwacht, durchsucht und festgehalten werden, was für diese traumatisierend und stigmatisierend sein kann.

Gemeinsamer Erfolg von Wissenschaft und Protesten

Amazon versuchte damals die Studienergebnisse zu untergraben, aber Buolamwini veröffentlichte eine detaillierte Antwort, in der sie sagte: „Amazons Ansatz war bisher Verleugnung, Ablenkung und Verzögerung. Wir können uns nicht darauf verlassen, dass Amazon sich selbst überprüft und der Polizei oder Regierungsbehörden unregulierte und nicht-erprobte Technologien zur Verfügung stellt“.

Das Moratorium von Amazon bezeichnet sie auf Twitter als „Erfolg nicht nur von Wissenschaftler:innen, sondern auch von Bürgerrechtsorganisationen, Aktivist:innen, Angestellten und Aktionär:innen“, der im Zusammenhang mit dem Tod von George Floyd und aufgrund der Proteste möglich geworden sei.

Doch nicht nur der rassistische Bias ist ein Problem der Technologie: Gesichtserkennung erhöht mit „dem Nummernschild im Gesicht“ die allgegenwärtige Überwachung und bedroht Grundrechte wie die Versammlungsfreiheit. In Deutschland setzt sich unter anderem das Bündnis „Gesichtserkennung stoppen!“ gegen die Technologie ein. Dem Bündnis gehören zahlreiche Digital- und Bürgerrechtsorganisationen an.