Sie sagen es im Fernsehen, sie schreiben es in Zeitungskolumnen, sie posten es in sozialen Medien: Konservative Stimmen werden unterdrückt! Dass diese Behauptung zumindest auf Twitter nicht stimmt und meist sogar das Gegenteil der Fall ist, will nun ein Forscher:innen-Team herausgefunden haben.

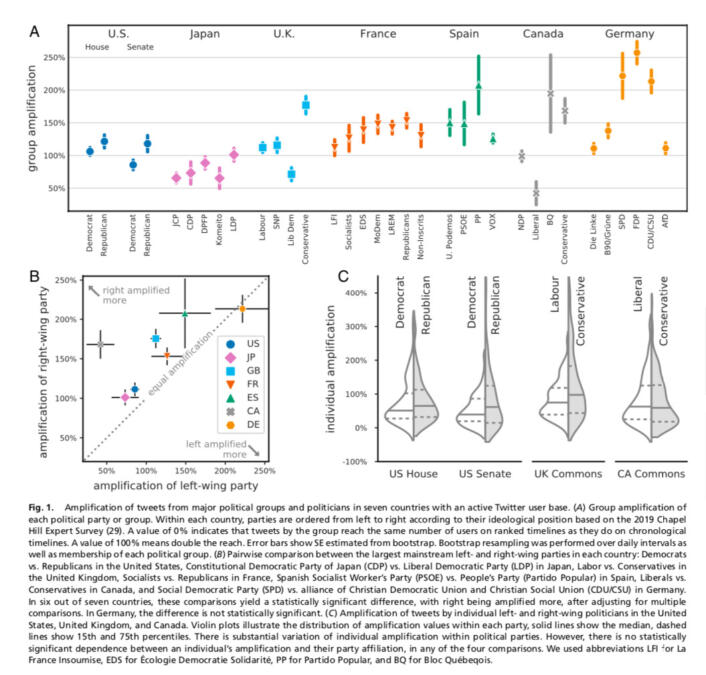

In einer Studie untersuchten sie über 3.000 Twitter-Accounts von Politiker:innen relevanter Parteien in sieben Staaten, darunter Deutschland, den USA und dem Vereinigten Königreich. Sie maßen die Reichweite und die algorithmische Verstärkung (oder Unterdrückung) ihrer Tweets, indem sie verglichen, inwiefern sich eine algorithmisch kuratierte Timeline von einer chronologischen unterscheidet. Würden etwa Tweets einer bestimmten ideologischen Gruppe in der chronologischen Ansicht öfter angezeigt werden als in der automatisiert erstellten, dann könnte man daraus dem Schluss ziehen, dass Twitter solche Inhalte unterdrückt.

Von einer digitalen Zensur ist in keinem der Länder etwas zu bemerken, parteiübergreifend verstärkt der Algorithmus von Twitter so gut wie alle Abgeordneten. Im Vergleich mit der chronologischen Kontrollgruppe blendet Twitter ihre Tweets meist doppelt so oft oder öfter ein. In sechs der untersuchten Staaten bevorzugt Twitters Algorithmus sogar Abgeordnete rechter Parteien und behandelt sie besser als ihre linke Konkurrenz.

Ausreißer Deutschland

Bemerkenswert ist der Ausreißer Deutschland. Hierzulande lässt sich letzterer Effekt nicht beobachten, rechte wie linke Stimmen werden ziemlich gleichwertig ausgespielt. Heruntergebrochen auf Parteien profitieren vor allem FDP-Politiker:innen von ihrem Twitter-Auftritt. Im Schnitt werden ihre Tweets über drei Mal öfter in die algorithmische Timeline gespült. Abgeordnete der zwei am wenigsten verstärkten Parteien, AfD und Linke, können sich immer noch über eine verdoppelte Reichweite im Vergleich zur chronologischen Ansicht freuen.

Twitter hatte 2016 standardmäßig auf eine algorithmenbasierte Darstellung umgestellt. Seitdem wird den allermeisten Nutzer:innen nicht mehr notwendigerweise das angezeigt, was zuletzt gepostet wurde, sondern was das Empfehlungssystem für besonders interessant hält. Auch andere Online-Dienste wie Facebook nutzen die Technik inzwischen, bei TikTok ist sie sogar das zentrale Element, um überhaupt Inhalte angezeigt zu bekommen.

Konservative besonders laut

Da für die Öffentlichkeit nicht nachvollziehbar ist, wie diese Empfehlungen genau zustandekommen, ranken sich viele faktenferne Theorien um die Algorithmen – was sich gut als politischer Spielball eignet. Auf die Spitze treiben das vor allem US-amerikanische Konservative. In so mancher Anhörung im Kongress schien die behauptete Unterdrückung rechter Accounts durch das angeblich liberale Silicon Valley ihr einziges Anliegen gewesen zu sein.

Eine ähnliche Dynamik lässt sich auch in Europa beobachten. Hier sind es unter anderem Politiker:innen der AfD, der polnischen PiS oder der ungarischen Fidesz, die sich einer Zensur ausgesetzt fühlen. Tatsächlich werden ab und zu vereinzelte Postings entfernt, aber weniger, weil sie konservative Einsichten zum Besten geben, sondern wenn etwa Beatrix von Storch pauschal gegen Muslime hetzt.

Dennoch wäre mehr Transparenz und Kontrolle über die Empfehlungssysteme der Online-Dienste nicht schlecht. Erreichen könnte das in Europa der Digital Services Act, der derzeit verhandelt wird. Schon der Vorschlag der EU-Kommission sah einige Verbesserungen vor, noch etwas weiter will das EU-Parlament gehen. Nutzer:innen müssten die Empfehlungen leicht ausschalten und sich zudem besser gegen sogenanntes „Shadowbanning“ wehren können. Wie weit dieses algorithmische Unsichtbarmachen von Inhalten verbreitet ist, bleibt unklar. Wenn es sich aber nachweisen ließ, dann waren davon keine rechten Politiker:innen betroffen, sondern meist marginalisierte Gruppen.

Das Paper erklärt etwas besser, wie das tatsächliche Experiment gestaltet wurde: Twitter intern wurden 1% Accounts bereits (zufällig) ausgewählt, die nicht dem neuen ML Algorithmus zu Anzeige unterliegen.

5 der 6 Autor:innen arbeiten bei Twitter.

Und die Daten sind nicht OpenData, sondern auf Anfrage erhältlich.

Danke für die Ergänzung. Das lässt mich an der Seriosität der Studie zweifeln.

Warum? Erkenntnisse sollten nicht davon abhängig sein, wer sie macht.