TikTok, das derzeit rasant wachsende Soziale Netzwerk aus China, hat ungewöhnliche Maßnahmen genutzt, um vermeintlich verwundbare Nutzer:innen zu schützen. Die Plattform hatte ihre Moderator:innen angewiesen, Videos von Menschen mit Behinderungen zu markieren und in ihrer Reichweite zu begrenzen. Auch queere und dicke Menschen landeten auf einer Liste von „Besonderen Nutzer:innen“, deren Videos grundsätzlich als Mobbing-Risiko betrachtet und in der Reichweite gedeckelt wurden – ungeachtet des Inhaltes.

Das zeigen interne Moderationsregeln, die netzpolitik.org einsehen konnte. Außerdem haben wir Gespräche mit einer Quelle bei TikTok geführt, die Einblick in die Moderation der Videosharing-Plattform hat. Nachdem wir im ersten Artikel die Reichweitenbegrenzung politischer Inhalte und die Mechanismen der Moderation beleuchtet haben, in einem zweiten den Umgang mit Kritik und der Konkurrenz angesehen, zeigen die neuen Dokumente erstmals, wie ByteDance, das chinesische Technologieunternehmen hinter TikTok, mit Mobbing auf seiner Plattform umgeht – und problematische Maßnahmen dagegen ergriffen hat.

Die Moderation der „Bullying-Zielscheiben“

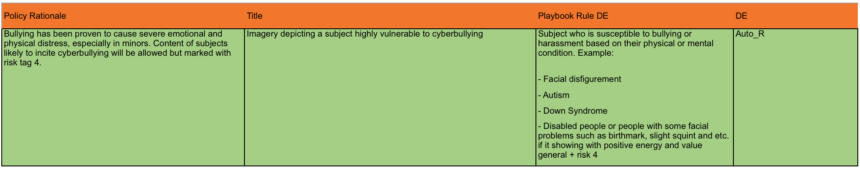

Der betreffende Abschnitt in den Moderationsregeln heißt „Bilder von Subjekten, die hochgradig verwundbar für Cyberbullying sind“. In den weiteren Erläuterungen heißt es, dies seien Nutzer:innen, bei denen man „auf Basis ihrer physischen oder mentalen Verfassung“ davon ausgehen muss, dass sie zur Zielscheibe von Angriffen werden. Mobbing habe nachweislich schlimme Folgen für die Betroffenen. Daher sollten Videos solcher Nutzer:innen grundsätzlich als Risiko betrachtet und in ihrer Reichweite begrenzt werden.

TikTok nutzte dazu eine Möglichkeit aus dem Arsenal der Moderation, um die Sichtbarkeit dieser Nutzer:innen zu begrenzten. Menschen mit Behinderungen sollten von Moderator:innen demnach als „Risk 4“ markiert werden. Dies bedeutet, dass ein Video nur in dem Land sichtbar ist, in dem es auch gepostet wurde. Für Menschen mit einer tatsächlichen oder angenommenen Behinderung bedeutet das: Statt einem weltweiten Publikum von einer Milliarde – so viele nutzen die App derzeit laut TikTok -, erreichten ihre Videos maximal 5,5 Millionen Menschen. Das ist die Zahl der Nutzer:innen, die TikTok derzeit in Deutschland laut der Fachzeitschrift AdAge haben soll.

Menschen mit Behinderungen nicht auf der großen Bühne

Für Fälle, die als besonders gefährdet galten, hatte TikTok noch weitreichendere Regelungen. Landeten ihre Videos auf den Bildschirmen der Moderationsteams in Berlin, Beijing oder Barcelona - nach 6.000 bis 10.000 Ansichten -, wurden sie mit einer automatischen Deckelung namens „Auto R“ versehen. Die Folge: Sollten diese Videos eine bestimmte Publikumsgröße überschreiten, landen sie automatisch in der Kategorie „not recommend“. Eine solche Kategorisierung bedeutet, dass ein Video nicht mehr im algorithmisch zusammengestellten For-You-Feed auftaucht, den Nutzer:innen beim Öffnen der App abgespielt bekommen. Solche Beiträge werden also streng genommen nicht gelöscht – sie haben aber faktisch kaum noch ein Publikum.

Der For-You-Feed ist die Möglichkeit, ein möglichst großes Publikum für Duette, Comedy-Sketche, Streiche und Tanzchoreografien zu bekommen. Wer es dorthin schafft, spielt auf der ganz großen Bühne und wird womöglich „TikTok-famous“. Viele taggen ihre Videos zu diesem Zweck mit Hashtags wie #foryou oder #fürdich. Von dieser Bühne, so lauteten die Anweisungen von TikTok an Moderator:innen, sollen Menschen mit Behinderungen aber ferngehalten werden.

Als Beispiele für Nutzer:innen, für die das gilt, nennen die Richtlinien „entstelltes Gesicht“, „Autismus“ und „Downsyndrom“. Moderator:innen sollen selbst im Review-Prozess darüber urteilen, ob jemand diese Merkmale aufweist und das Video entsprechend markieren. Dazu haben sie im Schnitt etwa eine halbe Minute Zeit, wie unsere Quelle bei TikTok berichtet.

TikTok zieht Barrieren ein

Die Regeln irritieren zunächst auf der ganz praktischen Ebene: Wie soll etwa ein Moderator erkennen, ob jemand, der auf TikTok einen 15-Sekündigen Videoschnipsel teilt, eine Störung aus dem autistischen Spektrum aufweist? Diese Anweisung ist eine von mehreren nicht nachvollziehbaren Regeln, die auch die Moderationsteams selbst maßgeblich verwirren, wie uns eine Quelle bei TikTok berichtet.

Noch grundsätzlicher aber zeugt die Richtlinie von einer großen Ahnungslosigkeit, was die Debatten um Inklusion und Sichtbarkeit von Menschen mit Behinderungen in den Medien angeht. Diese wurden in den vergangenen Jahren intensiv geführt – vorangetrieben vor allem von diesen Menschen selbst. Während Aktivist:innen ein barrierefreies Internet und Sichtbarkeit fordern, zog TikTok bewusst Barrieren ein – ohne, dass die Betroffenen davon etwas ahnten.

Falsch verstandene Fürsorge

Constantin Grosch von der Organisation AbilityWatch bezeichnet dieses Vorgehen als „übergriffig und ausgrenzend“. Menschen mit Behinderungen seien in den Medien ohnehin schon unterrepräsentiert und würden paternalisiert. „Die hier aufgeführte Regelung überführt dieses Verhalten in neue digitale Plattformen, in denen aus falsch verstandener und unnötiger Fürsorge die Sichtbarkeit von behinderten Menschen bewusst reduziert wird.“ Gerade wenn man weiß, dass eine verbreitete Form des Mobbing im so genannten Ghosting besteht – dem bewussten Ignorieren eines Anderen – sei diese Praxis verheerend. Maßnahmen gegen Cybermobbing müssten auf die Beschränkung der Taten und nicht der Opfer abzielen und zudem für alle Menschen gleichermaßen gelten.

Grosch weist auch darauf hin, dass das Markieren von Menschen aufgrund einer Behinderung gerade in Deutschland besonders befremdlich erscheint und verweist auf die Geschichte. Die Nationalsozialisten hatten von 1940 bis 1941 mehr als 70.000 Menschen mit körperlichen, geistigen und seelischen Behinderungen im Rahmen der „Aktion T4“ systematisch erfasst und ermordet.

Auch Manuela Hannen und Christoph Krachten von der Evangelischen Stiftung Hepatha, die derzeit ein inklusives Social-Media-Team aufbaut, sind irritiert. „Wir empfinden das als Zensur, für die es keine Grundlage gibt. Es ist vollkommen absurd, nicht die Trolle zu bestrafen, sondern die Opfer des Cyberbullyings. Unsere Bemühungen um große Reichweiten so zu konterkarieren, trifft unser Projekt im Mark.“

Der Inklusions-Aktivist Raul Krauthausen sagt gegenüber netzpolitik.org: „Ein vermeintliches Opfer vor sich selbst schützen, ist immer schwierig. Behinderte Menschen sind ja auch nicht alle gleich. Manche können damit besser, andere schlechter umgehen – wie nicht behinderte Menschen auch.“

PR-Kampagnen für Diversity und Inklusion

Eine Quelle, die mit der Moderation vertraut ist, berichtet, Mitarbeiter:innen hätten wiederholt auf die Probleme dieser Richtlinie hingewiesen und um eine sensiblere und sinnvollere Regelung gebeten. Ihre Hinweise seien jedoch von den chinesischen Entscheidungsträger:innen abgetan worden. Die Regeln wurden vor allem aus Peking heruntergereicht. Dies deckt sich weitgehend mit dem, was die Washington Post von ehemaligen TikTok-Mitarbeiter:innen in den USA erfuhr.

Dabei ist TikTok derzeit besonders darum bemüht, Schönwetter zu machen in Deutschland, den USA und anderen Märkten, in denen die App zuletzt rasant gewachsen ist. So hat die Plattform mit Hashtag-Kampagnen zu Bodypositivity oder respektvollem Verhalten zuletzt selbst viel dafür getan, um Mobbing auf TikTok zu ächten. Zum Safer Internet Day am 5. Februar lud TikTok etwa dazu ein, „ein starkes Signal durch die Plattform zu senden: Ein Signal für Inklusion, Diversität und Sicherheit und gegen Mobbing, Hassrede oder beleidigendes Verhalten.“

Zu diesem Zeitpunkt waren Moderator:innen noch angewiesen, Menschen mit Behinderungen und andere, die als Mobbing-Risiko gewertet wurden, in der Reichweite drastisch einzuschränken.

Die Bedenken gegenüber TikTok werden auch dadurch befeuert, dass TikTok wesentlich intransparenter mit seinen Richtlinien umgeht als Konkurrenten aus dem Silicon Valley. Lange Zeit hat die Firma gar nichts darüber preisgegeben, auf welcher Basis Moderationsentscheidungen getroffen werden. Unter dem wachsenden Druck der öffentlichen Aufmerksamkeit, vor allem was die Proteste in Hongkong angeht, versucht TikTok sich nun klar gegen den Vorwurf abzugrenzen, die Inhalte würden von China aus gelenkt.

Betrieben wird TikTok von der chinesischen Firma ByteDance. Sie soll derzeit etwa 75 Milliarden Dollar wert sein, das ist mehr als Uber und Snapchat zusammen, berichtet die Washington Post. Inhaber von ByteDance ist Zhang Yiming, einer der reichsten Männer Chinas. 2017 kaufte ByteDance die damals schon populäre US-amerikanische Videosharing-App Musical.ly und stellte sie unter das Dach ihrer eigenen Marke TikTok. Seitdem wächst die App, die vor allem unter jungen Nutzer:innen beliebt ist, rasant. Vor kurzem soll sie die 1‑Millarde-Nutzer:innen-Marke erreicht haben – schneller als jede andere Social-Media-Plattform zuvor.

TikTok: War nie als langfristige Lösung gedacht

Zwischenzeitlich scheint man auch bei TikTok gemerkt zu haben, dass die Regelungen zum Umgang mit Mobbing nicht ideal waren. Eine Sprecherin erklärte auf Anfrage, die Regeln habe man „zu Beginn“ so gewählt, um Mobbing auf TikTok entgegenzuwirken. „Dieser Ansatz war nie als langfristige Lösung gedacht und obwohl wir damit eine gute Absicht verfolgt haben, wurde uns klar, dass es dabei nicht um den richtigen Ansatz handelt.“ Die Regelungen seien inzwischen durch neue, nuancierte Regeln ersetzt worden. Man habe die Technologie zur Identifikation von Mobbing weiterentwickelt und ermutigen die Nutzer zum positiven Umgang miteinander.

Das klingt als seien die Regeln ein Relikt aus der weit zurückliegenden Vergangenheit der Plattform. Aus Dokumenten, die netzpolitik.org vorliegen, geht aber hervor: Die Anweisungen an Moderator:innen waren mindestens bis September dieses Jahres noch genau so gültig. Zu unseren weiteren konkreten Fragen, wie es zu den Regeln kam, von wann bis wann sie galten und ob für die Entwicklung der neuen Regeln auch Behindertenverbände hinzugezogen werden, wollte TikTok sich nicht äußern.

Liste mit mit „besonderen Nutzer:innen“ angelegt

Zusätzlich zu den genannten Regelungen pflegten Moderator:innen von TikTok eine Liste mit „besonderen Nutzer:innen“, die in größerem Maß von Mobbing betroffen sein könnten. Diese Nutzer:innen wurden grundsätzlich als Risiko bewertet und ihre Videos automatisch mit der Markierung „Auto R“ in der Reichweite gedeckelt, damit sie eine bestimmte Zahl von Views nicht überschreiten.

Insgesamt sind 24 Accounts auf dieser Liste, darunter Menschen, die Videos mit Hashtags wie #lebenmitbehinderung posten oder „Autist“ in ihren Biografien stehen haben. Auf der Liste stehen aber auch Nutzer:innen, die einfach nur dick sind und damit selbstbewusst umgehen. Auffallend viele zeigen eine Regenbogenflagge in ihrer Biografie oder verorten sich in ihren Texten und Videos als lesbisch, schwul oder nicht-binär.

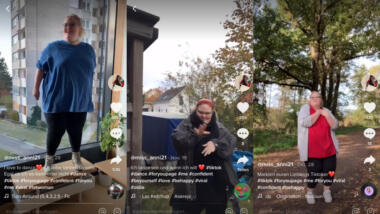

Einer der Accounts auf dieser Liste gehört Annika, auf TikTok miss_anni21. Die 21-Jährige arbeitet als Erzieherin in einer Kita und veröffentlicht auf TikTok Sketche, Hommages an ihre Mutter und vor allem Tanzvideos, die sie im vollen Körpereinsatz zeigen. Untertitel: „Ich liebe tanzen! #confident #me #fatwoman“. Dass TikTok sie auf einer Liste von Mobbing-Opfern führte, hat sie schockiert. Sie sagt gegenüber netzpolitik.org: „Ich finde das krass und diskriminierend, dass Menschen so herabgestuft werden. Das ist unmenschlich.“ Ab wann lande man auf so einer Liste, fragt sie sich.

Natürlich gebe es Menschen, die psychisch weniger stabil seien und mit dem Hass nicht umgehen können. Sie selbst zählt nicht dazu. Vor etwa einem Jahr gingen zwei ihrer Tanzvideos viral, erstmals zeigte sie darin ihren ganzen Körper und plötzlich explodierte die Zahl ihrer Follower von 800 auf 10.000 (heute sind es mehr als 22.000 Menschen, die ihr beim Tanzen zusehen). Mit der Aufmerksamkeit kam auf der Hass. Bring dich um, dich will niemand auf der Welt. Etwa zwei bis drei Monate ging das, sagt sie. „Ich bin aber so ein Mensch, mir ist das egal.“ Das liegt auch an ihrem neuen Publikum auf TikTok. „Mir folgen jetzt Leute, die in mir ein Vorbild sehen. Das hat mich noch stärker gemacht.“ Dass TikTok sie in der Reichweite begrenzt und somit vermeintlich vor sich selbst schützt – für sie absolut unnötig.

In den vergangenen Wochen hat sie schon wieder 4.000 neue Follower dazugewonnen. Sie sagt, sie habe den Eindruck, dass ihre Videos jetzt wieder mehr Menschen erreichen. Wurde die Liste aus dem Verkehr gezogen? TikTok selbst hat sich auf unsere detailierten Nachfragen dazu nicht geäußert.

Über diese Recherche und die Quellen:

Unser Wissen über die Moderation bei TikTok in Deutschland beruht auf einem mehrstündigen Gespräch von netzpolitik.org mit einer Quelle, die Einblick in die Moderationsstrukturen und die Policy hat. Wir haben die Identität der Quelle und ihren Arbeitsvertrag überprüft. Wir können und wollen die Quelle aus Gründen des Informantenschutzes nicht näher beschreiben.

—

Sollten Sie Informationen oder Hinweise zu diesem Thema oder anderen Themen haben, freuen wir uns über eine Kontaktaufnahme – gerne verschlüsselt. Nutzen Sie dafür keine beruflichen Mailadressen, Telefonnummern, Netzwerke und Geräte.