Gut gemachte Websites und Anwendungen machen Spaß, generieren Aufmerksamkeit und binden Nutzer:innen an das eigene Produkt. Das haben erfolgreiche Unternehmen wie Facebook, Amazon, Instagram oder Twitter früh gemerkt und in nutzerorientiertes Design investiert. Schon seit den 1990er Jahren erforschen User-Experience-Designer:innen, wie Menschen mit Computern interagieren – und optimieren auf Grundlage psychologischer und verhaltensökonomischer Erkenntnisse die eigenen Dienste.

Zielkriterium der Optimierung ist dabei meistens nicht das Wohl der Nutzer:innen, sondern der wirtschaftliche Vorteil des eigenen Unternehmen, warnt die Stiftung Neue Verantwortung in ihrem neuen Papier „Dark Patterns: digitales Design mit gesellschaftlichen Nebenwirkungen“.

Die dunkle Seite des User-Experience-Designs benachteiligt die Nutzer:innen etwa durch Tricks wie farblich hervorgehobene Buttons für kostenpflichtige Optionen, zu kleine Schriftarten für wichtige Details und versteckte Regler für Datenschutzoptionen.

Die Politik muss handeln

Die Autor:innen Sebastian Rieger und Caroline Sinders kritisieren, dass europäische Regulierungen für den digitalen Raum bisher kaum Kriterien zum digitalen Produkt- und Oberflächendesign vorgeben. Durch diese Lücke könnten allerdings wichtige Gesetze unwirksam werden. Wenn beispielsweise Datenschutzgesetze den Nutzer:innen durch die Möglichkeit der Einwilligung ein Stück informationelle Selbstbestimmung ermöglichen wollen, das Einwilligungsmenü aber irreführend gestaltet sei, werde die Idee dahinter ad absurdum geführt.

Wenn Onlineshops durch – oftmals irreführende – Warnhinweise oder Countdowns wie „Nur noch 2 Zimmer verfügbar!“ Menschen unter Druck setzen, Preisvergleiche erschweren oder zu Impulskäufen verleiten, dann entstünden ihnen Nachteile. Um das zu verhindern und gegen manipulatives Design vorzugehen, müssten nach Auffassung der Autor:innen nicht zwangsläufig neue Gesetze diskutiert werden.

Stattdessen solle bestehendes Recht konsequenter angewendet werden: Neben der Datenschutz-Grundverordnung und der ePrivacy-Verordnung eigneten sich dafür auch EU-Richtlinien etwa über unlautere Geschäftspraktiken, Verbraucher- und Wettbewerbsrecht oder das deutsche Privatrecht (BGB) und das Telemediengesetz (TMG). 2019 hatte auch die Datenethik-Kommission der Bundesregierung empfohlen, mit dem Gesetz gegen unlauteren Wettbewerb, das irreführendes oder aggressives Markverhalten untersagt, gegen Dark Patterns vorzugehen.

Die Stiftung Neue Verantwortung macht in ihrem Paper deutlich: Es ist unerheblich, ob Nutzer:innen bewusst manipuliert werden sollen oder Entscheidungen versehentlich gelenkt werden – das Stichwort „Dark Patterns“ umfasst alles, was bekanntermaßen ein bestimmtes Verhalten fördert und dadurch zu Nachteilen für Nutzer:innen führen kann.

Gut erforscht, politisch unterschätzt

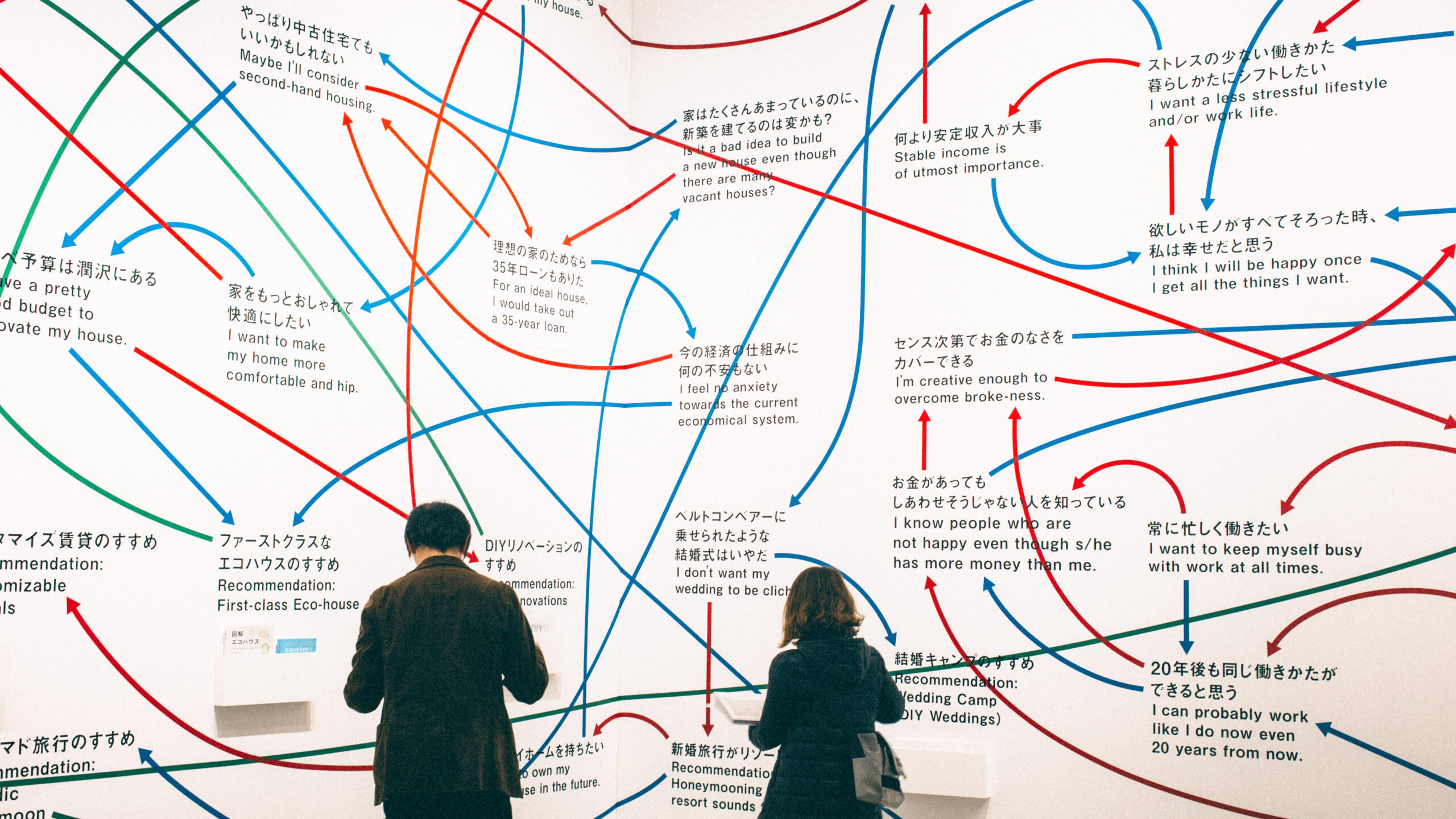

Der Twitter-Account @darkpatterns sammelt hunderte Beispiele für manipulatives Design. Die Bandbreite der Mechanismen ist laut dem Papier groß, aber gut erforscht und klassifiziert. Zuletzt hatte auch das Büro für Technikfolgenabschätzung des Bundestages vor der Praxis gewarnt.

Trotzdem werde ihr Einfluss in Politik und Öffentlichkeit unterschätzt. Viel zu häufig bleibe den einzelnen Nutzer:innen in der Informationsflut der vielen Apps, Online-Dienste und Anbieter keine Zeit für informierte Entscheidungen. Problematische Design-Praktiken würden dabei gar nicht bewusst gesehen oder einfach hingenommen.

Dabei sind Dark Patterns kein individuelles Problem, sondern ein „Massenphänomen der digitalen Welt“. Laut einer zitierten Studie verwenden bis zu 11 Prozent der weltweit am häufigsten besuchten Shopping-Webseiten Design-Taktiken, die Nutzer:innen zu unbeabsichtigten und möglicherweise schädlichen Entscheidungen zwingen, anleiten oder sie täuschen. Dabei geht ihr Einfluss weit über Online-Einkäufe hinaus, sondern betrifft sogar Betriebssysteme von Computern und Smartphones.

Es fehle ein öffentliches Problembewusstsein für manipulative Designtechniken, kritisieren die Autor:innen des Papiers. Um hier mehr Sichtbarkeit herzustellen, müssten Daten- und Verbraucherschutzorganisationen gemeinsam mit Behörden die digitale Manipulation von Nutzer:innen auch in den Mittelpunkt einzelner Prozesse stellen. Wie das aussehen kann, zeigten 2018 mehrere europäische Verbraucherschutzorganisationen: Sie stießen Datenschutzaufsichtsverfahren gegen Google an, weil der Konzern beim Einholen der Einwilligung zur Nutzung von Standortdaten trickse. Für diese Arbeit bräuchten zivilgesellschaftliche Organisationen mehr Ressourcen, fordern Sinders und Rieger.

Besonders problematisch für den Datenschutz

Immer mehr Geschäftsmodelle basieren darauf, Daten von Nutzer:innen zu sammeln, auszuwerten und zu verkaufen. Deshalb werden auch digitale Oberflächen so gestaltet, dass Nutzer:innen möglichst viele Daten mit den Unternehmen teilen und die Verarbeitung erlauben. Eigentlich schreibt die Datenschutzgrundverordnung „by Design“ und „by Default“ vor, doch die Einstellungen sind häufig so irreführend, dass Nutzer:innen zu möglichst niedrigen Datenschutzeinstellungen gedrängt werden, zeigte eine Untersuchung der norwegischen Verbraucherschutzbehörde Forbrukerrådet am Beispiel von Google, Facebook und Microsoft. Gleiches gelte für die „Cookie-Banner“ der meisten Internetseiten.

Die Design-Tricks zum Erschleichen von Einwilligungen sind einer der Gründe, warum viele Datenschützer:innen seit langem skeptisch gegenüber dem Instrument sind. Eigentlich müssten Einwilligungen der Datenschutz-Grundverordnung zufolge informiert und freiwillig erfolgen – beides ist oft nicht der Fall. Auf netzpolitik.org berichten wir immer wieder kritisch darüber, wie Unternehmen sich Einwilligungen erschleichen.

Die Autor:innen des Papiers fordern, dass sich Regierungen und Behörden intensiv mit der „Architektur digitaler Produkte und Oberflächen beschäftigen“, um hier die richtigen Strategien gegen irreführendes Design zu entwickeln. Als Vorbilder nennen sie die norwegische Verbraucherschutzbehörde, die Dark Patterns umfangreich untersucht hat, oder die französische Datenschutzbehörde CNIL, die sich mit digitalem Produktdesign beschäftigt hat und gezielt versucht, ein Problembewusstsein auch innerhalb der Design-Industrie zu schaffen.

Aber bitte zusammen

Auch deutsche Verbraucherschutzorganisationen hätten bereits verstreute Expertise, die allerdings weder systematisch genutzt noch weiterentwickelt werde. Die Autor:innen des Papiers fordern schnelles Handeln in einer gemeinsamen Einheit von Jugend‑, Daten- und Verbraucherschutz- und gegebenenfalls Wettbewerbsbehörden.

Besetzt werden könnte eine solche Einheit interdisziplinär mit Produkt- und Interface-Designer:innen, Jurist:innen, IT-Forscher:innen und Expert:innen aus den Behörden, die dann wiederum Ministerien im Gesetzgebungsprozess beraten – etwa das Familienministerium zur geplanten Jugendschutznovelle. Sie warnen vor Parallelstrukturen wie im Bereich der Cybersicherheit. Stattdessen sollte eher auf europäischer Ebene gedacht und mit anderen Ländern kooperiert werden.

Denn in Zukunft rechnen Rieger und Sinders mit noch mehr Online-Anbietern und Diensten, die international angeboten werden. Wichtig werden für sie neben visueller Gestaltung auch Audio- oder Sprachpatterns, wenn Sprachassistenten immer mehr genutzt werden.