Julian Jaursch ist Projektleiter beim Berliner Think Tank Stiftung Neue Verantwortung. Dort analysiert er unter anderem Ansätze, wie mit Desinformation in der digitalen Öffentlichkeit umgegangen werden kann. Aktuell befasst er sich damit, welche Transparenz- und Rechenschaftspflichten für große Plattformen gelten, gerade bei digitalen politischen Kampagnen und politischer Onlinewerbung.

Auf großen digitalen Plattformen wie auch bei Messenger-Diensten finden sich zuhauf falsche und irreführende Informationen zu COVID-19. Von angeblichen Wunderheilmitteln über frei erfundene Selbstdiagnosetipps bis hin zu Verschwörungstheorien zu den angeblichen Drahtzieher:innen hinter der Pandemie: Facebook, Twitter, YouTube, WhatsApp und andere Dienste müssen mit einer Flut an Desinformation umgehen.

Bisher ist die Reaktion der großen Tech-Unternehmen verbindlicher als zu Zeiten des US-Wahlkampfs 2016, als politischer Desinformation im digitalen Informationsumfeld kaum etwas entgegengesetzt wurde. Damals wie heute sind Eingriffe in die Meinungsfreiheit, um Lügen und Verunglimpfungen bestimmter Politiker:innen oder Gruppierungen weniger prominent zu platzieren, aus gutem Grund strittig. Bei Gesundheitsthemen scheinen solche Eingriffe heute ohne größere Diskussionen und technische Schwierigkeiten möglich zu sein. Mark Zuckerberg sagte dazu: „Wir hatten immer die Regel, dass wir Gefahren für das körperliche Wohlergehen nicht erlauben.“ Das sei anders „als das Hin und Her zwischen Kandidat:innen vor einer Wahl.“

Zwar geht es bei Gesundheitsthemen tatsächlich nicht um politische Meinungen, sondern um wissenschaftliche Fakten. Das macht zum Beispiel die Deplatzierung von Falschnachrichten zur Masernimpfung recht unkontrovers, wie es etwa bei Pinterest und YouTube der Fall ist. Aber die wissenschaftliche Lage zu SARS-CoV‑2 ist bei weitem nicht so klar wie bei Anti-Vax-Desinformation.

Was Millionen Menschen lesen, kann Auswirkungen auf die öffentliche Gesundheit haben

Was heute Gerücht und unbestätigte Studie ist, kann morgen offizielle Linie sein, auch wenn die Akteure das selbst vielleicht gar nicht wissen. Zum Beispiel warnte kürzlich noch das Bundesgesundheitsministerium vor „Fake News“, dass Einschränkungen des öffentlichen Lebens geplant seien. Dennoch sagen die Plattformen, dass sie hart gegen Desinformation zu COVID-19 durchgreifen werden: Facebook etwa will Inhalte löschen, die Gesundheitsorganisationen als falsch einstufen, und Google zeigt Informationen solcher Organisationen bei Suchen bewusst ganz oben an. Das ist gut, sinnvoll und im Interesse der öffentlichen Gesundheit.

Das Vorgehen der Plattformen zu Desinformation bei COVID-19 ist bisher beflissen. Ebenso wie in Krisensituationen politische Entscheidungsträger:innen schnell neue Lösungen finden müssen, sind sich nun offenbar auch große Plattformen ihrer Verantwortung für den öffentlichen Diskurs bewusst. Was Millionen Menschen auf Facebook, Twitter oder YouTube zu COVID-19 lesen, hören und sehen, kann Auswirkungen auf die öffentliche Gesundheit haben. Doch während Politiker:innen sich erklären müssen und wieder abgewählt werden können, beruhen die Maßnahmen großer Tech-Unternehmen nicht auf demokratisch legitimierten Vorgängen. Es ist weder im Interesse der Plattformen selbst noch der Gesellschaft, solche Macht unkontrolliert zu lassen.

Aber wie reagieren die Plattformen nun auf Desinformation zu COVID-19? Und welche Fragen wirft das Vorgehen auf?

Nahezu alle großen Plattformen haben im Zuge der Pandemie verschiedene Maßnahmen ergriffen, unter anderem:

- Philanthropische Maßnahmen, hauptsächlich in Form von Spenden: Beispielsweise arbeitet Facebook dafür mit den Vereinten Nationen und der Weltgesundheitsorganisation zusammen. Amazon hat für die Region Seattle einen „Nachbarschaftsfonds“ aufgesetzt.

- Zusammenarbeit untereinander und mit Regierungen, zum Beispiel zur Datenanalyse, um die Ausbreitung des Coronavirus zu erkennen, oder zur Botentwicklung, um Faktenchecks zu ermöglichen.

- Warnungen vor Desinformation und Verweis auf verlässliche Quellen.

- Hoch- und Herabstufen von Inhalten via KI

Mit Blick auf Desinformation fokussiert sich die folgende kurze Analyse auf die beiden letztgenannten Punkte.

Warnungen vor Desinformation und Verweis auf verlässliche Quellen

Große Plattformen haben mittlerweile etwas Erfahrung damit, Nutzende auf verlässliche Informationen hinzuweisen. So gibt es schon seit einiger Zeit unter bestimmten YouTube-Videos Verweise zur Quelle des Videos – etwa, ob es sich bei den Produzierenden um staatliche TV-Sender handelt.

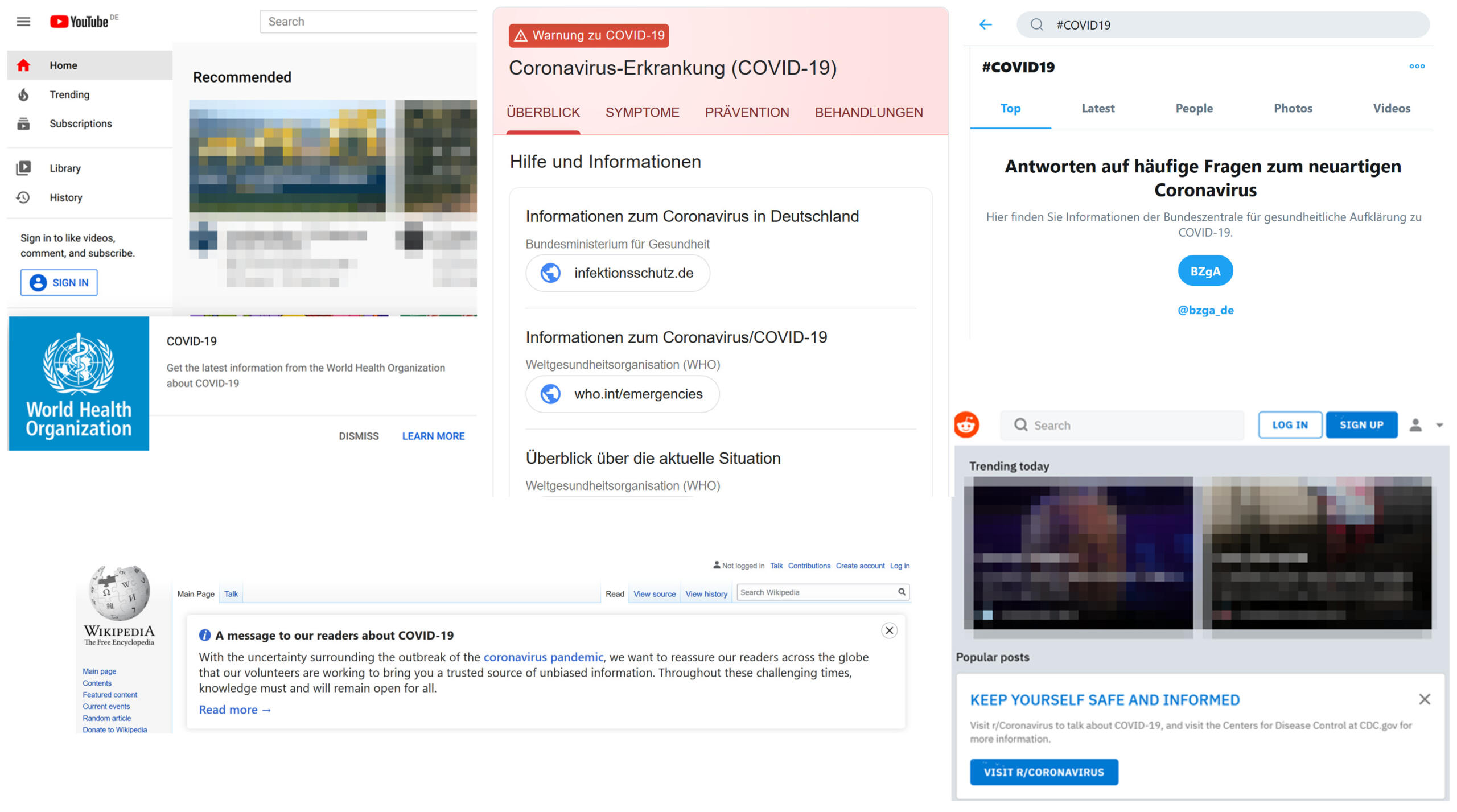

Warnhinweise zu COVID-19 gibt es in unterschiedlichen Formen auf fast allen Plattformen: YouTube zeigt bereits auf der Startseite einen Link zur Weltgesundheitsorganisation, die auch mit TikTok und Snapchat kooperiert. Google hat ein prominent platziertes Infofenster bei einer Suche zum Thema, Amazon verlinkt auf das Robert Koch-Institut, Twitter auf die Bundeszentrale für gesundheitliche Aufklärung. Instagram zeigt bei einer Suche nach „Coronavirus“ zunächst nichts außer einen Link zum Bundesgesundheitsministerium an. Facebook hat COVID-19-Informationen im Menü integriert und verweist Nutzende auf ein eigens eingerichtetes Informationspanel. Dass Facebook allen Nutzenden solche Informationen anzeigt, ist unüblich, da die Plattform sonst so gut es geht personalisiert ist.

Wie effektiv die Maßnahmen sind, ist zwar unklar, doch in jedem Fall ist es sinnvoll, Nutzenden zumindest die Option zu geben, mit wenigen Klicks an verlässliche Quellen zu kommen. Dass es dabei die Plattformen sind, die entscheiden, was verlässliche Quellen sind, ist in diesem Fall offensichtlich wenig kontrovers, weil es sich dabei um unabhängige, wissenschaftliche Behörden und Institutionen handelt, die teils sogar per Gesetz mit der Krisensituation befasst sind.

Eine Debatte darüber, wie und wann Tech-Unternehmen solche Entscheidungen treffen, ist dennoch wünschenswert. Denn diese Maßnahmen zeigen, dass Plattformen in der Lage und willens sind, zu bestimmten Themen prominent auf bestimmte Quellen hinzuweisen. Das kann für gute Zwecke genutzt werden – wie bei COVID-19 oder wenn etwa auch bei politischer Desinformation auf Faktenchecks verwiesen würde – aber auch mutwillig Debatten im Interesse Weniger verzerren. Ein Mindestmaß an Transparenz und Nachvollziehbarkeit ist nötig.

Hoch- und Herabstufen von Inhalten via KI

Was für Entscheidungen zu Quellenverweisen gilt, sollte umso mehr bei der Inhaltemoderation beachtet werden. Alle großen Plattformen haben öffentlich versichert, rigoros gegen Desinformation zu COVID-19 vorzugehen, also etwa Falschaussagen über vermeintliche Therapien zu entfernen. Facebook und YouTube versprachen außerdem der Weltgesundheitsorganisation unbegrenzte Werbecredits, damit diese theoretisch Informationen in allen Nutzerfeeds platzieren kann.

In der aktuellen Krisensituation ist ein solches Vorgehen einleuchtend. Doch auch hier ist idealerweise ein besseres Verständnis über Entscheidungsfindungen und Verantwortlichkeiten in den Unternehmen sowie die Abstimmung mit Regierungen wünschenswert. Anfang März trafen sich Vertreter:innen großer Plattformen und Mitglieder der Europäischen Kommission in Brüssel und waren sie sich einig, dass verlässliche Quellen zu COVID-19 auf Plattformen bevorzugt aufzufinden sein müssen und Desinformation entfernt werden müsse. Ähnliche Gespräche gab es in den USA.

Gerade wenn sich Staaten und Unternehmen einigen, welche Informationen den Millionen Plattformnutzenden vermehrt gezeigt und welche unterdrückt werden sollen, ist eine gewisse Aufsicht sinnvoll. Nochmal: Zur COVID-19-Pandemie ist die Sachlage recht klar, welche Inhalte gesundheitsschädlich sein könnten. Es ist vorbildlich, dass sich große Unternehmen ihrer Verantwortung stellen, ihr Vorgehen in Blogposts erläutern und mit Regierungen und internationalen Organisationen kooperieren. Doch für die Zukunft sollte Klarheit herrschen, unter welchen Umständen und mit welchen Begründungen und Kontrollmechanismen Einfluss auf die Sortierung und Anzeige von Inhalten auf Plattformen genommen werden kann.

Das ist auch im Eigeninteresse der Plattformen. Hinzu kommt in der aktuellen Lage, dass diese Inhaltemoderation (egal ob zu COVID-19 oder anderen Themen) vermehrt automatisiert wird. So müssen die großen Plattformen auf viele menschliche Inhaltemoderator:innen verzichten, die nicht mehr zur Arbeit kommen können oder sollen, und stattdessen KI-Systeme einsetzen. Diese sind aber nach eigenen Angaben noch sehr fehleranfällig und werden auch rechtmäßige Inhalte fälschlicherweise entfernen.

COVID-19 ist zuallererst eine gesundheitliche Herausforderung, gerade für arme und schwache Menschen, und zudem eine Herausforderung für die Gesundheits- und Wirtschaftssysteme. Vor diesem Hintergrund geht es nicht darum, in der aktuellen Krisensituation das Verhalten der großen Plattformen zu kritisieren. Einige Schritte der Unternehmen stimmen hoffnungsvoll, dass trotz Schwachstellen ein Umgang mit Desinformation möglich ist: der frühzeitige Schulterschluss mit internationalen Organisationen und Expert:innen, um deren Informationen zu platzieren, das strikte Vorgehen gegen gesundheitsschädliche Inhalte und generell eine Offenheit, mögliche Gefahren auf den eigenen Plattformen überhaupt anzuerkennen und anzugehen.

Dass dennoch weiterhin viel COVID-19-Desinformation Verbreitung findet, zeigt aber auch die Herausforderungen im digitalen Nachrichten- und Informationsumfeld, das maßgeblich von einigen großen Unternehmen geprägt ist. Politische Entscheidungsträger:innen, die mit ihren Verordnungen zu COVID-19 das Leben der Bürger:innen bestimmen, müssen für ihre Handlungen Rechenschaft ablegen. Für unternehmerische Entscheidungsträger:innen bei den Plattformen, deren Algorithmen das Informations- und Nachrichtenumfeld von Millionen Menschen ausmachen, sollten ebenfalls Transparenz- und Rechenschaftspflichten gelten.