Julia Angwin und Hannes Grassegger haben für ProPublica einen detaillierten Blick in Facebooks Löschkataloge geworfen und sind der Entstehung des Regelwerks nachgegangen. Die gezeigten Folien im Artikel sind denen vom Süddeutschen Magazin im Dezember 2016 veröffentlichten inhaltlich sehr ähnlich. Zusammen mit den vom Guardian veröffentlichten „Facebook Files“ ergeben sie mittlerweile ein recht genaues Bild, was bei Facebook gelöscht wird und was nicht. Gleichzeitig zeigt der Artikel, dass die Regeln immer komplexer werden, immer mehr Ausnahmen erhalten und oftmals auch nicht-intendierte Auswirkungen haben.

Grundsätzlich gilt: Bei Facebook gibt es bestimmte geschützte Kategorien wie Geschlecht, Religionszugehörigkeit, nationale Herkunft, geschlechtliche Identität, Rasse (Race), Ethnizität, sexuelle Orientierung sowie Behinderung oder Krankheit. Nimmt man nun eine dieser geschützten Kategorien und verbindet sie mit einem Angriff, zum Beispiel einen Aufruf zu Gewalt, ist dies laut Facebook Hate Speech. Und wird gelöscht.

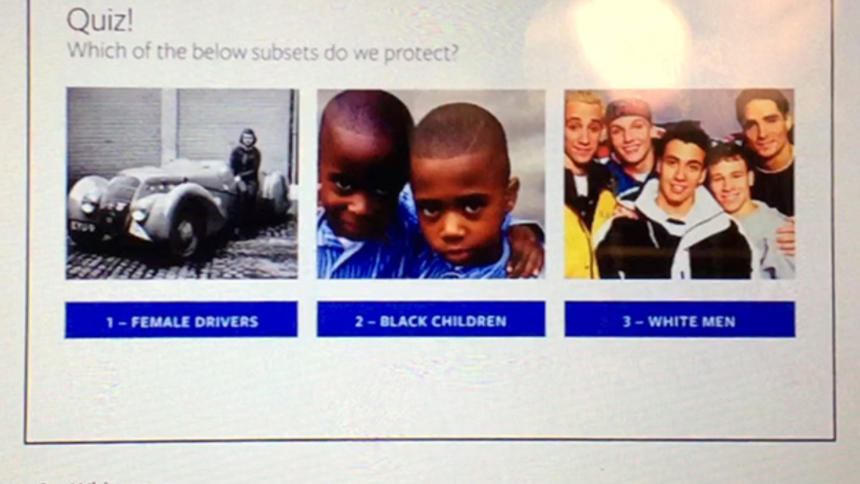

Werden Teilmengen (Subsets) der geschützten Kategorien wie „Französische Kinder“ oder „Lesbische Bäckerinnen“ Ziel von Angriffen, dann greift Facebooks Hate-Speech-Regel nicht. Die geschützte Kategorie bleibt nur geschützt, wenn sie mit einer geschützten Kategorie verknüpft wird. Das führt zu der skurrilen Situation, dass „Schwarze Kinder“ bei Facebook schlechter geschützt sind als „Weiße Männer“. Das belegt eine Folie, die ProPublica veröffentlicht hat (siehe Aufmacherbild oben).

Die Idee dahinter ist, dass alle gleich vor Hate Speech geschützt sind und Facebook sich ein konsistentes Regelwerk geben will, nach der die Moderatoren weltweit gleich entscheiden können. In der Realität können durch die Regeln allerdings benachteiligte Gruppen schlechter geschützt sein. Das kritisiert auch Juraprofessorin Danielle Citron gegenüber ProPublica. Der Ansatz von Facebook schütze Menschen, die es am wenigsten brauchen und nicht diejenigen, die es wirklich nötig hätten. Facebook-Managerin Monika Bickert erklärt dies damit, dass die Regeln global gelten sollen und Menschen überall auf der Welt verschiedene Ansichten hätten, was zum Teilen in Ordnung wäre.

ProPublica verweist im Artikel auf andere interessante Beispiele: Ein US-Senator, der zur Tötung „radikalisierter Moslems“ aufruft, bleibt unzensiert. Eine „Black Lives Matter“-Aktivistin, die allen weißen Menschen Rassismus vorwirft, wird gelöscht. Gleichzeitig hat zum Beispiel Donald Trumps Kampagne, muslimische Einwanderung zu verbieten, gegen die vorliegenden Richtlinien von Facebook (Protected Category + Calling for Exclusion) verstoßen. Als dies Facebooks Mitarbeiter durchsetzen wollten, wehrte sich Mark Zuckerberg persönlich gegen die Löschung.

Löschregeln werden komplexer

Facebook Löschregularien wurden mit der Zeit immer komplexer. Im Jahr 2008 sollen sie nur eine Seite umfasst haben, berichtet ProPublica. Im Jahr 2013 umfasste das Regelwerk schon 15.000 Wörter, es ist heute die Grundlage der Löschpraxis des Unternehmens. Auf der anderen Seite verlässt sich Facebook aber auch auf Informationen des US-Außenministeriums, etwa wenn es darum geht zu definieren, wer eine Terror-Organisation ist. Dann wieder gibt es geheime Listen, welches so genannte „Hate Organisations“ sind, die gebannt werden.

Mit wachsendem Umfang des Regelwerks stiegen auch die Ausnahmen an. Ein bekanntes Beispiel ist die ikonografische Fotografie des Napalm-Mädchens, das wegen Nacktheit von Facebook gelöscht wurde – und nach Protesten von Chefredakteuren und Ministerpräsidenten zu den Ausnahmen hinzugefügt wurde.

Diese Art der Ausnahmen kritisiert Kate Klonick, die sich mit Zensur bei Technologiefirmen beschäftigt, gegenüber ProPublica. Die Beispiele zeigten, dass Prominente, Staatschefs und wichtige Leute überproportional die Regeln von Facebook verändern könnten.

Zum komplexen Löschkatalog von Facebook werden sich nach Verabschiedung des Netzwerkdurchsetzungsgesetzes auch noch „offensichtlich rechtswidrige Inhalte“ gesellen, über die das soziale Netzwerk richten werden muss, wenn es denn keine Bußgelder kassieren will.

Auszug aus dem Löschkatalog (geschützte Kategorien):

Schöner und aufschlussreicher Artikel, tendenziöse Überschrift. Muss das sein? Immer wieder Öl ins Feuer gießen?

Ihr hättet genauso gut „Schwarze Rollstuhlfahrer besser geschützt als schwarze Postboten“ als Titel nehmen können. Oder: „Chinesische Rollstuhlfahrer besser geschützt als chinesische Postboten als Briefmarken sammelnde Postboten“.

Warum habt ihr den „weißen Mann“ gewählt?

Ich verstehe nicht, was an der Überschrift tendenziös sein soll. Überschriften müssen knallen und Aufmerksamkeit auf sich ziehen. In diesem Fall sollte es auch eine Referenz an den Artikel sein, den meiner zusammenfasst. Und natürlich sollte man bei Ungleichheiten und Ungerechtigkeiten immer wieder Öl ins Feuer gießen, um diese sichtbar zu machen und irgendwann abzubauen.

Gleich vorweg: ich werde mich nicht auf eine Diskussion einlassen, die den weißen Mann als Opfer darstellt. Das ist wie Klimawandel leugnen, dafür will ich meine Zeit nicht verschwenden.

Also verwendest du die Genderdebatte für Clickbaiting, hane ich das richtig verstanden?

Ich bin mir ziemlich sicher, dass du ganz genau weißt, was du da machst. Du versuchst in einem Thema, nämlich den unmöglichen Regeln von Facebook, ein unnötiges Gebashe einer Gruppe unterzubringen. Und dass diese Gruppe derzeit durch die Genderdebatte negativ konnotiert ist, weißt du auch, wie ich es deinem Kommentar entnehmen kann.

Auf Probleme aufmerksam machen kannst du in diesem Fall in Bezug auf die Facebook-Regeln, nicht aber willkürlich auf etwas anderes.

Und was hat das jetzt mit Klimawandel leugnen zu tun? „Der weiße Mann an sich“ mag durchaus derzeit und seit Langem Vorteile gegenüber allen anderen nach dieser Kategorisierung haben. Dennoch hilft es auf gar keinen Fall, wo es nur geht Ohrfeigen einzustreuen und somit selbst dem zu mutieren, wofür „der weiße Mann an sich“ kritisiert wird. Das ist, wie der Welt Frieden zu bringen. Mit Krieg. Oder siehst du das anders?

Und du bräuchtest deine Zeit damit nicht zu verschwenden, wenn du damit nicht dein Clickzahlen erhöhen wollen würdest.

Wie üblich beim Thema „Gleichberechtigung“ ist mir zwar nicht ganz klar, warum weiße Männer nicht ebenfalls vor Angriffen geschützt werden sollten bzw. warum ich als Individuum es ertragen sollte, dass man mich angreift, weil es weißen Männern statistisch gesehen besser geht.

Nichtsdestotrotz, wer in der Praxis schon mal mit Facebooks Löschregeln auseinandergesetzt hat, weiß, wie grotesk das ist. Ich habe mehr als einmal die Verherrlichung des Holocausts gemeldet, inklusive drastischen Bildmaterials (und zwar nicht als Einzelfall, sondern als Gruppe) und durfte erfahren, dass das nicht gegen die Gemeinschaftsstandards verstößt. Und wenn das bei Facebook die Messlatte des Akzeptablen ist, wundere ich mich, dass bei Facebook überhaupt irgendwas gelöscht wird. Achso, außer Titten. Titten gehen natürlich gar nicht. Weg damit.

Da steht doch nirgendwo, dass jemand schlechter gestellt werden sollte, sondern dass manche Gruppen schlechter gestellt sind.

Schon klar. Der Subtext, der bei sowas gerne durchschimmert ist, dass ein Angriff auf eine schwarze Frau (dafür, dass sie schwarze Frau ist) schlimmer wäre als ein Angriff auf einen weißen Mann (weil er weißer Mann ist).

Und auch wenn natürlich völlig klar ist, dass rein statistisch die schwarze Frau eher mit Angriffen zu rechnen hat als der weiße Mann, trifft es mich als Individuum doch genauso. Es tröstet mich nicht, zu wissen, dass das statistisch unwahrscheinlich war.

„Der Ansatz von Facebook schütze Menschen, die es am Wenigsten brauchen und nicht diejenigen, die es wirklich nötig hätten.“

Ich finde, das ist falsch. Es sollte jeder unabhängig von Geburtsmerkmalen gleich stark geschützt werden. Auch der weiße Mann, der vielleicht statistisch ganz oben steht, individuell aber möglicherweise trotzdem mit so etwas konfrontiert wird.

Ich lese da nicht die Aussage raus, dass bestimmte Menschen in Zukunft schlechter geschützt werden sollen, sondern dass die Situation momentan so ist.

P.S.: Deine Referenzierung lasse ist natürlich durchaus ein Argument. :-)