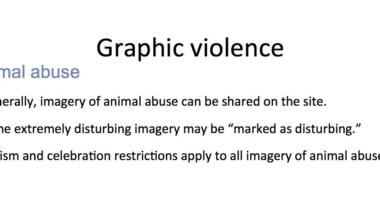

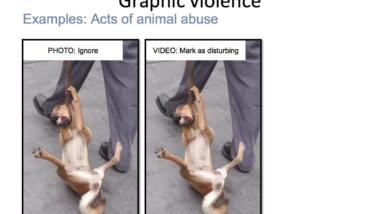

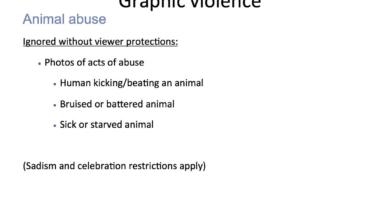

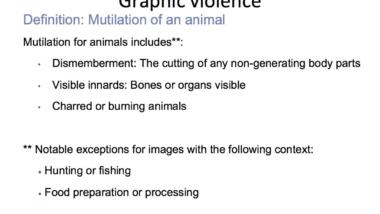

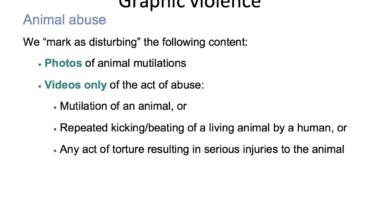

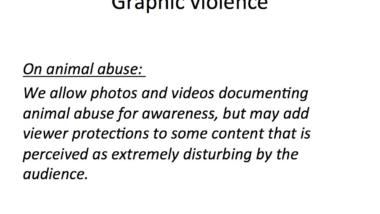

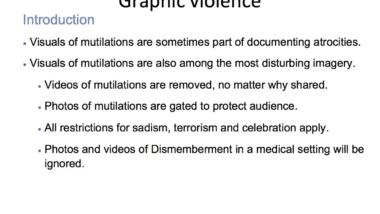

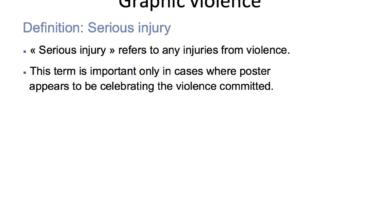

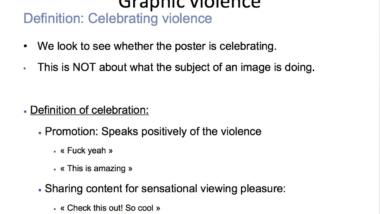

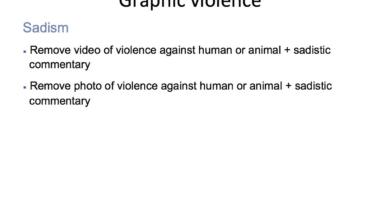

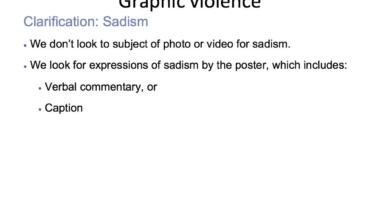

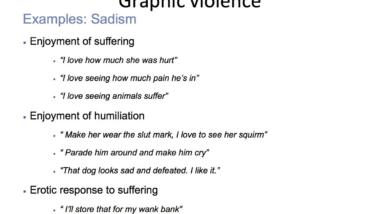

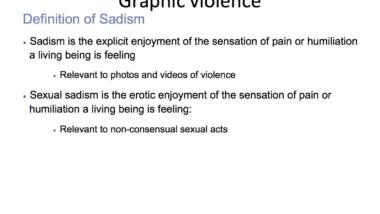

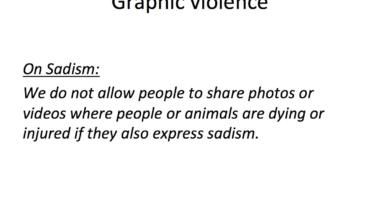

„Lasst uns dicke Kinder schlagen“ ist in Ordnung, „Jemand sollte Trump erschießen“ wird gelöscht. Bilder von Tieren, die gequält werden, sind erlaubt. Kommt ein Satz wie „Ich liebe zu sehen, wenn Tiere leiden“ hinzu, dann wird gelöscht. Dies sind nur ein paar Beispiele aus dem Löschkatalog von Facebook. Dem Guardian sind mehr als 1000 Seiten aus Handbüchern und Präsentationen zugespielt worden, aus denen die Löschpraxis des sozialen Netzwerks hervorgeht. Die Berichterstattung darüber ist in einem Dossier mit dem Namen „Facebook Files“ verfügbar.

Wir haben alle verfügbaren Folien beim Guardian aus den einzelnen Galerien gesammelt und in diesem PDF zusammengefasst. So fällt es etwas einfacher, den Überblick über den Leak zu behalten. Schon im vergangenen Dezember hatte das Süddeutsche Magazin einschlägige Leitfäden eingesehen, aus denen die Grundprinzipien der Moderation hervorgehen. Wir haben diese Richtlinien damals in einem Artikel veröffentlicht und die Prinzipien erklärt.

Bei Morddrohungen entscheidet die Glaubwürdigkeit

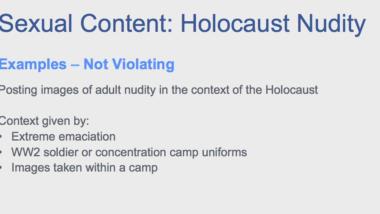

Meinungsfreiheit erfordert bei Facebook einen gehörigen Spagat und immer mehr Sonderregeln. Während zum Beispiel Nacktfotos generell verboten sind, erlaubt das soziale Netzwerk, Nacktbilder von Holocaust-Opfern unter dem Schlagwort „Holocaust Nudity“ hochzuladen. Mit solchen Prinzipien will Facebook die Auseinandersetzung mit wichtigen Bildern der Geschichte möglich machen. Solche Ausnahmen sind durchaus sinnvoll, wie das Beispiel mit dem nackten Napalm-Mädchen zeigte. Hier löschte Facebook das wohl wichtigste Pressefoto des Vietnamkrieges, weil es ein nacktes Kind zeigte – und löste einen Proteststurm aus.

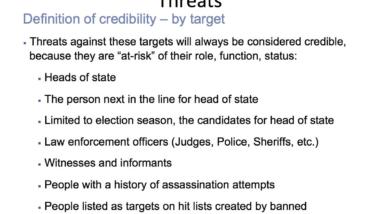

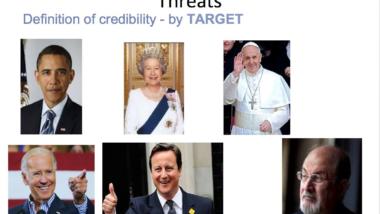

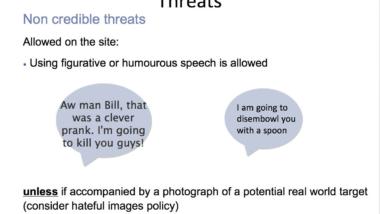

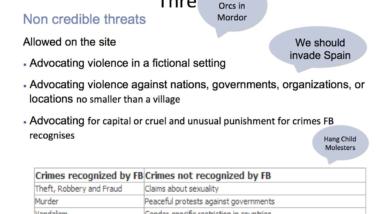

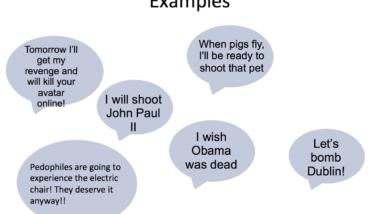

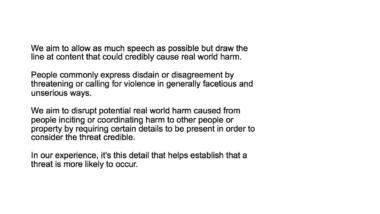

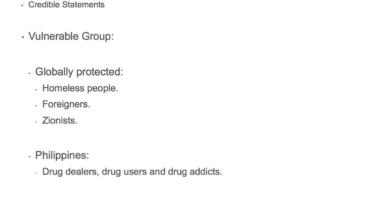

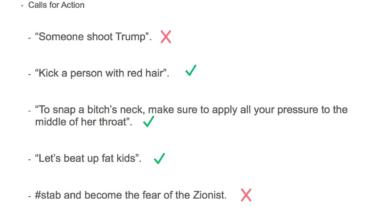

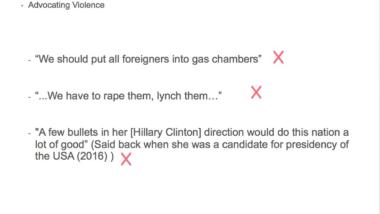

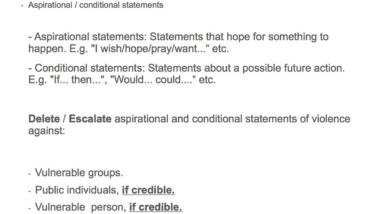

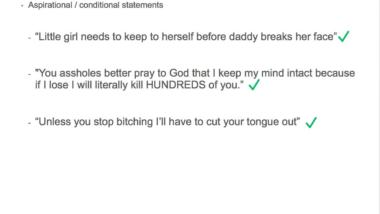

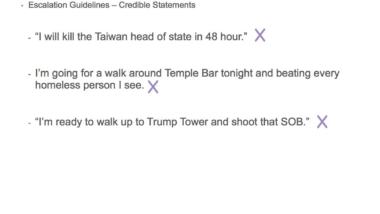

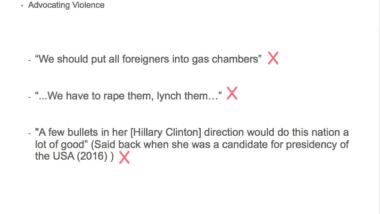

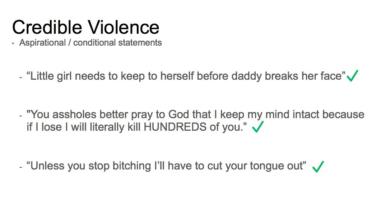

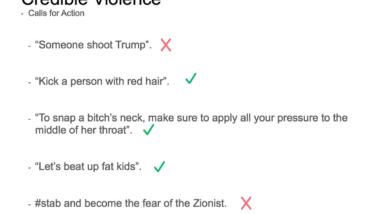

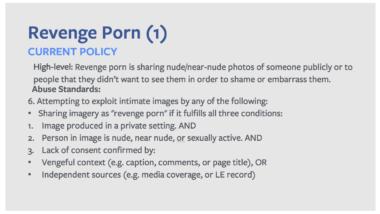

Interessant ist der Umgang von Facebook mit Morddrohungen und ‑aufrufen. Staatsoberhäupter genießen hier einen besonderen Schutz, weswegen Aussagen wie „Jemand sollte Trump erschießen“ von der Plattform verschwinden. Dagegen hält Facebook „Ich hoffe, dass Dich jemand umbringt“ für legitim, während wiederum „Ich hasse Ausländer und werde sie alle erschießen“ nicht durchgeht. Das hat mit den „geschützten Gruppen“ zu tun, die damals in der Veröffentlichung des SZ Magazins erklärt wurden.

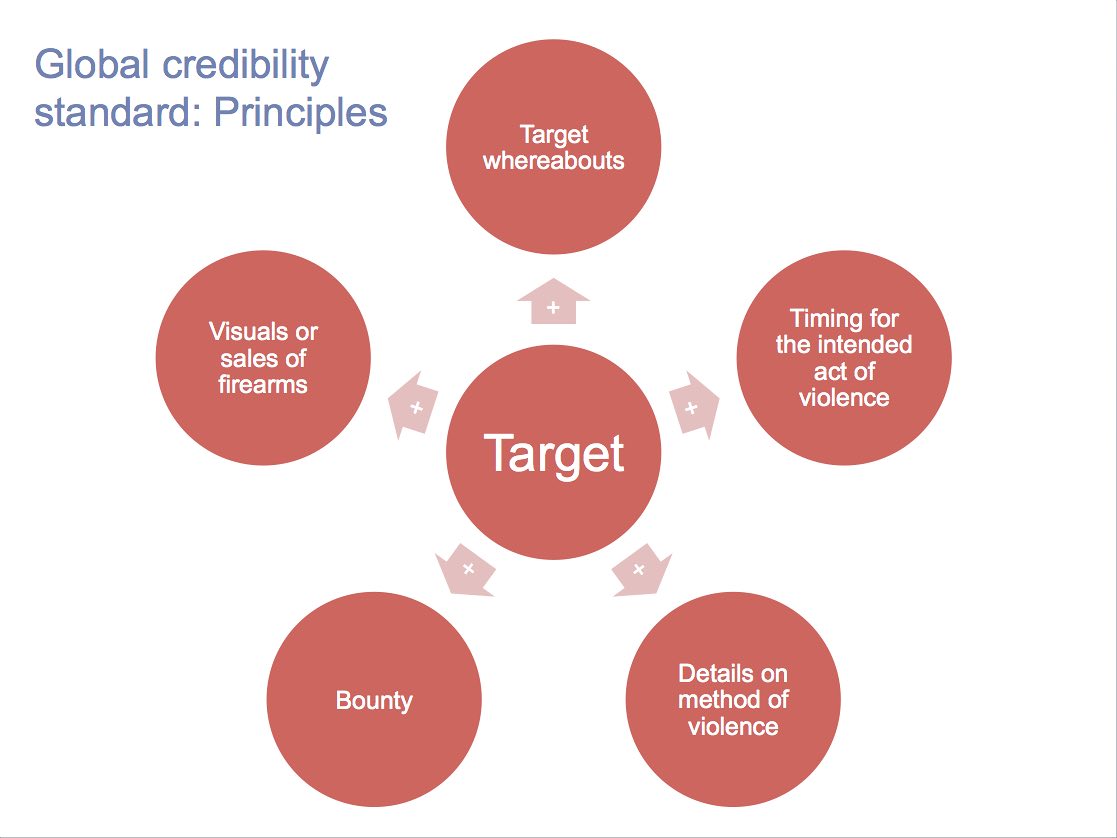

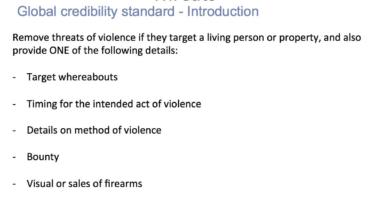

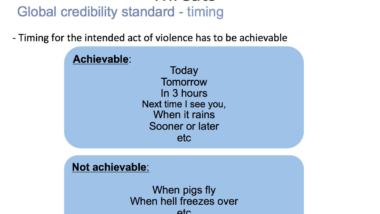

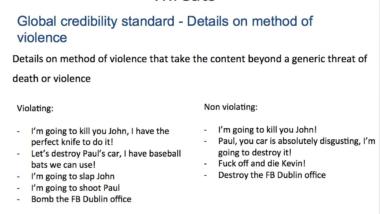

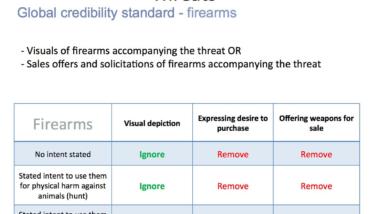

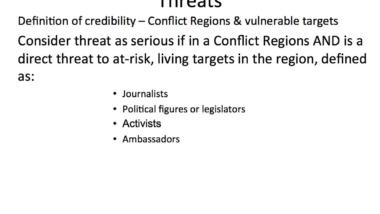

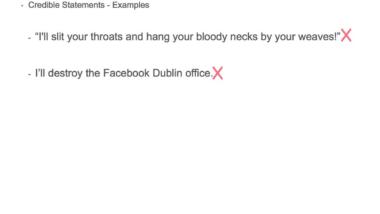

Die unterschiedliche Bewertung von Morddrohungen hat noch eine weitere Ebene: Je mehr Details in eine Drohung einfließen, beispielsweise Orte, Art der Gewalt oder ein Zeitpunkt, desto glaubwürdiger bewertet das Unternehmen die Ansage.

Die bislang veröffentlichten Regeln zeigen, wie komplex die Löschentscheidungen mittlerweile geworden sind. Würde in Deutschland nun noch das Netzwerkdurchsetzungsgesetz hinzukommen, erhöht sich der Komplexitätsgrad weiter: Dann gelten nicht nur die bislang völlig intransparenten Löschregeln von Facebook, sondern auch die unternehmensinterne rechtliche Interpretation deutscher Gesetze. Und da das deutsche Gesetz eine Strahlkraft auf andere Länder haben könnte, dürfte sich der Komplexitätsgrad mit weiteren solchen nationalen Gesetzen noch einmal erhöhen.

Wer selbst sehen will, wie schwierig solche Löschentscheidungen schon heute für die weltweit etwa 4.500 Moderatoren sind, kann hierfür ein Quiz beim Guardian machen.

Anhang: Die veröffentlichten Facebook-Folien

Hinweis: Einige der Bilder in den Folien können verstörend sein.