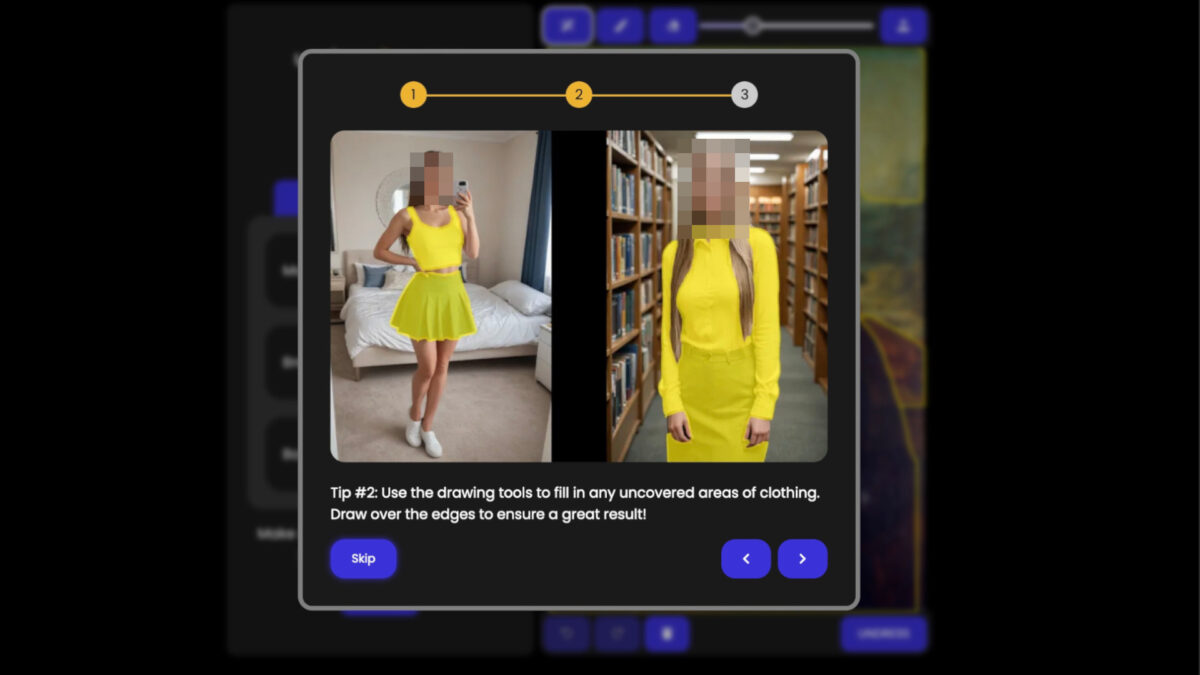

Die ersten Bilder sind gratis, ab dann wird ein Abo fällig. Websites zum Erstellen sexualisierter Deepfakes bieten ihre Dienste inzwischen offen im Netz an; es braucht nur eine Anmeldung per E‑Mail-Adresse. Nutzer*innen können ein beliebiges Foto hochladen – und per Mausklick wird die abgebildete Person entkleidet. Die Ergebnisse sind teils fotorealistisch, möglich ist das durch moderne Bildgeneratoren.

Wer solche Bilder ohne Einverständnis der gezeigten Personen erstellt, setzt sich über deren sexuelle Selbstbestimmung hinweg und übt bildbasierte Gewalt aus. Wer solche Bilder verbreitet, kann sich eventuell strafbar machen.

Für die Recherche hat netzpolitik.org eine Stichprobe aus zehn Deepfake-Websites miteinander verglichen und deren Betreiber*innen kontaktiert. Die Seiten ließen sich innerhalb kürzester Zeit finden. Es genügten simple Suchbegriffe bei einer gängigen Suchmaschine. Um den Seiten keine zusätzliche Reichweite zu verschaffen, werden Namen hier nicht genannt, auch nicht die verwendeten Suchbegriffe.

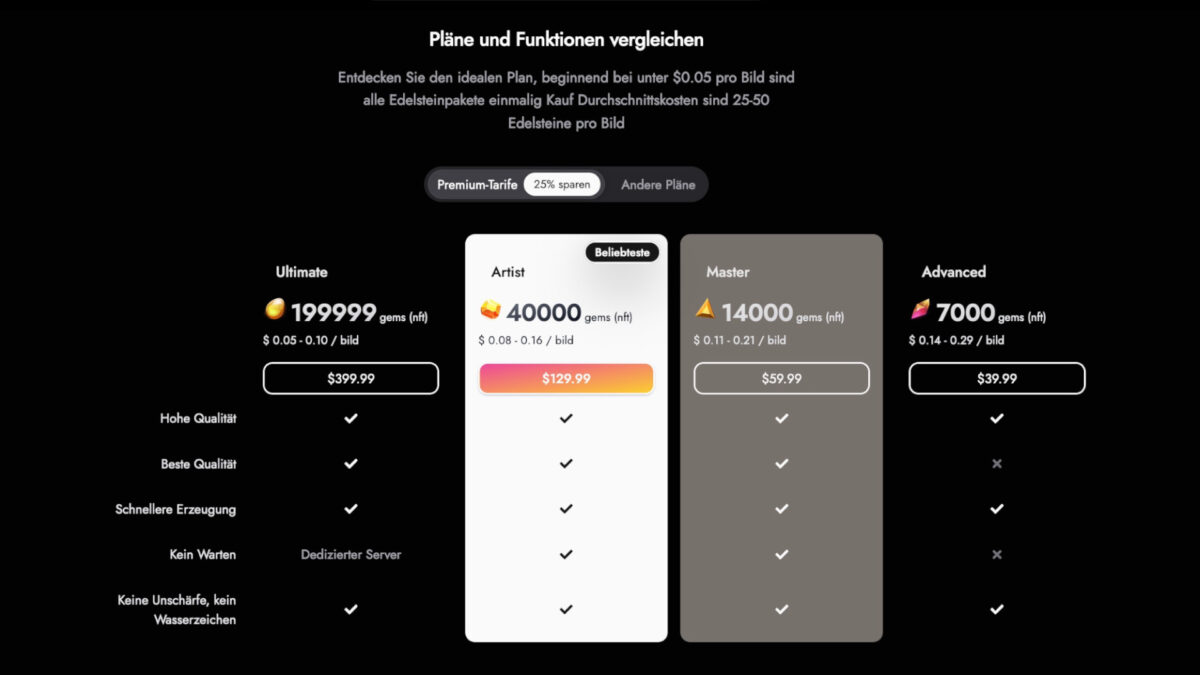

Der Vergleich zeigt: Es ist inzwischen so einfach wie nie, realitätsnahe sexualisierte Deepfakes zu erstellen. Die Website-Betreibenden haben nach eigenen Angaben teils Hunderttausende Nutzer*innen pro Monat. Die Preise für Premium-Abos beginnen bei 2 Euro für Einsteiger*innen und enden bei bis zu 380 Euro fürs Jahresabo. Die Abos versprechen auch eine höhere Auflösung oder kürzere Bearbeitungszeiten.

Dass man solche Bilder nicht ohne Einverständnis der gezeigten Personen erstellen soll, wird oft per Pop-up-Hinweis abgefrühstückt. Teils legen die Websites den Besucher*innen allerdings nahe, sich Nacktbilder weiblicher Promis generieren zu lassen. So zeigt eine Seite das Oben-ohne-Bild einer bekannten US-Sängerin. Deepfakes weiblicher Körper sind offenkundig das Primärprodukt. Nur vereinzelt fand sich auch die Option, nackte männliche Körper zu generieren.

Werkzeuge einfach zugänglich

Jüngst berichteten internationale Medien über einen Deepfake-Fall aus dem US-Bundesstaat Pennsylvania: Die Polizei hatte demnach einen Schüler festgenommen, der KI-Nacktbilder von Mitschüler*innen erstellt haben soll. Aus Sicht der Eltern habe die Schule nicht ausreichend auf Warnungen reagiert. Als der Streit eskalierte, fiel sogar der Unterricht aus. Im Vorjahr kochte ein Deepfake-Fall in einer spanischen Schule zu einem landesweiten Skandal hoch. Die Mütter der betroffenen Mädchen organisierten sich, Zeitungen und Fernsehen berichteten.

Unsere Recherche zeigt: Die Werkzeuge für solche Deepfakes sind einfach zugänglich. Täter*innen bräuchten nur wenige Minuten und ein paar Fotos aus sozialen Medien, um ähnliche Skandale zu reproduzieren. Eines der Tools bietet Nutzer*innen sogar an, einfach den Link zu einem Instagram-Profil einzugeben und die Software soll sich die Bilder automatisch schnappen. Der Aufschrei in Spanien und in den USA mag sich auf konkrete Einzelfälle beziehen – doch vieles spricht dafür, dass sich solche Fälle rund um kursierende KI-Nacktbilder sehr leicht wiederholen können.

Die Technologie dahinter sind universell einsetzbare Bildgeneratoren wie etwa das quelloffene StableDiffusion. Mehrere der untersuchen Websites nehmen ausdrücklich auf StableDiffusion Bezug. Vereinfacht ausgedrückt entsteht das KI-Nacktbild so: Zunächst erkennt eine Software die Umrisse einer dargestellten, bekleideten Person. Dann wird die entsprechende Fläche mit der Darstellung einer nackten Person gefüllt. Beibehalten werden das Gesicht und die sonstige Umgebung des Bildes. Gerade bei frontalen Aufnahmen mit eng anliegender Kleidung können auf diese Weise sehr realistische Aufnahmen entstehen.

Zwar könnten Menschen auch mit einer herkömmlichen Bastelschere Gesichter ausschneiden und Fotos montieren. Im Gegensatz zu solchen Papierfakes sind Deepfakes jedoch mühelos zu erstellen und realistischer.

Verbreitung seit 2023

Noch vor wenigen Jahren war der Zugang zu sexualisierten Deepfakes deutlich schwerer. 2019 gab es etwa Berichte über eine Deepfake-Software namens Deepnude. Auch wenn die ursprünglichen Uploads der Software offline genommen wurden, kursierten in Foren weiterhin Kopien. Inzwischen müssen sich Nutzer*innen nicht mehr durch solche Foren wühlen.

2022 berichteten wir gemeinsam mit dem SPIEGEL über populäre FaceSwap-Apps. Nutzer*innen konnten in den Apps etwa das Nacktbild einer Pornodarsteller*in hochladen und dann deren Gesicht ersetzen. Auch das ist wohl überholt: Inzwischen benötigen Nutzer*innen nur noch das Bild einer beliebigen, bekleideten Person als Vorlage.

2024 warf laut US-Magazin 404 Media Apple mehrere iOS-Apps aus dem App Store, die für nicht-einvernehmliche, sexualisierte Deepfakes geworben haben sollen. Wenn sie ihre Dienste dagegen direkt im Browser anbieten, müssen sich Deepfake-Shops nicht an die Richtlinien von App-Marktplätzen halten.

Der offenbar älteste der zehn untersuchten Online-Shops wurde im Jahr 2022 erstmals im Internet Archive hinterlegt. Das Internet Archive dokumentiert – größtenteils automatisch – Websites für die Nachwelt. Vier Online-Shops wurden im Jahr 2023 erstmals archiviert; vier weitere im Jahr 2024. Die für diese Recherche untersuchten Deepfake-Shops sind also eine neuere Entwicklung.

Windelweiche Schutzmaßnahmen

Alle zehn Shops haben sich zumindest oberflächlich auf juristischen und ethischen Widerstand vorbereitet. Bei mehreren Shops weisen Pop-up-Fenster darauf hin, dass Nutzer*innen volljährig sein müssen und keine Fotos ohne Einverständnis hochladen dürften. Ein Shop schreibt im Footer der Website, für die generierten Bilder sei man als Unternehmen nicht verantwortlich. Ein weiterer Shop führt aus, man sei sich der ethischen Implikationen bewusst – und ermuntere Nutzer*innen, alle rechtlichen Standards einzuhalten. Einen eher kreativen Ansatz verfolgt ein anderer Shop: Die generierten Bilder seien Kunst.

Mehrere Shops schreiben ausdrücklich, dass sie Maßnahmen gegen die sexualisierte Darstellung von Minderjährigen ergreifen würden. In vielen Ländern, darunter Deutschland, ist der Besitz solcher Aufnahmen strafbar. Mithilfe automatischer Alterserkennung lassen sich zumindest technische Hürden hochziehen, um zu verhindern, dass Deepfakes von Kindern generiert werden. Allerdings sind die Schätzungen solcher Anwendungen ungenau. Gerade Personen um die 18 Jahre könnten also irrtümlich als bereits volljährig oder als noch minderjährig eingeschätzt werden.

Dennoch behauptet einer der analysierten Shops, man blockiere 99,9 Prozent illegaler Inhalte durch automatische und händische Prüfung. Außerdem würden die erzeugten Aufnahmen ein Wasserzeichen verpasst bekommen, das Zeitstempel und IP-Adresse enthalte. So könnten Betroffene im Zweifel ein Bild zur Ersteller*in zurückverfolgen. Näher geprüft haben wir das nicht.

Ob die Darstellung einer erwachsenen Person mit oder ohne Einverständnis erfolgt, lässt sich ohne Weiteres nicht feststellen. Große Pornoseiten wie Pornhub verlangen von Darsteller:inen deswegen inzwischen Dokumente und Video-Verifikation. Solche Vorkehrungen fanden wir jedoch bei keinem der zehn Shops.

Dabei ist der Einsatz von Deepfakes für einvernehmliche Darstellungen durchaus denkbar. Im Frühjahr interviewte beispielsweise die taz die Porno-Creatorin Sika Moon, die von realen Aufnahmen ihres Körpers zu Deepfakes wechselte – unter anderem zum Schutz vor Stalking. Mit Blick auf nicht-einvernehmliche KI-Nacktbilder sagte sie: „Das Problem liegt nicht im Werkzeug, sondern bei dem, der es benutzt.“

Adresse: unbekannt

Eine Unternehmensadresse gaben nur drei der zehn Shops auf ihrer Website an. Zwei davon waren demnach in Großbritannien, eine in Argentinien registriert. Zwei Shops erwähnten zumindest das Land Großbritannien als Firmensitz. Und zwei weitere nannten auf direkte Anfrage ihr angebliches Herkunftsland: Kambodscha und Taiwan. Bei drei Shops bleibt schleierhaft, wo die Betreiber*innen sitzen.

Der Deepfake-Shop aus Taiwan hat nach eigenen Angaben 200.000 zahlende Nutzer*innen. Im Durchschnitt würden täglich 100.000 Bilder generiert, heißt es in einer E‑Mail, die jedoch mit keinem Namen unterzeichnet wurde. Beim Shop in Kambodscha sollen es täglich 6.000 generierte Bilder sein, rund 50.000 Nutzer*innen würden für den Dienst zahlen. Seit Gründung seien fast 22 Millionen Aufnahmen in Nacktbilder verwandelt worden.

Von Außen überprüfen lassen sich diese Zahlen nicht. Gerade im Konkurrenzkampf miteinander hätten solche Shops zumindest den Anreiz, sich als besonders populär zu präsentieren.

Zahlungen mit Kreditkarte oder PayPal

Am Geschäft mit den Deepfakes sind offenbar herkömmliche Zahlungsdienstleister beteiligt: sechs von zehn Shops gaben an, Zahlungen per Visa und Mastercard zu akzeptieren; drei nennen PayPal, drei Google Pay. Ob Zahlungen über diese Dienstleister auch wirklich funktionieren, haben wir nicht getestet.

Alle Shops verlangen zudem einen Login per E‑Mail, um sich Bilder generieren zu lassen. Das dürfte auch eine Maßnahme gegen automatisierte Nutzung durch Bots sein. Hierfür boten acht von zehn Shops an, sich per Gmail-Adresse einzuloggen – also einen weiteren Google-Dienst.

Die Pressestellen von Visa, Mastercard, PayPal und Google beantworteten die Presseanfrage von netzpolitik.org sehr ähnlich: Demnach verstoßen die Shops für sexualisierte Deepfakes gegen die Richtlinien der Konzerne. Entsprechenden Hinweisen gehe man nach. Wie oft das schon der Fall gewesen ist, will jedoch keiner der Konzerne beantworten – auch nicht auf direkte Nachfrage.

Auf einen potenziellen Wegfall der Zahlungsoptionen haben sich mehrere Shops bereits vorbereitet. Sie bieten auch Zahlung per Kryptowährung an.

EU-Richtlinie verbietet Verbreitung

Bereits in unserem Bericht aus dem Jahr 2022 haben wir geschildert, was KI-generierte Nacktbilder für Betroffene bedeuten können. Die Bilder können sich schnell verbreiten, auch in der Schule oder im Arbeitsumfeld. Selbst wenn ein Deepfake nicht den wahren Körper zeigt, kann es Betroffene bloßstellen und verletzen. Josefine Ballon von HateAid sagte: Betroffene wüssten nie, ob andere die Deepfakes vielleicht doch für echt halten. Die gemeinnützige Organisation unterstützt Betroffene digitaler Gewalt juristisch und bringt sich politisch ein.

Zum Schutz von Betroffenen hat sich die EU jüngst auf eine Richtlinie zur Bekämpfung von Gewalt gegen Frauen geeinigt. Demnach müssen Mitgliedsstaaten – auch Deutschland – die Verbreitung nicht-einvernehmlicher, sexualisierter Deepfakes ausdrücklich unter Strafe stellen. Die EU-Mitgliedstaaten haben für die Umsetzung drei Jahre Zeit. Die neuen Regeln dürften damit also erst ab 2027 greifen. Zumindest die Union im Bundesrat zeigte schon in diesem Jahr Ambitionen, eine frühere Regulierung zu schaffen.

Bis auf Weiteres müssen sich Betroffene in Deutschland auf andere Gesetze berufen. In Frage kommen etwa zivilrechtliches Vorgehen wegen der Verletzung von Persönlichkeitsrechten oder das Kunsturhebergesetz, wie der deutsche Juristinnenbund ausführt. HateAid nennt gerade bei herabwürdigenden Deepfakes auch eine strafrechtliche Handhabe, etwa wegen Beleidigung oder Verleumdung.

Geschlechtsspezifische Deepfakes

Neben den Personen, die per Deepfake entkleidet werden, spielt noch eine Gruppe eine Rolle: Vorlage für die nackten Körper der Deepfakes dürften in vielen Fällen die Aufnahmen von Erotik- und Pornodarsteller*innen sein. Deren Job ist ohnehin oft prekär – und die wenigsten dürften ihr Einverständnis dafür gegeben haben, mit ihren Inhalten für KI-Training oder als Deepfake-Vorlage herzuhalten.

Im Kern sind nicht-einvernehmliche, sexualisierte Deepfakes weniger ein juristisches oder technologisches Problem als ein gesellschaftliches. Es ist die Entscheidung von Menschen, die Grenzen der abgebildeten Personen durch KI-Nacktbilder zu verletzen. In den Skandal-Fällen aus Pennsylvania und Spanien waren Teenager*innen involviert. Je nach Fall und Alter sind sie noch nicht einmal strafmündig.

Das Phänomen hat auch eine geschlechtsspezifische Dimension. Besonders im Visier digitaler Gewalt sind Frauen – und das spiegelt sich auch in den zehn untersuchten Online-Shops wider. Sexualisierte Frauenkörper stehen auf diesen Websites klar im Vordergrund. Es wimmelt vor Brüsten, Nippeln und Vulven. Penisse muss man aktiv suchen und wird nur manchmal fündig. So lange es für viele kein Tabu ist, solche nicht-einvernehmlichen Bilder zu generieren, dürften sich Deepfakes kaum eindämmen lassen.