I. produziert Pornofilme, aber seine Darsteller:innen wissen davon nichts. Für seine Produktionen nutzt er Material aus dem Internet. Er kombiniert die Körper von Pornodarsteller:innen mit den Gesichtern anderer Menschen. Eine Software erkennt Mimik und Bewegungen und lässt das neue Gesicht mit der Videovorlage verschmelzen. Solche Videos nennt man Deepfakes. Und die Software dafür musste er nicht etwa in einer geheimen Ecke des Internets auftreiben. Er benutzt einfach eine populäre Smartphone-App.

In einem Forum für Deepfake-Pornos schwärmt I. von der App, die im Google Play Store mehr als eine Million mal heruntergeladen wurde. Es gibt sie auch für iOS. „FaceMagic ist die beste kommerzielle Deepfake-App, die ich je benutzt habe!“, schreibt er auf Englisch. Er bezeichnet sie als „godsend“, Geschenk des Himmels.

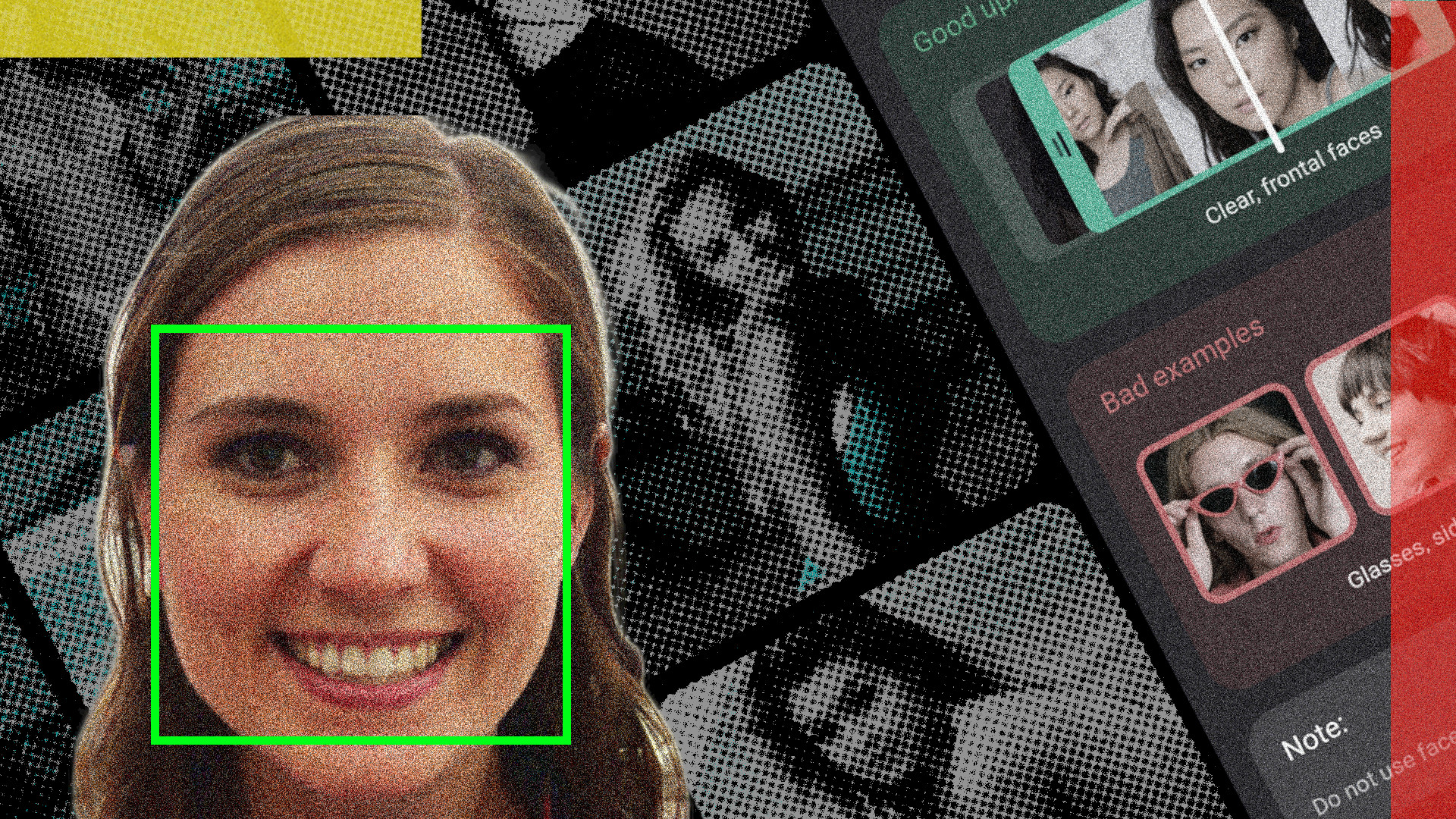

Mit FaceMagic können Nutzer:innen innerhalb weniger Sekunden beliebige Gesichter in beliebige Videoclips montieren. Wer genau hinschaut, kann den Fake oft erahnen. Die Gesichter haben weich gezeichnete Konturen, manche Bewegungen wirken verzögert. Dennoch ist die Qualität der Clips gut genug, um Deepfake-Fans ins Schwärmen zu bringen. Und sie reicht aus, um Personen herabzuwürdigen, etwa wenn ihr Gesicht gegen ihren Willen in einem realistischen Porno auftaucht.

„Übergriffige und gewaltvolle Erfahrung“

Wer Menschen ohne Einverständnis in sexualisierte Aufnahmen montiert, verletzt ihre Persönlichkeitsrechte, wie Josephine Ballon von HateAid erklärt. Die gemeinnützige Organisation hilft Betroffenen von digitaler Gewalt im Netz. Ballon beschreibt es als „übergriffige und gewaltvolle Erfahrung“, wenn andere Bildmaterial über einen in Umlauf bringen, ohne dass man das kontrollieren kann. Fachleute nennen das bildbasierte, sexualisierte Gewalt. Unter diesen Sammelbegriff fallen auch sogenannte Rachepornos.

Gemeinsam mit dem SPIEGEL haben wir untersucht, wie drei der populärsten Deepfake-Apps mit bildbasierter Gewalt umgehen. FaceMagic, Reface und FacePlay. Die drei Gratis-Apps wurden millionenfach heruntergeladen und können beliebige Gesichter in bewegte Clips montieren. Unsere Recherche zeigt: Die Betreiber setzen sich nur bedingt dagegen ein, dass ihre Apps für bildbasierte Gewalt missbraucht werden. So ließen sich bei unserem Test mit der Bezahl-Version von FaceMagic problemlos Deepfake-Pornos erstellen.

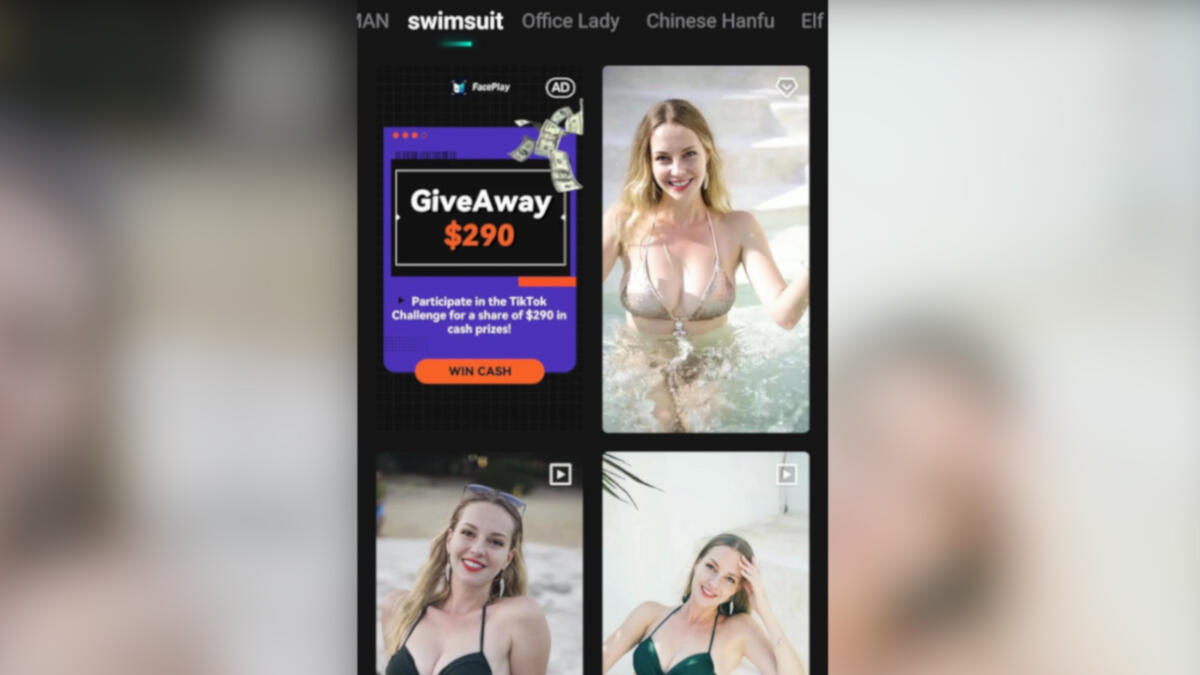

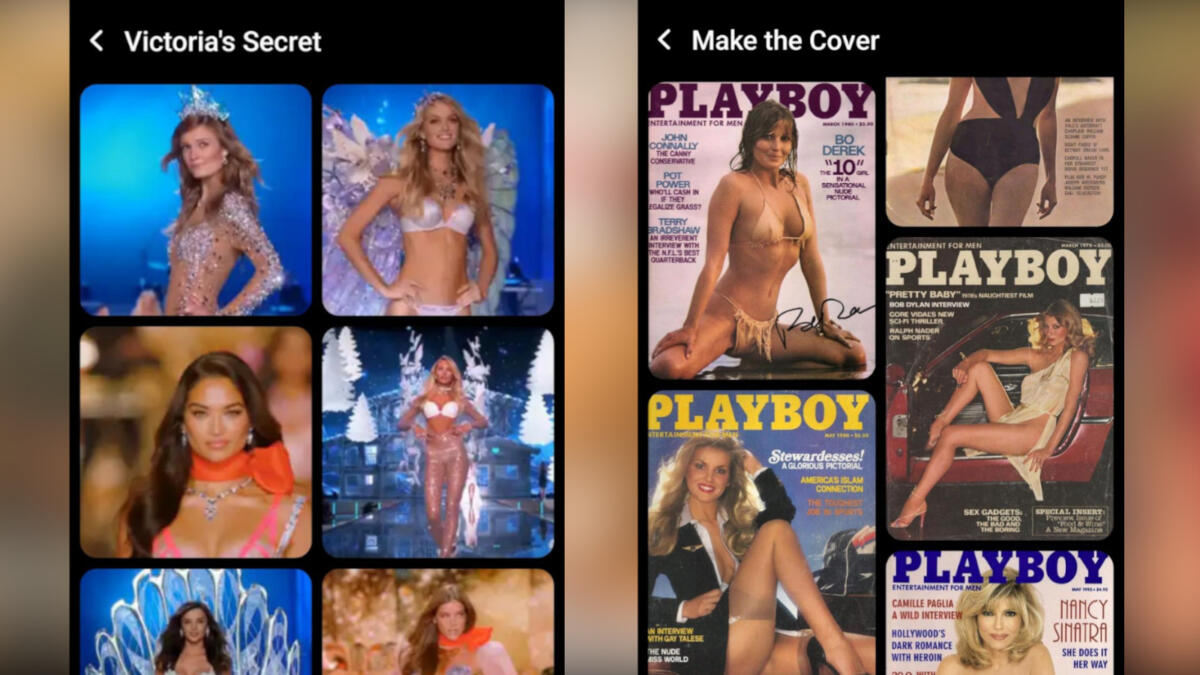

Der Konkurrent Reface verhindert so etwas. Die App scannt hochgeladene Videovorlagen automatisch – erkennt sie dabei Nacktheit, wird kein Deepfake erstellt. Dennoch ermöglicht auch Reface sexualisierte Deepfakes. Wer die App öffnet, bekommt Videoclips angezeigt, Vorlagen für eigene Deepfakes. Unter der Überschrift „Trending“ sehen Nutzer:innen im August etwa Vorlagen, um fremde Gesichter auf Cover des Erotik-Magazins Playboy zu platzieren. Die dritte untersuchte App, FacePlay, schlägt unter anderem Clips mit Bikini-Models vor.

FaceMagic äußert sich nur anonym zu den Vorwürfen

Wir haben der Beratungsstelle HateAid die Ergebnisse der Recherche vorgelegt. „Wir sind sehr besorgt“, schreibt HateAid-Juristin Josephine Ballon. „Die Tatsache, dass Deepfakes der breiten Masse auf diese Weise zugänglich werden, birgt aus unserer Sicht diverse Gefahren.“ Deepfakes könnten Betroffene psychisch und gesellschaftlich belasten. „Vor allem Frauen sind hier besonders im Fokus.“

Das Team hinter FaceMagic schreibt auf Anfrage, es würde das Hochladen pornografischer Inhalte weder erlauben noch dazu ermutigen oder es befürworten. „Nutzer:innen sollten für die von ihnen hochgeladenen und produzierten Inhalte verantwortlich sein.“ Die E‑Mail kam von einer Sammeladresse und wurde nicht namentlich unterzeichnet. Es ist unklar, wer sie verfasst hat. Auch auf unsere direkte Nachfrage hin wollte die Person ihre Identität nicht offenlegen.

iOS-Hersteller Apple teilt mit, im App Store habe man noch nie Pornografie zugelassen. Zu einzelnen Apps wie etwa FaceMagic wollte sich der Sprecher nicht äußern. Google hat auf unsere Fragen bloß mit einem Link zu den eigenen App-Richtlinien reagiert.

Deepfake-Pornos millionenfach geklickt

Seit einigen Jahren berichten auch große Nachrichtenmedien über Deepfakes. Häufig geht es dabei um die Sorge, dass Deepfakes für politische Desinformation genutzt werden könnten. Was, wenn ein gefälschter Präsident Unfug über einen Krieg verkündet?

Deutlich seltener sind Berichte über sexualisierte Deepfakes. Dabei lässt sich die Szene in Echtzeit beobachten. In teils öffentlichen Foren tüfteln Nutzer:innen daran, Menschen möglichst realistisch in pornografische Bilder und Videos zu montieren. Ihre Kreationen werden teils millionenfach abgerufen.

Die Technologie selbst ist nicht verwerflich. Wenn alle Beteiligten zustimmen, können Deepfakes ein kreatives Stilmittel sein. Der Knackpunkt ist, ob eine Person überhaupt in einem Deepfake auftauchen möchte. Eine Frage, die in den Foren für Deepfake-Pornos offenbar keine Rolle spielt. Ohne Einverständnis erstellte Deepfakes können eine enorme Belastung sein, wie Josephine Ballon erklärt – und eine Straftat, beispielsweise eine Verleumdung.

Wenn Deepfakes beim Arbeitgeber landen

Ein Deepfake mit einem Hardcore-Porno hat wohl eine andere Dimension als ein Bikini-Deepfake. Beides kann für Betroffene jedoch psychische und gesellschaftliche Folgen haben, wie Ballon erklärt. Es möchte eben nicht jeder freizügige Bilder von sich veröffentlichen. Selbst wenn ein Deepfake nicht den eigenen Körper zeigt – Betroffene könnten dadurch in der Öffentlichkeit bloßgestellt werden. Die Bilder könnten sich rasend schnell verbreiten.

„Wir haben Fälle gesehen bei denen die Betroffenen von den Bildern erfuhren, nachdem der Arbeitgeber kontaktiert wurde“, sagt Ballon. Das sei demütigend. Man wisse nie, ob jemand die Deepfakes vielleicht doch für echt hält. Ballon sagt, auch heutzutage müssten Frauen negative Reaktionen fürchten. Beispiele dafür sind der Freundeskreis, die Familie, der Job. Noch Jahre später könnten die Aufnahmen auftauchen, „wenn sich die Frau für einen Job bewirbt oder ein*e neue*n Partner*in kennenlernt“. Es könne auch sein, dass die eigenen Kinder oder Eltern sie im Netz finden.

Viele Fälle dieser Art gebe es in der Beratung von HateAid jedoch nicht. „Insgesamt müssen wir hier ebenfalls von einer hohen Dunkelziffer ausgehen, weil die Schamgrenze enorm hoch ist“, sagt Ballon.

FaceMagic: Deepfake-Pornos aus dem Google Play Store

Nicht für „illegale Zwecke“ nutzen: Diese Warnung zeigt die App FaceMagic an, bevor man mit ihr ein Deepfake-Video erstellt. Ausführlicher wird es im Kleingedruckten. Laut Nutzungsbedingungen dürfen FaceMagic-Nutzer:innen nichts hochladen, was „diffamierend, obszön, beleidigend, (…) pornografisch unanständig“ oder „belästigend“ ist.

Wirksam überprüft wird das offenbar nicht. Wie unsere Recherche zeigt, ist es Mitte August problemlos möglich, mit FaceMagic einen Deepfake-Porno zu erstellen. Dafür braucht es jedoch einen Premium-Account für rund 10 Euro im Monat. Wie das US-Magazin VICE berichtet, soll FaceMagic auf Pornoseiten damit geworben haben, dass die App Deepfake-Pornos erstellen könne. FaceMagic widerspricht: „Wir haben niemals selbst für Pornografie geworben oder eine Werbe- oder Personalagentur dazu ermächtigt.“

Ungeachtet dessen wird FaceMagic offenbar für Pornos genutzt. Auf der eingangs genannten Plattform für Deepfake-Pornos gibt es nicht nur den euphorischen Erfahrungsbericht von I. über FaceMagic. Auch zwei Deepfake-Pornos sind mit FaceMagic getaggt. Beide wurden mehr als zehntausend Mal abgerufen. „Die FaceMagic-App ist die beste aller Zeiten“, steht unter einem der Videos.

Werbeclips mit Striptease-Szene

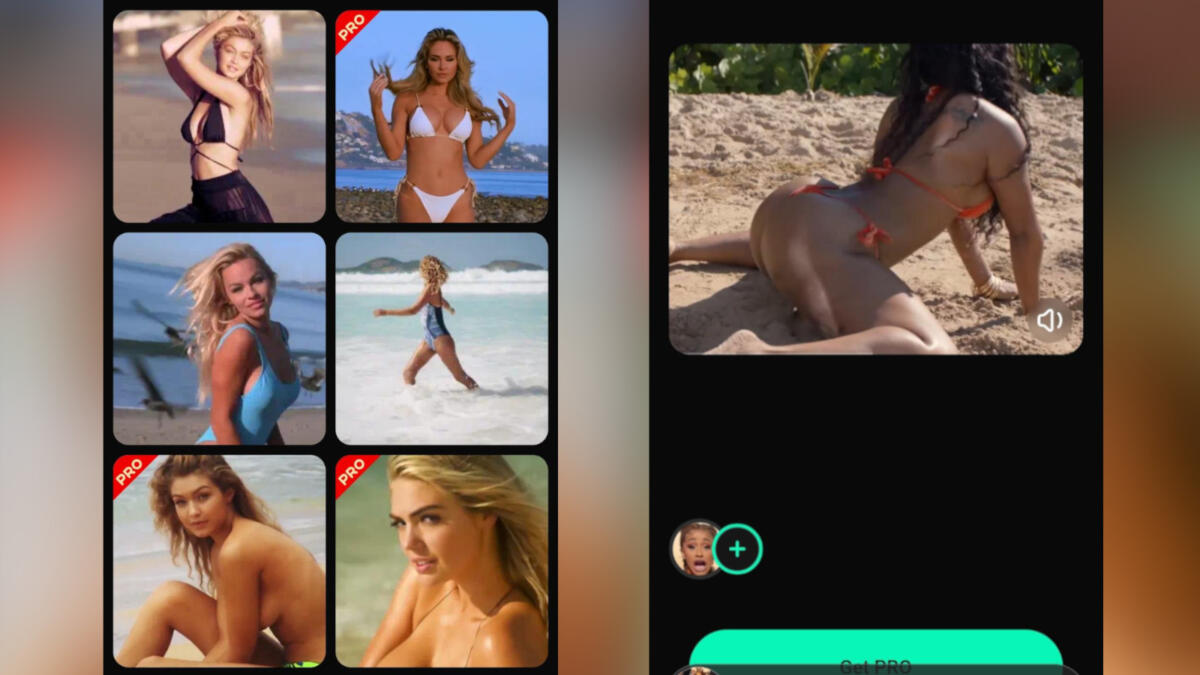

Darüber hinaus bietet FaceMagic Videovorlagen für mögliche Deepfakes an. Darunter waren bei unserem Test der App auch eine twerkende Rapperin und ein Oben-Ohne-Model am Strand. FaceMagic teilt mit, Videovorlagen in der App würden teils von Nutzer:innen erzeugt, allerdings vom Inhalte-Team überprüft.

In öffentlich einsehbaren Werbeclips führt FaceMagic selbst vor, wie sich die App für sexualisierte Deepfakes einsetzen lässt. Sie wurden auf dem YouTube-Kanal „FaceMagic“ hochgeladen. Ein Clip zeigt einen Striptease aus einem Kinofilm. Ein anderer hat den Titel: „Upload anything, deepfake anyone“ – alles hochladen, alle deepfaken.

Ein dritter Clip zeigt einen Chatverlauf, in dem ein FaceMagic-Nutzer seinem Kumpel einen Deepfake schickt. Darin posiert eine Darstellerin im Pool, offenbar nackt, das Wasser steht ihr bis zu den Schlüsselbeinen. Die Frau hat aber nicht ihr eigenes Gesicht, sondern das des Kumpels. „Ich bin sprachlos“, schreibt der Kumpel. „Kannst du auch das Gesicht meiner Freundin montieren?“

Die flüchtige Szene stellt es als alltäglich dar, dass Männer ohne Einverständnis sexualisierte Deepfakes von Frauen erstellen und untereinander tauschen. Das Einverständnis der Freundin wird in dem Clip nicht einmal thematisiert. Nachdem wir FaceMagic auf diesen YouTube-Clip angesprochen haben, war er plötzlich offline.

Hinter FaceMagic steckt Firmengruppe aus Hongkong

Auf den ersten Blick ist nicht ersichtlich, in welchem Land die Firma hinter FaceMagic ihren Sitz hat. Als Betreiberin im Google Play Store ist eine Firma namens „Insight Technology LTD“ verzeichnet, im App Store eine „Deepart Limited“. Doch die populäre Deepfake-App kommt nicht etwa aus dem Silicon Valley, sondern aus Hongkong.

„Insight Technology LTD“ ist schlicht der neue Name der „Deepart Limited“, wie aus Berichten chinesischer Wirtschaftsportale hervorgeht. Die Betreiber-Firma von FaceMagic gehört einem Geschäftsbericht zufolge über ein weiteres Tochterunternehmen zum Hongkonger Konzern „Shenzhen Xinguodu Co“. Im Geschäftsbericht wird FaceMagic ausdrücklich erwähnt, und zwar als erfolgreiches Produkt für Überseemärkte.

Andere Produkte aus dem Portfolio der Firmengruppe sind elektronische Bezahlgeräte, die unter dem Namen Nexgo vertrieben werden. Kund:innen können mithilfe von Nexgo-Geräten nicht nur mit ihrer Kreditkarte zahlen, sondern auch mit ihrem Gesicht. Die Firmengruppe setzt Biometrie also nicht nur für Deepfakes ein. Das FaceMagic-Team bestätigt auf Nachfrage, dass sie zur selben in Hongkong ansässigen Firmengruppe wie Nexgo gehören. Verwaltung und Betrieb der beiden Firmen seien nicht miteinander verbunden. Von Gesichtserkennung in Nexgo-Produkten wisse man nichts.

Privacy International äußert Bedenken zu FaceMagic

Wer mit FaceMagic zum Spaß Deepfakes erstellt, lädt Porträtfotos hoch und schickt der App damit auch biometrische Daten. Wie sicher ist es, diese Daten preiszugeben? Immerhin werden die Grundrechte in der Sonderverwaltungszone zunehmend auf Druck der autoritären Regierung in China abgebaut.

Wir haben Privacy International um eine Einschätzung gebeten. „Die Erhebung biometrischer Gesichtsdaten sollte nicht auf die leichte Schulter genommen werden“, schreibt ein Sprecher. Laut Datenschutzbestimmungen verwendet FaceMagic Daten zwar nur für die Funktionen der App. Privacy International gibt allerdings zu bedenken, dass außerhalb der EU weniger hohe Standards für Datenschutz gelten.

„Unternehmen können der Willkür autokratischer Regierungen ausgeliefert sein, die beschließen könnten, die von den Unternehmen gesammelten Daten abzugreifen“. Nutzer:innen könnten zurecht davon abgeschreckt werden, einem undurchsichtigen Unternehmen ihre Daten anzuvertrauen.

FaceMagic teilt mit, man erfülle die Richtlinien der App-Marktplätze von Google und Apple. Falls die Regierung von Hongkong die Herausgabe von Daten verlange, halte man sich an die gesetzlichen Bestimmungen. Unsere Frage, ob und wie oft das bereits passiert sei, blieb unbeantwortet.

FacePlay: Eigene Kategorie für Bikini-Deepfakes

Zumindest Hinweise auf eine Verbindung zu China gibt es auch bei der Deepfake-App FacePlay. Sie wurde mehr als 10 Millionen Mal im Google Play Store heruntergeladen. Einige Bereiche der App sind auf Chinesisch. Innerhalb der App wird eine WhatsApp-Gruppe für interessierte Nutzer:innen beworben. Die Admins der Gruppe haben Telefonnummern mit einer chinesischen Vorwahl.

Unsere per E‑Mail verschickten Fragen zur Herkunft der App hat FacePlay nicht beantwortet. Falls FacePlay tatsächlich aus China kommt, würden auch auch auf diese App die Datenschutz-Bedenken zutreffen, die Privacy International über FaceMagic geäußert hat.

Im Gegensatz zu FaceMagic bietet FacePlay nicht die Möglichkeit, eigene Videovorlagen für Deepfakes hochzuladen. Nutzer:innen müssen sich an einer Reihe vorgeschlagener Clips bedienen. Die Clips sind in Kategorien unterteilt. Eine dieser Kategorien heißt „Swimsuit“ und zeigt Bikini-Models.

Bei FacePlay dürfte es jedoch nicht erlaubt sein, daraus Deepfakes ohne Einverständnis zu erstellen, denn laut Nutzungsbedingungen untersagt sind unter anderem „anstößige“ und „herabwürdigende“ Inhalte, die möglicherweise einer Person „unangenehm“ sind. FacePlay hat sich nicht zu den Videovorlagen geäußert.

Reface: Gesichter aufs Playboy-Cover montieren

Eine Konkurrenz zu FaceMagic und FacePlay ist die App Reface. Sie wurde mehr als 100 Millionen Mal heruntergeladen und ist damit die populärste der drei untersuchten Apps. Das Entwicklerteam stammt aus der Ukraine und bloggt darüber, was es bedeutet, während des Angriffskriegs durch Russland eine Deepfake-App zu betreiben.

Auch Reface war schon Thema im Forum für Deepfake-Porno-Fans. Ende 2020 beschwert sich ein Nutzer, dass er mit Reface keine Pornos mehr erstellen kann. „Um ehrlich zu sein, das war die beste App, die ich je getestet habe, und sie hatte funktioniert“, schreibt er betrübt. Ob diese Aussage stimmt, konnten wir nicht überprüfen. Reface schreibt, man habe nicht-einvernehmliche Deepfakes von Anfang an „sehr ernst“ genommen.

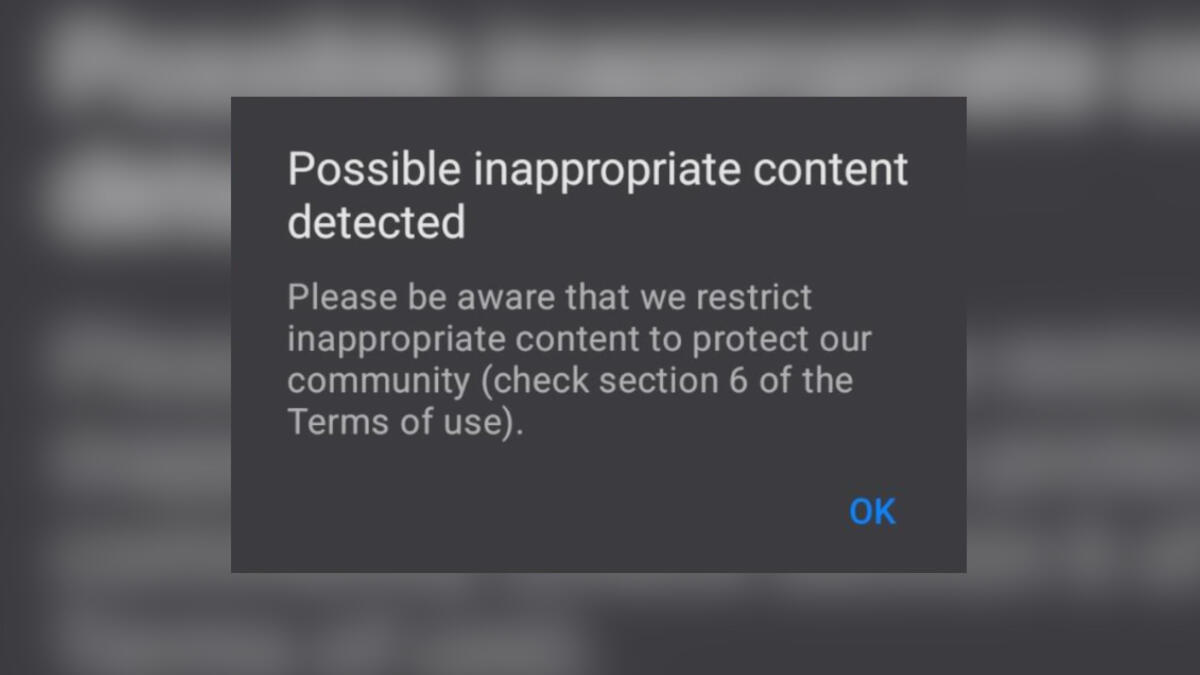

Möchte man heute mit Reface einen Porno erstellen, erscheint ein Hinweis: „Möglicherweise unangemessener Inhalt entdeckt“. Einen Deepfake erstellt die App dann nicht. Auf Anfrage erklärt eine Sprecherin: Wer mehrfach versuche, Pornos mit Reface zu generieren, werde gebannt.

In den Richtlinien von Reface steht unter anderem, „nicht-einvernehmliche sexuelle Bilder” seien nicht erlaubt. Dabei präsentiert Reface Nutzer:innen selbst sexualisierte Vorlagen für Deepfakes. Unter der Überschrift „Trending“ sind das etwa Cover des Erotik-Magazins Playboy. Es gibt auch eine Kategorie an Deepfake-Vorlagen mit Unterwäsche-Models der Marke Victoria’s Secret.

Diese Bilder sind zwar jugendfrei, aber durchaus sexualisiert. Ohne Einverständnis der gezeigten Personen können auch sie unter bildbasierte Gewalt fallen. Das heißt, Menschen können damit andere herabwürdigen und Macht über sie ausüben. Ist das im Sinne von Reface? Eine Sprecherin erklärt, Videovorlagen aus der App würden auch aus externen Quellen stammen. Nur ein Teil werde von Reface selbst entworfen. Um problematische Inhalte zu entfernen, würden Vorlagen auf Nacktheit gescannt; außerdem könnten Nutzer:innen Inhalte melden.

Auch Darsteller:innen werden nicht gefragt

In Berichten über Deepfake-Pornos wird eine Personengruppe oft vergessen. Bei dem Thema geht es nicht nur um die Produzent:innen der Clips oder um die Menschen, deren Gesichter montiert werden. Es gibt auch noch die Darsteller:innen aus den Videovorlagen. Auch sie haben nicht unbedingt zugestimmt, ihren Körper für Deepfakes herzugeben. Was bedeutet das für betroffene Porno-Darsteller:innen, deren Aufnahmen beispielsweise mit FaceMagic bearbeitet werden können?

Einerseits könnten Deepfakes für Porno-Darsteller:innen ein finanzielles Problem darstellen, schreibt Yigit Aydin, Sprecher der European Sex Workers’ Rights Alliance (ESWA). Darsteller:innen verdienen oft ihr Geld mit kostenpflichtigen Inhalten hinter Paywalls. „Wenn es viele kostenlose Deefakes gibt, möchten Kund:innen möglicherweise nicht für exklusive Inhalte zahlen“, schreibt Aydin.

Das Problem sei aber nicht nur finanziell. Auch Sexarbeiter:innen wünschen und erwarten Privatsphäre, wie Aydin erklärt. „Es ist immer belastend und manchmal traumatisierend, wenn man feststellt, dass die eigenen Daten ohne Zustimmung entwendet und genutzt wurden“. Es sei noch nicht oft Thema bei ESWA gewesen, schreibt Aydin, aber: „Deepfakes haben das Potenzial, Sexarbeiter:innen emotional zu verletzen, genauso wie andere Menschen.“

Für den SPIEGEL recherchierte Theresa Locker.