Sollen in Europa demnächst Kameras hängen, die eine Person an ihrem Gesicht oder ihrem Gang erkennen? Sollen Behörden zumindest mitteilen müssen, wenn sie sich auf automatische Entscheidungen stützen, um Sozialleistungen zu verteilen? Darüber entscheidet in den kommenden Monaten die EU mit dem größten Vorstoß dieser Art, den sie bisher gewagt hat. Nach Jahren der Vorbereitung bewegt sich der AI Act, der den Einsatz von solchen und anderen hochriskanten Systemen regulieren soll, in Richtung Zielgerade. Die Kommission hat ihren Vorschlag bereits vorgelegt, Parlament und Rat stimmen sich derzeit ab.

Wie genau die Regeln am Ende ausfallen werden, dabei hat Deutschland mehr als ein Wörtchen mitzureden. Deutschlands Stimme hat im Rat Gewicht. Noch hat die Ampelregierung die Möglichkeit, sich zu einzelnen Punkten im geplanten Gesetz zu äußern und sie gar zu verhindern.

Doch in der Stellungnahme, die vor Kurzem aus Deutschland an die französische Ratspräsidentschaft ging, tauchen die kritischsten Punkte – etwa biometrische Erkennung im öffentlichen Raum oder Social Scoring – gar nicht auf. Die EU-Kommission bat zunächst offenbar nur zu anderen, weniger kritischen Abschnitten um Kommentare. Das geht aus einem Entwurf der deutschen Stellungnahme hervor, den wir veröffentlichen. Ob die heiklen Punkte nicht zur Sprache kamen – oder bislang schlicht geheim geblieben sind – ist unklar.

Rat verhandelt hinter verschlossenen Türen

In einer Sitzung des Digitalausschusses im Bundestag Mitte März hatte ein Vertreter des Justizministerium schon formuliert, wo Deutschland in diesen Fragen steht: Deutschland plädiere bei den Verhandlungen für einen kompletten Ausschluss von Methoden wie Videoüberwachung mit automatisierter Gesichtserkennung im öffentlichen Raum.

Im AI Act sind derzeit Ausnahmen vorgesehen, die den Einsatz dieser Verfahren für bestimmte Zwecke – etwa zur Verhinderung von Terroranschlägen oder zur Suche nach Täter:innen, die per europäischem Haftbefehl gesucht werden – erlauben würden. Mitgliedstaaten bekämen die Option, das in ihren nationalen Gesetzen zuzulassen. Das heißt Deutschland könnte dann entscheiden, solche Verfahren nicht einzusetzen – Polen oder Ungarn aber schon.

Ein weiteres Problem: Die Verbote beziehen sich nur auf Systeme, die in Echtzeit arbeiten. Programme, die auf zuvor aufgezeichneten Aufnahmen automatisiert nach Personen fahnden, wären demnach weiter erlaubt.

Wenn Deutschland sich tatsächlich für einen kompletten Ausschluss einsetzt, dann steht das womöglich in einer anderen Stellungnahme. In Artikel 5 werden die relevanten Passagen festgezurrt. Die Verhandlungen im Rat selbst passieren hinter verschlossenen Türen. Die Sitzungen der Ratsarbeitsgruppen sind nicht öffentlich, der Lauf der Verhandlungen damit kaum transparent.

Eine Sprecherin des für die Verhandlungen verantwortlichen Wirtschaftsministeriums bestätigte, dass die Regierung die deutsche Teilstellungnahme am 16. März an die französische Ratspräsidentschaft übersandt hat. Weitere Inhalte wollte sie nicht kommentieren, es handele sich um einen laufenden Verhandlungsprozess.

Nach den Zielen der Ampel gefragt verwies sie stattdessen auf den Koalitionsvertrag. Dort steht: „Biometrische Erkennung im öffentlichen Raum sowie automatisierte staatliche Scoring Systeme durch KI sind europarechtlich auszuschließen.“ Zudem finde sich im Kapitel „Freiheit und Sicherheit“ folgender Abschnitt: „Flächendeckende Videoüberwachung und den Einsatz von biometrischer Erfassung zu Überwachungszwecken lehnen wir ab. Das Recht auf Anonymität sowohl im öffentlichen Raum als auch im Internet ist zu gewährleisten.“

Eigene Datenbank für öffentliche Verwaltung

Bemerkenswerte Kritik zum Entwurf hat die Bundesregierung aber durchaus. So beginnt ihre Stellungnahme gleich mit dem Hinweis, der AI Act sei in seiner jetzigen Form zu sehr auf die Privatwirtschaft zugeschnitten und eigne sich kaum dazu, auch die öffentliche Verwaltung zu regulieren. Gerade für diese Behörden, die sich um Sicherheit, Migration, Asyl oder Steuern kümmern, sei es aber besonders wichtig, eine „rasche und zeitgleiche Regulierung von KI-Systemen“ zu schaffen.

„Grundsätzlich möglich wäre daher ein separater, eigenständiger Technologienrechtsakt zur Regelung von KI-Systemen der genannten Behörden“, schlägt die Stellungsnahme vor. „Dieser wäre dann rasch und zeitgleich zum bereits vorliegenden Entwurf der KI-Verordnung zu entwickeln und zu verhandeln.“

Bemerkenswert ist noch eine weitere Forderung in diesem Zusammenhang. Unabhängig von einem möglichen Zusatzgesetz fordert Deutschland eine öffentliche Datenbank für alle KI-Systeme, die von öffentlichen Stellen eingesetzt werden. Zum öffentlichen Sektor zählen die Bundes- und Landesregierungen oder Gemeinden, aber auch etwa Krankenversicherer oder Sozialbehörden. Dieser öffentliche Sektor trage eine besondere Verantwortung und habe Zugang zu besonders sensiblen Daten, heißt es zur Begründung. Daher müssten hier auch höhere Anforderungen an die Transparenz gelten. Registriert werden sollen deshalb nicht nur Systeme, die als hochriskant gelten, sondern ausnahmslos alle Systeme, die zum Einsatz kommen. Betroffene sollen nicht nur erfahren können, wo KI-Systeme eingesetzt werden, sondern auch, zu welchem Zweck.

NGOs: Bisherige Pläne reichen nicht

Bislang plant die Kommission solch eine Datenbank lediglich für Systeme, die laut dem geplanten Gesetz als hochriskant eingestuft werden. Darunter fallen zum Beispiel Verfahren, die automatisch die Kreditwürdigkeit einer Person bewerten sollen oder in Bewerbungsverfahren eingesetzt werden, aber auch solche zur biometrischen Identifikation oder zur vorhersagenden Polizeiarbeit.

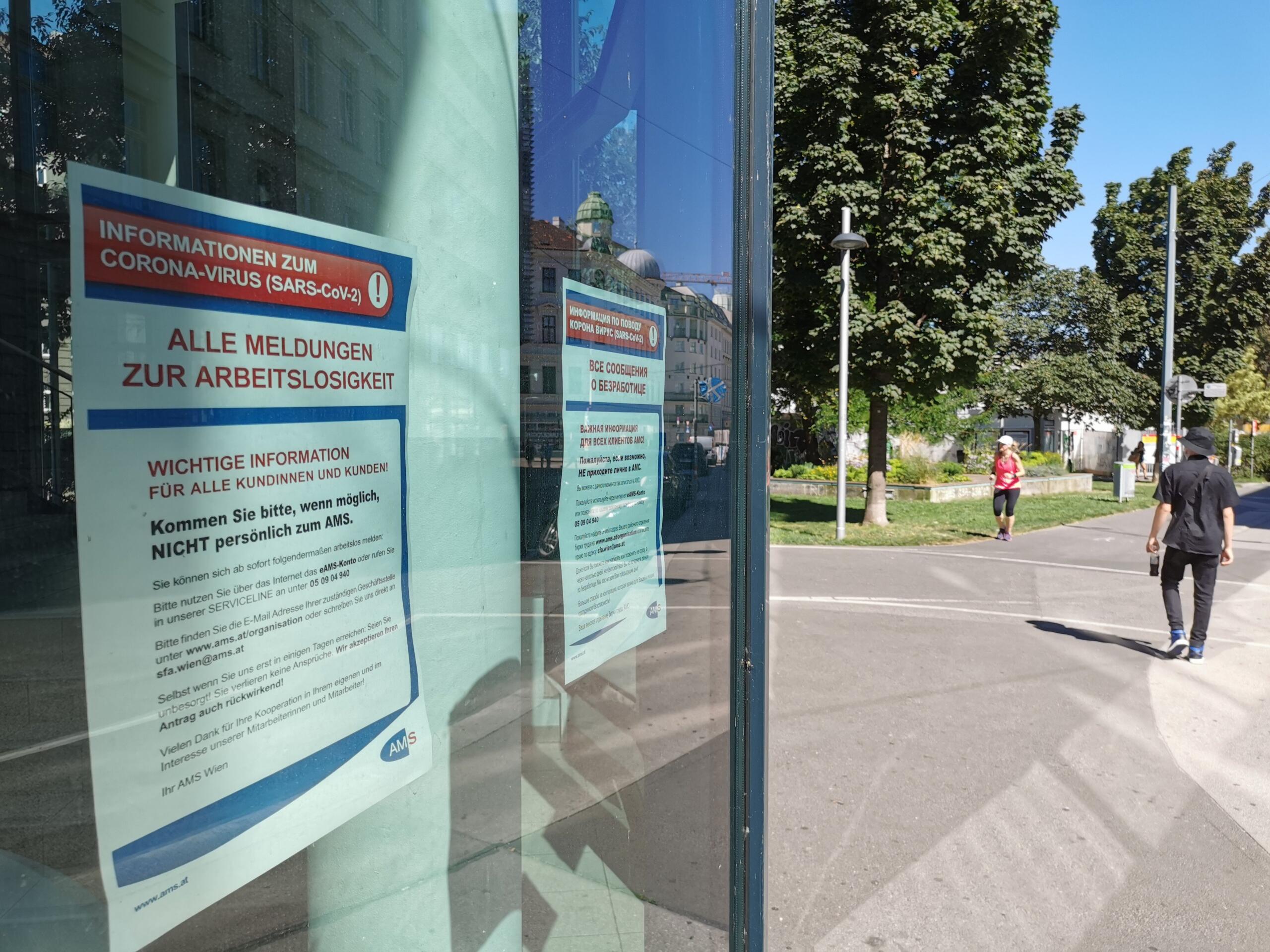

Menschenrechtsorganisationen wie AlgorithmWatch kritisieren jedoch, dass die Pläne in ihrer jetzigen Form nicht ausreichten, um Bewohner:innen der EU vor Profilerstellung und Diskriminierung zu schützen. Gerade im öffentlichen Sektor flogen zuletzt mehrere Skandale um automatisierte Entscheidungen auf. In den Niederlanden etwa musste Anfang 2021 die Regierung zurücktreten. Behörden hatten jahrelang automatisch nach Sozialbetrug gefahndet und zu unrecht Kindergeld von Bürger:innen zurückgefordert – besonders solchen mit doppelter Staatsbürgerschaft. Österreich streitet seit Jahren über ein System, das die Chancen von Arbeitssuchenden auf dem Jobmarkt vorhersagen soll und dabei systematisch Frauen, Mütter und alte Menschen benachteiligt.

In diesen und anderen Fällen, mahnen die Organisationen, würde der AI Act in seiner jetzigen Form auch nichts bringen. Auch Mitglieder der EU-Parlaments bezeichneten die jetzige Lösung als unzureichend. Das Parlament verständigt sich derzeit noch auf seine finale Position.

Muss das BAMF seine Dialekterkennung auflisten?

In Deutschland würden diese neue Regeln womöglich auch das Bundesamt für Migration und Flüchtlinge (BAMF) betreffen. Es setzt seit Jahren eine Software zur Sprach- und Dialekterkennung in Asylverfahren ein, die hohe Fehlerquoten aufweist. Der Einsatz eines solchen Systems zur Überprüfung von Asylanträgen zählt laut dem Verordnungsentwurf der Kommission als hochriskant.

Doch das BAMF wird seine Systeme vermutlich trotzdem nicht im geforderten Register offenlegen müssen, selbst wenn sich die Bundesregierung mit ihrem Vorschlag durchsetzt in Brüssel. Denn laut dem Kommissionsentwurf beziehen sich die Regeln nur auf neue Systeme, die ab einem noch zu definierenden Datum eingesetzt werden. Bereits im Einsatz befindliche Technologien fielen damit durch die Lücken der Verordnung – egal wie riskant sie für die Grundrechte sind. Dieser Interpretation folgt auch eine Antwort der Bundesregierung auf eine Anfrage, die ein Abgeordneter der Linken kürzlich stellte.

Mehr Transparenz für hochriskante Systeme

Deutliche Nachschärfungen fordert die Bundesregierung auch an anderen Stellen, vor allem zu den Transparenzpflichten. Geplant ist bisher: Wer ein System für die Emotionserkennung oder biometrische Kategorisierung einsetzt, der soll Nutzer:innen darauf hinweisen müssen. Auch für den Einsatz von Deepfakes, manipulierten Bildern, soll die Regel gelten.

Die Bundesregierung fordert, diese Transparenzpflichten auszuweiten: auf alle als hochriskant eingestuften Systeme. Auch in diesen Fällen sollten alle, die solche Systeme für eine Entscheidung einsetzen, Nutzer:innen darüber informieren müssen: Welchen Zweck verfolgt das System, welche Daten dienen als Grundlage der Entscheidung? Personen sollen auch eine Erklärung zu Entscheidungen einfordern können, die sie betreffen. Das würde zum Beispiel Personen betreffen, deren Kredite aufgrund von automatisierten Entscheidungen abgelehnt wurden oder denen bestimmte Leistungen verweigert würden.

Eigentlich sehen die Datenschutzregeln der EU (DSGVO) in solchen Fällen schon bestimmte Rechte für Personen vor, deren Daten für eine Entscheidung „verarbeitet“ werden. Allerdings gelten diese nur im Fall vollautomatischer Entscheidungen. Sobald ein Mensch bei der Entscheidung dazwischen geschaltet ist, sind die Regeln hinfällig – ein Schlupfloch, auf das Fachleute seit Jahren hinweisen. Die Bundesregierung fordert nun, dass die Regeln auch dann gelten sollten, wenn eine Entscheidung nur teilweise von den Berechnungen eines automatisierten Systems beeinflusst wurde. Es wäre ein kleiner Unterschied mit einer großen Wirkung.

Was will der AI Act?

Der Vorschlag der EU-Kommission für den AI Act definiert Vorgaben für den Einsatz von KI-Systemen und automatisierten Entscheidungen, die als hochriskant gelten und verbietet bestimmte „inakzeptable“ Einsatzbereiche. Darunter fallen etwa das so genannte Social Scoring durch Behörden oder Systeme, die die Schwächen von Kindern ausnutzen, um diesen zu schaden.

Auch die biometrische Fernüberwachung im öffentlichen Raum gilt grundsätzlich als „inakzeptabel“. Allerdings definiert der Entwurf hier bestimmte Ausnahmen zum Zweck der Strafverfolgung oder bei der Suche nach vermissten Kindern. Hier sollen EU-Mitgliedsstaaten die Option bekommen, solche Systeme in ihren nationalen Gesetzen zuzulassen, wenn sie das wollen.

Interessant wird vor allem, wie Deutschland sich in diesem Punkt positioniert. Ist es den Ampelparteien wirklich ernst mit ihrer Haltung, dass diese Verfahren in der EU nicht zugelassen werden sollen, dann müssten sie sich für ein komplettes Verbot einsetzen – nicht nur in Deutschland, sondern EU-weit. Die Option müsste dann aus dem Entwurf der Kommission rausverhandelt werden.

Update vom 6. April 2022: Der Verweis auf AlgorithmWatch wurde nachträglich hinzugefügt.