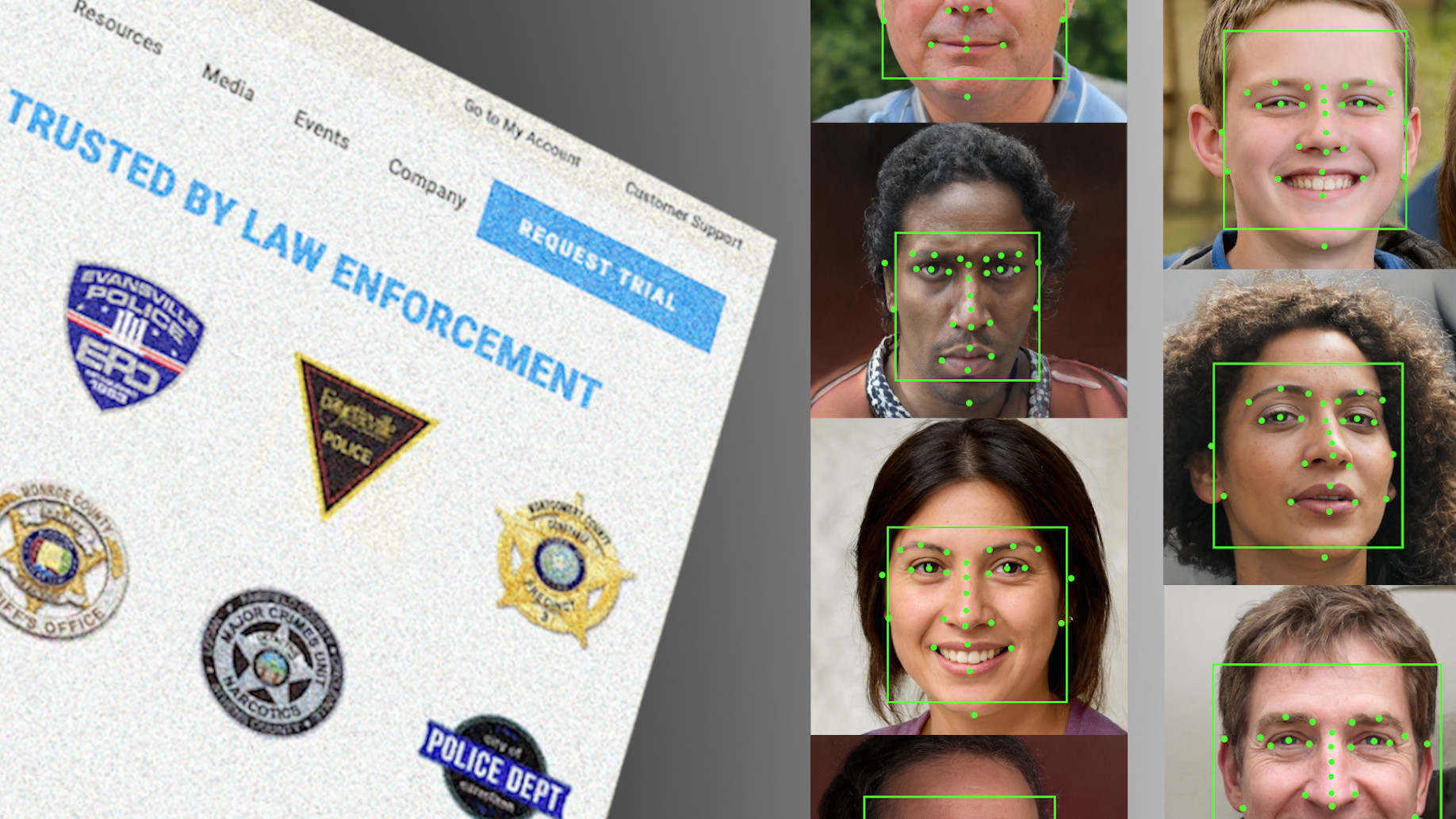

Nach Australien zeigt nun auch Großbritannien klare Kante gegen Clearview AI. Das Unternehmen betreibt eine kostenpflichtige Gesichtersuchmaschine für Ermittlungsbehörden. Nun soll Clearview AI die Daten von Menschen aus Großbritannien löschen und keine neuen erheben. Das geht aus einer vorläufigen Mitteilung der britischen Datenschutzbehörde hervor. Demnach drohe Clearview AI eine Strafe von umgerechnet 20 Millionen Euro.

Auch die Datenschutzbehörde in Australien hat Clearview AI Anfang November aufgefordert, die Daten australischer Bürger:innen zu entfernen. Die Forderungen sind eine neue Stufe der Eskalation in der internationalen Kritik an der Gesichtserkennungssoftware.

In Deutschland hatte sich bisher der Hamburger Datenschutzbeauftragte durch Widerstand gegen Clearview AI hervorgetan. Recherchen von netzpolitik.org zufolge hat das Unternehmen inzwischen jedoch wenig von deutschen Datenschützer:innen zu befürchten. Dazu später mehr.

„Unangemessener Eingriff in die Privatsphäre“

Clearview AI hat laut eigener Website mehr als 10 Milliarden Bilder von Menschen aus dem Internet erfasst. Die Einschätzung der Datenschützer:innen in Australien ist deutlich: Clearview AI habe die Privatsphäre der Australier:innen verletzt. Die verdeckte Sammlung dieser Art von sensiblen Informationen sei ein „unangemessener Eingriff und unfair“, sagt die australische Datenschutzbeauftragte, Angelene Falk. „Sie birgt ein erhebliches Risiko, Einzelpersonen zu schaden, einschließlich schutzbedürftiger Gruppen wie Kindern und Opfern von Straftaten, deren Bilder in der Datenbank von Clearview AI durchsucht werden können.“ Falk sieht in der Datenbank von Clearview AI zudem die Gefahr von Identitätsdiebstahl und falschen Zuordnungen.

Die britische Datenschutzbeauftragte Elizabeth Denham sagt: „Ich habe erhebliche Bedenken, dass personenbezogene Daten in einer Weise verarbeitet wurden, die niemand in Großbritannien erwartet hätte“. Die von der Behörde gesammelten Hinweise deuteten darauf hin, dass Clearview AI weiterhin erhebliche Mengen an Daten britischer Bürger:innen verarbeiten könnte.

Auf Anfrage von netzpolitik.org teilt eine Sprecherin von Clearview AI ein anwaltliches Statement. Demnach hält das Unternehmen die Behauptungen der britischen Datenschützer:innen für „faktisch und juristisch inkorrekt“. Clearview AI gebe öffentlich verfügbare Informationen an Ermittlungbehörden weiter, britische Kund:innen habe das Unternehmen keine. Man erwäge, gegen die Entscheidungen der Behörde vorzugehen.

Bevor die vorläufigen Maßnahmen wie etwa die Millionenstrafe greifen, kann Clearview AI noch Stellung beziehen. Mit einer Entscheidung sei erst Mitte 2022 zu rechnen, teilt die britische Datenschutzbehörde mit.

Clearview-CEO: „Es bricht mir das Herz“

Der CEO von Clearview AI, Hoan Ton-That, fühlt sich offenbar missverstanden. Ein Statement von ihm hat die Pressestelle von Clearview AI unter anderem an netzpolitik.org geschickt. Darin heißt es, Ton-That sei zutiefst enttäuscht, dass die britische Datenschutzbehörde seine „Technologie und Beweggründe“ falsch interpretiert habe.

Clearview AI solle dabei helfen, „abscheuliche“ Verbrechen zu lösen, schreibt Ton-That. Wenn britische Ermittler:innen gegen sexuellen Missbrauch von Kindern vorgehen, dürfe Clearview AI nun nichts mehr tun. „Es bricht mir das Herz.“ Gerne würde Ton-That mit führenden Köpfen und Gesetzgeber:innen über die Technologie sprechen, heißt es weiter.

Ein Gesprächsangebot, das auch netzpolitik.org aufgreifen wollte. Immerhin ist die Kritik an der Technologie in Politik und Zivilgesellschaft bekannt. Das Sammeln bereits öffentlicher Fotos aus dem Internet ist alles andere als harmlos, denn die Menschen auf den Fotos haben Rechte. Wer biometrische Daten verarbeiten will, braucht laut Datenschutzgrundverordnung (DSGVO) eine ausdrückliche Einwilligung. Die Arbeit an einer Suchmaschine, die weltweit Personen per Schnappschuss identifizieren kann, käme zudem einer Abschaffung der Anonymität im öffentlichen Raum gleich.

In einer E‑Mai haben wir etwa gefragt, wie Ton-That den Einsatz von Gesichtserkennung gegen Aktivist:innen, Journalist:innen und Dissident:innen bewerte. Eine weitere Frage bezog sich auf seine Sicht zum rassistischen Bias von Gesichtserkennung, der dazu führen kann, dass Unschuldige verdächtigt werden. Die Fragen blieben unbeantwortet.

Deutsche Betroffene müssen sich einzeln beschweren

Noch im August 2020 hatte der damalige Hamburger Datenschutzbeauftragte Johannes Caspar Clearview AI scharf kritisiert. Er schrieb von „düsteren digitalen Dystopien“ und sah darin eine „kaum mehr kontrollierbare Form der Herrschaft über Menschen“. Offenbar hatte die Firma auf Rückfragen der Behörde nicht zufriedenstellend reagiert, denn die Hamburger Datenschützer:innen drohten mit Strafen: Bis zu 170.000 Euro Zwangsgeld, falls Clearview AI die siebzehn Fragenkomplexe nicht umfassend beantworte.

Vorangetrieben wurde die Debatte in Deutschland durch den Fall des Informatikers Matthias Marx. Er ist selbst gegen seinen Willen in der biometrischen Datenbank von Clearview AI gelandet und hat den Hamburger Datenschutzbeauftragten eingeschaltet.

Mehr als ein Jahr später ist das Fazit ernüchternd. Clearview AI hat die Fragen der Hamburger Behörde ohne Zwangsgeld beantwortet; außerdem will die Firma die biometrischen Daten von Marx gelöscht haben. Und zwar nur die von Marx. Ein Vorgehen gegen Clearview AI im Namen aller Bürger:innen – wie in Australien oder Großbritannien – wird es in Deutschland anscheinend nicht geben.

Datenschutzbehörden wiegeln ab

Ein Sprecher der Hamburger Datenschutzbehörde beschreibt gegenüber netzpolitik.org rechtliche Hürden. Sie drehen sich um regionale Zuständigkeiten. Seine Behörde sei nur für Betroffene mit Wohnort in Hamburg zuständig. Wo die erfassten Personen genau wohnen, dürfte Clearview AI nicht unbedingt bekannt sein. Das Problem wiederholt sich auf EU-Ebene: Jedes Land hat seine eigene Datenschutzbehörde. „Nur über eine koordinierte Aktion aller oder mehrerer Aufsichtsbehörden in Europa wäre ein gemeinsamer Vollzug möglich“, schreibt der Sprecher der Hamburger Behörde.

Unterm Strich heißt das: Falls Clearview AI beim Erfassen von angeblich 10 Milliarden Online-Fotos weitere Deutsche erfasst hat, dann müssten die sich wohl selbst beschweren – einzeln. Das könne kaum im Interesse der Behörden sein, sagt Matthias Marx im Gespräch mit netzpolitik.org. Clearview AI habe nicht einmal ein Verbot, andere, neue Bilder von ihm zu verarbeiten. „Die DSGVO ist noch jung, vielleicht betreten wir auch juristisches Neuland“, sagt Marx. Vonseiten der Hamburger Datenschutzbehörde heißt es derweil: Aktuell seien keine weiteren Schritte wegen Clearview AI geplant.

Und auch der Bundesdatenschutzbeauftragte (BfDI) sieht im Fall Clearview AI keine Zuständigkeit. Betroffene könnten sich an die zuständigen Landesbehörden wenden, teilte ein Specher mit. Die vom BfDI beaufsichtigten Behörden würden seiner Kenntnis nach Clearview AI nicht nutzen. Außerdem schreibt der Sprecher, seine Behörde sensibiliere „immer wieder“ öffentlich dafür, „dass personenbezogene Daten im Internet von Dritten missbraucht werden können“. In der Konsquenz bedeutet das wohl: Wer Fotos von sich ins Netz stellt, ist selbst Schuld.

Aktivist:innen handeln, die EU zögert

Die Debatte um Clearview AI hat auch in der EU Fahrt aufgenommen. Im Januar 2020 erwägte die EU-Kommission kurz, automatisierte Gesichtserkennung im öffentlichen Raum vorläufig zu verbieten – ließ das Vorhaben aber wieder fallen.

Europaweit haben sich zivilgesellschaftliche Initiativen gegen Gesichtserkennung gegründet. Dazu gehört auch die Initiative Reclaim your Face, die ein Verbot von biometrischer Massenüberwachung in Europa fordert. Ein zivilgesellschaftliches Bündnis aus europäischen Datenschutzorganisationen wie noyb („none of your business“) und Privacy International hat bei Datenschutzbehörden in Frankreich, Österreich, Griechenland, Italien und Großbritannien Beschwerde eingereicht.

Die Datenschutzbehörde in Österreich hat danach ein Verfahren gegen Clearview AI eingeleitet, wie ein Sprecher auf Anfrage mitteilte. Bei der französischen Datenschutzbehörde sind einem Sprecher zufolge bereits mehrere Beschwerden wegen Clearview AI eingegangen. Wie die Behörde damit jetzt verfährt, werde noch geprüft.

Noyb hätte eine stärkere Zusammenarbeit der nationalen Aufsichtsbehörden erwartet. „Dabei hat die Tätigkeit von Clearview offenkundig europaweite Auswirkungen“, schreibt ein Sprecher. Auch wenn die meisten Verfahren noch laufen, würden sich zum Teil unterschiedliche Auslegungen der DSGVO abzeichnen.

Rückenwind bekommen die Initiativen in ihrem Kampf gegen automatisierte Gesichtserkennungstechnologien aus dem EU-Parlament. Die Abgeordneten sprachen sich Anfang Oktober mit deutlicher Mehrheit gegen den Einsatz biometrischer Massenüberwachung in der EU aus. Die Resolution des Parlaments ist aber rechtlich nicht bindend. Bisher will die EU-Kommission biometrische Gesichtserkennung nicht per se verbieten, sondern nur einschränken. Wie genau der endgültige Gesetzestext aussehen soll, handelt die EU derzeit noch aus.

Andere Länder greifen schon länger durch

Dass strenges Vorgehen gegen Gesichtserkennungssoftware möglich ist, haben andere Länder und Kommunen längst vorgemacht. Die schwedische Datenschutzbehörde hat ein Bußgeld in Höhe von 250.000 Euro gegen die örtliche Polizeibehörde verhängt, weil sie die umstrittene Gesichtserkennungssoftware unrechtmäßig eingesetzt hatte.

Als erste Stadt in den USA hat San Francisco den Einsatz von Gesichtserkennung schon 2019 verboten, Minneapolis zog Anfang des Jahres nach und verbannte die Technologie aus ihren Polizeistationen.

In den USA steht Clearview AI zunehmend in der Kritik, immer wieder gibt es Klagen gegen das Unternehmen. So läuft gerade eine Sammelklage in Illinois. Zunächst hatte das Gericht in Illinois den Antrag von Clearview AI abgelehnt, die Klage abzuweisen. Akteur:innen der Zivilgesellschaft wie die Electronic Frontier Foundation werten das bereits als Erfolg.

Seit Juli 2020 ist Clearview AI auch in Kanada tabu: Kanadische Sicherheitsbehörden dürfen die Gesichtsdatenbank nicht mehr einsetzen. Clearview AI dürfe auch keine Bilder mehr in Kanada sammeln. Der kanadische Datenschutzbeauftragte Daniel Therrien erklärte: „Was Clearview AI tut, ist Massenüberwachung – und das ist illegal.“ Zusammen mit drei weiteren kanadischen Datenschutzbeauftragten forderte er die Regierung auf, bestehende Datenschutzgesetze zu verschärfen. Die Maßnahmen der kanadischen Datenschutzbehörde wies Clearview AI bisher zurück – ihre Dienste wolle das Unternehmen in Kanada aber nicht mehr anbieten.

Ergänzungen

Wir freuen uns auf Deine Anmerkungen, Fragen, Korrekturen und inhaltlichen Ergänzungen zum Artikel. Bitte keine reinen Meinungsbeiträge. Unsere Regeln zur Veröffentlichung von Ergänzungen findest Du unter netzpolitik.org/kommentare. Deine E-Mail-Adresse wird nicht veröffentlicht.

2 Kommentare zu „Großbritannien droht Clearview mit Millionenstrafe – Deutschland drückt sich“

,

Armer kleiner Ton-That, er meint es doch so gut und wird nur missverstanden. Meint der das wirklich ernst, oder lügt er nur unverschämt? Wieder mal das Vehikel des sexuellen Missbrauch von Kindern, in dessen Namen jede noch so große Perversität gerechtfertigt ist.

Das Schadenspotenzial, das von so einer Technik ausgeht ist immens. Ganz zu schweigen davon, das wohl niemand sein Einverständnis gegeben hat, das sein Gesicht (ist schließlich etwas sehr persönliches) nach eigenem Ermessen von Fremden in beliebige Datenbanken eingespeist wird, von dem was damit passiert (und von dem keiner so genau sagen kann was das ist) ganz zu schweigen.

Nur weil irgendwo im Netz ein Bild von mir gepostet wurde (muss ich ja nicht mal selber veröffentlicht haben) bin ich doch kein Freiwild. Dem Kerl und seiner widerlichen Firma fehlt doch jegliches Verständnis dafür, was elementare und nicht verhandelbare Rechte anderer sind. Aber das scheint ihn offensichtlich nicht im geringsten zu interessieren. Von solchen Kleinigkeiten wie einem klaren Verstoss gegen die DSGVO ganz zu schweigen.

Es bleibt zu hoffen, das immer mehr Länder und Organisationen gegen den Laden vorgehen, aber auch gegen andere, die ähnliches planen oder bereits anbieten.

,

https://www.spiegel.de/netzwelt/netzpolitik/frankreich-verdonnert-clearview-ai-zu-20-millionen-euro-geldstrafe-a-f2947fd1-b219-4b35-be3f-6a403fb08a5f

»>Auf SPIEGEL-Anfrage teilte die Behörde damals mit, dass der Anspruch auf Löschung »jedem Betroffenen zusteht, dessen Daten rechtswidrig verarbeitet werden«.«<

Auch lustig, nicht etwa systematische Verstöße systematisch beheben zu wollen, die Betroffenen mögen sich bitteschön einzeln dort vor Ort melden. So klingt das zumindest. Deutschland schützt seine Bürger im Digitalen! Die Welle kann kommen…

Dieser Artikel ist älter als 4 Jahre, daher sind die Ergänzungen geschlossen.