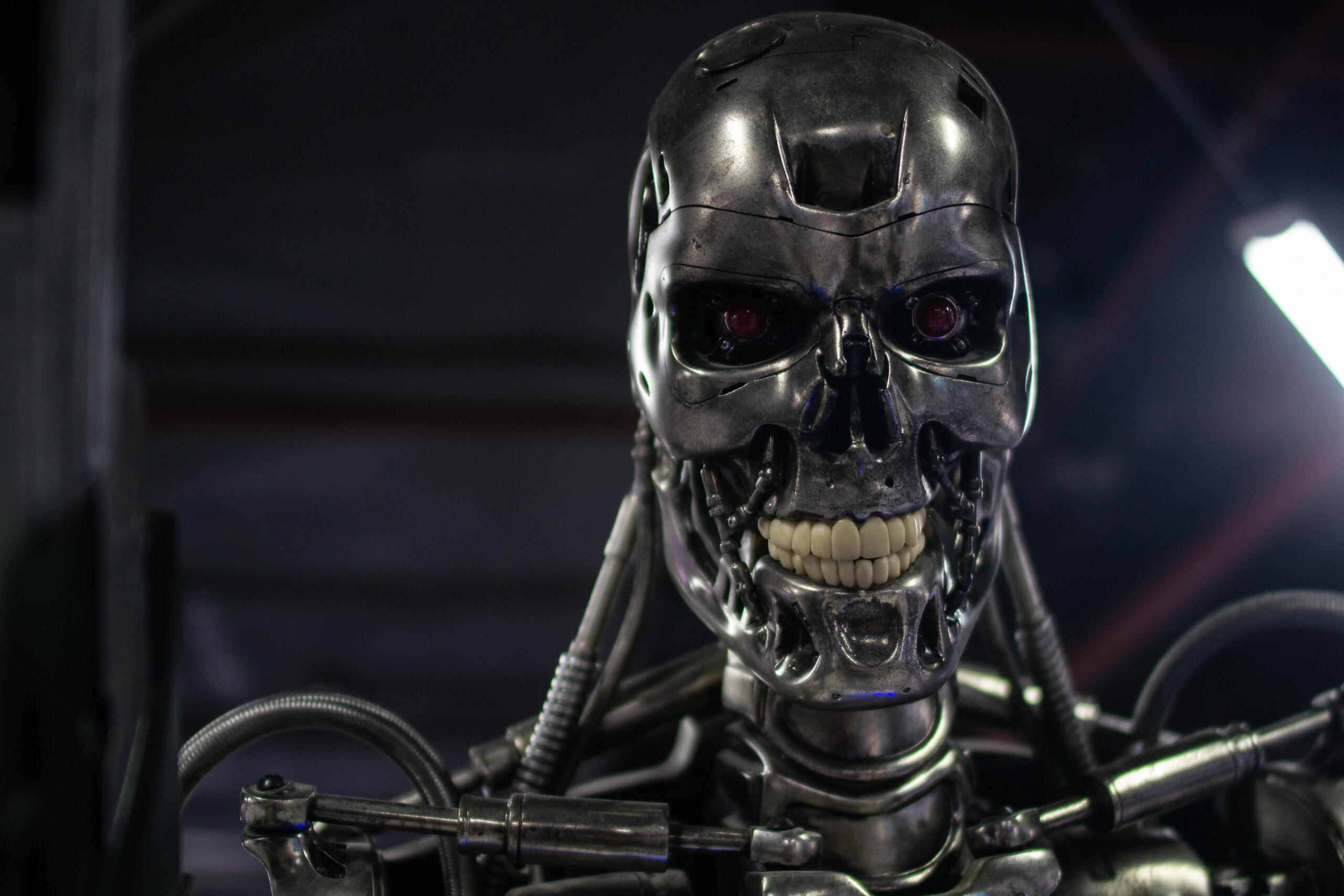

Der Bundestag hat sich heute gegen die internationale Ächtung von autonomen Waffensystemen ausgesprochen. Eine breite Mehrheit der Abgeordneten stimmte gegen entsprechende Anträge von Grünen und Linken.

Mehrere Staaten arbeiten an vollautomatischem Kriegsgerät, darunter die Vereinigten Staaten. Bereits 2016 zeigte das Pentagon vor Pressevertretern einen Schwarm selbststeuernder Drohnen, die für Kampfeinsätze genutzt werden könnten. Gearbeitet wird auch an automatisierten Raketenabwehrsystemen und intelligenten Minen.

Auf UN-Ebene wird bisher ergebnislos über ein Verbot von Killer-Robotern debattiert. Für dieses Ziel kämpft die Kampagne „Killer-Roboter stoppen!“. Die Aktivisten argumentieren, dass ein Roboter in asymmetrischen Kriegssituationen nicht in der Lage sein wird, zwischen Zivilisten und Kämpfenden zu unterscheiden. Ein Expertenbericht der NGO Human Rights Watch urteilte bereits 2018, dass ihr Einsatz nur schwer mit dem Völkerrecht vereinbar sei. Die Kampagne gegen Killer-Roboter fürchtet, dass Kriege durch den Einsatz autonomer Waffensysteme endgültig industrialisiert werden und ein internationales Wettrüsten eingeläutet werden könnte.

Völkerrechtliche Ächtung und keine Förderung

Die Bundestagsfraktion der Grünen forderte in ihrem Antrag die Bundesregierung auf, sich für eine völkerrechtliche Ächtung autonomer Waffensysteme einzusetzen: „Eine Entwicklung, die dazu führt, dass Waffen selbständig Ziele erkennen und diese bekämpfen, ohne dass ein Mensch noch eingreifen kann, muss unbedingt verhindert werden.“

In einem zweiten Antrag fordern die Grünen, dass der Europäische Verteidigungsfonds autonome Waffensysteme nicht fördert. Die aktuelle Verordnung zu dem Fonds sei in dieser Hinsicht nicht deutlich genug, weswegen sie die explizite Aufnahme eines Verbots von Kampfrobotern erreichen wollen.

Die Linkspartei möchte mit ihrem Antrag erreichen, dass die Bundesregierung ein Moratorium gegen die Entwicklung und Anschaffung autonomer Waffensysteme ausspricht. In einem zweiten Schritt soll sie dann im EU-Ministerrat erwirken, dass die EU keine Forschung auf diesem Gebiet mehr fördert und andere Mitgliedsstaaten ebenfalls Moratorien erklären.

Alle drei Anträge wurden mit den Stimmen der Großen Koalition und teilweise jenen von FDP und AfD abgelehnt.