Seit Ende letzten Jahres sind Bild-Generatoren für alle im Netz frei verfügbar. Es genügt ein simpler Text-Befehl wie „Porträt eines Weltraum-Affen“, um handwerklich beeindruckende Bilder zu schaffen. Millionen solcher Bilder sind schon im Netz. In zahlreichen Artikeln, Threads, Essays und Podcasts diskutieren Nutzer*innen darüber, was die neue Technologie etwa für Illustrator*innen und Künstler*innen bedeutet, und ob all das überhaupt erlaubt sein sollte. Jetzt wollen einige Betroffene Antworten vor Gericht.

In den USA haben Künstler*innen rund um Anwalt Matthew Butterick eine Sammelklage eingereicht (PDF). Sie richtet sich unter anderem gegen Stability AI, das Start-up hinter dem populären Bild-Generator Stable Diffusion. Die Klagenden werfen dem Unternehmen vor, dass ihre Werke ohne Einverständnis zum Training der KI genutzt wurden. Sie verlangen Schadenersatz und Unterlassung. Das heißt: Die Firma soll ihnen Geld geben und ihre Werke nicht mehr in die Bild-Generierung einfließen lassen. Die Pressestelle von Stability AI schreibt auf Anfrage, hinter den Anschuldigungen der Sammelklage stehe ein Missverständnis der Technologie. Das Unternehmen habe die Absicht, sich dagegen zu verteidigen.

Auch die Bild-Agentur Getty Images will nach eigenen Angaben in London gegen Stability AI vorgehen. Der Vorwurf ist, dass der Bild-Generator ohne ausdrückliche Erlaubnis mit Getty-Bildern trainiert worden sei und das Unternehmen damit nun kommerzielle Interessen verfolge. Diese Angelegenheit nehme Stability AI sehr ernst, wie eine Sprecherin mitteilt. Allerdings habe man davon erst durch Medienberichte erfahren und noch keine Dokumente erhalten.

Die Fälle dürften nicht nur für Jurist*innen interessant werden. Zur Debatte steht nicht nur das Urheberrecht, sondern die Frage, was Kreativität eigentlich bedeutet – und wie Maschinen lernen dürfen.

Sammelklage hält Werke nicht für „neu“

Eine Übersicht zur Rechtslage in Deutschland und der EU haben wir vergangene Woche veröffentlicht. Hier steht das Urheberrecht nach Einschätzung von Fachleuten nicht im Weg, wenn es darum geht, Bild-Generatoren mit Werken aus dem Netz zu trainieren. Auch für die neu generierten Bilder lässt sich zunächst kein Urheberrecht beanspruchen.

Völlig anders argumentieren die Anwält*innen in der US-amerikanischen Sammelklage. Ihre Argumentation gegen Stable Diffusion basiert hauptsächlich darauf, dass sie die generierten Bilder nicht als neue Werke einstufen. Vielmehr würden die Generatoren Teile der Bilder aus dem Trainingsmaterial kopieren, ähnlich wie bei einer Collage. Entsprechend bezeichnen sie Stable Diffusion als „Collagen-Werkzeug“.

Die Strategie dahinter liegt auf der Hand: Die Sammelklage will sich auf das Urheberrecht berufen. Damit das möglich ist, stellen die Anwält*innen die Behauptung auf, dass die Ergebnisse von Bild-Generatoren bloß schnöde Kopien von urheberrechtlich geschütztem Material seien. Es braucht ein paar technische Erklärungen, um dieser Argumentation folgen zu können – und um sie zu durchschauen.

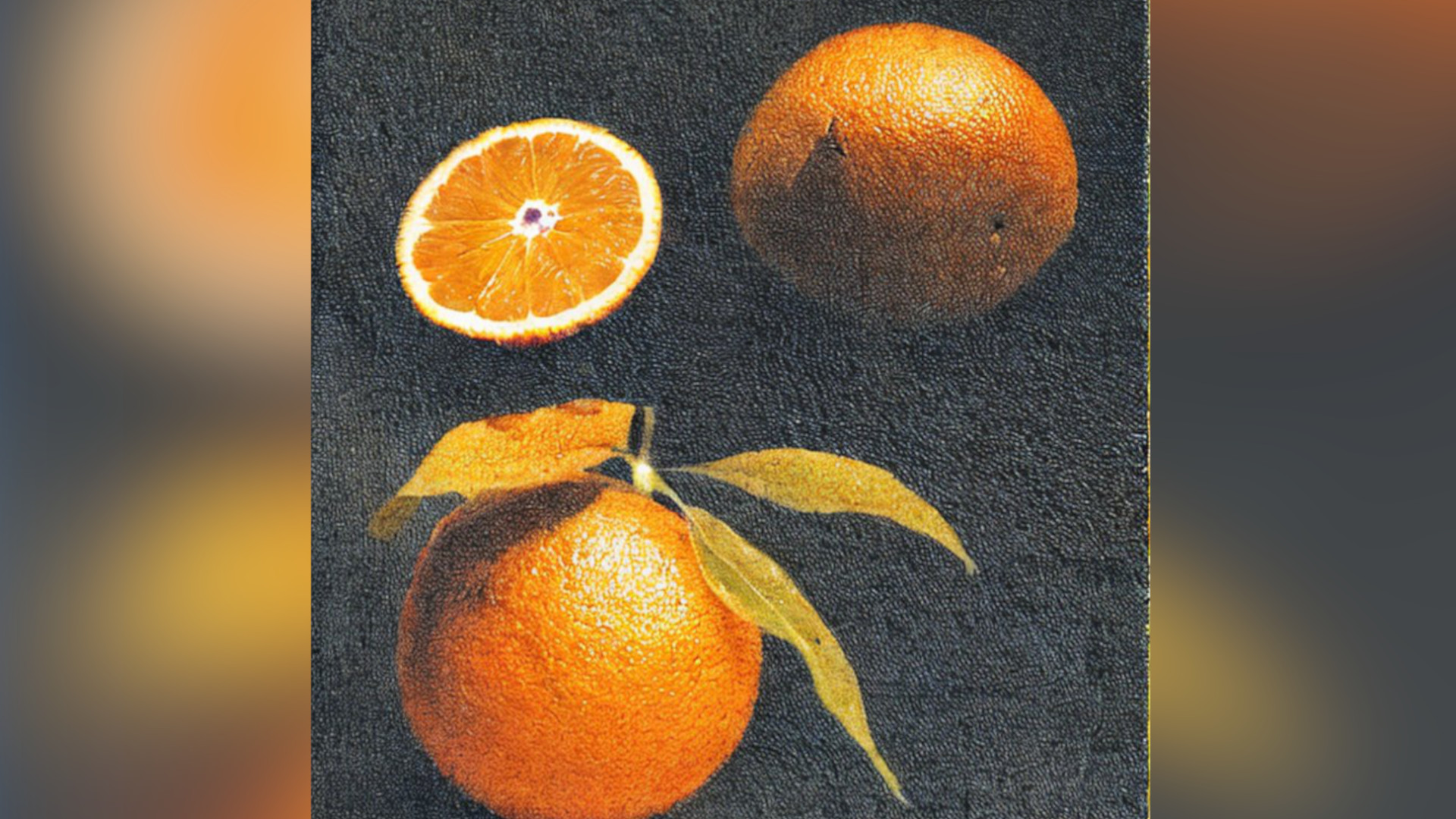

Was eine Orange ausmacht

Anwendungen wie Stable Diffusion kleben nicht etwa wie bei einer Collage Schnipsel aus mehreren Bildern aneinander. Stattdessen steckt dahinter eine Software, die mit Abermillionen Bildern trainiert wurde. Beim Training hat die Software in den verschiedenen Motiven nach Merkmalen gesucht und sich diese Merkmale gemerkt. Ein mögliches Merkmal wäre zum Beispiel: Orangen sind rund.

Das ist natürlich noch längst nicht alles, denn Orangen haben viele weitere Merkmale. Manche Merkmale gehören ziemlich fest zu einer Orange, zum Beispiel die Farbe Orange. Andere Merkmale gehören nur manchmal zu einer Orange, zum Beispiel ein Blatt. Und dann darf man nicht vergessen, dass es noch viele weitere runde oder orangefarbene Dinge gibt, die man nicht mit einer Orange verwechseln sollte. Die Datengrundlage eines Bild-Generators sind also unfassbar viele komplexe Bündel aus Merkmalen und Ähnlichkeiten. Es sind voneinander abhängige Variablen, mit deren Hilfe die Software neue Bilder berechnet.

Gibt man Stable Diffusion nun den Befehl, eine „Orange“ zu generieren, dann wendet die Software die gelernten Variablen an. Sie errechnet daraus ein Bild mit „orangigen“ Eigenschaften: höchstwahrscheinlich orangefarben und rund, vielleicht mit einem Blatt. Und wenn Orangen im Trainingsmaterial sehr häufig in einer Obstschale liegen, dann besteht die Wahrscheinlichkeit, dass auch das generierte Bild eine Obstschale zeigt.

Die Ergebnisse von Stable Diffusion werden sich dabei etwas voneinander unterscheiden, selbst wenn man der Software mehrfach den exakt selben Befehl gibt. Das liegt daran, dass die Software die Gewichtung der zahlreichen Merkmale bei jedem Durchlauf ein klein wenig ändern kann. (Um bei dieser rein technischen Erklärung nichts falsch zu machen, haben wir sie dem Computerwissenschaftler Robin Rombach vorgelegt. Er hat Stable Diffusion an der Ludwig-Maximilians-Universität München mit entwickelt und forscht heute für Stability AI.)

Inspiration für Maschinen

Stable Diffusion gelingt hier mithilfe von Software etwas, das sich entfernt mit menschlicher Erinnerung vergleichen lässt. Bittet man einen Menschen, eine Orange zu zeichnen, dann wird auch er dabei auf teils verschwommene Eindrücke von Orangen zurückgreifen. Solche Vergleiche mit dem Menschen können dabei helfen, die Technologie eingängig zu erklären, sie können aber auch sehr in die Irre führen. Letztlich geht es hier allein um Software, die Dinge berechnet. Vermenschlichende Begriffe wie „Intelligenz“, „Training“, „Erinnerung“ und „Inspiration“ dienen nur als Vergleich und müssen kritisch hinterfragt werden.

Mit dem Begriff Inspiration hat auch Till Kreutzer seine Erklärung veranschaulicht. Im Gespräch mit netzpolitik.org sagte der auf Urheberrecht spezialisierte Anwalt: „Künstlerisches Schaffen funktioniert schon immer so, dass aus Eindrücken und Inspirationen etwas Neues geschaffen wird. Neu ist nur, dass diese Inspiration jetzt maschinell vorgenommen wird“.

Ganz anders argumentiert die von Matthew Butterick geführte Sammelklage. Sie stellt die Behauptung auf, die Werke von Bild-Generatoren seien nur dem Anschein nach „neu“. In Wahrheit, führt Butterick auf einer Erklärseite zur Klage aus, seien sie „offenkundige Kopien aus den Trainingsbildern“, da sie ausschließlich auf einer „Kombination“ von Daten aus dem Trainingsmaterial bestehen.

Die Argumentation irritiert, wenn man sich vor Augen führt, dass die Werke von Bild-Generatoren offensichtlich neu sind. Ein Werk wie etwa diesen Waschsalon im Stil von Edward Hopper hat es vorher schlicht nicht gegeben. Doch auch solche Widerreden versucht Butterick vorwegzunehmen: Er nennt es eine „Ebene der magischen Irreführung“, die es Nutzer*innen schwer mache, im generierten Bild die eigentliche Kopie zu erkennen.

Brachiale Umdeutung des Begriffs „neu“

Die Anwält*innen der Sammelklage möchten mit ihrer Argumentation eine Jury überzeugen: Sie verlangen einen Prozess mit Geschworenen, also Laien aus der Bevölkerung. Wenn es so weit kommt, dürften die Geschworenen ins Grübeln kommen, denn die Sammelklage betreibt eine brachiale Umdeutung des Begriffs „neu“.

Ob das in den USA juristisch funktionieren könnte, kann der Autor dieses Textes nicht bewerten. Der auf Urheberrecht spezialisierte deutsche Anwalt Till Kreutzer sieht die Begründung zumindest „auf tönernen Füßen“; sie sei ihm „technisch und aus eigener Anschauung nicht ersichtlich“. Selbst wenn die Ähnlichkeit eines generierten Bildes zu einem Werk im Einzelfall groß sei, würde das „keinesfalls zur generellen Rechtswidrigkeit der Technologie führen“. Kreutzer könne allerdings nicht einschätzen, ob die Klage nach US-Recht erfolgversprechend sei. Die Pressestelle von Stability AI schreibt über die Sammelklage: „Die Anschuldigungen stellen ein Missverständnis darüber dar, wie generative KI-Technologie funktioniert und wie das Urheberrecht aussieht.“

Aus geisteswissenschaftlicher Perspektive ist die Argumentation der Sammelklage ein Taschenspielertrick. Es ist möglich, jede Art von Werk als Kombination aus bereits bekannten Elementen zu deuten. Besonders in der geistes- und sozialwissenschaftlichen Strömung des Poststrukturalismus ist das seit Jahrzehnten ein alter Hut. In der Folge ließe sich auch jeder beliebige Text als Kopie oder Remix älterer Texte beschreiben. Das wiederum ist oft nur ein Zwischenschritt in der Argumentation: Eine daran anknüpfende poststrukturalistische Ansicht lautet, dass eigentlich bei jedem Lese-Vorgang ein komplett neues Werk erschaffen wird. Wer für strenges Urheberrecht argumentieren will, sollte daher vom Poststrukturalismus eher die Finger lassen.

Es geht auch weniger kompliziert: Das Gericht soll im Grunde zwischen Kunstfreiheit und dem Schutz des geistigen Eigentums abwägen. Dafür braucht es eine funktionierende Unterscheidung zwischen „neuen“ und kopierten Werken. Wenn Merkmale von zig Werken so ausführlich miteinander vermischt werden, dass Menschen darin ein neues Motiv und einen neuen Sinn erkennen, dann ist das treffendste Wort dafür wohl schlicht: neu.

Von fairen und unfairen Kopien

Andere Argumente der Sammelklage lassen sich mit weniger Worten erklären. Demnach hätten manche Nutzer*innen mithilfe von Stable Diffusion Werke im Stil bestimmter Künstler*innen generiert – und diese Werke dann als vermeintliche Originale dieser Künstler*innen zum Verkauf angeboten. Sie seien „Hochstapler“, heißt es in der Sammelklage. Durch Stability AI sei den betroffenen Künstler*innen ein wirtschaftlicher Schaden entstanden. Die Anwält*innen sehen darin außerdem unlauteren Wettbewerb.

Wenn es zum Prozess kommt, könnten sich grundlegende Fragen rund um Bild-Generatoren erstmals vor Gericht klären. Beim Urheberrecht in den USA spielt dabei auch ein Grundsatz namens „Fair Use“ eine Rolle. Der Grundsatz erlaubt es, sogar urheberrechtlich geschützte Werke zu nutzen, solange es „fair“ (gerecht) ist.

Dahinter steht eine Abwägung aus mehreren Faktoren, etwa, ob man mit der Nutzung Geld verdient, ob man die Urheber*innen damit vom Markt fegt; ob man sich ausgiebig an einem Werk bedient oder nur ein wenig – und welche Schaffenshöhe das genutzte Werk überhaupt hatte. Gerade weil diese Abwägung so viele Dimensionen hat, dürften US-amerikanische Prozesse bei diesem Thema interessant werden.

In einem Beitrag der Fachzeitschrift „Texas Law Review“ argumentieren die Juristen Mark Lemley und Bryan Casey, dass man das Training von KI-Systemen mit geschützten Werken als „fair“ betrachten sollte. Ihre Begründung: Beim Training greife die Software gerade nicht auf das kreative Erzeugnis zu, das vom Urheberrecht geschützt sei, sondern vielmehr auf die nicht vom Urheberrecht betroffenen Merkmale eines Werks: ihre zugrunde liegenden Muster.

Beim Grundsatz „Fair Use“ gehe es darum, neue Ideen zu schaffen, zu teilen und darauf aufzubauen, schreiben die Forschenden. „Es geht darum, die Fähigkeit zu lernen zu bewahren – unabhängig davon, ob es sich bei dem lernenden Wesen um einen Menschen oder einen Roboter handelt.“

Strategischer Move von Getty Images

Auch in Großbritannien kann sich Stability AI auf einen Rechtsstreit vorbereiten. Dort will die Bild-Agentur Getty Images gegen das Unternehmen vorgehen. Während noch wenige Details öffentlich bekannt sind, hat Getty-Images-Chef Craig Peters mit dem US-Magazin „The Verge“ gesprochen.

Demnach wolle Getty Images den Unternehmen hinter Bild-Generatoren keinen finanziellen Schaden zufügen oder ihre Entwicklung stoppen. Die Klage beziehe sich unter anderem darauf, dass Inhalte von Getty Images automatisiert zum Training des KI-Systems genutzt worden seien – was gegen die Nutzungsbedingungen verstoße. Peters wolle über faire Kompensation verhandeln, wie aus dem Gespräch mit „The Verge“ hervorgeht.

Der Fall in Großbritannien erscheint pragmatischer als der in den USA. Getty Images verfolgt offenbar das strategische Ziel, auch ein Stück vom Kuchen abzukriegen, nun da Bild-Generatoren den Markt umkrempeln. Und in einem Punkt sind sich wohl alle Konfliktparteien einig: Die Technologie kann vieles verändern, es geht um Geld und Macht. Die Unternehmen hinter generativer KI sammeln gerade hohe Summen von Investor*innen ein. Für Rechtsstreite sind sie damit sicher gut gewappnet.