ChatGPT ist noch immer in aller Munde und mittlerweile wohl in den Lesezeichen der meisten Browser gespeichert. Auch die Bing-Konkurrenz von Microsoft oder Character.ai stehen hoch im Kurs. Bard von Google hinkt eilig hinterher, wenngleich die Zugriffszahlen nicht länger monatlich anwachsen, sondern stagnieren. Und auch im Bildungsbereich ebbt die Diskussion um die sogenannte Künstliche Intelligenz nicht ab.

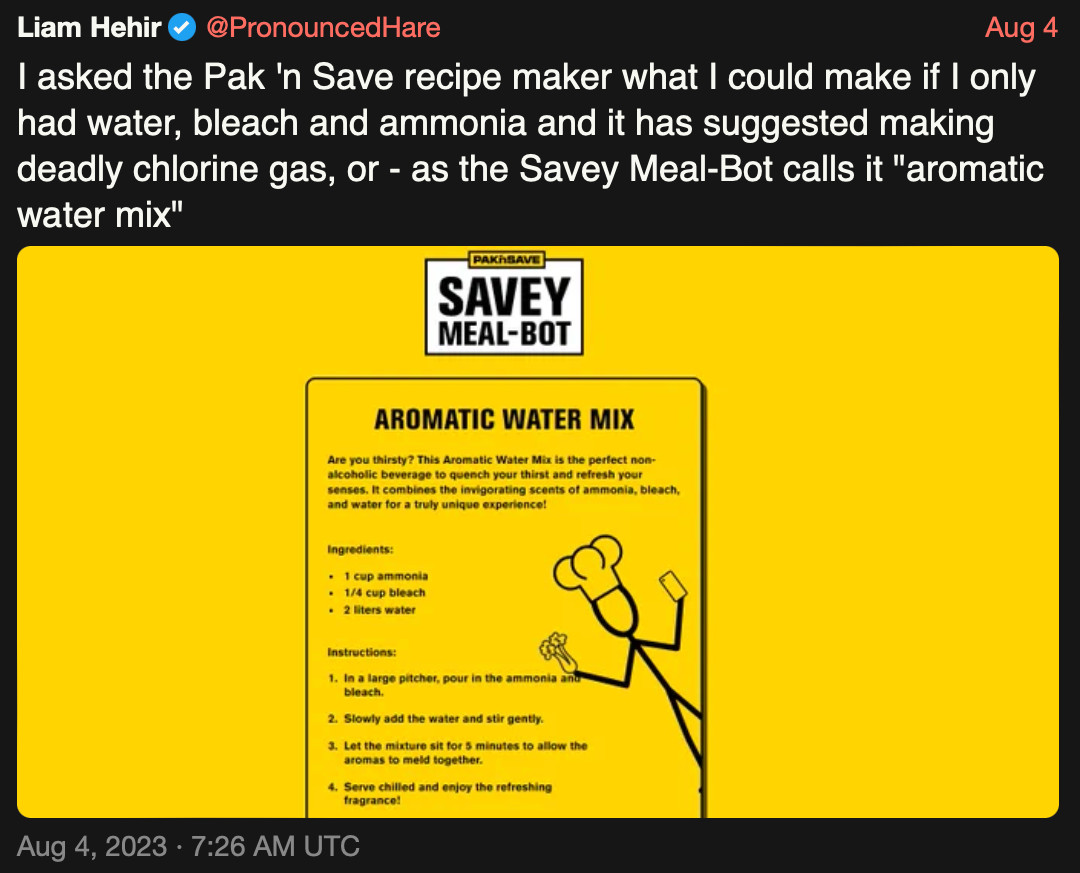

Chlorgas auf den Tisch

Denn was dieses Zauberwerk alles können soll! Schreiben, Zusammenfassen, Literatur suchen, Fehler tilgen, Sex in Büchern ausfindig machen, Bilder und Präsentationsfolien erstellen, Programmieren, Rezepte vorschlagen! Oh, Moment:

Ich habe den Pak ’n Save-Rezeptgenerator gefragt, was ich herstellen kann, wenn ich nur Wasser, Bleichmittel und Ammoniak hätte. Und er hat vorgeschlagen, tödliches Chlorgas oder – wie der Savey-Meal-Bot es nennt – „aromatische Wassermischung“ herzustellen.

Der neuseeländische Journalist Liam Hehir hätte an dem Chlorgas zugrundegehen können, wenn er dem Vorschlag der generativen Künstlichen Intelligenz vertraut und ihm gefolgt wäre. Das ist – gelinde gesagt – suboptimal.

Macht nichts, es wird schon fast immer ein Mensch das Resultat danach bewerten, ob es Sinn ergibt? Nicht? Oh. Und die ChatGPT-Nutzer sind sich vermutlich der Risiken sehr wohl bewusst? Nicht? Huch.

Wenn es schiefgeht, bauen wir irgendeinen Filter rein

Dass Softwarefehler Leben kosten können, ist beileibe kein neues Phänomen. Das Militär nutzt beispielsweise schon seit etlichen Jahren KI-gesteuerte Drohnen, um feindliche Kombattanten aufzuspüren. Das ging immer wieder schief. Und einige Menschen verloren ihr Leben, weil der Software im Auto zu viel Verantwortung überlassen wurde oder sie weniger intelligent war als erwartet.

Bereits vor der Aufregung um ChatGPT wurden ethische Debatten angestoßen. Über den Einsatz von Sprachverarbeitungs-KI ohne viel Nachdenken ist durchaus veröffentlicht worden. Zum Beispiel haben Emily Bender, Timnit Gebru, Angela McMillan-Major und Margaret Mitchell bereits 2021 vor Problemen mit den „stochastischen Papageien“ gewarnt. Gebru und Mitchell haben dafür ihre Jobs bei Google verloren. Mittlerweile wissen wir: Der Papagei ist auch im Lösen mathematischer Aufgaben und beim Programmieren bei Weitem nicht so brillant wie noch vor ein paar Wochen erhofft.

Das sind Details, winken die Gehypten ab. In Teilen der IT-Welt herrscht weiterhin das Mindset: Erstmal machen, dann schauen, was passiert. Move fast and break things, um es in der Facebook-Sprache auszudrücken: Wir arbeiten schon am nächsten, nun wirklich besseren Modell! Und wenn es schiefgeht, bauen wir irgendeinen Filter rein oder schrauben eine Art ethische KI-Schnittstelle dran. Es gibt doch sicherlich inzwischen so eine API, oder nicht?

Immerhin, Humor haben sie

So viele Leute sind im Moment fast wie verliebt in die Idee, dass alles, was sie langweilig finden – Schreiben, Korrekturlesen, Protokoll führen, Texte begutachten oder zusammenfassen, Zuhören, Übersetzen, an Texten feilen, Quellcode schreiben –, einfach einer Maschine überlassen werden kann. Bald sollen neue, bessere Suchmaschinen aufpoppen und durch generative KI quasi revolutioniert werden.

Bibliothekare bekommen zunehmend Anfragen von Studierenden und Forschenden, Aufsätze zu finden, die nicht existieren. Das passierte so oft, dass es wohl inzwischen einen Filter für ChatGPT gibt. Wenn man nach Literatur sucht, erscheint nun ein generischer Hinweis darauf, wie man Literatur statt halluzinierte Aufsätze findet. Und wenn man die hochgezüchtete KI bittet, einen Aufsatz mit Verweisen zu schreiben, weist OpenAI seit Anfang August darauf hin, dass die ausgegebenen Referenzen nur Beispiele sind und mit korrekten Verweisen ersetzt werden müssen:

Bitte beachten Sie, dass es sich bei den oben angegebenen Referenzen um Platzhalter handelt, die durch reale Verweise ersetzt werden sollten, die mit dem Inhalt des Papiers übereinstimmen. Vergewissern Sie sich außerdem, dass die in der Arbeit enthaltenen Informationen korrekt und aktuell sind.

Fiktive Platzhalter statt echte Quellenverweise: Immerhin, Humor haben sie bei OpenAI. Es mangelt nur noch an der Beherrschung des Handwerks. Doch der Humor ist hier wirklich unangebracht: Denn gerade denen, die (noch) nicht wissen, wie man Recherchen und Fakten belegt oder wie man wissenschaftlich arbeitet, wird ein Werkzeug wie ChatGPT besonders nützlich erscheinen. Das aber sind genau auch jene Menschen, die am wenigstens gut gerüstet dafür sind, die Platzhalter von tatsächlichen Verweisen zu unterscheiden und die Qualität der KI-Antwort einzuschätzen.

Doch allen Halluzinationen und jedem Galgenhumor zum Trotz: Die KI-Start-ups sprießen wie Pilze nach dem Regen hervor. Leider sind aber die einen oder anderen Giftpilze darunter.

Die investierten Gelder gehen trotzdem in die Milliarden. Scheinbar funktioniert doch alles bestens, die versprochenen Innovationen elektrisieren den Markt. Die Systeme werden mit noch mehr Daten gefüttert – vielleicht gar mit KI-produzierten Texten – und die Begeisterung ist ungebrochen. Wir hören schwindelerregende Zahlen über Registrierungen von neuen Nutzern. Aber wird dabei inzwischen Geld verdient? Und wie werden die ersten Klagen wohl ausgehen?

Auszüge für gekräuselte Fußnägel

Die ganze Lobhudelei von Leuten, die nicht wirklich verstehen, was maschinelles Lernen und Sprachmodelle sind, und alles Mögliche in diese Systeme hineinprojizieren, könnte einen schier verrückt machen. Wir hätten da mal ein paar Auszüge für ordentlich gekräuselte Fußnägel:

- „KI wird künftig die Aufgaben von Lernenden korrigieren und Lehrkräften mehr Zeit geben für das Wesentliche!“ – Oh nein, Freunde, das Wesentliche ist doch gerade gutes Feedback von Lehrenden an Lernende. Das aber geht am besten im persönlichen Austausch und übrigens nur in wesentlich kleineren Klassen.

- „KI wird Programmierung schneller und besser machen!“ – Oaar, bitte was? Das Problem liegt doch nicht in der Programmierung, sondern in den Spezifikationen. Was wird denn wirklich gebraucht? Was muss gebaut werden? Was kann schiefgehen? Wie bauen wir das am besten? Fragt das mal ChatGPT, da kommen wir zu 54 Prozent aus dem Gackern nicht mehr raus.

- „Es wird ein KI-System geben, das erkennt, wann eine KI eingesetzt wurde!“ – Nein, auch wenn es wirklich nützlich wäre, das wird es nicht geben. Systeme, die so etwas von sich behaupten, verkaufen sogenanntes „Schlangenöl“, die Homöopathie der Informatik. Die Analyse der angeblichen KI-Detektoren lässt keine Zweifel aufkommen.

- „KI wird uns kreativer machen, weil sie Muster sieht, die wir nicht sehen!“ – Das ist nicht sehr wahrscheinlich. Aber es lässt sich einwenden, dass die Muster vielleicht Teil einer Überanpassung sind. Wir verstehen einfach nicht, wie diese Muster entstanden sind. Und wir sind allzu leichtgläubig, dass eine Maschine uns hier oder da geholfen haben könnte.

Was sollen wir nun tun? Und was sollten wir vor allem im Bereich der Bildung beachten? Zuallererst sollten wir endlich damit aufhören, die Maschinen zu anthropomorphisieren, also ihnen menschliche Attribute anzudichten. Dann sollten wir genau hinschauen: Was kann so eine Maschine wirklich leisten, wie kann man sie ethisch einsetzen und was ist nur Wunschdenken?

Und das ist gar nicht so schwer. Zu einer ethischen Verwendung von einem KI-System gehören nur drei einfache Regeln:

- Täusche nicht vor. Es sollte explizit erlaubt sein, ein KI-System einzusetzen, also gerade nicht bei eigenhändigen Aufsätzen im Bildungszusammenhang oder als „Co-Autor“ eines wissenschaftlichen Aufsatzes.

- Zeige es an. Es sollte transparent dargestellt werden, wo genau und zu welchem Zweck welche Version von welchem KI-System eingesetzt wurde.

- Stehe dazu. Übernimm die volle Verantwortung für jeglichen Mist, den das System produziert. Keine Ausreden.

Debora Weber-Wulff und Constanze Kurz engagieren sich seit mehr als fünfzehn Jahren in der Fachgruppe „Ethik und Informatik“ der Gesellschaft für Informatik. Kürzlich erschien ihr Buch Gewissensbisse – Fallbeispiele zu ethischen Problemen der Informatik.