Das Problem rund um Deepfake-Pornos ist in der Politik angekommen. Zu den ersten Unterzeichner*innen einer neuen Petition gehören unter anderem die Bundestagsabgeordnete und Vorsitzende der Jusos, Jessica Rosenthal, die Bundestagsabgeordnete und Bundesvorsitzende der Frauen-Union, Annette Widmann-Mauz (CDU), sowie die EU-Abgeordnete Alexandra Geese (Grüne). Die Petition fordert Maßnahmen zum Schutz von Menschen, die gegen ihren Willen in Pornos montiert wurden.

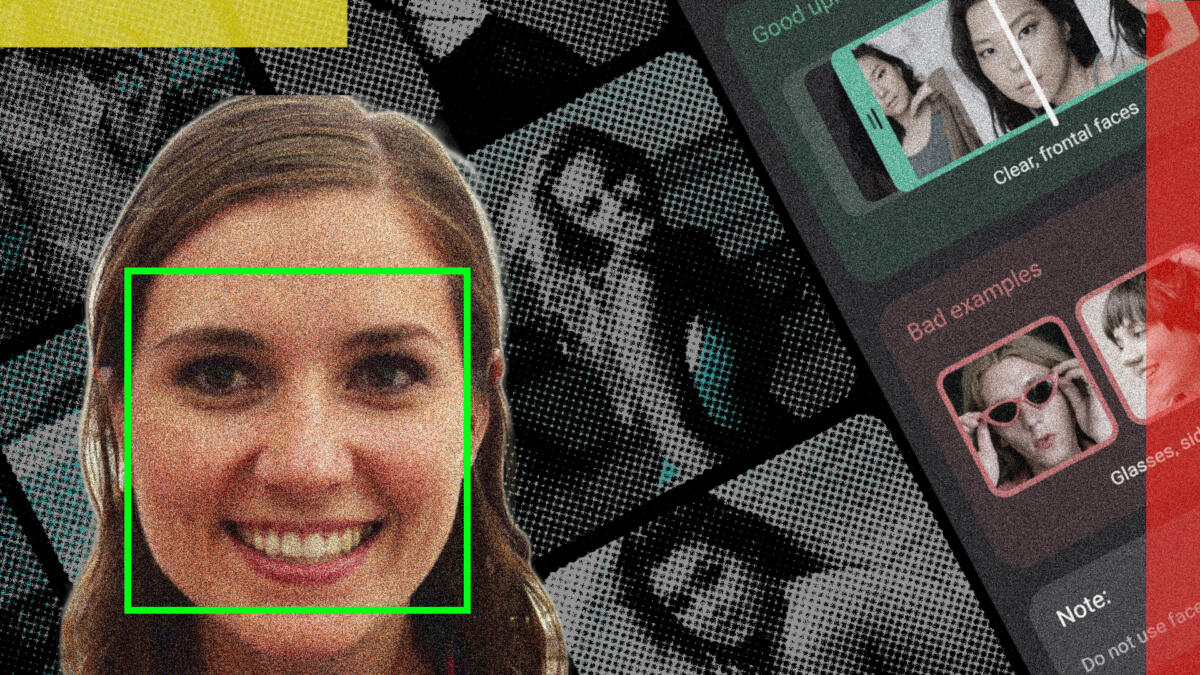

Im September haben wir in einer gemeinsamen Recherche mit dem SPIEGEL gezeigt, wie groß die Gefahr durch solche Deepfake-Pornos ist. Teils millionenfach heruntergeladene Smartphone-Apps machen es möglich, Menschen gegen ihren Willen in sexualisierte Deepfakes zu montieren. Dafür genügt bereits ein Foto, etwa aus den sozialen Medien. Passende Videovorlagen gibt es direkt in kostenlosen Smartphone-Apps. Sie werden als Face-Swap-Apps beworben, mit denen sich Gesichter austauschen lassen.

Die Ergebnisse lassen sich bei genauem Hinsehen oft als Fake entlarven. Es gibt aber auch ausgefeiltere Software, die täuschend echte Ergebnisse produziert. In beiden Fällen können solche Videos Betroffene verletzen und vor Angehörigen oder Vorgesetzten herabwürdigen. „Deepfakes können Betroffene psychisch und gesellschaftlich belasten“, schrieb uns Josephine Ballon von der Hilfsorganisation HateAid. Vor allem Frauen stünden im Fokus.

Die gemeinnützige Organisation HateAid ist auch Initiatorin der Petition „Porno-Manipulation jetzt stoppen“. Eingangs heißt es: „Jede Person muss selbstbestimmt über ihren eigenen Körper und ihre Intimität entscheiden können.“ Genau das stehe aber durch Face-Swap-Apps auf dem Spiel. „Plötzlich ungewollt im Porno: Das kann uns jetzt allen passieren“, heißt es weiter. Die Apps würden sogar dazu animieren, Nacktaufnahmen zu fälschen.

Petition will App-Stores in die Pflicht nehmen

Die Dimension des Problems wurde im September durch die Recherche-Kooperation öffentlich. Konkret haben wir drei populäre Deepfake-Apps untersucht, die für iOS und Android erhältlich sind. Die Apps sind kein Geheimtipp aus dem Nischenforum, sie wurden millionenfach heruntergeladen. Unsere Recherche zeigte: Die Betreiber haben sich nur bedingt dagegen eingesetzt, dass ihre Apps für bildbasierte Gewalt missbraucht werden können. Über eine der drei Apps hatten vor dem Hintergrund bereits englischsprachige Nachrichtenmedien berichtet.

Die Petition richtet sich an Digitalminister Volker Wissing (FDP). Er soll demnach verhindern, dass „App-Anbieter ungewollte Manipulationen von Nacktaufnahmen anbieten und anpreisen“ und sich dafür einsetzen, dass „App-Stores keine Apps mehr anbieten, die die ungewollte Manipulation von Nacktbildern ermöglichen“.

Im September hatten wir Google und Apple auf das Problem angesprochen; die Konzerne sind Anbieter der wichtigsten App-Marktplätze. Apple teilt mit, im App Store habe man noch nie Pornografie zugelassen. Zu einzelnen Apps wollte sich der Firmensprecher nicht äußern. Play-Store-Betreiber Google hatte auf unsere Fragen bloß mit einem Link zu den eigenen App-Richtlinien reagiert.

Auch Prominente betroffen

„Die jetzigen Gesetze müssen dringend so angepasst werden, dass sie uns wirksam vor dem Porno-Missbrauch unserer Bilder schützen“, schreibt HateAid in der Petition. Es müsse geprüft werden, inwieweit deutsches Strafrecht derartige Inhalte bereits erfasst. Eventuell brauche es ein Verbot, solche Inhalte herzustellen, weiterzugeben und öffentlich zugänglich zu machen. Zwar können bereits jetzt nicht-einvernehmliche Deepfakes als Beleidigung, Verleumdung oder Verletzung des Rechts am eigenen Bild in Betracht kommen. Betroffene sollen es laut Petition aber einfacher haben, sich juristisch wehren zu können.

Der Knackpunkt bei Deepfake-Pornos ist das fehlende Einverständnis. Wenn alle Beteiligten ihre Zustimmung erteilen, können Deepfakes auch ein kreatives Stilmittel sein. Aber nicht-einvernehmliche Deepfake-Pornos sind eine von vielen Arten digitaler Gewalt. Das ist ein Sammelbegriff, zu dem auch unter anderem Hassrede, Stalking und bildbasierte Gewalt gehören, umgangssprachlich bekannt als Rachepornos. Oft werden Frauen zum Ziel digitaler Gewalt, und oft wird digitale Gewalt von analoger Gewalt begleitet, zum Beispiel durch (Ex-)Partner*innen.

Das Thema ist für viele Betroffene schambesetzt, selten gehen sie an die Öffentlichkeit. Im Oktober 2021 berichtete das vom WDR produzierte Funk-Format „reporter“ über Influencer:innen, die gegen ihren Willen in Deepfake-Pornos gelandet sind. Solche Deepfake-Pornos mit Prominenten werden auf einschlägigen Websites teils millionenfach geklickt. Die Videos verletzen nicht nur die Rechte der Prominenten, sondern auch die Rechte der Porno-Darsteller:innen – denn auch sie haben ihre Aufnahmen in der Regel nicht zur freien Bearbeitung und Verbreitung freigegeben.