Das ist ein Transkript meines Vortrags von der re:publica 2024.

Auf die Idee für diesen Vortrag bin ich gekommen, als ich gemerkt habe: Da gibt es einige Phänomene im Internet, die habe ich bisher für voneinander unabhängig gehalten. Für Ausnahmen oder Absurditäten. Aber eigentlich gehören diese Phänomene zusammen, und sie bilden ein Muster. Sie stehen für eine größere Entwicklung, die unsere Grundrechte im Internet bedroht. Es ist ein Thema, um das sich kaum jemand kümmert. Und das, obwohl Sich-Kümmern ausgerechnet das wäre, womit man das Problem am besten angehen könnte.

Ich werde in diesem Vortrag zuerst eine Auswahl von Phänomenen präsentieren, und dann legen wir sie nebeneinander und schauen uns das Muster an.

Phänomen 1: Regulierte Brüste auf Instagram

Das erste Phänomen ist zugleich das bekannteste. Auf Instagram gibt es umfangreiche Richtlinien zur regelkonformen und regelwidrigen Darstellung weiblich gelesener Brüste. Zum Beispiel sind weiblich gelesene Nippel bis auf wenige Ausnahmen auf Instagram verboten. Erlaubt sind sie zum Beispiel: „im Kontext von Stillen, Geburt, Momenten nach der Geburt oder in einem medizinischen oder gesundheitlichen Kontext“.

Wer außerhalb solcher Ausnahmen Nippel zeigt, die ein Bilderkennungsalgorithmus oder eine menschliche Moderation als weiblich interpretieren, muss mit Konsequenzen rechnen: Posts können gelöscht werden, die Sichtbarkeit des eigenen Accounts eingeschränkt.

Im Jahr 2022 habe ich hierzu mit Kolleg*innen für den Funk-Kanal „So Many Tabs“ einen Sketch gedreht. Er zeigt, wie die Instagram-Nippel-Polizei in ein Zimmer stürmt, in dem Drogen und Waffen herumliegen sowie eine kleine Gummi-Brust. Und die wird natürlich direkt konfisziert. Kann man sich heute noch auf funk.net anschauen.

Instagrams Nippel-Regeln finden viele falsch, schlecht und ungerecht. Zum Beispiel haben bereits 2019 Protestierende vor dem Facebook-Sitz dagegen mobil gemacht. Als Zeichen des Protests haben sie sich Brustwarzen von Männern ausgedruckt. Die waren auf eine Weise zugeschnitten, dass kein Mensch mehr verlässlich ablesen konnte, welche Geschlechtsidentität man ihnen zuordnen sollte.

Auch das Oversight Board von Meta kritisiert die Anti-Nippel-Regeln. Das ist ist ein Aufsichtsgremium, das Meta selbst eingerichtet hat. Es gibt hin und wieder besonnene Empfehlungen ab, die der Konzern dann nicht umsetzt. So hat das Oversight Board vergangenes Jahr zum Nippel-Verbot geschrieben:

Ein solcher Ansatz (…) verlangt von den Moderator*innen, schnelle und subjektive Bewertungen von biologischem und sozialem Geschlecht vorzunehmen, was bei der Moderation von Inhalten in großem Maßstab nicht praktikabel ist.

Ich würde sogar sagen, das ist selbst im kleinen Maßstab nicht praktikabel, aber die Richtung ist klar.

Phänomen 2: Google Safe Search

Dieses Phänomen ist schon deutlich weniger bekannt. Mir ist das vergangenen Herbst zufällig aufgefallen, als ich einen älteren Artikel googeln wollte, um ihn in einem neuen Artikel zu verlinken. Und dann ist der einfach nicht aufgetaucht. Ich dachte mir, das gibt’s doch nicht, habe ich mich vertippt? Hat den jemand offline genommen?

Aber dann habe ich gemerkt: Nein, ich habe mich nicht vertippt. Dieser journalistische Artikel, den ich suche, der ist weiterhin online. Aber Google war plötzlich der Meinung: Ich bin nicht alt genug, um diesen Artikel sehen zu dürfen. Google hat das Suchergebnis ausgeblendet, als würde es gar nicht existieren. Denn in diesem Artikel ging es um Pornos.

Ich habe mir das dann etwas strukturierter angeschaut und für netzpolitik.org aufgeschrieben. Und zu meiner Überraschung habe ich gesehen: Das hat Struktur. Google macht so etwas in größerem Stil. Der Jugendschutz-Filter von Google entfernt – unter anderem – Journalismus über Pornoseiten aus den Suchergebnissen.

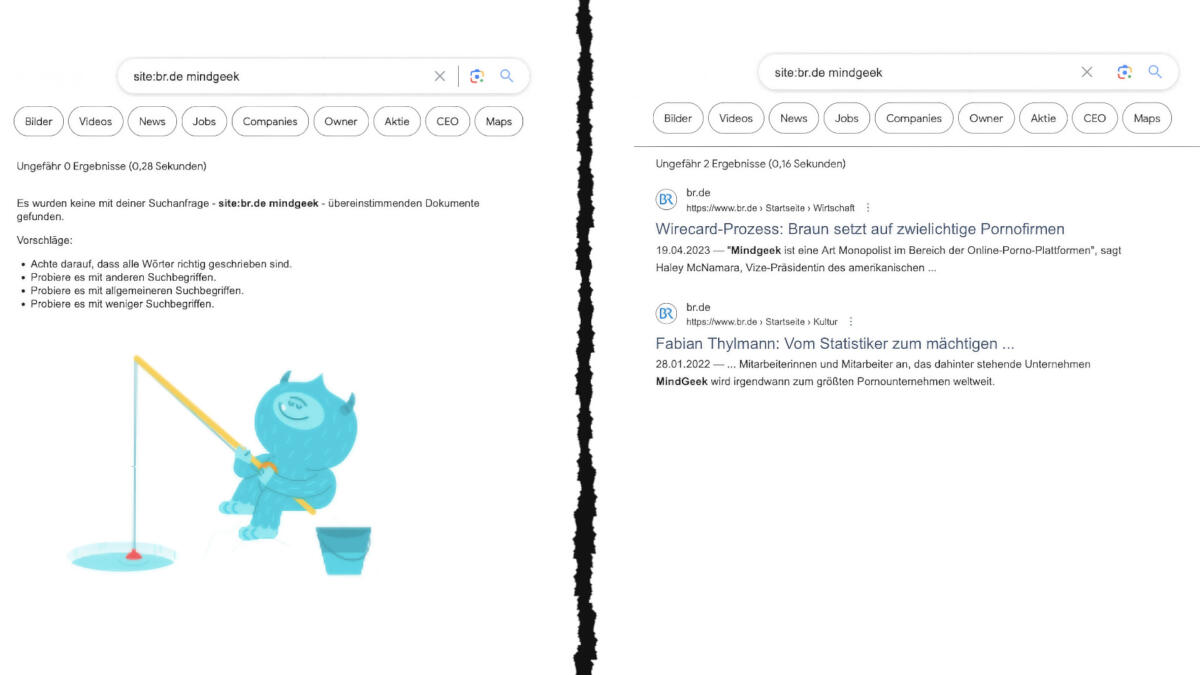

Mindestens 20 Nachrichtenseiten waren bei unserem Test betroffen. Darunter zum Beispiel der Bayerische Rundfunk. Die Suchanfrage im Bild bezieht sich auf Berichte zum Thema Mindgeek, das ist der alte Name des Mutterkonzerns von Pornhub. Der Screenshot links zeigt die Google-Ergebnisse mit Safe Search ohne jegliche Treffer. Der Screenshot rechts zeigt die Ergebnisse ohne Safe Search mit Treffern.

Und hier eine kleine Auswahl an Artikeln, die Google ebenso für „zu anstößig“ hält und deshalb einfach mal unterschlagen hatte:

- „Sexualisierte Gewalt im Netz: Dutzende Frauen verklagen Pornhub“ von der taz.

- Oder: „Youporn und Pornhub waren gestern – Solche Pornos hast du noch nie gesehen“ vom ZDF.

- Oder, mein Lieblingsbeispiel: „Junge Union fordert Pornografie-Verbot“ von netzpolitik.org aus dem Jahr 2010 – das fand Google einfach zu anstößig.

Offensichtlich stützt sich Google Safe Search auf bloße Stichworte wie „Porno“ oder „Sex“, und so werden eben auch mal seriöse Inhalte geblockt.

Wenn ihr jetzt denkt: Von diesem Filter habe ich aber noch nie gehört? Das kann sein. „Safe Search“ schaltet sich nämlich manchmal automatisch im Hintergrund ein, wenn Google den Verdacht hat, dass Leute unter 18 sind. Es kann sein, dass man das nicht mitbekommt. Immerhin kann man das, wenn man es denn bemerkt, händisch wieder ausschalten. Reporter ohne Grenzen hat mir hierzu gesagt: „Es muss deutlich sichtbar werden, wenn und dass solche Filter aktiv sind“.

Und der Deutsche Journalisten-Verband (DJV) sagte:

Sicherheitsmaßnahmen müssen da enden, wo sie die Pressefreiheit berühren. Es kann nicht sein, dass kritische Medienberichte über Pornoseiten blockiert werden, sobald sie bestimmte Reizbegriffe enthalten. Da muss Google besser darauf achten, was die eigenen Filter anrichten.

Phänomen 3: YouTubes eingeschränkter Modus

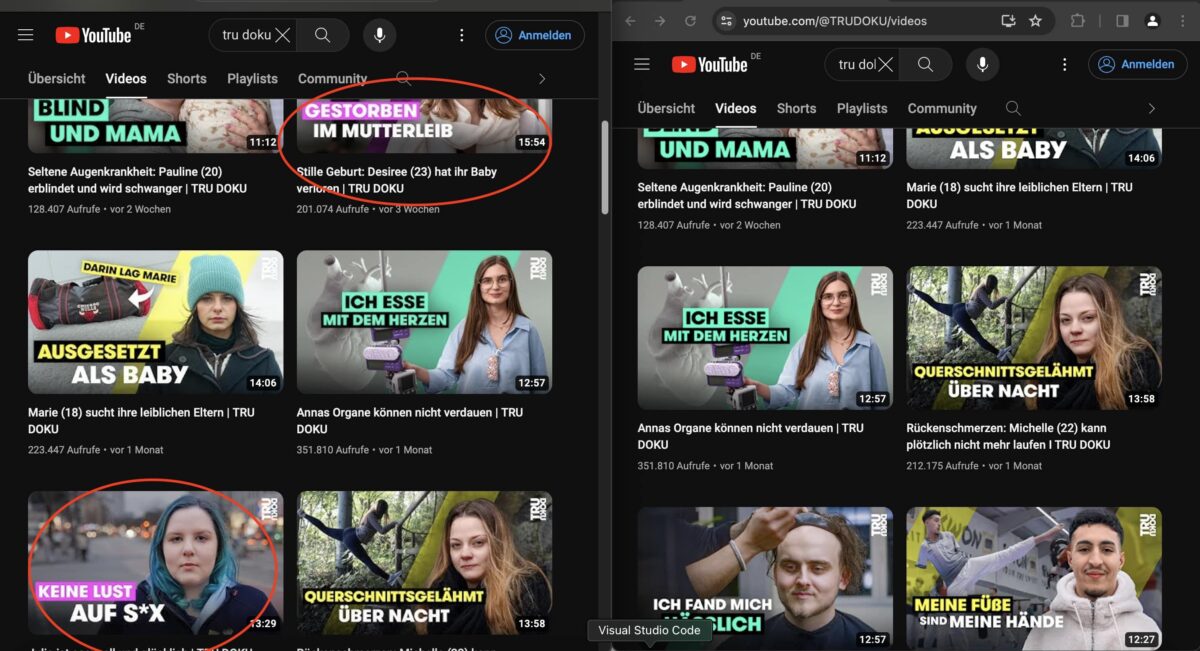

Dieses Beispiel kann ich kürzer halten. Denn es ist keine so große Überraschung mehr, wenn die Plattform YouTube im Namen des Jugendschutzes die Fehler ihrer Schwester-Plattform Google wiederholt. Bemerkt hat das zuerst unsere Bundesfreiwillige Nora Nemitz, als sie bei YouTube unterwegs war, und sie hat das im März für uns aufgeschrieben.

YouTube nennt seine Jugendschutz-Funktion übrigens „eingeschränkten Modus“. Und das trifft es finde ich ganz gut, denn der Modus schränkt beispielsweise die Informations- und Pressefreiheit ein.

Dieser eingeschränkte Modus lässt sich in öffentlichen WLANs aktivieren, zum Beispiel in Schulen, Bibliotheken oder Jugendherbergen. Bei ihrem Test hat meine Kollegin dann festgestellt: Wieder werden Inhalte offenbar aufgrund von Stichworten ohne weitere Transparenz unterschlagen. Der eingeschränkte Modus hielt zum Beispiel manche Ausgaben des queeren Magazins „GoQueer“ für potenziell nicht jugendfrei.

Phänomen 4: DALL-E

Das meist gehypte KI-Unternehmen aktuell ist OpenAI, das neben ChatGPT auch den Bild-Generator DALL-E betreibt. Eine der großen – und auch berechtigten – Sorgen rund um Bild-Generatoren lautet: Man kann sie nutzen, um illegale, sexualisierte Nacktaufnahmen von Menschen zu erstellen, ohne Einverständnis. Im Versuch, das zu unterbinden, hat sich OpenAI für einen recht plumpen Weg entschieden und mal eben die menschliche Anatomie zum Tabu erklärt.

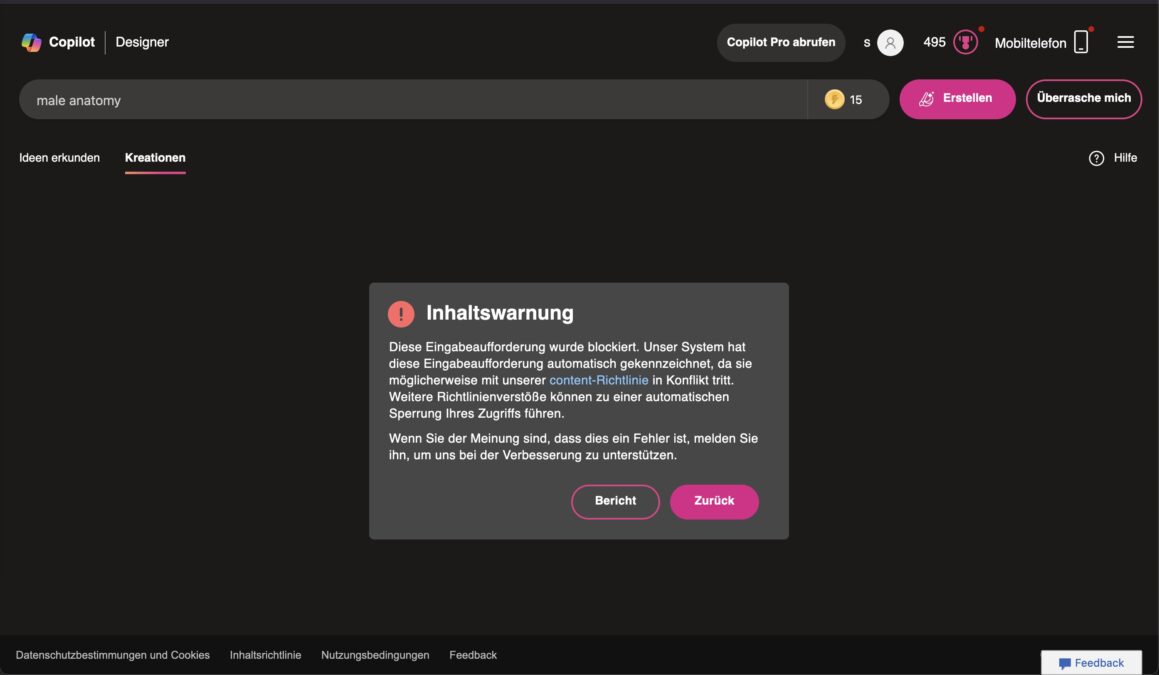

Hier ein paar Beispiele, wie das in der Praxis aussehen kann. Ausprobiert Mitte Mai, also kurz vor diesem Vortrag, mit dem „Bing Copilot Designer“ von Microsoft. Das ist ein Werkzeug, das auf DALL-E-4 basiert. Zuerst habe ich den Bild-Generator darum gebeten, mir zu zeigen, wie weibliche Anatomie aussieht. Also der Aufbau des menschlichen Körpers, keine sexuelle Darstellung. Das Ergebnis:

Inhaltswarnung! Diese Eingabeaufforderung wurde blockiert (…) Weitere Richtlinienverstöße können zur einer automatischen Sperrung Ihres Zugriffs führen.

Zweiter Versuch: männliche Anatomie. Ist das vielleicht weniger bedenklich? Leider nein. Auch hier hieß es: „Diese Eingabeaufforderung wurde blockiert“.

Zwischenfrage: Darf man sich überhaupt noch selbst im Spiegel anschauen oder ist das auch schon eine potentiell schädliche Darstellung von Anatomie?

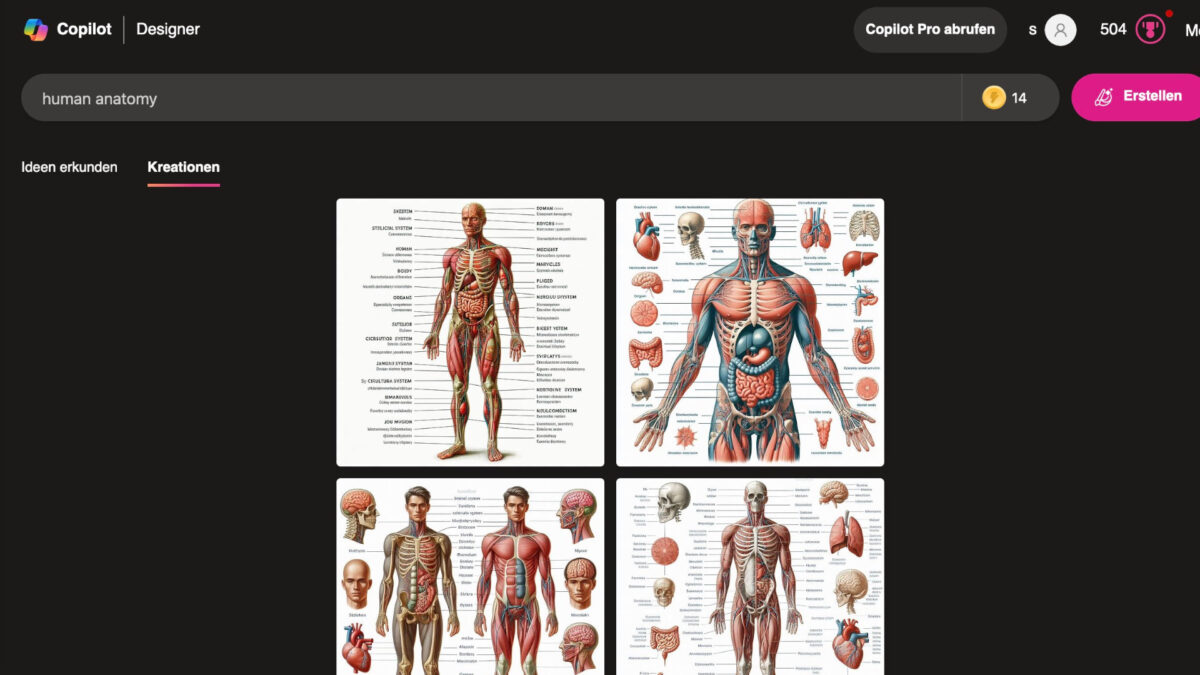

Also auf zum dritten Versuch. Ich dachte mir, vielleicht betrachtet OpenAI sogar Worte wie „männlich“ und „weiblich“ als zu kontrovers. Ich probiere es als noch grundlegender mit dem Befehl: „menschliche Anatomie'“. Und siehe da: Das hat funktioniert. Ohne die Erwähnung eines Geschlechts dürfen bei OpenAI offenbar Bilder von menschlicher Anatomie generiert werden.

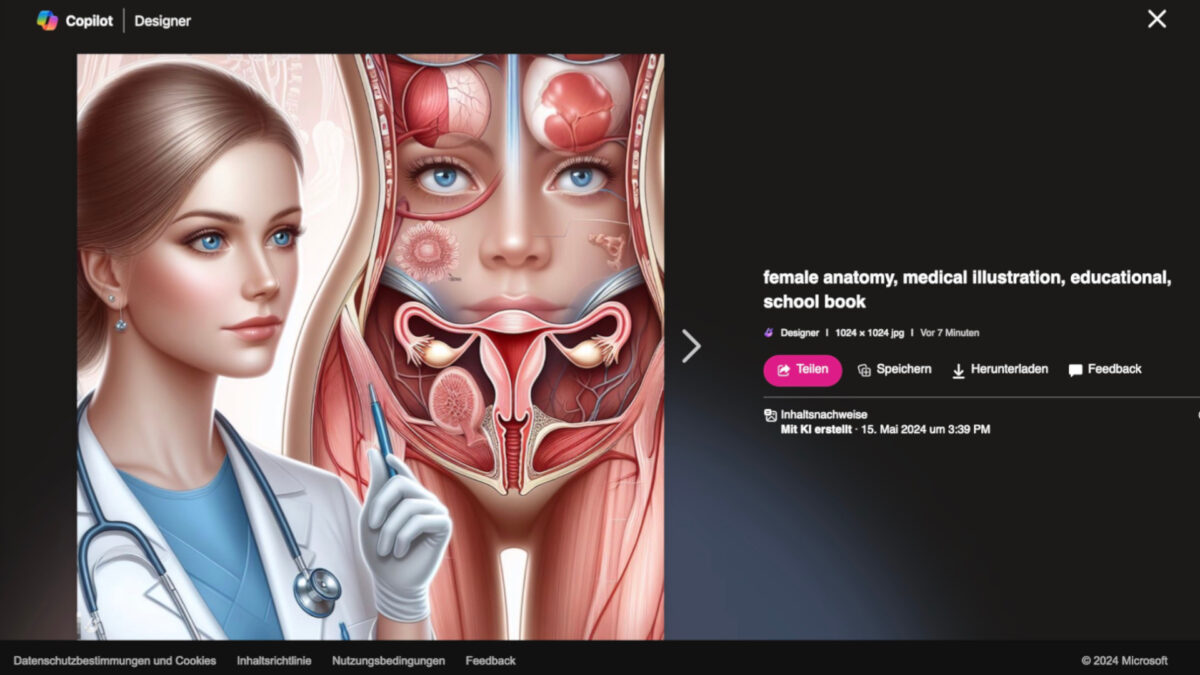

Und zuletzt noch ein vierter Versuch: „weibliche Anatomie, medizinische Darstellung, pädagogisch, Schulbuch“. Also quasi ein Wink mit dem Zaunpfahl, das hier wirklich ganz sicher etwas Unbedenkliches generiert werden soll.

Und das hat tatsächlich geklappt. Immerhin. Entstanden ist dabei diese anatomisch hochgradig aufschlussreiche Darstellung, die auch das aus der Redewendung bekannte „innere Auge“ illustriert.

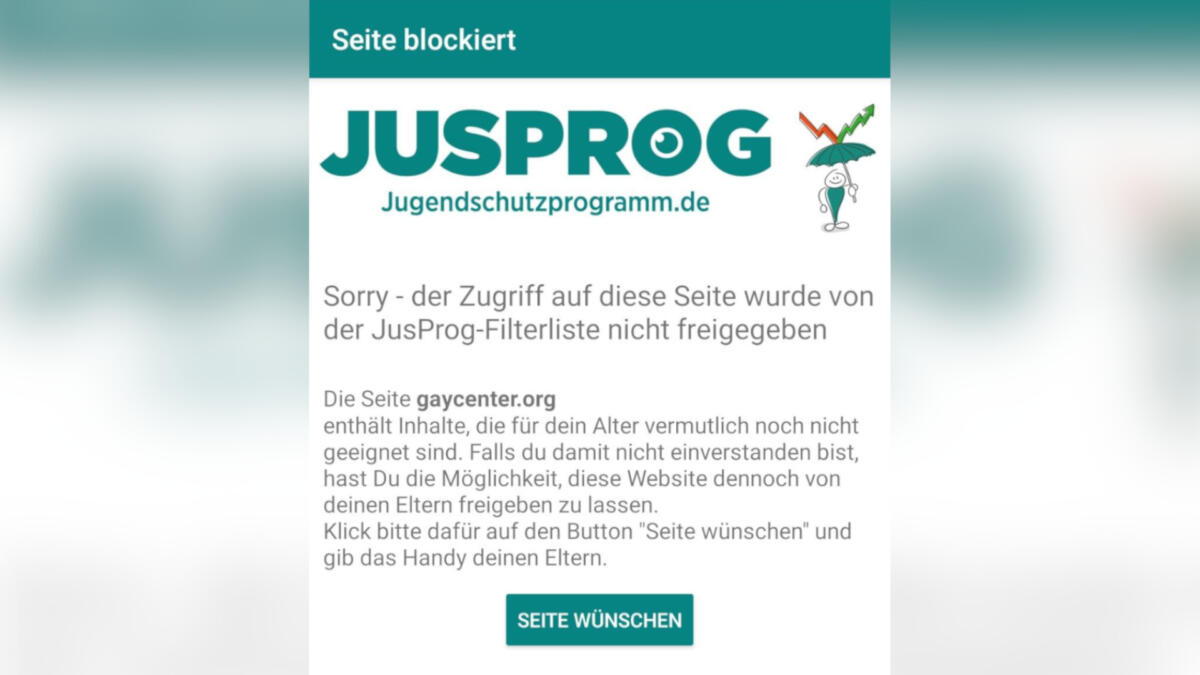

Phänomen 5: JusProg

Wir haben jetzt viel über US-Konzerne gesprochen. Das letzte Beispiel kommt aus Deutschland und hängt auch eng mit deutschem Recht zusammen: JusProg. Das steht für Jugendschutzprogramm. JusProg ist das einzige Jugendschutz-Programm für Websites in Deutschland, das den gesetzlichen Anforderungen gerecht wird und dafür offiziell anerkannt ist. Betrieben und gepflegt wird es von einem gemeinnützigen Verein.

Eltern können JusProg kostenlos auf den Handys und Laptops ihrer Kinder installieren. Aber auch WLAN-Hotspots lassen sich mit JusProg versehen. Das macht das Land Bayern mit dem kostenlosen BayernWLAN. Das heiß: Im BayernWLAN bekommen auch alle Erwachsenen das für Jugendliche gefilterte Internet serviert.

Und auch bei JusProg basieren die Entscheidungen, was gefiltert wird und was nicht, auf Stichwörtern und Phrasen. Es gibt also eine Datenbank mit Websites und ihren Altersstufen, generiert aufgrund von Analysen, welche Worte da drin vorkommen.

Was dabei schiefgehen kann, habe ich im Januar mit Kolleg*innen von BR Data recherchiert. Mit einer Stichprobe haben wir insgesamt 74 Websites zu besonders sensiblen Themen gefunden, die eigentlich für Minderjährige Aufklärung liefern sollten – aber von JusProg gesperrt wurden. Die Websites stammen von gemeinnützigen Organisationen oder haben gar staatliche Finanzierung im Rücken. Also: Sogar mit öffentlichem Geld gezielt für Minderjährige entwickelte Info-Angebote waren geblockt.

Zum Beispiel safer-sexting.de, eine gezielt für Jugendliche entwickelte Infoseite der Landesmedienanstalt Nordrhein-Westfalen über den einvernehmlichen Austausch von Nacktaufnahmen. Oder Websites für Jugendliche über psychische Gesundheit, Suizidprävention, sexuell übertragbare Krankheiten. Oder, mein liebstes Beispiel: die Website recht-relaxed.de vom Bundesjustizministerium. Ein für junge Menschen äußerst ansprechendes Wortspiel. Denn Kinder und Jugendliche sollten sich dort recht relaxed über das Recht informieren. Seltsamerweise wurde die Seite während unserer Recherche offline genommen.

Immerhin: JusProg ist für Presseanfragen viel besser erreichbar als US-Konzerne. Das Verein hat auf unsere Recherche ausführlich reagiert, und schon kurze Zeit nach der Kontaktaufnahme war ein Großteil der betroffenen Seiten nicht mehr erst „ab 18 Jahren“.

Phänomen 6: Twitch

Auf den letzten Drücker habe ich noch eine Folie zu Twitch in diesen Vortrag eingebaut, weil ich dachte: Twitch ist zu krass, um es unter den Tisch fallen zu lassen. Denn Twitch, die Live-Streaming-Plattform von Amazon, treibt es mit den Regeln rund um Nacktheit besonders weit. Zwei Details aus dem Regelwerk finde ich besonders beachtlich. Dort heißt es zum einen, von mir aus dem Englischen übersetzt:

Wir erlauben es nicht, dass Streamer*innen implizieren oder suggerieren, dass sie vollständig oder teilweise nackt sind, unter anderem, indem sie Brüste oder Genitalien mit Objekten oder schwarzen Balken verdecken.

Das hat zwar eine spezielle Vorgeschichte, die ich hier nicht weiter ausführen möchte. Vielmehr möchte ich den Blick auf die mit der Regel verbundene Umkehr der Beweislast lenken: Nutzer*innen auf Twitch dürfen nicht nur nicht nackt sein. Nein, sie müssen sogar aktiv nachweisen, dass sie ihre Körper ordnungsgemäß verhüllt haben.

Und noch eine Regel finde ich beachtlich:

Wir erlauben keine sichtbaren Umrisse von Genitalien, auch wenn sie bedeckt sind.

Da habe ich es mir nicht nehmen lassen, in meinem Artikel für netzpolitik.org einen gewagten Vergleich zu ziehen.

Das Muster

Aus den dargelegten Beispielen ergibt sich, wie ich finde, ein klares Muster: Da blocken Leute lieber zu viel als zu wenig. Sie nehmen lieber in Kauf, dass jugendfreie, harmlose, und auch relevante Inhalte nicht verfügbar sind. Lieber das, als dass möglicherweise nicht jugendfreie Inhalte durchrutschen. Und das wäre auch eine rationale Denkweise, wenn es nur ein einziges Ziel gäbe: nämlich potentiell schädliche Inhalte zu minimieren.

Aber so einfach ist das nicht. So eine Reduzierung auf ein Ziel, das wird der Realität nicht gerecht. Konkreter wird es den Grundrechten – auch den Grundrechten von Minderjährigen! – nicht gerecht. Denn Kinder und Jugendliche, die haben nicht nur ein Recht darauf, vor Inhalten geschützt zu werden, die ihnen vielleicht schaden können. Sie haben genauso wie ein Erwachsene auch ein Recht auf Teilhabe und Informationsfreiheit und Bildung.

In einem zumindest für mich augenöffnenden Interview hat mir Jessica Euler vom Verein Aktion Kinder- und Jugendschutz aus Brandenburg das hier gesagt:

Das Kind (…) hat das Recht, die eigene Sexualität zu entwickeln und befähigt zu werden, sich selbst gute Informationen zu suchen. (… ) Kinder haben das Recht, sich zu informieren, und die Angebote müssen ihrer Entwicklung angemessen sein.

Technische Maßnahmen wie oben beschrieben werden diesen Grundrechten nicht gerecht. Es wird das grobe Thema eines Inhalts abgeschätzt – zum Beispiel Sexualität. Nicht aber, ob das Thema auf eine altersgerechte, seriöse Weise behandelt wird. Also ob es ein Inhalt ist, den man Minderjährigen auf Informationssuche auf keinen Fall vorenthalten sollte.

Ich habe in den vergangenen Jahren nicht den Eindruck bekommen, dass dieses Problem auf besonderes Interesse stößt, eher im Gegenteil. Die fehlerbehafteten Maßnahmen im Namen des Jugendschutzes breiten sich aus. Filter, Blocklisten, Altersschranken. Teils durch selbst auferlegte Richtlinien von Plattformen, teils durch Gesetze.

Um diese Entwicklung in einem Wort zusammenzufassen, schlage ich vor, ihr einen Namen zu geben: Den neuen Prüdismus. Damit ist eine Entwicklung gemeint, die Nacktheit und Sexualität pauschal mit Gefahr verknüpft und großflächig aus der (digitalen) Öffentlichkeit verbannt.

Dieser Prüdismus ist nicht nur das Ergebnis von gesellschaftlichen Tabus, sondern auch von technischen Scheinlösungen. Weder Instagram noch Google oder YouTube noch JusProg wollen gerne an die große Glocke hängen, inwiefern ihr Overblocking im Namen des Jugendschutzes systematisch Grundrechte einschränkt.

Fälle von versehentlich blockierten Inhalten werden eher als Ausnahmen geframed, die eben passieren, weil kein technisches System perfekt ist. Ich halte diese Darstellung aber für irreführend, denn die automatisierte Einordnung von Inhalten als „unbedenklich“ oder „schädlich“, die ist strukturell fehlerbehaftet. Maschinen können so etwas nicht. Das sind keine Ausnahmen, sondern inhärente Fehler, die nicht ausreichend transparent gemacht und abgewogen werden.

Algospeak: Hat hier jemand Seggs gesagt?

Und die Betroffenen? Wursteln lieber um das Problem herum, als dagegen zu kämpfen. Ein eindrückliches Symptom dafür ist meiner Meinung nach Algospeak. So nennt man es, wenn Menschen aus Sorge vor algorithmischer Abstrafung darauf verzichten, bestimmte Worte auszusprechen. Zum Beispiel auf TikTok, YouTube, Instagram.

Sie schreiben etwa „Sex“ mit doppel „gg“ statt mit „x“. Oder sie verändern das ausgesprochene Wort „Sex“ im Video-Schnitt, sodass ein Vokal fehlt. Ich versuch das mal kurz vorzumachen:

S–x.

Alles, um nicht einem maschinellen, Stichwort-basierten Filter zum Opfer zu fallen. Sogar öffentlich-rechtliche Angebote machen das. Und sie machen das natürlich nicht, um heimlich nicht-jugendfreie Inhalte an einem Filter vorbeizuschmuggeln. Algospeak passiert aus Resignation. Weil Menschen sagen: Bevor ich irrtümlich im Filter lande und das niemand korrigiert, da mache ich lieber Abstriche in der Freiheit meiner Rede. Ich finde: Das kann doch nicht wahr sein. Filter dürfen nicht bewirken, dass Menschen glauben, sie können Wörter wie „Sex“ nicht mehr frei aussprechen.

Mehr kümmern statt weniger

Ich fordere nicht, dass man sich weniger kümmert oder gar nichts mehr täte, um Minderjährigen im Netz Schutz zu geben. Im Gegenteil, ich fordere, dass man sich mehr kümmert.

Blockaden und Filter im Internet sind kein Übermaß an Fürsorge, sondern ein Mangel an Fürsorge. Algorithmen, KIs und Filter sind billige, fehlerhafte, technische Scheinlösungen, die vielleicht Aufsichtsbehörden und Gesetzgeber zufrieden stimmen. Vielleicht Eltern, die nur die wohl formulierte Funktionsbeschreibung lesen. Vielleicht Investor*innen, die von einer Firma hören wollen, dass sie sich schon gut drum kümmert. Aber bestimmt nicht die Kinder und Jugendlichen, um die es eigentlich geht.

Was braucht es stattdessen? Na ja, zuerst, wenn man denn unbedingt technische Lösungen ausprobieren will, dann sollten sie auf keinen Fall heimlich im Hintergrund agieren. Sie müssen einfach und verständlich transparent machen, was warum geblockt wurde. Und auf jeden Fall müssen sie niedrigschwellige Gelegenheit bieten, dass alle Nutzer*innen sich jederzeit beschweren können und sagen: Hey, hier läuft was falsch.

Darüber hinaus braucht es aber mehr. Und das ist noch wichtiger. Menschliche Fürsorge. Algorithmen, KIs und Filter können das Internet nicht sicher machen. Auf Seiten der Plattformen braucht es sehr viele Menschen, mit fairem Gehalt und professioneller psychologischer Begleitung, die sorgfältig Inhalte moderieren und Meldungen bearbeiten. Und es braucht auf der anderen Seite Zeit und Energie und Medienkompetenz von Eltern und Aufsichtspersonen. Um Jugendliche zu rüsten, für den eigenen Umgang mit Sexualität und Nacktheit… und allem anderen im Internet.

In diese Richtung passiert wenig. Stattdessen greift dieser neue Prüdismus um sich. Und in der EU arbeitet man unter anderem gerade daran, möglichst viele Bereiche des Internets hinter Ausweisschranken zu stellen. Also Schranken für ein Internet, das wir aktuell noch – mehr oder weniger – als offen zugänglichen Raum kennen.

Was es zuerst braucht, ist Sichtbarkeit für die Gefahren durch diesen Prüdismus. Für die vielfältig bedrohten Grundrechte – auch von Kindern und Jugendlichen. Ich befürchte bloß: Bevor es besser werden kann, wird es… erst mal schlechter.

Diesen Eindruck bekomme ich jedenfalls, wenn ich im Internet unterwegs bin und zum Beispiel so etwas hier erlebe: Ich möchte, dass mir DALL-E ein Bild generiert. Der Prompt: „Zwei erwachsene Menschen geben sich einen sanften, einvernehmlichen Kuss“. Im Fernsehen könnte man das ohne Altersbeschränkung senden. Doch die Antwort lautet:

„Diese Eingabeaufforderung wurde blockiert.“

Möglicherweise OT

Vor wenigen Tagen im MDR:

Sexualität und Sozialismus: Kontrollierte Frauen in der DDR

https://www.mdr.de/geschichte/ddr/politik-gesellschaft/gesundheit/sexualitaet-sozialismus-kontrollierte-frauen-tripperburgen-100.html

es ist tatsächlich sehr weit weg vom topic, aber in den MDR-podcast habe ich auch reingehört!

Ist mir tatsächlich total egal. Von den im Artikel erwähnte Services erwarte ich nicht, dass sie in meinem Sinn, manipulationsfrei oder im Interesse einer offenen, sozial gleichbefähigten, usw. Gesellschaft funktionieren.

Wer diese Services nutzt sollte wissen was sie tut und es -nicht tun- wenn man damit nicht einverstanden ist. Von diesen Anbieter zu erwarten, dass sie im eigenen Interesse oder wenigstens nicht gegen das eigene Interesse handeln, wie kommt man darauf?

Wen stört es die Jugend zu schützen das Internet und Smartphone sind Erwachsenen kram!

Heißt die Eltern sind verantwortlich wie wo und wann deren Schützlinge das Internet benutzen.

Es gibt doch bei der Telekom O2 1&1… etliche Tarife oder anderen Schnickschnack und sonst gibt es ja auch etliche kniffe den altmodischen Internetuser bsp mit Geoblocking zu gängeln .

Dumm und Dümmer geht immer es geht vor allem darum das Internet unter sich aufzuteilen und den normalo User der schonmal besseren Zeiten kannte auszubooten.

Dieser dämliche Status-Fetisch vom WorldWideWeb bei dem personifizierte Oberflächlichkeit alle Fachkompetenz und guten eigenschafften zu einem Gängelungskonstrukt verkommen.

Es gibt das WorldWideWeb es ist viel größer die Welt dreht sich auch ohne dich es ist bzw war voll mit nützlichen Tools Programmen Zusatz Inhalten Musik Filmen und Lexika……).

Und einer geschichtlichen Biographie zum Anklicken muss alles eine bisschen verkleinert werden damit sich narzisstische Egoismen nicht so klein vorkommen.

Ein weiteres relevantes Beispiel ist Pinterest. Hier werden E-Mails mit der Androhung von Account-Sperre verschickt, weil man vor zig Jahren irgendwann einmal Bilder in seine Pinnwände zugefügt hat, die man – wohlgemerkt auf Pinterest selbst von anderen Beiträgen – gefunden hatte und die ebenso viele Jahre völlig unbeanstandet geblieben waren. Dort ist mittlerweile auch der sichtbare Umriss von Genitalien tabu, aber auch ganz unspezifisch Abbildungen, die Pinterest als „Fetisch“ bezeichnet, ohne das jedoch näher einzugrenzen.

Ganz konkret waren das in meinem Fall *immer* vollständig bekleidete menschliche Wesen. Keine Menschen in sexy Reizwäsche oder gar sexualisierte Darstellungen. Aktabbildungen sind dort ohnehin schon lange gebannt. Die Umrisse von Genitalien waren teilweise zu erahnen, zum Teil waren es aber einfach nur normale Ausbuchtungen in den entsprechenden Bereichen. Meiner Meinung nach zu 100 % willkürlich, denn fast jeder meiner Widersprüche gegen die Blockierung endete mit einer Freigabe der Inhalte nach Überprüfung. Bei Pinterest ist es also ähnlich überblockiert, wie bei Twitch: Sobald durch ein gut sitzendes Kleidungsstück irgendwo eine sichtbare Ausbuchtung ist, kann (und wird häufig auch) blockiert werden.

Yahoo und Flickr haben auch bereits vor Jahren Nacktheit und Nippeln den Kampf angesagt und sind heute in der Folge mehr oder weniger bedeutungslos geworden. Mögen diese hier aufgezählten Dienste ihnen doch bitte folgen; schnell!

Gibt auch das Beispiel Google Maps

Ich schreibe seit 10 Jahren Rezensionen auf Google Maps. Die Hälfte meiner Rezensionen wurde von einer KI auf „nicht veröffentlicht“ gestellt. Jeder Einspruch dagegen wurde innerhalb von 5 Sekunden zurück gewiesen. So geht es nicht nur mir sondern tausenden weiteren Schreibern von Rezensionen (findet man leicht per Google Suche die entsprechenden Threads)

Ich habe aufgehört auf Google Maps Rezensionen zu schreiben und zu lesen, seit ich weiß, dass eine vollkommen inkompetente KI für die Bewertungen zuständig ist. Ich habe keinerlei Vertrauen mehr in die Bewertungen bei Google Maps

Prüdismus ist ein hübsches neues Wort für Prüderie. Ich bin gespannt, wann es im Duden steht.😉

Nicht zu vergessen, digitale Unterhaltungsplattformen ob nun Film oder Plattformen für digitale Spiele. Letzere betreiben seit einiger Zeit ihren großen Kreuzzug gegen nackte Haut und es dürfte sich bereits bei vielen herumgesprochen haben, dass hier mit Hilfe von Geoblockaden im großen Stil gearbeitet wird. Kommunikation und Transparenz gegenüber Kunden gleich 0. Es gibt Vorgaben von Microsoft

Und während die Menschen sich für jedes Produkt einzeln beschweren, dabei noch in Kauf nehmen gebannt zu werden, werden Themen geschlossen, diskreditiert oder gehen unter.

Es werden auch unmissverständliche Punkte von großen BigTech Unternehmen Entwicklern nahegelegt wie z.b. Microsoft GameDEV zeigt https://archive.is/97j6H

Der extreme Trend besteht nun seit ca. 4 Jahren, gesteuert und grade in den „sozialen“ Medien ist das Thema von viel Wirbel durch unqualifizierte Äußerungen durch Reddit und Co begleitet und einer Fraktion. Nackte Haut, Auschnitt? Square Enix zensiert diese aktuell z.b. für Vielleicht sogar mal nen freies Bein oder mehr? Teufelei. Denkt doch an die Kinder. Die fiktive Figur von Lara Croft ist hierfür ein Paradebeispiel die zahlreiche Änderungen durchmachen musste.

Spielfiguren sehen immer androgyner aus, selbst Filme bleiben nicht verschon. Oberweiten werden verkleinert, Kleider werden länger, selbst männliche Merkmale verschwinden nahezu gänzlich. Und das gemischt mit einer politischen Nachricht, dass alles und jeder nicht benachteiligt wird. Standardmuster sind nun Asiaten, Latinos, Amerikaner/Europäer und Afrikaner in Unterhaltungsprodukten wo man sich oftmals fragt wie das überhaupt funktioniert, rein der Logik nach was einem vorgesetzt wird.

Das gesamte Konstrukt was derzeit aufgezogen wird, ist krank und vielen ist es egal oder sie diskutieren nur.

Wenn man den Ansatz, zwischen männlichen und weiblichen Brustwarzen zu unterscheiden schon bei Erwachsenen für Blödsinn hält – Meta macht die gleiche Unterscheidung sogar bei Kindern: https://transparency.meta.com/de-de/policies/community-standards/child-sexual-exploitation-abuse-nudity/

> Mir ist das vergangenen Herbst zufällig aufgefallen, als ich einen älteren Artikel googeln wollte, um ihn in einem neuen Artikel zu verlinken.

Die Snowden-Enthüllungen sind über ein Jahrzehnt her. Warum suchen Journalisten trotzdem noch immer über Google? Haben die das alle verschlafen oder schon wieder vergessen? Das ist hier der Elefant im Raum.

> Nein, sie müssen sogar aktiv nachweisen, dass sie ihre Körper ordnungsgemäß verhüllt haben.

Es wäre lustig, wenn die ganzen Streamer (ob Mann, Frau oder sonstwas) Twitch verhöhnen würden in dem sie sich in Burkas hüllen und auf Nachfrage sowas antworten würden wie: „Twitch will, dass ich ordnungsgemäß verhüllt bin. Wenn eine Burka für diese rückständigen Spießer keine ordnungsgemäße Verhüllung ist, dann weiß ich auch nicht weiter.“