Jetzt isses soweit: Ich glaube, Text-zu-Bild-Generierung wird ein großes Ding. Die Technologie wird verändern, welche Bilder wir in unserem Alltag sehen und wie wir mit Bildern kommunizieren. Sie wird unsere Fantasie auf das nächste Level bringen und künftige Generationen werden uns belächeln, wenn sie hören, dass wir tatsächlich ein Leben ohne diese Technologie geführt haben.

Aber der Reihe nach. Text-zu-Bild-Generierung heißt, eine Software bekommt einen Textbefehl und wandelt ihn in ein Bild um. Sie wurde massenhaft mit Bildern und Bildbeschreibungen gefüttert, damit sie am Ende selbst aus einer Beschreibung ein eigenes Bild formen kann. Als Textbefehl eignen sich nicht nur Motive, sondern auch Stile und Formen wie Foto, Gemälde, Zeichnung. Zum Beispiel: Tokio im Stil von Claude Monet, Öl auf Leinwand. Voilà.

Viele nennen das Künstliche Intelligenz. Mitunter sehen künstlich generierte Bilder zusammengepanscht und misslungen aus. Vor sechs Jahren hatte ich für den SPIEGEL über eine rudimentäre Text-zu-Bild-Software geschrieben. Die Bilder waren so – naja. Doch seit einer Weile sind künstlich generierte Bilder revolutionär.

Gleich mehrere Anbieter arbeiten gerade an neuartigen Text-zu-Bild-Generatoren. Seit einer Weile kursieren Bilder von DALL-E 2 in sozialen Medien. Kostenlos für alle ist DALL-E 2 aber derzeit nicht zugänglich. Mit StableDiffusion ändert sich das. Die Software ist seit dieser Woche für alle verfügbar und läuft auch auf dem eigenen Rechner. Noch braucht es für die Einrichtung etwas Geduld, Klickarbeit und eine entsprechende Grafikkarte. Aber fast täglich erscheinen neue Schritt-für-Schritt-Tutorials, Entwickler:innen tüfteln an grafischen Nutzungsoberflächen, und erste Anbieter machen StableDiffusion über den Browser zugänglich.

Ich glaube, das geht jetzt sehr schnell. Deshalb lehne ich mich heute weit aus dem Fenster und formuliere vier Prognosen über die Zukunft mit Text-zu-Bild-Generierung.

Prognose 1: Unsere Welt wird buchstäblich schöner

So etwas liest man selten auf netzpolitik.org, aber ich blicke mit Begeisterung und Optimismus auf unsere digitale Zukunft, zumindest in Sachen Text-zu-Bild-Generierung. Halbherzig bebilderte Online-Artikel, schnöde T-Shirt-Motive, hingerotzte CD-Cover, Stockfotos aus der Hölle – all das und mehr kann bald der Vergangenheit angehören.

Dank Text-zu-Bild-Generierung können alle in kurzer Zeit erstaunlich schöne Bilder erschaffen. Nicht mehr handwerkliches Unvermögen wird der Grund für die fade Bebilderung unserer Umwelt sein, sondern allein fragwürdiger Geschmack. Und das ist ein Riesenfortschritt.

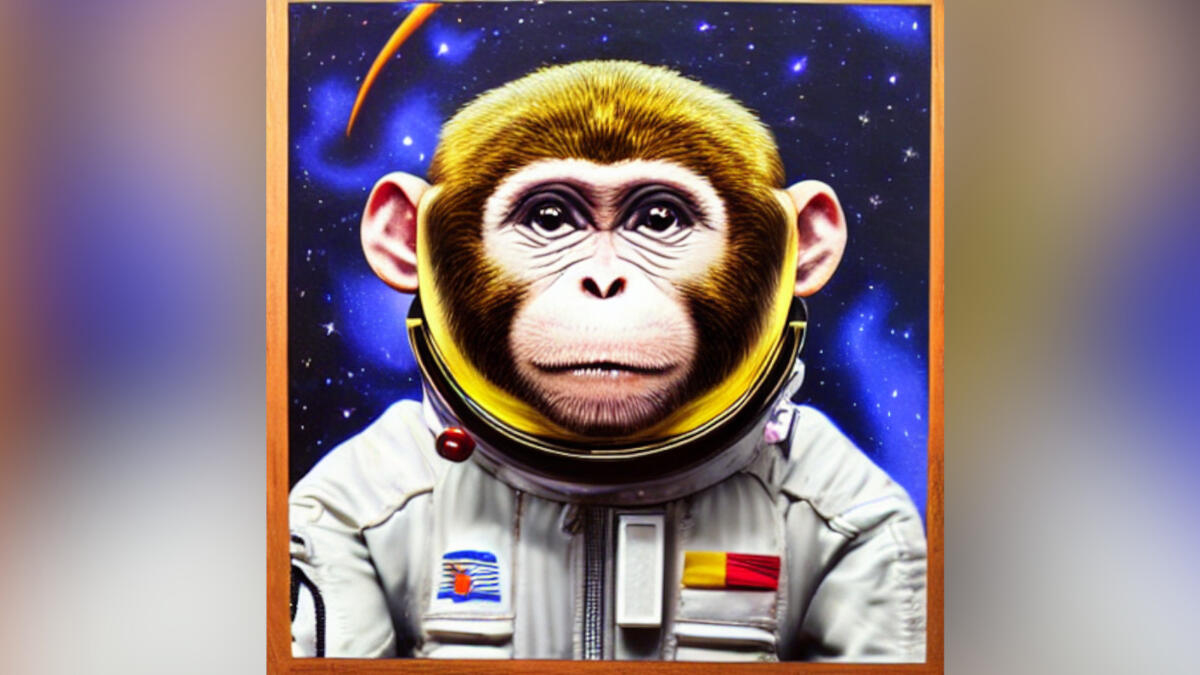

Heute ist es Alltag, den Liebsten mal eben ein Gruppenselfie zu schicken oder einen Schnappschuss vom Essen. Wenn wir etwas teilen wollen, das wir gerade sehen, machen wir einfach ein Foto. Künftig wird es auch möglich sein, zu teilen, was wir uns gerade vorstellen. Hey, ich habe gerade an einen Weltraum-Affen gedacht – und da ist er auch schon. Unser Leben im Netz wird kreativer und bunter, wenn wir praktisch per Knopfdruck unsere Fantasie manifestieren können.

Prognose 2: Die Technologie wird Bilderdurst wecken

Als ich ein Junge war, hat mich ein Bild aus der TV-Zeitschrift Hörzu in seinen Bann gezogen. In der Rubrik „Original und Fälschung“ fanden Leser:innen zwei Versionen eines bekannten Kunstwerks und sollten in einer davon zehn versteckte Fehler erkennen. Das Bild, von dem ich nicht mehr loskam, war Edward Hoppers Gemälde Nighthawks. Drei Gäste und ein Barkeeper schlagen sich in einer verglasten Bar die Nacht um die Ohren. Ich war bezaubert von der kontemplativen Einsamkeit, die aus dem Bild sprach, und wollte unbedingt mehr davon.

Heutzutage würde man einfach googeln, sich andere Werke von Hopper anschauen, und merken, dass es ziemlich Mainstream ist, ausgerechnet „Nighthakws“ abzufeiern. Damals hatte ich, glaube ich, weder Zugang zu einem Computer noch zum Internet. Ich bin in die nächste Stadt gefahren, um in einer Buchhandlung einen Bildband zu finden. Den Aufwand war es mir wert. Erst mit diesem Bildband konnte ich meinen Bilderdurst stillen und mich in die anderen Werke von Hopper vertiefen.

Mit Text-zu-Bild-Generierung lassen sich solche Anflüge von Bilderdurst auf ganz neue Art ausleben. Faszinierende Bilder lassen sich nicht nur suchen und betrachten, sondern auch selbst erstellen. War ja klar, dass ich sofort ausprobieren musste, ob StableDiffusion einen Waschsalon im Stil von Edward Hopper darstellen kann. Kaum zu glauben, dass Hopper nie selbst einen Waschsalon gemalt hat.

So einen Bilderdurst habe nicht nur ich. Auf Reddit und Twitter posten massenhaft Nutzer:innen ihre ersten Kreationen mit unter anderem DALL-E 2 und StableDiffusion, und sie schreiben sich gegenseitig, wie begeistert sie sind. Ich glaube, angetrieben von Bilderdurst wird eine Welle an fantasisevollen Kreationen durchs Netz spülen. Das wird das Lebensgefühl im Netz mitbestimmen, bis sich alle daran gewöhnt haben, dass sie so etwas jetzt einfach immer tun können.

Prognose 3: Nach einer Debatte wird die Technologie akzeptiert werden

Die Debatte ist jetzt schon da, und sie wird weiter rollen: Was, wenn Menschen mit Text-zu-Bild-Generierung strafbare Motive erschaffen, die anderen schaden? Volksverhetzung und Hakenkreuze. Sexualisierte Gewalt gegen Minderjährige und nicht-einvernehmliche Deepfakes. All das gibt es schon jetzt, doch Text-zu-Bild-Generierung kann bewirken, dass sich solche Aufnahmen noch leichter erstellen lassen. StableDiffusion hat zwar Vorkehrungen getroffen, um Motive mit Nacktheit zu unterbinden, doch längst kursieren Anleitungen, wie man diesen Schutz-Mechanismus entfernt.

Es ist eine Debatte mit zwei Fraktionen, die sich wohl bei jeder neuen Technologie wiederholt. Eine Fraktion wird darauf pochen, dass die Technologie neutral sei und es in der Verantwortung von Nutzer:innen liege, nichts Böses damit anzustellen. Eine andere Fraktion wird die neue Technologie für gesellschaftliche Probleme veranwortlich machen und starke Regulierung fordern, um jeglichen Missbrauch zu verhindern.

Ich glaube, es gibt einen guten Grund, warum sich diese Debatte immer wiederholt: Manchmal haben die einen Recht, manchmal die anderen. Es kommt drauf an, in welchem Ausmaß sich gesellschaftliche Probleme bloß in einer neuen Technologie spiegeln (nicht so schlimm), und in welchem Ausmaß die Technologie gesellschaftliche Probleme verstärkt oder gar erzeugt (schlimm). In einer Gesellschaft mit ungleich verteilten Privilegien gibt es Technologien, die vulnerable Gruppen übermäßig schwächen. Manches sollte man besser nicht auf die Menschheit loslassen.

Bei frei verfügbarer Text-zu-Bild-Generierung überwiegen meine Bedenken derzeit nicht. Ähnlich wie bei Handy-Kameras für alle oder Bildbearbeitung für alle glaube ich: Was Menschen mit dieser Technologie letztlich tun, ist kaum vorgezeichnet und hinreichend offen, um das Experiment zuzulassen. Ich finde es verantwortbar, wenn alle Zugang zu dieser Technologie haben. Ich wage die Prognose: Die Fraktion, die vor allem die Nutzer:innen in der Verantwortung sieht, wird die Nase vorn haben.

Prognose 4: Es wird etwas völlig Überraschendes passieren

Selten machen Menschen mit Technologie das, was man sich vorher vorgestellt hat. Star Trek hat früh vorhergesehen, wie Computer das Wissen der Menschheit für alle zugänglich machen. Sogar Sprachsteuerung gab es schon, während die Zuschauer:innen noch Kabeltelefone mit Wählscheibe zuhause hatten. Aber Star Trek hat übersehen, dass Menschen mit Computern Informationen nicht nur abrufen werden, sondern auch generieren. In dem fiktiven Universum fehlen soziale Medien, einer der lustigsten blinden Flecken in der Science-Fiction-Geschichte.

Ich glaube, bei neuen Technologien gibt es immer diese eine Ecke, um die man nicht herumdenken kann. Was morgen schnöder Alltag ist, liegt heute jenseits der Vorstellungskraft. Bevor TikTok zur meistgehypten Video-Plattform der Welt wurde, hat man mir an der Journalist:innenschule beigebracht: Hochkant-Videos funktionieren nicht und sind peinlich. Lol.

Stand jetzt sind bei mir noch viele Fragen offen: Was bedeutet die Technologie für den Beruf von Künstler:innen und Grafik-Designer:innen? Wird es eines Tages sehenswerte Buchverfilmungen geben, die allein per Software entstanden sind? Meine Prognose über die Text-zu-Bild-Generierung lautet: Auch dieser Text wird mal eine Lachnummer werden, weil ich etwas übersehe, das sich erst später als offensichtlich herausstellt.

FACT

FAKE

Wie sollen wir in Zukunft Realität von Fiktion unterscheiden ( was essentiell ist für funktionierende Demokratie und Rechtsstaatlichkeit ), wenn alle ganz begeistert davon sind, dass jeder wie wild effekt-heischend herumschraubt: Millionen Fiktionen, nur eine Realität – schwer, die eine zu funden… ?

ganz einfach wir vor 60 Jahren, als es noch keine TV’s gab, echte Erlebnisse werden wieder an Wert gewinnen. Ich finde es gut.

Ja, das ist einerseits eine coole Möglichkeit, andererseits wird sie, ebenso wie Deep Fake, das Leben deutlich erschweren. Wir sind Wesen, die dem, was sie „selbst gesehen haben“ den höchsten Stellenwert beimessen. Das ist dann vermeintlich ein Abbild von Realität. Wir glauben, dass sei objektiv wahr. Und nur bei Zaubervorstellungen ist uns bewusst, dass es da irgendeinen Trick geben muss. Und wir rätseln, wie der Illusionist das hinbekommen hat.

In unserem Alltagsleben fehlt aktuell die Option, alles anzuzweifeln, was man sieht. Das wäre dann der Beginn einer Paranoia.

Vielleicht erinnert sich jemand noch an den Film „Wag the Dog – wenn der Schwanz mit dem Hund wedelt“: Um von der sexuellen Belästigung einer Praktikantin abzulenken, beauftragt der amerikanische Präsident Mr. Fix-it Brean, das Problem zu lösen.

„Brean sieht die einzige Möglichkeit darin, die Aufmerksamkeit der Medien auf einen (fiktiven) Krieg zu lenken, den er mithilfe des Filmproduzenten Motss in Szene setzt. Die Wahl fällt auf Albanien als Gegner, weil die Öffentlichkeit über dieses Land nichts weiß. Im Studio werden angebliche Augenzeugenberichte produziert, woraufhin in den Nachrichten die Meldung verbreitet wird, die USA zögen gegen Albanien in den Krieg, nachdem albanische Terroristen eine Atombombe in einem Koffer versteckt in die USA schmuggeln wollten.“

(Wikipedia)

Der Film kam vor der Lewinski Affäre von Bill Clinton ins Kino. Da sieht man wieder, wie die Realität die Fiktion einholt.

Und der Krieg gegen Saddam Hussein und den Irak wurde auch durch Fake News und angebliche Bilder von Chemiewaffenfabriken im Irak gestartet.

Das passiert, weil die Leute glauben, dass das Gesehene real sei.

Vielleicht ist diese Text to Picture Geschichte nur ein cooles Tool und ermöglicht es, „abstrakte Zeichen“ –> Text in eine Bildergeschichte zu konvertieren.

Wird das dann das Analphabetentum verstärken?

Andererseits: ein Bild sagt mehr als tausend Worte. Bilder transportieren sehr viel Information innerhalb Sekundenbruchteilen.

Aber unterwandern damit den kognitiven Filter, der beim Lesen eingeschaltet ist. Subliminal gewissermaßen. Unterhalb der Wahrnehmungsschwelle.

KI kann also tolle Bilder generieren, mittlerweile auch glaubwürdige Texte schreiben (Siehe GPT3) und die KI von Github kann zig Programmiersprachen nahezu perfekt auf Zuruf programmieren.

D.h solche Sachen wie Webdesign oder APP Programmierung etc werden sich bald automatisieren lassen. Dann wird es doch einmal Zeit über das Bedingungslose Grundeinkommen nachzudenken. Denn viele Jobs die gute Bildung erfordern sind dann plötzlich recht leicht automatisierbar.

> nahezu perfekt

Nein. Die KI rotzt dir irgendeinen Scheiß hin, der auch noch in 4 von 10 Fällen Sicherheitslücken aufweist. Entwickler, die sich für ihr Projekt blind darauf verlassen, sind faul oder inkompetent. Der einzige legitime Verwendungszweck, von dem ich bisher gehört habe, ist Prototyping von Anwendungen, die dann auch _weggeworfen_ werden.

https://www.spiceworks.com/tech/security/news/40-of-code-produced-by-github-copilot-vulnerable-to-threats-research/

Nicht zu vergessen ist auch, dass Copilot u.a. mit GPL-Sourcecode trainiert wurde und der Beef wegen angeblicher Lizenzverletzung immer noch schwelt. Copilot für ein zu veröffentlichendes Produkt zu verwenden, birgt Risiken.

Es fällt mir wirklich schwer nachzuvollziehen wieso Fiktion und Realität bei einigen Themen immer gleichgestellt wird und bei anderen nicht. Würde jemand diese Gleichstellung mit einer Ermordung tun, so würde man ihm Verharmlosung unterstellen (oder wie vor kurzem die Äußerungen eines Botschafters bzgl. Israel)

Meine Prognose zu dieser Technologie ist eher negativ. Man sieht es ja bereits an NFTs. Es wird sicherlich von vielen genutzt werden, aber in Anbetracht der Tatsache das die Generierung und immer frei Verfügbarkeit die geschaffenen Werke sehr entwertet. Hinter Menschen gemachten Bildern steckt Talent das man wirklich begeistern kann und hinterfragen „Welche Technik? Was sagt das Bild aus?“

niemand hindert dich deine Bilder in welcher Technik auch weiterhin immer ohne Ai zu malen,

wo ist dein Problem?

Angst die Ai malt besser wie du?

Das ist keine KI, das ist Machine Learning, also Mustererkennung und Musterreproduktion.

Lernen wird von beiden Arten der Intelligenz angewandt, natürliche und künstliche Intelligenz. Erstere macht es nur auf wesentlich besserem Niveau.

Inzwischen gibt es auch Bemühungen für KIs, die nicht mehr mit massenhaft menschengemachten Labels gefüttert werden. Stattdessen lernt die KI „von alleine“: https://www.sciencealert.com/ai-has-discovered-alternate-physics-on-its-own

Das ändert nichts an der Diskussion. Deswegen machen einige die unterscheidung schwacher gegenüber starker KI.

Ob die Diskussion hier sinnvoll ist, will ich nicht einschätzen. Machinelearning ist allerdings auch durchaus eine Art von Fachbegriff. Ein System wie AlphaGo lernt nur, ohne Daten, allerdings mit Wissen über die Regeln, ist aber in keiner Weise „intelligent“. Mustererkennung ist zwar überall vorhanden, inklusive Artefakten, allerdings würde ich selbst das nicht mit Machinelearning gleichsetzen. Die Bestrebungen, Systeme zu bauen, die im Grunde wie Machinelearningsysteme funktionieren, bzw. „das“ leisten, aber mit sehr wenig Trainingsdaten auskommen, gibt es natürlich. Das wiederum ist aber nicht per se ein selbstlernendes System. Usw. usf.

Manche wollen den Begriff KI nun mal für das reserviert wissen, was andere „starke KI“ nennen. Dem Fachbereich KI ist Machinelearning allerdings alles andere als fremd (usw. usf.).

Machine Learning entpricht Ueben und Trainieren, es entspricht nicht dem darueber hinaus gehenden verstehenden Lernen mit Bildung eines Weltverstaendnisses einer echten Intelligenz.

Das Beispiel ist uebrigens ganz nett, um das zu demonstrieren. Es gibt keine „alternate physics“. Auf 4.7 statt 4 Freiheitsgrade zu kommen ist ein fundamentales Fehlverstaendnis, das das System mangels Reflektionsmoeglichkeit nicht erkennen kann.

Bei Künstlern wäre ich im Allgemeinen auch nicht so sicher.

Hier fragt man also nach der Intention (Realismus, wieviel?). Das gebaute System ist sicherlich ein Prototyp, dem es an Ausgestaltung und Training fehlt.

„Tokio im Stil von Claude Monet, erstellt mit StableDiffusion.“ Sicher? Sieht eher nach Shanghai aus.

Ja sieht so aus, StableDiffusion hat einfach was anderes aus dem Textbefehl „Tokio“ gemacht.

Was das verändern wird?

1. Noch eine App mit Cloudanbindung.

2. Werkzeuge für Kreative (Unternehmer).

Ansonsten:

– „Kreative“ benutzen bereits die digitalen Möglichkeiten des Renderings, die bereits jetzt umfassend sind.

– Einige haben bessere oder teurere Werkzeuge, mit denen sie noch besser bzw. schneller ähnlich gut arbeiten können.

– Text-zu-Bild wird ein neues Werkzeug in deren Baukasten, welches angepasst zur Auswahl der 3D-Modelle oder für Post eingesetzt werden könnte, „wenn man mal einen lustigen Filter braucht“.

– Der Abstand zu den Kreativen wird sich nicht verkleinern. Aber es werden mehr arbeitslos, während immer weniger gut ausgerüstete den Markt bespülen.

– (Alternativ: Micropayment Plattformen für Ideen und kleine Umsetzungen werden erlaubt und z.B. nicht von Hartz-4 abgezogen. Jetzt müssen nur noch die Suchmaschinen tatsächliche Funktion erfüllen, damit die Menschheit nicht einfach nur in sogenannten Inhalten untergeht. Bisher sind wir da bei Mau/Mau.)

Es könnte allerdings schon das Segment der lower-budget „Visual Novel“ Produktion boosten, da ein Drehbuchschreiber vielleicht schon bald keinen billigen Renderwilligen mehr braucht, jedenfalls nicht für die Bildgestaltung. Dafür muss das Werkzeug aber in Kontexten bleiben, und z.B. die Figuren in einer Erzählung stringent wiederholt umsetzen, bzw. allgemeine Vorgaben umsetzen können. Zumindest für Prototypische Storyboards wäre das schon interessant. Der Boost wird also ein Cloudboost sein, zugunsten eines neuen Geldsäckles, geschätzt bis zu Fünf davon.

>>> Deutungswürdig: So stellt sich StableDiffusion „netzpolitik.org im Jahr 2070“ vor.

Der Weißhaarige war eben schon alt. Oder sieht er nicht ein bischen wie Assange aus?

>>> Aber Star Trek hat übersehen

Naja, vielleicht auch nicht. Immerhin liegt das ein oder andere Jahrhundert dazwischen, und die Gesellschaft vor Erfindung des Warpantriebes sah auf dem Schirm bereits etwas abgefleddert aus. Allgemein in Star Trek haben eigentlich alle Kommunikatoren und der direkte Kontakt wird in der Kultur vielleicht viel höher bewertet als z.B. textuelle Andeutungen darüber, während Informationen und Fakten direkt der Allgemeinheit zugänglich gemacht werden. „Der Computer“ ermöglicht sicherlich auch Logbücher und deren Auswertung für alle jew. für sich. Tratsch läuft dann eben 1:1. Statt Film und Computerspiel gibt es gibt nun mal das ultrarealistische Holodeck (man frage mich nicht nach der Auslastung), wo man selbst im Film/Spiel mitmachen kann, also die Evolution, von der wir noch träumen. Kann gut sein, dass in der Gesellschaft also 2D-Filme und Spiele derart out sind, dass sie in Star Trek zu zeigen, inetwa so wäre, wie „mehr Einradfahrer“ auf den Gängen von Raumschiffen und Stationen fahren zu lassen. Und vom Holodeck „abwärts“ gibt es vielleicht ja auch ähnliches in abgespeckt für das Quartier – Filme können nun mal oft schon wegen der begrenzten Zeit nur andeuten bzw. einzelne Aspekte herausstellen.

Ich würde allerdings schon sagen, und da zählen „soziale Medien“ (nicht unbedingt wie wir sie heute „kennen“) mit rein, dass Informationsmedien bei Sci-Fi Filmen insgesamt oft kurz kommen, und meißt bestenfalls angedeutet werden, also auch Zeitung oder Blogs mit Expertise – Werbetafeln und Produktplatzierung gibt es doch oft. „Soziale Medien“ fehlen meiner Meinung nach daher eher in Szenarien, in denen es sowas wie Zeitung oder Fernsehen gibt, also eher in allen möglichen anderen Filmen außer Star Trek.

> In dem fiktiven Universum fehlen soziale Medien, einer der lustigsten blinden Flecken in der Science-Fiction-Geschichte.

Das ist eine interessante These. Hier ist eine Alternative.

Im fiktiven Universum vom Star Trek gib es (in der Föderation) kein Geld. Angehörige der Sternenflotte beziehen kein Gehalt. Gesellschaftliche Anerkennung und Erfolg bemisst sich daran, wie sehr sich ein Individuum für die Gesellschaft einbringt.

Wie würde Social Media wohl aussehen, wenn Geltungssucht und Selbstbeweiräucherung nicht mehrheitlich praktiziert wird? Passt ein sinnvoller Beitrag dann noch in 140 Zeichen?

Wo kriegt denn das Ding seine Daten her? „Mal mal eine Kuh auf der Wiese!“ Es gibt Milliarden mehr unterschiedliche Kühe und Wiesen, als je dokumentiert werden können. Und was eine Wiese ist, ist auch nicht zu standardisieren. Für A ist es ein ungepflegter Hunderasen, für B ein sich ständig wandelnder Lebensraum für abermilliarden Individuen. Also wird das generierte Bild immer banal und ein Spiegel der Interpretation durch den oder die jeweils zuständigen Programmierer Creative-Directors?) sein. Wie doof…

Interessanter Gedanke. Womit werden diese Systeme trainiert? Wieder mal knallharter gender/race bias?

Das ist so ein Knackpunkt.

Es bräuchte alle Daten und mehr. Beim Copyright wird es dann interessant, weil z.B. ein generiertes Bild durchaus Rechte anderer verletzen könnte. Mit Copyright kann es „die Revolution für alle“ schon deswegen nicht geben. Uber-mäßig „natürlich“ schon, erstmal illegal alles plattmachen, dann Geld zählen, Grüße an die Amazonasregion. Generierte Bilder sollten auch kein Copyright haben können, wie bei Musik? Wir kommen da eben in ein anderes Modell…

Es wird wohl strukturierte Datenverarbeitung und Aufbereitung betreiben müssen, also z.B. Terrain simulieren und „passend verwenden“. Letztlich also eine Mischung aus Rendering und Aufhübschung, in Iterationen, mit Auswahl von Modellen, eventuell auch Iterationen von Auswahl und Verwerfung. Im Grunde ist es das wohl schon, in gewisser Weise, nur noch stark vereinfacht.

Das Training von Modellen wie GPT-n oder Dall-E 2 oder StableDiffusion verbraucht extrem viel Rechenkraft und damit Energie, um trainiert zu werden. Die daraus resultierenden negativen Konsequenzen für die Umwelt, verleihen der “Intelligenz” dieser Technologie ein zweifelhaftes Helden-Image.

Auch die Erstellung der neuen Inhalte verläuft nicht emissionsfrei.

Aber vielleicht schenkt uns ja die beim Author des Artikels so große Begeisterung weckende KI demnächst einen funktionierenden Fusionsreaktor, wer weiß.

Hallo Sebastian Meineck,

vielen Dank für diesen interessanten Artikel. Es ist sehr interessant wie vieles aus diesem Feld gerade. Aber es reicht halt nur aus um Inhalte eines Teenagers mit 200 bis 300 Stunden Erfahrung zu ersetzen.

Unter den Bildern dieser KI sind einige gute Ansätze, aber sie alle haben Alienlike Fehler, die so in der Physik nicht möglich sind und einem Menschen sofort auf fallen. Manche Bildern wirken wie von einer Künstler:in auf Droge, andere haben halt starke Fehler. Ich denke da sind die Kamera-Apps und Hautglättungs-Algoithmen weiter, welche echte Bilder optimieren müssen unter seltsamen Lichtbedingungen.

Es ist beeindruckend und viele Bilder auch sehr gut. Doch wie in jeder Kunst, müssen erst mal 100erte Aufnahmen gemacht werden oder Bilder aussortiert werden um ein besonderes hervor heben zu können. Somit ist es in Erster Linie halt einfach nur Stromverschwendung.

Denn es gehört mehr dazu Werke zu schaffen. Hier stimmen aufgrund von fehlender Raum-Information leider sehr oft z. B. die Proportionen oder die Lichtverhältnisse nicht.

Dennoch ist diese Entwicklung beeindruckend. Aber es verändert nichts, außer die Stromrechnung.

Grüße Chris

Du solltest Dir mal die verschiedene Stilarten der Malerei angucken und das mit den „Fehlern“ ueberdenken. Statt die Bilder mit der Erwartungshaltung aus der Initialisierung zu vergleichen, sollte man fairerweise Werkimmanent interpretieren.

Kunst ist, was andere als solches bezeichnen. Grosse Kunst ist, was andere teuer bezahlen wollen. Alles andere liegt im Auge des Betrachters.

Hallo Anonymous,

vielleicht hast du recht. Aber mich stört es sehr oft leider. Wenn die schärfe nicht passt, wenn Farben zu stark und satt sind. Wenn es möglich ist Bilder so zu personalisieren das diese nur für bestimmte Menschen oder Zielgruppen attraktiver wirken und so weiter..

Es mag auch noch Kunst sein. Doch es wäre halt nicht perfekt. Daran störe ich mich und unter dem Aspekt waren die Künstler:innen der letzten 200 Jahre schon mal weiter, als es diese KI aktuell ist. Gut möglich das jena nach 30 Jahren training ebenso unfassbar gut sein wird, wie es Gruppen von Künstler:innen mit Photorealistischen Inhalten im 17. bis 18. Jahrhundert waren.

Ich denke aber eher, führt so ein Werkzeug halt dazu das Information und Fertikgkeiten verloren gehen, oder sich gar nicht erst in einer bestimmten Qualität entwickeln können. Weil man es halt berechnen kann, ein Foto machen und darauf dann 300 Stunden aufwenden könnte um zusätzliche gute Abstraktionsschichten auf zu tragen. Ja da ist dann der Stormverbrauch und die Algorithmen günstiger.

Doch ihr fehlen (aktuell) die Wurzeln für eine Nachvollziehbarkeit der Physik unserer Welt. Aber diese hat ein Kleinkind ja auch nicht. Es bleibt spannend.

Der Grund warum ich gegen die Euphorie an der stelle war, sollte lediglich verdeutlichen welche Information und Energie/Erfahrung durch Training von echten Menschen in anderen Kunstwerken steckte.

Schau dir die NFTs an, wofür manche viel Geld ausgeben. Mit Kunst hat dieses Copy and Paste leider sehr oft nichts zu tun.

Grüße

Chris

„Die Kuenstler:inner der letzten 200 Jahre“ ist dann allerdings Deine sehr exklusive Definition von Kunst. Kann man machen, ist halt beliebig ausschliessend.

Was ist eigentlich aus der Idee geworden, *nur* den Text hinzuschreiben und das Bild in der Phantasie der Leserin entstehen zu lassen?

Phantasie laesst sich nicht monetarisieren.

Wie sieht das eigentlich mit dem Copyright an solchermaßen erstellten Bildern aus?

Nun, ich bin zwar fast eingeschlafen, aber hier scheint ein umfassender Artikel für die EU-Sicht zu sein:

https://www.gevers.eu/blog/artificial-intelligence/artificial-intelligence-ai-the-qualification-of-ai-creations-as-works-under-eu-copyright-law/

Der referenzierte US-Fall wird bei Techdirt gut behandelt:

https://www.techdirt.com/2022/02/22/us-copyright-office-gets-it-right-again-ai-generated-works-do-not-get-copyright-monopoly/

Ich sage es mal so: dass zusammengewürfelte Bildinhalte/-stile durchaus in der Lage sein könnten, bspw. Stockfoto-Datenbanken den Rang abzulaufen, sagt über die Relevanz und die momentane Verwendung von Bildern („dokumentarische“ Fotos vom Schlage „Politiker steht irgendwo vor etwas oder neben jemanden“ mal mit eingeschlossen) mehr als über die Qualität der KI-Bilder an sich.

„StableDiffusion hat zwar Vorkehrungen getroffen, um Motive mit Nacktheit zu unterbinden,“

Zensierende Blockwarte zensieren. wissenschaftler hingegen untersuchen die Tatsachen. Haben sie getan und festgestellt, dass umso weniger sexuelle Gewalt entsteht, je mehr Pornosgraphie zur freien Verfügung steht. Heißt: die ganzen Zensoren, die Nacktheit für eine Ausgeburt des Teufels halten, leisten der sexuellen Gewalt Vorschub. Genau gegenteilig wäre es richtig. So viel Nacktheit wie möglich, Pornographie für alle zugänglich, das würde die sexuelle Gewalt verringern.

Also doch keine Kunst!

Das wird zB bei antiken griechischen Vasen oder indischen Ornamenten anders gesehen.

Der Punkt zeigt uebrigens sehr schoen, dass diese tools inhaerent freiheitsfeindlich sind: sie beschraenken die Ausdrucksmoeglichkeit der Nutzer auf so unkontrollierte wie intransparente Weise.

Ich sehe das etwas kritischer..

und ich hätte mir gewünscht, dass der Autor auch ebenso eine dystopische Variante als Warnung entwirft.

Anstatt kritische Stimmen im Vorfeld zu verunglimpfen.

Meine Grundlage ist Erich Fromms und Herbert Marcuses Kritische Theorie.

Auf der Kritischen Theorie, insbesondere auf Marcuses „Der eindimensionale Mensch“, welche einerseits für die 68er Bewegung entscheidend mitverantwortlich war, basieren zahlreiche kritische popkulturelle Dystopien. Zum Beispiel „Terminator“ oder andere Science Fiktion, die eine Warnung ausspricht, in der Technisierung und Automation zu Gleichmacherei und Tod jedes lebendigen Impulses wird.

Und hier ist meine Prognose in der Tradition der Kritischen Theorie.

Marcuse sagt, die letzte Instanz ist die Kunst und das kreative Moment, das den Widerstand vor der repressiven Totalität der technologischen Rationalität darstellt.

Dieses Mittel, diese letzte Instanz des Widerstandes gegen die Repressivität des herrschenden Systems wird durch die Technisierung gänzlich vernichtet.

Wenn Maschinen, die nicht fähig sind zur Kritik, nun Bilder malen, bekommen wir ein automatisiertes 1984 von George Orwell. Eine kritikfreie Gesellschaft, in der alles „schön“ ist. Zumindest so dargestellt wird.

Doch das Elend oder die Einschränkung der Freiheit unter einem Narrativ der Sicherheit und des Fortschritts nimmt seinen Lauf.

Wenn jetzt also jeder mit Leichtigkeit und bloßem Wissen, ein Bild per Text entwerfen kann, dann wird es keine Menschen mehr geben, die von dem Handwerk leben können. Es wird die Vernichtung des kritischen Potentials in der Gesellschaft und die Technisierung, die tendenzielle Entstehung der „Cybermen“. Der Siegeszug der technischen Rationalität über das Lebendige.

Ich gebe dem Autoren recht, die Dystopien haben die Mainstream Social Media Dynamiken und Tendenzen vl vergessen, die mitverantwortlich dafür sind, dass es so kommt wie es kommt..

Oder vielleicht haben sie sie auch nicht vergessen, sondern so grundlegend in dem Fortschritt integriert, dass sie so selbstverständlich sind.

Nehmen wir Blade Runner. Solch eine Dystopie ist eine fortgeschriebene Gesellschaftsentwicklung.

Wie es eigentlich jede Science Fiction ist. Science Fiction definiert sich daraus, dass es Gesellschaften sind, die weitergedacht wurden.

Was ist Social Media anderes als gesellschaftliche Korrespondenz. Der Schmelztiegel des Prozesses von gesellschaftlicher Entwicklung.

Nun, ohne abzuschweifen, es macht mir Angst, diese Entwicklung der Automatisierung und Ersetzung von kreativen Prozessen, insbesondere wenn sie unkritisch vom Mainstream gefeiert wird.

Letztendlich bleibt nun wirklich die letzte Chance, darauf zu hoffen, dass unsere liberale Vorstellung und das Bedürfnis danach nicht abhanden kommt, und wir endlich bald mittels Grundeinkommen für alle, die Erwerbsarbeit oder Vermarktung auf dem Markt von existentiellen Notwendigkeiten, wie der Deckung grundlegender Bedürfnisse sicherstellen.

Denn dann ist es egal, ob eine Maschine kreative Prozesse auf dem Markt übernimmt. Dann haben die Menschen auch genug Raum und Freiheit automatisierten und generierten Mechanismen entgegenzuwirken.

Quellen:

Herbert Marcuse:

Der eindimensionale Mensch

„Herbert Marcuse: Von der Jugend lernen“

https://www.youtube.com/watch?v=x6Uvwcbx7ok&t=17s

Erich Fromm:

Wege aus einer kranken Gesellschaft

Die Kunst des Liebens

Die Furcht vor der Freiheit

Lieben wir das Leben noch?

Grundeinkommen:

http://www.grundeinkommen.de

„Wenn Maschinen, die nicht fähig sind zur Kritik, nun Bilder malen, bekommen wir ein automatisiertes 1984 von George Orwell. Eine kritikfreie Gesellschaft, in der alles „schön“ ist. Zumindest so dargestellt wird.“

Bei der Automatisierung ist die Big Tech ja schon schön mit dabei, inklusive sich ergebender gesellschaftlicher Aspekte. Die Politik scheint nicht mehr in kleineren Kategorien denken zu können, so dass Gesetze dann auch „kritikfrei“ auf die großen Töpfe zugeschnitten wird, mit Kollateralschäden z.B. beim Moderationsprinzip (Wozu, wenn man trotzdem nahezu beliebig Haftet?) oder allgemeiner Dienstformen die nicht so automatisiert sind, zudem nicht die magischen Forderungen nach dem Gral des Blöden zu erfüllen im Stande sind (Uploadfilter nach Gesetzestext, Lizenzvereinbarungen mit den Verwerter- und Verlagsindustrien, Haftungsrisiken vor dem eigentlichen Projektstart, Alternative ohne Sichtbarkeit oder „Community“, …, oder nicht wollen: indifferente Haltung gegenüber dem Ausliefern der Nutzer an übegriffigen Staat, Werbung von Werbenetzwerk anzeigen, um Leben zu dürfen, etc. pp.). Die Gesetzgebung meidet Kritik, aber nicht den N-ten Aufguss vor dem Verfassungsgericht. Strukturelle Reform oder wenigstens Ausbesserung, geschweige denn Rücknahme von Schlechtem wird mit „vollem Ernst“ gemieden Usw. usf.

Insgesamt sind wir schon in der Richtung unterwegs, das Potential für den Schwenk reicht bereits für den Schwenk – ab da ist nur noch die Übernahme der Macht durch etwas Vernünftigeres (ganz ganz schwierig ~ Revolution?) oder „Hoffnung“ die Option.

Beim Klimawandel ist es ähnlich. Die Politik meidet Kritik an der Wirtschaft, obwohl sie massive Mittel für „Transparenz“ hätte, stellt sich Jahrzehntelang ausdrücklich nicht strategisch auf (EU irgendwo?), so dass „die Wirtschaft“ allgemein in die Parasitenrolle wechselt – keine Verantwortung übernehmen, Finger rühren nur bei Förderung durch den Staat, Technologie erforschen oder teilen auch eher nicht so viel, aber gerne klagen, sobald Umweltmaßnahmen an die Töpfe zu gehen drohen. Das ist natürlich ein Versagen der Politik und des gesamten Systems, bzgl. einer noch denkbaren Zukunft. Letztere zu nehmen, gibt es ja bereits Bemühungen, nicht selten solcher, die damit bzw. davon seher gut leben können (siehe USA zuletzt und Russland als Beispiele für „Führung mit System“). Gierbasiert transformiert es sich schlecht. Weder Markt noch die Wirtschaft leisten sowas. Alles was die können, ist sich wie der Säbelzahntiger anzupassen: einige sterben aus, andere passen zufällig irgendwie rein. Einige wollen auswählen dürfen, wer welche Sorte Säbelzahntiger sein darf, und halten sehr viel Macht mit wenigen Händen. Für die, die „Evolutionstheorie“ in der praktischen Anwendung auf den Fortgang der Menschheit toll finden, sei gesagt, dass über Populationsgrößen keine Aussage gemacht wird, das Individuum nichts zählt, usw. Es wird dabei (typisch Rechts) immer übersehen, wer oder was da eine Auswahl trifft, oder überhaupt eine Wahl hat (typisch nützliche Trottel: und man wähnt sich auf der Seite der Auswählenden, ähnlich wie nichts zu verbergen haben Meinende, die nicht verstehen, dass dann andere Auswählen, was lebt und was nicht).

Bei der allemeinen Wirtschaftsschelte muss natürlich etwas amgedämpft werden. So haben einige Hersteller seit Jahrzehnten bereits auf Plastikbeschichtungen in Milchtüten weitestgehend verzichtet, andere ersetzen Kunststoffverpackungen zusehends immer mehr durch Karton u.ä. Bin mal gespannt, ob der Staat den Atomkraftwerksbetreibern jetzt einen Teil der Entschädigung streicht, die sie für den geplanten Ausstieg erhalten sollten oder bereits erhalten haben. Professionelle Rahmen setzen können wohl nur noch PR-Unternehmen.

Naja, bisserl selbst denken muss man dann doch noch. Das ist die Skyline von Shanghai, nix Tokio. ;-)

Das ist in der Tat sehr witzig und ein starkes Beispiel dafür, wie selbst hinter bezaubernden Erzeugnissen schnöde Trainingsdaten stecken.

Das derzeitige System wird sicherlich Fade werden, wenn man es denn dann schon ein bischen kennt. Training ist sehr teuer, und das System ist dann erst mal so gebacken.

Nicht garantiert, aber wahrscheinlich, wird man es für den Kunstteil auf Dauer weit aufblähen müssen, also mit viel mehr Trainingsdaten arbeiten, sowie größerem Innenleben, wenn es eine wirklich richtige Sache werden soll, und dann kommt eigentlich fast nur noch die Cloud in Frage. Zudem wäre die Frage, wessen Werke da wie, zudem möglichst treffend verschlagwortet, eingefüttert werden dürfen. Da ist von „geht nicht“ über „irgendwas aufgekauft und jetzt ist dein Telefonbuch weg“ bis zu „Soziales Netzwerk X fügt irgendwas mit opt-out zu den AGB hinzu“ alles drinnen. Vielleicht kippt auch ein Land, zum Zwecke der internationalen Konkurrenz, so könnten Rechteverwerter in Übersee mit der Technologie anbandeln. Ob sich das lohnt… für ein eigenes „soziales Netzwerk“ währen Lizenzvereinbarungen mit Verwertern Pflicht, wenn die kein internationales Verwerterkartell bilden. Witzig, wie hier eigentlich klarwerden sollte, wie problematisch die EU-Urheberrechtsreform letztlich ist, was die Chancen für irgendwelche Marktteilnahmen betrifft.

Copyright kann des Nutzers Problem sein, sofern die Trainingsdaten keine Rechte verletzten. Das limitiert dann allerdings das Anwendungsfeld. Nutzerfotos automatisch zu teilen, führt wieder zu weiteren „Uploadfiltern“, Einschränkungen etc., bietet sich also für bestehende Plattformen an. Mehr lock-in, mehr und bestehende Restriktionen für die Generierung, in der Welt der „unendlichen Möglichkeiten“. Wird so ein System für sich so gut, dass es so bestehen kann, wäre ein bezahlter oder webegetriebener Clouddienst sicherlich denkbar. Der Datenabfluss aus dem interaktiven Schaffensprozess klingt auch erst mal interessant.

Wegen der unklaren Problematik denke ich, dass die Unternehmen nach weiteren Anwendungen suchen, für die sich ein Aufkauf besonders lohnt, und das wird wohl nicht zwingend (nur) der Kunstgenerierungsteil werden, wenn es zeitnah passieren soll. Es gibt wohl schon einen Ausblick auf vielversprechende Anwendungen, Investoren, hohe Bewertungen, aber wohl noch keinen offiziellen Aufkauf, und kein offizielles definitives Geschäftsmodell.

Ich habe mir vor einer Woche StableDiffusion für Blender mit einer Open Source UI heruntergeladen und einige Bilder generiert. Man benötigt eine gute Grafikkarte mit einem noch besseren Grafikspeicher. Für ein Full HD Bild benötigt man rund 10GB Grafik-RAM. Shared Memory ist aktuell nicht verfügbar.

Man kann neben Text auch ein Bild als Vorlage hinzufügen und verschiedene Einstellungen vornehmen, etwa wie sehr sich das Bild an dir Textvorlage halten soll und wie viele Generierungsschritte das Bild beinhalten soll (25 sind Standard, unter 10 wird das Ergebnis meistens völlig unbrauchbar). Außerdem kann es Kachelbilder erstellen.

Ich habe die KI heruntergeladen um zu testen, wie gut generierte Texturen aussehen und ob sie für meine Spieleentwicklung einen Mehrwert bietet. Das Ergebnis ist durchwachsen. Zum einen liegt es an den benötigten Texturen. Eine Ziegelsteinwand sieht wesentlich hochwertiger aus als eine Holzmaserung. Artefakte haben beide Texturen, aber bei den Ziegelsteinen ist es mehr die Anordnung der Steine, bei dem Holz hingegen die farbliche Detailqualität. Als Placeholder brauchbar, fürs Endprodukt nicht. Zum Anderen aber auch der Bedarf des Grafikspeichers. Mit 10GB Grafikspeicher kann man Texturen mit einer Auflösung von 1024×1024 generieren, die nächstgrößere (für Spieleentwicklung) sinnvolle Auflösung von 2048×2048 benötigt jedoch deutlich mehr, was ich nur mit „Shared Memory“ (dabei wird die Hälfte des RAMs der Grafikkarte zur Verfügung gestellt) bewerkstelligen könnte.

Darüber hinaus kostet es viel Energie ein Bild generieren zu lassen. Ein Bild mit ~2 Megapixel (entspricht Full HD) kann schonmal 10-15 Minuten bei voll ausgelasteter highend Grafikkarte generiert werden, je nach Einstellungen (ohne Vorschaubild der Zwischenschritte geht es schneller).

Wie die NP.org-Lesenden wissen, hat KI auch eine Schattenseite, die mir ebenfalls aufgefallen ist. Bilder besitzen einen Bias, also eine Neigung Bilder in einer bestimmten Art und Weise generieren zu lassen, je nachdem, wie viel und welches Trainingsmaterial zur Verfügung steht. So hatte ich einmal etwas eingegeben, was gar nicht so spezifisch war, mir aber immer den selben Fantasycharakter in 8-12 Posen dargestellt hat (typisches Charakter-Artdesignbild wie man es z.B. aus Deviantarts kennt). Das hat mir nochmal vor Augen geführt, wie hochproblematisch dieser Bias für andere KI-Systeme (z.B. Überwachungskameras) ist, auch wenn er bei der Bildgenerierung weniger schlimm ist als in der Überwachungsindustrie.

Zudem habe ich eine gewisse Logik in der Generierung erkannt und festgestellt, dass da weit weniger „Magie“ in den Systemen steckt, als es klingt. Die Systeme sind viel weniger „kreativ“ als die einzelnen Bilder suggerieren. Ein Beispiel bietet folgendes Bild: https://i.imgur.com/IiUl16N.png (CC0)

Zu sehen sein sollte ein Sonnenschein und je nachdem wie stark sich das Bild an dem Wort „Sunshine“ orientieren sollte entsteht vorne eine Stadt, die sich in mehreren Stufen hin zu einer Art Steinhaufen bis hin zum Wald entwickelt hat. Die Sonne war dabei nur bei den Waldbildern zu sehen. Im konkret verlinkten Bild hat die KI zudem den Waldrand als Horizont fehlinterpretiert was auf lustige Weise die Probleme verdeutlicht. Bei anderen Bildern war die Sonne am richtigen Horizont. Das dreieckige Flachland hinten war bei allen Bildern nahezu identisch.

Kreative Leute wird sie also nicht ersetzen können. Die KI kann allerdings ein Werkzeug für Kreative sein und so werde ich sie sicher auch einsetzen – und wenn es nur die Suche nach Inspiration ist. Aber generierte Bilder können auch ein Beiwerk der finalen Kunst sein.

Ein von mir generiertes Bild, das ich sehr inspirierend finde und mir viele verschiedene Ideen liefert ist z.B. dieses hier: https://i.imgur.com/jKjs0ud.png (CC0)

Unterm Strich hat auch diese Technik Vor- und Nachteile. Als kreativer Mensch habe ich wenig Sorge, dass mir KI den Beruf streitig machen wird. Eher werden KIs (und ich warte schon auf KIs in anderen Bereichen, etwa für Materialanimationen) mein Toolset erweitern und mir mehr Möglichkeiten an die Hand geben mehr aus meiner Kunst zu machen.

Es ist ein Deep-learning-System auf einem Gebiet mit vermutlich nicht formulierbaren Regeln… Kopfschmerzen sind da eigentlich vorprogrammiert.

Für diesen spezifischen Anwendungszweck ist das System „interessant“, aber so kaum so und so weit tragend (in dieser konkreten Form, die „es“ bzw. solches sicherlich nicht dauerhaft konkret beibehalten wird. Man könnte sich eine Cloudvariante vorstellen, fragt sich aber, wie Monetarisierung einerseits, andererseits die Versorgung mit Trainingsdaten aussehen soll. Das war jetzt mal ein 600000+-Tacken Show-case.

Es gibt natürlich weitere Anwendungsfälle, die wohl auch für die Bewertung mindestens eines mit solcher Technik involvierten Unternehmens verantwortlich sein dürften. Die Technik ist u.a. auch in der Lage dazu, gegebene Bilder zu verändern, Upscaling/Superresolution, u.a. Da sind u.a. professionelle Tools denkbar (Postproduction, schnelles Estimate oder sogar Assetplatzierung in 3D, u.a. wo ja 10GB Grafikspeicher dann nicht für alle das Problem sind. Die Technik arbeitet auf Basis eines Bildes dann viel schneller, als ein neues Rendering benötigen würde. Ausdruck in der Postproduction vielleicht noch. Das wird vielleicht noch geforscht). Dann kommen noch andere Anwendungen bis zu Echtzeit, zur Hilfe bei Vergleichsbildern mit Videoüberwachung und Phantombildern, und wer weiß was noch, vielleicht Subsystemeigenschaften des Hirns da selbst, für Bereiche in denen Nerven ankommen oder die nachgelagert sind, who knows. Vielleicht gibt es auch krasse Abstraktionen, die darauf hindeuten, dass diese Sorte Software ähnlich dem Prinzip der „Mustererkennung“ in anderen Entscheidungsbereichen schnelle Ergebnisse liefern kann (auf Monsterhardware), z.B. an der Börse oder bei Wettersimulation, vielleicht auch erst zusammen mit einem Quantum-Annealer. [Achtung: alles wildes Brainstorming]

Das bleibt etwas ominös, und in einem Interview gab es noch kein offizielles Geschäftsmodell, wohl aber eine hohe monetäre Bewerung des Unternehmens, und den Gedanken es zu verkaufen. Nun sind da Universitäten direkt beteiligt gewesen, und da werden einige vielleicht ein NDA, äh ich meine eine Idee davon haben, was man noch so damit machen kann.

„Die KI kann allerdings ein Werkzeug für Kreative sein und so werde ich sie sicher auch einsetzen“

Das vermute ich auch eher. Dennoch kann auch hier hinterfragt werden: „Und wer besorgt es denen dann?“

Zudem: was hat das dann für Folgen?

Ich sehe da drei wesentliche Eckpunkte:

1. Fixieren an Clouddienste. Für sich erstmal, allerdings durchaus mit Auswirkungen, was Abhängigkeiten betrifft. So einige „Kreative“ und Produzenten haben dicke Hardware herumstehen, aber das heißt nicht, dass ein System so gebaut werden wird, denn:

2. Woher die Trainingsdaten, damit es wirklich im professionellen Kontext funktioniert? Aus dem gesamten Internet/irgendwie (Auswirkungen? Man enteignet sich selbst mit Veröffentlichung?)? Vielleicht gibt es hier dann große Fortschritte, wenn man es so kombiniert bauen kann, dass weniger Trainingsdaten nötig sind, oder z.B. das System benutzte Assets trackt und nur zur Visualisierung, aber nicht zur Veröffentlichung genutzt wird. D.h. in der Postproduktion oder als kreatives „mach was ich schreibe“ Tool, um letztlich dann ein Assetplacement-Tool mit den Metadaten zu füttern (…). Das ist schon denkbar. Hat auch auswirkungen, denn wer sich das leisten kann, ist dann noch schneller.

3. Das Badewannenprinzip, oder die Handykamera. „Gut genug für so viel“ könnte man auch sagen. Ein Webdienst, woher auch immer die Daten, rollt einen Teil des kreativen Umfeldes auf, samt Video, und professionelle Tools werden nicht mal mehr gedacht (unwahrscheinlich). Theoretisch, also mit der Macht der Masse, könnte ein Big Player, oder ein Kartell von solchen, sowas versuchen (wollen). Vermutlich wird es irgendwann aber 2. auf Basis von Assetstores und Anbietern unabhängig von 3. geben, wo copyright nicht mal das Problem ist.

(Dann noch andere Anwendungsfälle. Vielleicht wird’s halt aufgekauft und man hört dann lange nichts mehr von.)

Die Technologie hat in der Tat große politische/ethische Probleme, je nachdem wie sie eingesetzt wird. Ich für meinen Teil habe auf Open Source (https://github.com/carson-katri/dream-textures) und meine Grafikhardware einer handelsüblichen High-End-Gaminggrafikkarte gesetzt, die immer noch günstiger als professionelle Karten sind.

Gestern Abend habe ich zudem das Update eingespielt, bei dem KI-Bildskalierung dabei ist. Damit kann ich ein 512×512 Pixel Bild auf 4096×4096 skalieren und benötige gar nicht mehr so eine gute Grafikkarte (hat auch kleinere Nachteile, etwa z.B. möglicher Verlust von Farbechtheit, die ich mir aber auch als Vorteil zu Nutze machen werde).

1. Auf Clouddienste möchte ich nicht zurückgreifen, aber das Problem sehe ich in manchen Bereichen tatsächlich auch, daher halte ich Ausschau nach im besten Fall Open-Source-Entwicklungen oder zumindest lokal ausführbaren Offline-Anwendungen.

2. Das Trainingsmaterial ist in der Tat ein großes Problem, auch bei anderen KI-Systemen (Text-to-Speech … kenne da schon eine hochproblematische Anwendung). Und ich vermute sehr stark, dass da auch mein Open Source Tool nicht ganz sauber ist. Zu Testzwecken habe ich versucht gewisse pornografischen Bilder generieren zu lassen. Am Ende sind tatsächlich Bilder herausgekommen, die das konkrete Prinzip verstanden haben. Damit ist erwiesen, dass mit solchem Material trainiert wurde (und das sicherlich ohne Einverständnis der Betroffenen). Auf der anderen Seite versteht die KI nicht worum es dabei geht und erstellt nichts sinnvolles (mehrere Körperteile verschiedener Körper verschmelzen zu einem undefinierbaren Gebilde). In meiner eigenen Arbeit mit dieser konkreten KI werde ich aber auf möglichst alles verzichten, wo ein Mensch als Trainingsmaterial herhalten musste – auch bekleidet. Damit sollte zumindest ich die Rechte der Menschen ausreichen geschützt haben. Andere Leute werden sich da leider weniger Gedanken machen.