Wenige Tage vor der Präsidentschaftswahl in Kenia droht Facebook eine Sperre in dem ostafrikanischen Land. Sollte das soziale Netzwerk die ausufernde Hetze auf seinem Dienst nicht bald in den Griff bekommen, werde die Nationale Kommission für Zusammenhalt und Integration (NCIC) eine Suspendierung der Dienste empfehlen. Das berichtet die Nachrichtenagentur Reuters.

Die Regierung wiegelt hingegen ab. Es werde keine Einschränkung von Medien, inklusive sozialer Medien, geben, erklärte Digitalminister Joe Mucheru auf Twitter. Auch der Innenminister Fred Matiang’i sprach sich gegen eine Sperre sozialer Netzwerke aus.

Entzündet hat sich der Streit letzte Woche an einer Untersuchung der Menschenrechtsorganisationen Global Witness und Foxglove. In einem Test schalteten sie 20 bezahlte Werbeanzeigen, die in Kenia gängige Hassrede enthielten. Darin sei zu Gewalt gegen einzelne ethnische Gruppen aufgerufen worden, was gegen die Gemeinschaftsrichtlinien verstößt.

Facebook genehmigte die in den zwei offiziellen Landessprachen Englisch und Swahili verfassten Anzeigen. Nur in einem Fall wies das Moderationsteam einen englischen Text zurück, weil er gegen Sprachregeln verstoßen haben soll. Nach einer geringfügigen Korrektur habe Facebook die Anzeige schließlich durchgewunken, berichtet Global Witness.

Angst vor Unruhen

In Kenia kommt es rund um Wahlen immer wieder zu politischen Unruhen und ethnischen Spannungen. Bei Auseinandersetzungen nach der Präsidentschaftswahl 2007 starben 1.500 Menschen, hunderttausende wurden vertrieben. In der Folge wurde der heutige Präsident, Uhuru Kenyatta, wegen Verbrechen gegen die Menschlichkeit vor dem Internationalen Gerichtshof für Menschenrechte angeklagt. Wegen Mangel an Beweisen nahm dessen Chefanklägerin die Klage jedoch zurück.

Kenyatta, der 2017 mit Unterstützung der umstrittenen Datenfirma Cambridge Analytica wiedergewählt wurde, tritt in diesem Jahr nicht mehr zur Wahl an. Der von ihm unterstützte Kandidat, Raila Odinga, liegt in Umfragen vorne.

Die nach den Ausschreitungen 2007 eingerichtete NCIC setzt sich für Versöhnung der ethnischen Volksgruppen ein und soll ein ähnliches Ausufern der Gewalt verhindern. Zuletzt hatten internationale Hilfsorganisationen vor zunehmenden Spannungen gewarnt. Auch bei der letzten Präsidentschaftswahl 2017 war es zu gewalttätigen Auseinandersetzungen gekommen.

NCIC zufolge decken sich die Ergebnisse der Menschenrechtsorganisationen mit eigenen Befunden. „Facebook verletzt die Gesetze in unserem Land“, sagte NCIC zu Reuters. Das soziale Netz habe sich als Vektor für Hassrede, Aufstachelung und Desinformation gebrauchen lassen, so Danvas Makori, ein Vertreter der staatlichen Behörde. Selbst anordnen kann NCIC eine Sperre von Facebook nicht, sei aber in Gesprächen mit der zuständigen Regulierungsbehörde, sagte Makori.

Wachsender Nachholbedarf

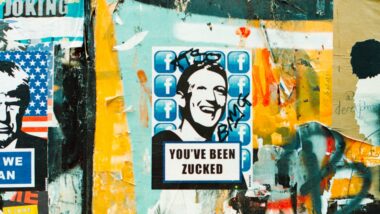

Facebook steht seit langem in der Kritik, als Brandbeschleuniger für ethnische und politische Konflikte zu fungieren, da der Konzern in den Ländern des Globalen Südens kaum Geld für die Moderation von Inhalten und Faktenchecks ausgibt. So stellten die Vereinten Nationen fest, dass das Unternehmen eine Mitschuld am Völkermord der Rohingya in Myanmar trägt, internen Berichten zufolge spielte sich ähnliches im Bürgerkriegsland Äthiopien ab.

Der Konzern selbst hatte sich erst jüngst in seinem ersten Menschenrechtsreport ein gutes Zeugnis ausgestellt. Prominent verweist das zu Meta gehörende Unternehmen auf seine Maßnahmen rund um demokratische Wahlen. Auf die Untersuchung von Global Witness und Foxglove reagierte das soziale Netzwerk mit einem Blogpost: So habe man seit Ende April knapp 80.000 gefährliche Inhalte von Facebook und Instagram in Kenia entfernt, zudem sei man gegen die Verbreitung von Desinformation vorgegangen.

Nachholbedarf haben auch andere Anbieter sozialer Medien, etwa der rasant wachsende Videodienst TikTok. Eine Untersuchung der Mozilla Foundation wies dem Anbieter kürzlich nach, massenhaft hetzerische und manipulative Inhalte zu verbreiten. Dem Moderations-Ökosystem von TikTok würden die Ressourcen und der Kontext fehlen, um adäquat auf Desinformation bei den Wahlen zu reagieren, heißt es in dem Bericht – trotz einer eilig auf den Weg gebrachten Initiative des Anbieters.

Inzwischen unterhält Meta in der kenianischen Hauptstadt Nairobi ein Moderationszentrum für Sub-Sahara. Das soll dabei helfen, differenzierte Entscheidungen bei der Beurteilung von Inhalten zu treffen. Gelungen ist dies augenscheinlich nur bedingt. Dort arbeitende Moderator:innen berichten von Überlastung, „mentaler Folter“ und schlechter Bezahlung. Kurzfristig dürften sich diese Missstände kaum abstellen lassen.

Global Witness, Foxglove und die Facebook-Whistleblowerin Frances Haugen fordern nun Notfallmaßnahmen ein. Diese sollten jenen ähneln, die Facebook nach dem Sturm des Kapitols in den USA ergriffen hatte. Zudem soll das Unternehmen bis auf Weiteres keine politischen Anzeigen mehr zulassen, heißt es in der gemeinsamen Stellungnahme.

0 Ergänzungen

Dieser Artikel ist älter als ein Jahr, daher sind die Ergänzungen geschlossen.