Der KI-Chatbot DeepSeek wird in Deutschland verboten. Die Berliner Datenschutzaufsicht hat die chinesische App als rechtswidrig bewertet, weil sie Daten ihrer Nutzer*innen nach China übermittelt. Damit verstößt sie gegen die Datenschutzregeln der EU (DSGVO). Apple und Google sollen die Anwendung nun aus ihren App-Marktplätzen entfernen. Auf anderen Wegen, etwa über den Browser oder heruntergeladen über die Seite des Unternehmens, ließe sich der Chatbot allerdings weiterhin nutzen.

DeepSeek habe gegenüber ihrer Behörde nicht überzeugend nachweisen können, dass Daten deutscher Nutzer*innen in China auf einem der EU gleichwertigen Niveau geschützt sind, sagt die Berliner Datenschutzbeauftragte Meike Kamp.

In China haben Behörden weitreichende Zugriffsrechte auf personenbezogene Daten, die auf den Servern chinesischer Unternehmen lagern.

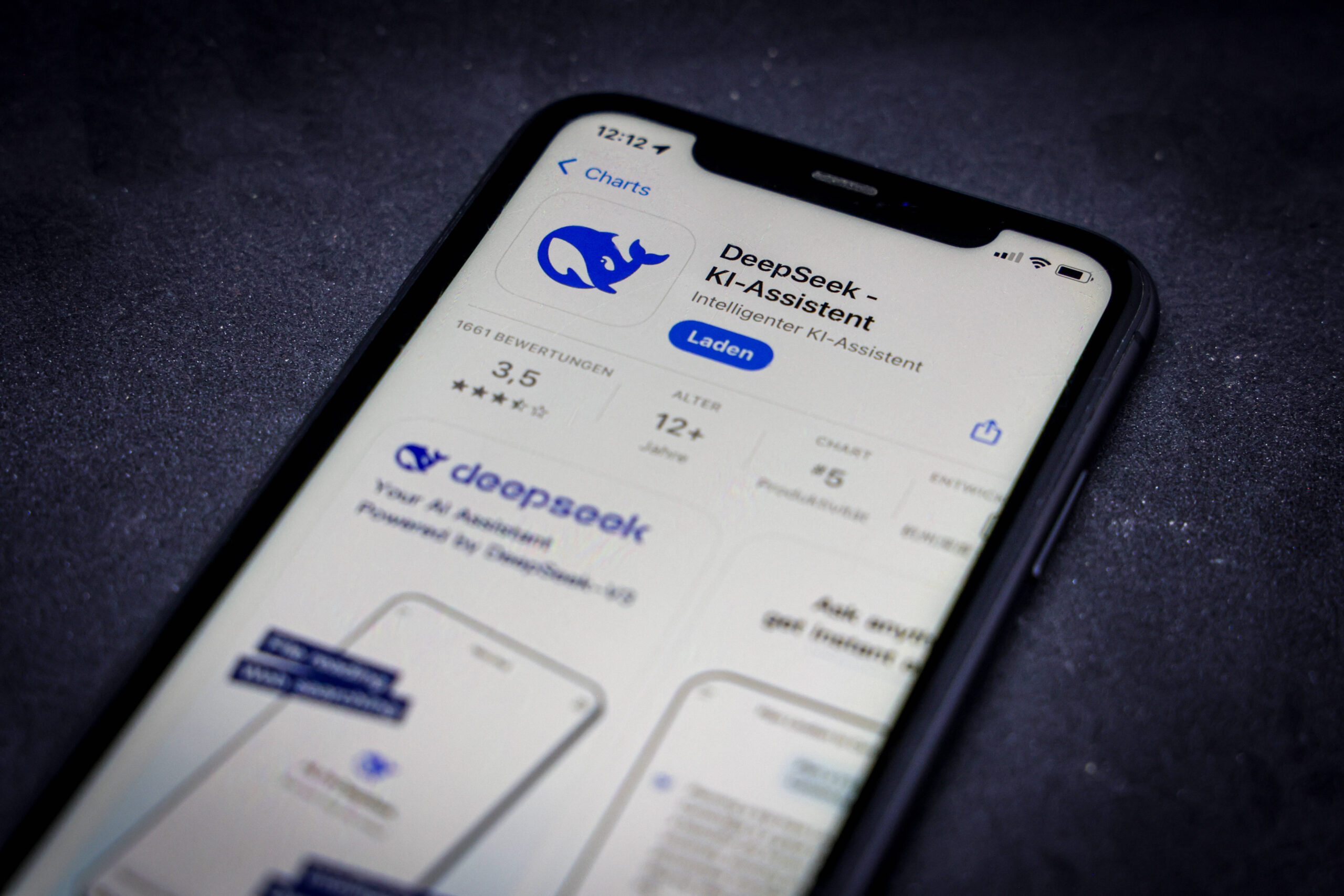

Ehemals Chartspitze, jetzt auf Verbotsliste

DeepSeek hatte nach der Vorstellung Anfang des Jahres für Furore gesorgt, weil die Leistungen des Modells hinter dem Chatbot an die von Marktführern wie ChatGPT von OpenAI heranreichten – für viele Beobachter*innen kam das überraschend. Zugleich soll das Training des Modells vergleichsweise günstig und mit weniger Rechenleistung stattgefunden haben, berichtete etwa die New York Times. Das brachte die Börsen durcheinander.

Die App gehört zu den beliebtesten KI-Anwendungen weltweit. Auch in Deutschland trendete sie zwischenzeitlich weit oben in den Download-Charts von Apple und Google. Nutzer*innen können mit der kostenlosen App chatten, Bilder hochladen oder sie für die Suche im Netz einsetzen.

Behörden warnten vor der App

Bedenken zum Umgang mit Nutzer*innendaten gab es von Anfang an. Denn alle gesammelten Daten – von Texteingaben und hochgeladenen Dateien bis zu den Informationen zum Standort und dem benutzten Gerät – übermittelt das Unternehmen nach China.

„Auch Tastatureingaben innerhalb der App können womöglich mitgelesen werden, bevor sie abgeschickt werden“, warnte das Bundesamt für Sicherheit in der Informationstechnik (BSI). Außerdem werde die Art der Tastatureingaben gespeichert, heißt es. Anhand der Art, wie Menschen tippen, lassen sich Nutzer*innen wiedererkennen.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Auch die Aufsichtsbehörden für Datenschutz hatten DeepSeek im Blick. Mehrere Landesbehörden gingen parallel gegen das Unternehmen vor. Die Gründe: Weitergabe der Daten und andere mutmaßliche Verstöße gegen die DSGVO. Das Unternehmen hatte etwa keinen gesetzlichen Vertreter in der EU benannt. In Abstimmung mit anderen Aufsichtsbehörden ist es jetzt die Behörde aus Berlin, die Maßnahmen ergreift.

Erst Aufforderung, dann Verbot

Die Behörde hatte nach eigenen Angaben DeepSeek Anfang Mai zunächst aufgefordert, die Übermittlung der Daten nach China einzustellen – oder die App eigenständig aus den Stores zu entfernen. Nachdem das Unternehmen nicht reagierte, folgte demnach heute die Meldung an Apple und Google. Dabei machte die Behörde von einer Regelung im Gesetz über digitale Dienste (Digital Services Act, DSA) Gebrauch, die Betreiber*innen von Plattformen dazu verpflichtet, Meldewege für illegale Inhalte zur Verfügung zu stellen.

Apple und Google müssen die Meldung laut DSA nun prüfen und über die Umsetzung entscheiden. Sie gelten in der EU als „sehr große Online-Plattformen“ und unterliegen damit besonders strikten Auflagen. So müssen sie ihnen gemeldete rechtswidrige Inhalte zügig entfernen, sonst drohen ihnen selbst Strafen in der EU.

Die Behörde hätte gegen DeepSeek auch ein Bußgeld verhängen können. Das lasse sich gegen Unternehmen aus Drittstaaten allerdings nicht vollstrecken, sagt Datenschutzbeauftragte Meike Kamp. Auch gegen die Webseite des Unternehmens könne die Behörde nicht vorgehen, weil der Host-Anbieter nicht bekannt sei.

In Italien ist DeepSeek bereits aus den App Stores verschwunden, nachdem die italienische Datenschutzaufsicht GPDP die App ins Visier genommen hatte. Australien hat die Nutzung der App auf Geräten der Regierung untersagt. In Südkorea wiederum ist die App nach einer zeitweisen Sperre wieder verfügbar, nachdem die Betreiber nachgebessert hatten.

Auch andere chinesische Apps haben Nutzer*innendaten an Server in China übermittelt, darunter die erfolgreichste: TikTok. Das Unternehmen hat jedoch im Gegensatz zu DeepSeek einen Sitz in der EU und fällt in die Zuständigkeit der irischen Datenschutzaufsicht, die jüngst gegen TikTok eine Millionenstrafe veranlasst hat.

Schreibe eine Ergänzung!