Brasilien arbeitet an einem Gesetz zur Regulierung künstlicher Intelligenz, das biometrische Gesichtserkennung stark einschränken könnte. Eine Expertenkommission hatte hierzu Ende letzten Jahres einen Bericht vorgelegt, der einen Entwurf für das Gesetz enthält.

Gesichtserkennungssoftware ist in Brasilien weit verbreitet. Die Polizei nutzt die Technologie zur Verfolgung von Straftaten. Etwa filmte sie in Vergangenheit schon mehrfach die riesigen Menschenmengen auf dem Karneval ab, um nach gesuchten Personen zu fahnden. In der Mehrheit der Bundesstaaten nutzen Schulen Gesichtserkennung, um die Anwesenheit ihrer Schüler*innen zu überprüfen. Auch das neue Überwachungssystem der U‑Bahn von São Paulo nutzt solche Technologie.

Gesichtserkennung trifft vor allem Schwarze Brasilianer*innen

Wie auch in Europa steht biometrische Gesichtserkennung in Brasilien in der Kritik. Das Forschungsprojekt „O Panóptico“ beobachtet den Einsatz der Technologie durch die Sicherheitsbehörden des Landes. „Die Einführung der Gesichtserkennung in Brasilien ist Teil einer Erweiterung der Überwachungsarchitektur, die schon in der Vergangenheit marginalisierte Personen und Gemeinschaften, insbesondere die Schwarze Bevölkerung, ins Visier genommen hat“, sagt Thallita Lima, die das Projekt mitkoordiniert, gegenüber netzpolitik.org.

Nach Daten des Projekts waren Stand 2019 90 Prozent der aufgrund von Gesichtserkennungssoftware verhafteten Personen Schwarz. Gerade bei Schwarzen Personen und auch bei Frauen ist solche Software besonders fehleranfällig. Das liegt unter anderem an unausgewogenen Trainingsdaten: Maschinelle Gesichtserkennung funktioniert meist am besten bei weißen, männlichen Personen.

Immer wieder gibt es in Brasilien Fälle, in denen Menschen zu Unrecht verhaftet werden, weil Gesichtserkennungssoftware sie fälschlicherweise als gesuchte Straftäter*innen identifiziert hat.

Das ist enorm gefährlich: Laut Amnesty International tötete die brasilianische Polizei 2021 mehr als 6.000 Menschen, 84,1 Prozent von ihnen waren Schwarz. In dem südamerikanischen Land herrscht extreme soziale Ungleichheit, deren Wurzeln in Kolonialismus und Sklaverei liegen.

Ausnahmen für die Strafverfolgung bleiben

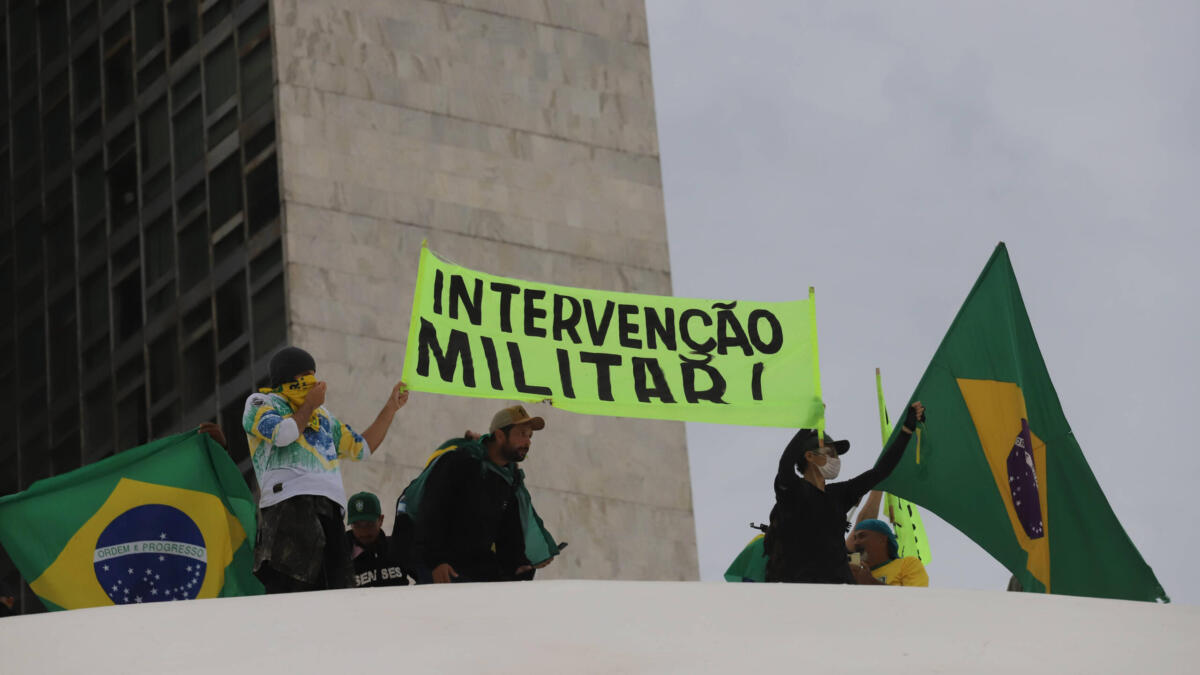

Die Bundespolizei hat angekündigt, auch für die Fahndung nach Beteiligten am Putschversuch in Brasilia vor einigen Wochen Gesichtserkennungssoftware einzusetzen. Am 8. Januar stürmten hunderte Anhänger*innen des abgewählten, rechtsradikalen Präsidenten Jair Bolsonaro wichtige Regierungsgebäude des Landes. Einer der Eindringlinge, der in brasilianischen Medien Schlagzeilen machte, weil er im Regierungspalast eine historische Uhr zerstörte, wurde unter anderem mithilfe von Gesichtserkennung gefasst.

„Obwohl die Gesichtserkennung einen symbolträchtigen und öffentlichkeitswirksamen Fall in Brasilien gelöst hat, ändert dies nichts daran, dass die Software weiterhin Fehler macht und eine geringe Genauigkeit aufweist, wenn sie in unserem städtischen Raum eingesetzt wird“, sagt Thallita Lima gegenüber netzpolitik.org. Diese Fehler würden weiterhin zu Gewalt und Einschränkungen, vor allem für die Schwarze Bevölkerung, führen.

Vor allem kommerzieller und wahlloser Gesichtserkennung könnte das geplante Gesetz einen Riegel vorschieben, ganz verboten werden soll die Technologie aber nicht: Zur Verfolgung schwerer Straftaten und zur Suche nach Verbrechensopfern oder vermissten Personen sollen Ausnahmen bleiben.

Initiativen kämpfen für Verbot

Bürgerrechtsorganisationen reicht das nicht: Die Kampagne „Tire Meu Rosto Da Sua Mira“ – auf Deutsch: Nimm mein Gesicht aus deinem Blickfeld – fordert ein generelles Verbot von Technologien zur Gesichtserkennung im Bereich der öffentlichen Sicherheit.

Neben Rassismus in der Strafverfolgung prangert sie an, ständige, wahllose Überwachung verletze Grundrechte wie Privatsphäre, Versammlungsfreiheit und Gleichberechtigung. Auch geschehe der staatliche Einsatz von Überwachungstechnologien in vielen Fällen in intransparenter Zusammenarbeit mit privaten Firmen.

Manche Politiker*innen setzen sich ebenfalls für stärkere Regulierung ein. Im Rahmen der Initiative „Sai Da Minha Cara“ (Weg von meinem Gesicht) haben im vergangenen Sommer gut 50 Abgeordnete auf Bundesstaaten- und lokaler Ebene Gesetzesentwürfe zum Verbot von Gesichtserkennung im öffentlichen Raum vorgelegt.

Geplante Regeln für KI-Systeme

Der Entwurf für das KI-Gesetz enthält noch weitere Regeln für KI-Systeme: So sollen Betreiber*innen für jedes solche System eine Risikobewertung durchführen müssen, bevor sie es auf den Markt bringen. Betroffene, deren Daten verarbeitet werden, sollen verschiedene Auskunfts- und Beschwerderechte gegenüber den Betreiber*innen bekommen.

Auch soll bei einer Reihe von Vorfällen eine Behörde informiert werden, etwa falls das System zur Gefährdung von Menschenleben, kritischer Infrastruktur, schweren Schäden an Eigentum oder der Umwelt oder ernsthaften Menschenrechtsverletzungen geführt hat. Sogenannte Social-Scoring-Systeme sollen gänzlich verboten werden.

Noch steht der Entwurf ganz am Anfang. Welche Regelungen tatsächlich Gesetz werden, bleibt abzuwarten.