Die Beschwerdestelle des eco, bei der man illegale und jugendgefährdende Inhalte im Internet melden kann, feiert dieses Jahr ihr dreißigjähriges Jubiläum. Sie ist fast so alt wie der Internetwirtschaftsverband eco selbst, der 1995 gegründet wurde und heute etwa eintausend Mitgliedsunternehmen hat. Der Verband nennt seine Meldestelle ein „Erfolgsmodell“.

Das beweisen die Zahlen, die heute im Jahresbericht der Meldungen vorgestellt wurden. Die Bilanz der eco-Meldestelle legt den Fokus auf die gemeldeten Missbrauchsdarstellungen von Kindern, die den weit überwiegenden Teil (93 Prozent) aller 51.359 eingegangenen Beschwerden betrafen. Der Betreiber der Beschwerdestelle arbeitet in der Bekämpfung dieser sogenannten CSAM-Inhalte permanent und aktiv mit Strafverfolgungsbehörden zusammen.

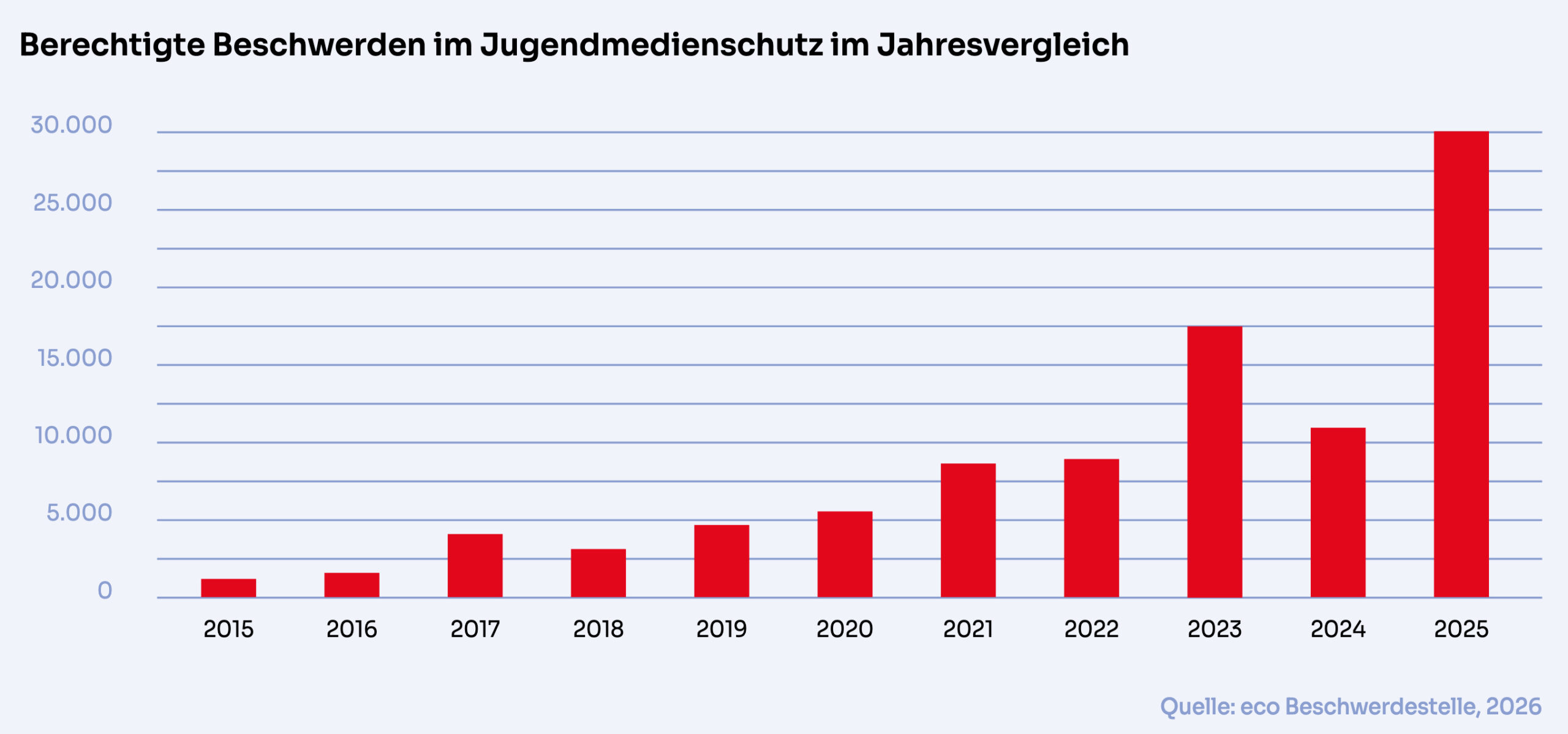

Ein neuer Höchststand von mehr als 30.000 rechtswidrigen Internetinhalten konnte aus dem Netz getilgt werden. Bei kinderpornographischen Inhalten berichtet eco von einer sehr hohen Gesamterfolgsquote von 99,51 Prozent. Im Inland wurde eine 100-Prozent-Erfolgsquote erreicht: Sämtliche der gemeldeten Inhalte mit Missbrauchsdarstellungen, die in Deutschland gehostet wurden, konnten entfernt werden.

Jeder einzelne an die Meldestelle in Köln herangetragene Fall werde geprüft, berichtete Alexandra Koch-Skiba, Leiterin der Beschwerdestelle bei eco. Sind die gemeldeten Inhalte, etwa Bilder, Videos oder Texte, nach juristischer Prüfung strafbar, wird zum einen die schnelle Löschung beim Provider oder beim Plattformbetreiber in Angriff genommen und der Fall zum anderen den Strafverfolgungsbehörden zur Kenntnis gebracht.

Diesen doppelten Ansatz bei der Bekämpfung rechtswidriger Inhalte betont Alexander Rabe, Geschäftsführer von eco, bei der Vorstellung des Jahresberichts. Denn „Internetsperren sind immer umgehbar“, daher gelte für eco der Grundsatz „löschen statt sperren“. Statt strafbare Inhalte nur zu blockieren, sollen die Dateien also direkt an ihrer Quelle aus dem Netz entfernt werden. Im Nachgang prüfen Mitarbeiter auch, ob die Inhalte wirklich verschwunden sind.

30.035 strafbare Inhalte

Nicht alle Meldungen, die bei eco zum Jugendmedienschutz eingingen, waren rechtswidrig. Nach rechtlicher Prüfung blieben insgesamt 30.035 Fälle als „berechtigte Beschwerden“, also betrafen strafbare Inhalte.

Das ist ein neuer Rekord an berechtigten Fällen. Zugleich wurden aber auch fast 42 Prozent der eingegangenen Meldungen nach der Prüfung als unberechtigt bewertet. Das ist dann der Fall, wenn der Inhalt rechtlich nicht relevant oder nicht prüfbar oder aber ein Duplikat ist, also bereits bekannt und zum Zeitpunkt der Meldung schon in Bearbeitung ist. Auch Meldungen außerhalb des Zuständigkeitsbereiches der eco-Beschwerdestelle fallen darunter.

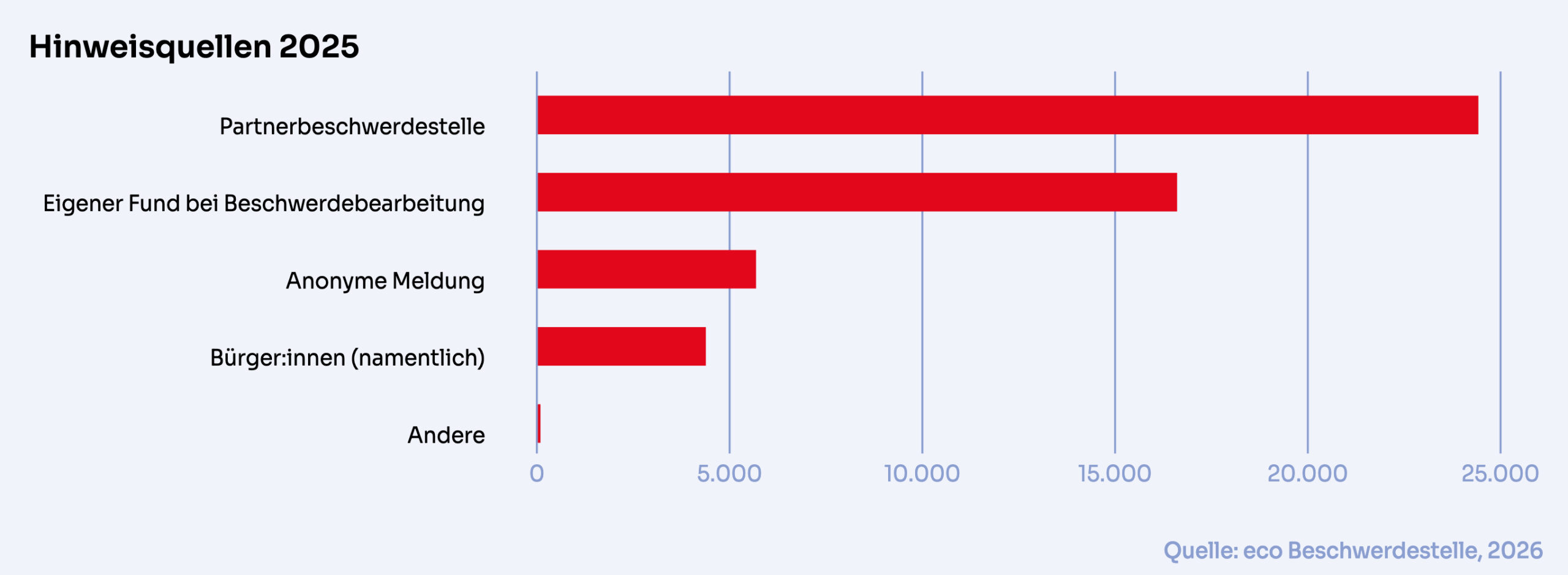

Hinweise zumeist aus dem INHOPE-Netzwerk

Ein sehr großer Teil aller Hinweise kam im vergangenen Jahr über INHOPE, die internationale Dachorganisation der Beschwerdestellen von fünfzig Ländern. 24.400 Fälle sind über diese Partnerbeschwerdestellen an eco gemeldet worden.

Meldungen, die nicht aus dem INHOPE-Netzwerk stammen und nicht bei der Beschwerdebearbeitung selbst aufgedeckt wurden, kamen überwiegend von dem Online-Meldeformular des Internetverbands. Das bietet – auf Wunsch anonym – die Möglichkeit, auf Inhalte hinzuweisen, die der jeweilige Hinweisgeber als rechtswidrig einschätzt.

Auch die Möglichkeit, Meldungen per E‑Mail einzureichen, kann genutzt werden. Sogar per Brief gingen in wenigen Fällen tatsächlich Hinweise ein. In 5.727 Fällen sind Beschwerden im vergangenen Jahr anonym eingereicht worden.

Manuelle Prüfung nötig

Seit vielen Jahren betont eco seine erfolgreiche Beschwerdestellenarbeit. Doch schnelle Löscherfolge können nicht durchweg erreicht werden. In Deutschland dauert es im Schnitt viereinhalb Tage, bis ein rechtswidriger Inhalt gelöscht ist. Das ist eine Summe aus der Zeit für Eingang und Prüfung der Meldung an Werktagen und der Reaktionszeit der betroffenen Provider.

Zunehmende Verschleierungsmethoden oder auch Massenhinweise seien herausfordernd, so Koch-Skiba. Das bedeute einen enormen Zeitaufwand. Es könne vorkommen, dass „zeitweise alle mit der Hinweisbearbeitung betrauten Mitarbeitenden der Beschwerdestelle“ Massenmeldungen über mehrere Werktage hinweg vollständig abarbeiten, erklärt eco gegenüber netzpolitik.org.

Im vergangenen Jahr seien diese Massenhinweise aber nicht ganz so umfänglich wie in früheren Jahren gewesen. Es seien diesmal nicht mehr als 2.500 URLs auf einmal gemeldet worden. Es gab jedoch in den Vorjahren auch Massenmeldungen mit URLs im fünfstelligen Bereich.

Eine manuelle Prüfung bei dieser Fülle an Meldungen, die manchmal also Hunderte oder gar Tausende einzelne Hinweise auf URLs enthalten, ist entsprechend zeitaufwendig. Allerdings erklärte eco gegenüber netzpolitik.org, dass eingehende Hinweise schon länger nicht mehr manuell erfasst werden müssen. Auch bei der Bearbeitung der Meldungen greife man auf „Automatisierungen und technische Unterstützung“ zurück.

Allerdings gilt: „Die inhaltliche Prüfung erfolgt jedoch weiterhin einzeln: Jeder gemeldete Inhalt wird […] gesichtet und bewertet.“ Das übernehmen nach wie vor die Menschen in der Meldestelle.

Eine Zunahme von KI-generierten Inhalten ist nicht zu verzeichnen, berichtet eco gegenüber netzpolitik.org. „Im Jahr 2025 lag ihr Anteil bei knapp einem Prozent.“ In Deutschland dürften auch fiktive Darstellungen von sexualisierter Gewalt und Grenzverletzungen gegen Kinder und Jugendliche nicht verbreitet werden. Für die Arbeit der Beschwerdestelle und deren juristische Bewertung machten daher generierte Inhalte keinen entscheidenden Unterschied.

Schreibe eine Ergänzung!