Automatisierte Entscheidungen, etwa von Google, beeinflussen unser Leben immer mehr. Aber was, wenn die Entscheidungen falsch sind? Autos sollten zum Beispiel nicht durch eine Fahrradstraße geleitet werden. Die Google-Suche sollte niemanden diffamieren. Und dass ein Mensch keinen Vertrag bekommt, weil die Schufa beim Scoring Fehler gemacht hat, ist auch nicht der Idealfall.

Die Organisation AlgorithmWatch hat jetzt eine Plattform entwickelt, mit der Betroffene auf diese Diskriminierung aufmerksam machen können. Auf Unding.de sind aktuell vier Szenarien aufgeführt, zu denen Missstände gemeldet werden können, weitere sollen hinzukommen.

Beispiele für automatisierte Diskriminierung

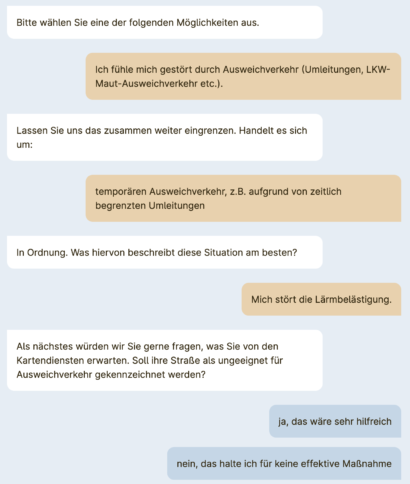

Ein Beispiel: Angenommen, die eigene Straße wird auf einmal von Automassen belagert. Die Antwort könnte sein: Es gibt eine Baustelle und anstelle der vom Verkehrsamt vorgesehenen Umleitung navigiert Google Maps über eben jene Straße, weil das schneller geht. Rücksicht auf verkehrsberuhigte Gebiete oder Wohnraum wird nicht genommen. Auf Unding könnte genau so ein Fall ganz einfach gemeldet werden.

Nutzer:innen werden in einem Frage-Antwort-System gebeten, das Problem zu spezifizieren. Unding erstellt aus den gesammelten Informationen eine E‑Mail und schickt sie an die verantwortliche Stelle, in diesem Fall Google.

In anderen Fällen könnten auch staatliche Stellen zuständig sein, so etwa für ein weiteres Szenario, das bereits auf der Plattform ist: Fotoautomaten. Bei einigen Amtsvorgängen müssen inzwischen biometrische Bilder vorgelegt werden, für die eigentlich Fotoautomaten direkt vor Ort genutzt werden können. Diese Automaten erkennen allerdings Schwarze Menschen und People of Color oft nicht. Auch solche Fehler in der Gesichtserkennung können direkt auf Unding.de gemeldet werden. Der Missstand wird dann an das Bundesamt für Sicherheit in der Informationstechnik (BSI) gemeldet, das die Fotoautomaten zertifiziert. Der Inhalt der Mail wird automatisch generiert und enthält alle wichtigen Angaben, die beschwerende Person muss sich um nichts weiter kümmern.

Die Plattform ist momentan noch in der Entwicklung und es gilt, je mehr Fälle gemeldet werden, desto besser. Die Macher:innen fordern auf, auch Vorfälle zu melden, die derzeit noch nicht aufgelistet sind. Sie werden dann aufgenommen und integriert.