Wer derart unter Druck steht wie der Datenkonzern Facebook es gerade tut, braucht Freunde. Facebook sucht sie jetzt in der Wissenschaft. Der Konzern hat angekündigt, ein neues Institut an der Technischen Universität München zu finanzieren, das sich mit ethischen Fragen und Problemen rund um den Einsatz von Künstlicher Intelligenz beschäftigen soll. Es wäre eine Premiere für Facebook, das erste direkte Sponsoring einer staatlichen Universität in Deutschland. Umgerechnet 6,6 Millionen Euro soll die TU in den kommenden fünf Jahren bekommen.

Das neue „Institute for Ethics in Artificial Intelligence“ soll akademisch unabhängig von Facebooks Interessen arbeiten. Das betonte Geschäftsführerin Sheryl Sandberg, die das Projekt am Sonntag medienwirksam vor großem Publikum auf der Digital-Konferenz DLD in München präsentierte. Das betont auch Christoph Lütge, Professor für Wirtschaftsethik an der TU und designierter Leiter des neuen Instituts. „Es gibt überhaupt keine Auflagen seitens Facebook, sondern wir bekommen dieses Geld um unabhängige Forschung zu finanzieren“, sagte er im Interview mit der Tagesschau. „Sonst würde ich es auch gar nicht machen.“

Millionen aus dem Marketing-Etat

Im Grunde ist es aber für Facebook ganz egal, welche Art von Forschung am Institut veröffentlicht wird. Gewonnen hat der Konzern mit der Maßnahme schon jetzt. Er kann sich als Partner einer angesehenen Universität präsentieren. Und er kann darauf verweisen, wie wichtig ihm die Fragestellung des ethischen Einsatzes von Algorithmen ist, wenn er das nächste Mal mit einer Panne, einer Nachlässigkeit oder bewussten Geschäftspraxis in die Schlagzeilen gerät – und womöglich auf die To-Do-Liste der Gesetzgeber. Liebe Politik, wir arbeiten doch schon an uns, siehe unsere 6,6 Millionen Euro Förderung für Ethik in der Künstlichen Intelligenz. Mfg, Facebook.

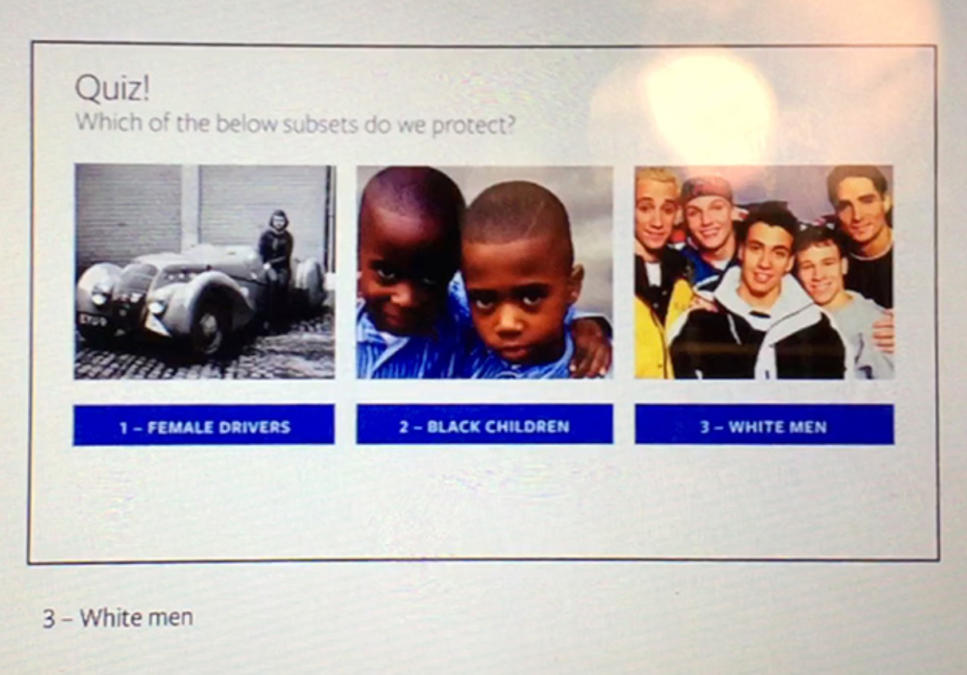

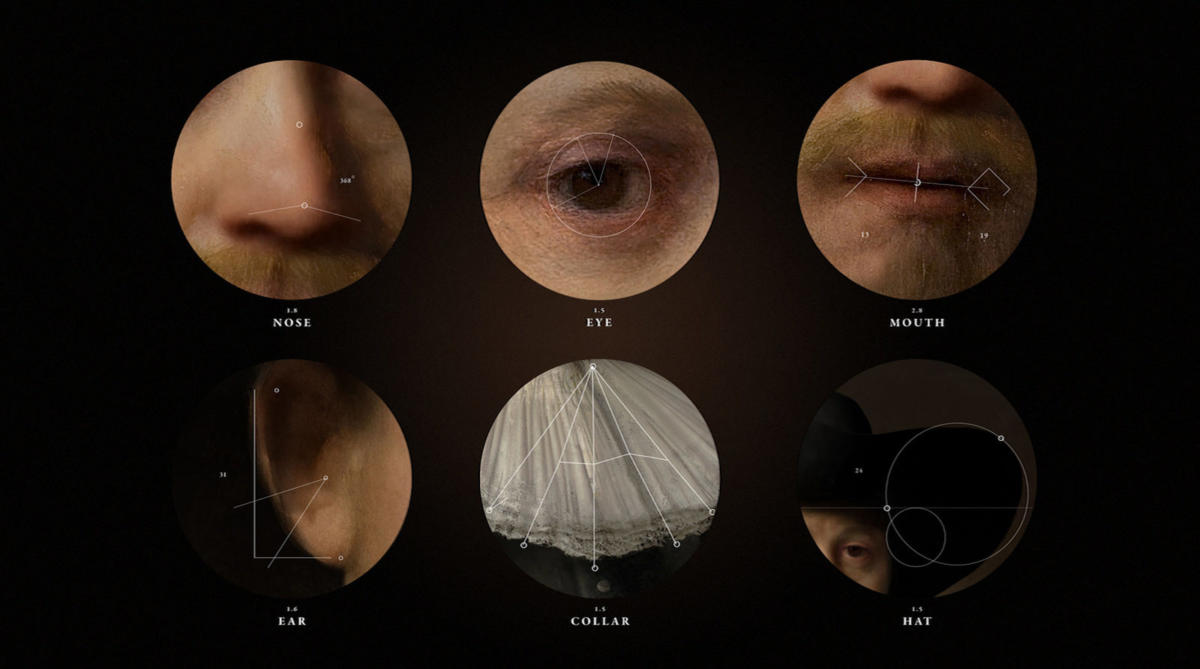

Das Unternehmen selbst nutzt maschinelles Lernen, also das, was gemeinhin unter dem Buzzword „Künstliche Intelligenz“ verstanden wird, bereits seit Jahren auf seinen Plattformen, um die Abläufe zu optimieren. Ein ganzer Stab von Forscher*innen arbeitet innerhalb des Konzerns an selbstlernenden Systemen, um Sprache besser zu verstehen, Gesichter auf Fotos und in Videos zu erkennen, die Verweildauer auf der Seite zu erhöhen, indem passgenaue Bilder in den Newsfeed gespült werden, oder Inhalte auszusortieren, die gegen die Richtlinien des Konzerns verstoßen. Gerade Letzteres stellt ein Problem dar, denn ob eine Nachricht, ein Foto oder Video gegen die Hausordnung verstößt, hängt vom Kontext ab – der ist aber gerade im Fall von Bildern und Videos technisch schwer zu erkennen.

Ganz großes Ethik-Theater

An Geld für Forschung in diesem Bereich mangelt es Facebook also nicht, auch nicht an fähigen Wissenschaftler*innen, die unter dem Dach des Konzerns an den Grundlagen und Anwendungen von so genannter Künstlicher Intelligenz (KI) forschen wollen. Warum sollte Facebook also ausgerechnet die Forschung zur Ethik im Zusammenhang mit KI nun an ein externes Institut auslagern?

Einen Teil der Antwort hat der Professor für Technologieverständnis John Naughton bereits vor einigen Tagen im britischen Guardian geliefert: Was Firmen und Konzerne im Zusammenhang mit KI derzeit aufführen, bezeichnet er als „Ethik-Theater“. Es ist die Aufführung von moralischer Verantwortung vor öffentlichem Publikum, vergleichbar mit der Aufführung von Sicherheit, die an den Schleusen von Flughäfen stattfindet.

Sheryl Sandberg verkündet diese Partnerschaft und sofort berichten Medien von Tagesschau bis Süddeutsche Zeitung. Facebook hat auf diesem Weg für 6,6 Millionen Euro eine vergleichsweise günstige Image-Kampagne in der deutschen Medienlandschaft eingekauft.

Zum Vergleich: 2017, dem letzten berichteten Jahr, hat Facebook laut eigenem Jahresbericht 4,7 Milliarden US-Dollar für Marketing und Sales weltweit ausgegeben. 7,75 Milliarden US-Dollar flossen in Forschung und Entwicklung. Es ist unklar, in welchem Bereich die Ausgaben für das Sponsoring der TU verbucht werden, aber in keiner der beiden Sparten fallen 6,6 Millionen Euro arg ins Gewicht.

Moralische Überlegungen als Nachsatz

Was dabei hinten runter fällt: Was Facebook tatsächlich in seiner täglichen Praxis tut oder sein lässt. So hat eine Recherche des US-Investigativ-Mediums The Intercept gezeigt, dass Facebook Algorithmen dazu einsetzt, das Verhalten seiner Nutzer*innen vorherzusagen und dies an Werbekunden zu verkaufen. Firmen können dann Werbung an Menschen ausspielen, die eine bestimmte Entscheidung noch nicht einmal getroffen haben. In Australien warben Facebook-Manager bei einer Großbank damit, sie könne mit dieser Technik „emotional verletzliche Teenager“ in ihren schwächsten Momenten erreichen.

Im Dezember machte die US-Journalistin Gillian Brockel in einem viralen Posting darauf aufmerksam, wie unbeabsichtigt grausam die personalisierte Werbung von Facebook, Instagram und anderen Plattformen ausfallen kann: Nachdem sie ihren Sohn tot geboren hatte, bekam sie Anzeigen für Still-BHs, Buggys und Einschlaf-Hilfen in die Timeline gespielt. Der Algorithmus ging davon aus, dass sie gerade ein Neugeborenes mit nach Hause genommen hatte. Facebook entschuldigte sich bei ihr, allerdings mit dem Hinweis, sie hätte die entsprechende Werbung in den Einstellungen ja blockieren können.

„Es (das Feature zum Blocken von Werbung) braucht noch Verbesserung, aber bitte verstehen Sie, dass wir daran arbeiten und uns über ihr Feedback freuen“, schrieb der Leiter der Anzeigenabteilung auf Twitter. Das Beispiel mag ein Einzelfall sein, aber es zeigt, welche Rolle Ethik in den Abläufen von Facebook spielt. Im großen Ganzen sind ein paar Tausend Frauen, die im Jahr Fehlgeburten haben und anschließend falsch kategorisiert werden, nicht so entscheidend für den Konzern, der mit den Daten von Millionen jungen Müttern gutes Geld verdient – aber er freut sich über ihre Rückmeldung zur Verbesserung seiner Produkte. Moralische Überlegungen sind bei Facebook ein Nachsatz zu dem, womit sich Profit machen lässt.

Institutsleiter: „Reputationseffekt ist in Ordnung“

Ist das Institut für Facebook also ein Manöver, um von den harten Fragen zum Umgang mit den Daten, Leben und Gefühlen seiner Nutzer*innen abzulenken? Christoph Lütge, der an der TU München zu Wirtschaftsethik forscht und das neue Institut leiten wird, sagt gegenüber netzpolitik.org, er habe kein Problem damit, wenn Facebook einen Imagevorteil aus der Sache zieht. „Kann sein, dass es einen Reputationseffekt gibt. Das würde ich aber nicht verkehrt finden.“ Wenn die von Facebook finanzierte Forschung dazu führe, dass KI am Ende ethischer angewandt werde, habe er „nichts gegen einen Win-Win-Effekt, von dem auch Facebook profitiert.“ Anders als beim Berliner Humboldt-Institut (HIIG), das maßgeblich von Google finanziert wird und wo Google über eine Stiftung auch mit in der Aufsicht sitzt, werde im Advisory Board seines Institutes kein Vertreter von Facebook mitreden.

Es klingt aber auch nicht so, als sei das notwendig, denn Lütges Vorstellungen entsprechen ohnehin den strategischen Interessen des Konzerns. Anregungen zu geben, wie die Politik Künstliche Intelligenz zum Beispiel besser per Gesetz regulieren könnte, sei nicht das primäre Ziel, sagt Lütge. Das Institut wolle „ethische Richtlinien“ entwickeln. Diese eigneten sich besser als Gesetze, um den Befürchtungen der Bevölkerung rund um KI beizukommen. „Diese Befürchtungen muss man aufgreifen, und das kann Ethik besser leisten als juristische Regulierung.“

Zur Frage, warum Facebook die Forschung zu Ethik in der Künstlichen Intelligenz auslagert und nicht selbst bearbeitet, hat Lütge noch eine andere Antwort. Sie ist sehr gut: „Man stelle sich vor, Facebook wäre mit eigenen ethischen Richtlinien rausgekommen. Das wäre unglaubwürdig gewesen.“ Das wäre es wohl in der Tat.