Facebook muss Inhalte entfernen, die rassistische Ideologien loben – auch wenn sie dabei nicht explizit die entsprechenden Begriffe benutzen. Das fordert ein eigener Bericht des Datenkonzerns. Facebook hatte im März bereits Lob auf rassistische Ideologien von seiner Plattform verbannt. Dies gilt allerdings nur für Posts, die explizit die Begriffe „white nationalism“ (weißer Nationalismus) oder „white supremacy“ (weiße Überlegenheit) benutzen.

Facebook musst in vergangenen Jahren viel Kritik wegen seiner Toleranz für rassistische Inhalte und Praktiken einstecken. US-Behörden verklagten den Konzern, weil er es jahrelang zuließ, bei Immobilienwerbung ethnische Minderheiten auszuschließen. Auch erlaubte der Konzern bisher fast jede Form von politischen Inhalten, darunter auch rassistische und menschenverachtende Äußerungen.

Als Reaktion kündigte Facebook im Vorjahr eine Serie von Berichten an, die sich mit der Kritik auseinandersetzen sollen. Der Konzern heuerte dafür die Anwältin Laura Murphy an, die lange eine Führungsrolle in der renommierten US-Bürgerrechtsorganisation ACLU einnahm.

Kritiker bezeichneten den vorliegenden Bericht jedoch als „auf klägliche Weise unzureichend“. In ihrem ersten Bericht hatte die Untersuchung im Dezember die Ergebnisse von Gesprächen mit Bürgerrechtsorganisationen zusammengefasst: „Innerhalb der Bürgerrechtsgemeinschaft beschweren sich sowohl die Vertreter der freien Meinungsäußerung als auch des Entfernens von Hassrede über die undurchsichtige Natur von Facebooks Content-Moderation und Durchsetzungspraktiken.“ Ein dritter, abschließender Bericht soll im Frühjahr 2020 erscheinen.

Keine Aufrufe zu Einschüchterungs-Events mehr

„Wir entfernen jetzt auch Posts von Personen, die planen, Waffen irgendwohin zu bringen um andere einzuschüchtern oder zu belästigen, oder die Personen dazu ermutigen“, schrieb Facebook-Vizechefin Sheryl Sandberg in einem Blogpost. Damit reagierte Facebook auf die Organisation von Events zur Einschüchterung von Minderheiten. Die Autoren des Berichts fordern, dass Facebook auch andere mögliche Wege untersucht, wie Eventseiten missbraucht werden könnten.

Die Autoren äußern sich auch zur Richtline zu „Gefährlichen Individuen und Organisationen“. Laut dieser wurden zum Beispiel Alex Jones oder Milo Yiannopolous dafür von Facebook gebannt, dass sie „bestimmte Kriterien für Hass oder Gewalt“ überschritten hatten. Laut dem Bericht bezieht Facebook dabei sowohl Aktivitäten auf Facebook als auch auf anderen Plattformen oder offline in seine Entscheidungen zur Sperrung ein. Die Autoren betonen, dass sie sich manchen Klagen über diese Richtline anschließen würden: sie sei „sowohl über-inklusiv als auch unter-inklusiv.“ Außerdem sei das Umgehen der Regeln sehr einfach.

Wohnungen, Jobs und Kredite

Ein Kerngeschäft Facebooks ist die Möglichkeit, Werbung nur sehr spezifischen Zielgruppen anzuzeigen. Doch nun will der Konzern bei Werbung für Wohnungen, Jobs und Kredite die Möglichkeiten zur Eingrenzung einschränken: ein limitiertes System soll beispielsweise Werbetreibenden für Immobilien nicht mehr erlauben, ihre Angebote nur Nutzern mit Interesse an spanischsprachigen Fernsehsendern anzuzeigen. Optionen für Alter, Geschlecht oder Wohnort sollen in dem neuen System ebenfalls nicht mehr vorkommen.

Diese Maßnahme hatte Facebook im März als Antwort auf mehrere Gerichtsverfahren von bürgerrechtlichen Organisationen angekündigt. Eine weitere Klage des US-Wohnungsministeriums läuft aber noch.

Facebook will außerdem eine Datenbank aller aktiven Werbungen für Wohnung, Jobs oder Kredite anlegen. Die soll sich dann jede Nutzerin frei anschauen können, auch wenn sie eigentlich nicht zu den geplanten Zielgruppen gehört. Werbetreibende sollen ihre Angebote selbst kennzeichnen, falls sie unter die drei betroffenen Kategorien fallen. Ansonsten soll „Technologie (z.B. Algorithmen oder maschinelles Lernen)“ Werbung erfassen, die nicht freiwillig gekennzeichnet wurde.

Moderation: Mehr Algorithmen, bessere Programme

Die vielbeschworenen Algorithmen werden auch bei der Content-Moderation zunehmend wichtiger: Im März 2019 wurden 65 Prozent der entfernten Hassrede-Inhalte von Algorithmen und nicht mehr von Usern gemeldet. Im Dezember 2017 waren es noch 24 Prozent.

Der Bericht geht auch auf die Arbeitsumstände von Facebooks Content-Moderatoren ein. Die seien nämlich nicht produktiv genug: Facebook würde momentan untersuchen, ob Moderationsentscheidungen ungenauer werden, je länger Moderatoren Hassinhalten ausgesetzt sind. Aber ja, man sei sich natürlich auch „sehr bewusst“, dass diese Moderatoren „ausreichende psychologische Unterstützung und Wellness-Ressourcen“ benötigen würden.

Letzten Monat hatte eine Reportage der US-Seite The Verge die extremen Arbeitsbedingungen in einem outgesourcten Moderationszentrum beschrieben. Kaum eine Mitarbeiterin würde es zwei Jahre in diesem Job aushalten.

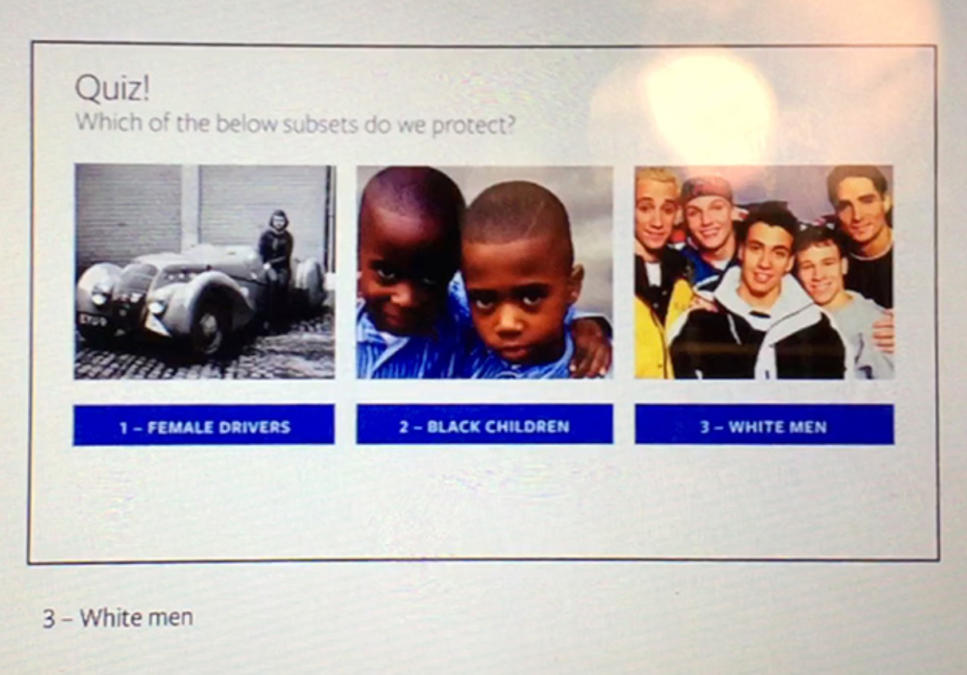

Außerdem sollen die Programme verändert werden, mit denen die Moderatoren ihre Arbeit machen. Bisher mussten diese zuerst entscheiden, ob ein Inhalt entfernt werden soll, und diese Entscheidung dann begründen. Aktuell laufe ein Pilotprogramm, bei dem Moderatorinnen sich durch eine Reihe an Fragen klicken, bis sie den Inhalt entfernen. Das soll den Prozess der Anwendung von Richtlinien vereinfachen.

Zusätzlich sollen Bildunterschriften nun direkt bei Bildern angezeigt werden, um zusätzlichen Kontext zu bieten: Ist ein Post ernst gemeint? Oder ist das Humor? Denn bisher enthalten die Richtlinien für Hassregeln eine Pauschalausnahme für humoristische Inhalte. Das sei viel zu breit gefasst, findet nun die Untersuchung: Sie empfiehlt die Entfernung der generellen Ausnahme und nur „eingeschränkte und präzise und objektiv definierte“ Sonderregelungen.

Wird 2020 besser als 2016?

Die USA werden nächstes Jahr einen Zensus durchführen. Facebook kündigt nun an, diesen Zensus ähnlich wie eine Wahlkampagne zu behandeln. Desinformation soll möglichst effektiv bekämpft werden. So bleibt soll eine schon etablierte „Civil Rights Task Force“ unter Facebook-Vize Sandberg nun permanent bestehen bleiben.

Auch für die anstehenden Wahlen verspricht der Bericht, dass man aus 2016 gelernt habe: Aufforderungen zur Nichtteilnahme an Wahlen sind nun verboten, Facebook habe in „proaktive Erfassungsalgorithmen“ investiert und ein Vollzeit-Wahlteam eingerichtet. Auch die schon vorhandene Datenbank von Wahlwerbung soll ausgebaut und besser zugänglich gemacht werden.

Richtigstellung: Ursprünglich stand in diesem Artikel, dass der US-Zensus eine Frage zur Staatsbürgerschaft enthalten würde. Diese Frage war aber schon am 27. Juni vom Supreme Court auf Eis gelegt worden.