Bias

-

Trumps KI-Plan: Ideologisch neutral, nicht „woke“

Symbolbild dieser Legislatur: Donald Trump hält seine Verordnungen gerne in die Kamera. Trumps KI-Plan: Ideologisch neutral, nicht „woke“ Die USA wollen bei KI weltweit führend bleiben – mit einem Aktionsplan, der mehr Freiheit für Unternehmen verspricht. Doch in einem Punkt greift die Regierung ein: KI darf nicht „woke“ sein. Das könnte zur ideologischen Säuberung von Trainingsdaten führen, warnen Fachleute.

-

Amazon Ring: Nachbarschaftsmeldungen landen in den USA direkt bei der Polizei

Nachbarschaftsapp wie die von Amazon Ring könnten Angst und Vorurteile fördern. (Symbolbild) Amazon Ring: Nachbarschaftsmeldungen landen in den USA direkt bei der Polizei Allein in Los Angeles hat die Nachbarschafts-App von Amazon Ring in zwei Jahren mehr als 13.000 Meldungen an die Polizei weitergeleitet. Eine Recherche zeigt: Viele dieser Meldungen haben gar nichts mit Kriminalität zu tun, sondern spiegeln die Paranoia und die rassistischen Vorurteile der Ring-Nutzer.

-

Degitalisierung: Was war nochmal das Problem?

Degitalisierung: Was war nochmal das Problem? Künstliche Intelligenz wird gerade fast wie Magie gehandelt. Ein paar Daten reingestopft, und alle Weltprobleme lösen sich in Wohlgefallen auf. Bisschen übertriebene Erwartung, findet unsere Kolumnistin. Und fragt sich, was Technologie eigentlich alles lösen soll.

-

Automatisierte Diskriminierung: Twitter prüft Rassismus in der Bildervorschau

Nutzer:innen entdeckten, dass die Twitter-Vorschau lieber das Gesicht des Republikaners Mitch McConnell zeigte als das von Barack Obama. Automatisierte Diskriminierung: Twitter prüft Rassismus in der Bildervorschau Die automatische Bilder-Vorschau von Twitter scheint die Gesichter weißer Menschen zu bevorzugen und Schwarze Menschen systematisch auszublenden. Das Unternehmen beteuert, die Technologie sei auf solche Verzerrungen getestet worden und will das Modell nun erneut überprüfen.

-

Datenrassismus: Eine neue Ära

Technology is never neutral. Datenrassismus: Eine neue Ära Datenbasierte Technologien bringen nicht nur mehr Effizienz. Sie werden auch zur Gefahr für jene, die ohnehin schon strukturell am Rand stehen. In ihrem Gastbeitrag erklärt Sarah Chander, was Datenrassismus ist, wie er sich auf Betroffene auswirkt und was wir dagegen tun können.

-

: Gesichtserkennung: Kritik macht Algorithmen genauer, nicht nur für weiße Männer

Zu Testzwecken hielt MIT-Forscherin Joy Buolamwini ihr eigenes Gescht in die Kamera - und wurde von vielen Systemen erst erkannt, als sie sich eine weiße Maske aufsetzte. : Gesichtserkennung: Kritik macht Algorithmen genauer, nicht nur für weiße Männer Die MIT-Forscherin Joy Buolamwini hat untersucht, wie ihre Kritik an diskriminierender Gesichtserkennung zur Lösung des Problems beiträgt. Ein halbes Jahr nach ihrer Studie zeigt sich: unabhängige Beobachtung wirkt. IBM, Microsoft und andere Hersteller erkennen nun Gesichter von Schwarzen und Frauen besser.

-

: Interview mit Maya Ganesh: Wie sehen uns Maschinen?

Maya Ganesh (links) im Gespräch mit Kathrin Maurer. : Interview mit Maya Ganesh: Wie sehen uns Maschinen? Datenforscherin Maya Ganesh erklärt im Video, was Big Data mit Diskriminierung zu tun hat und welche persönlichen Konsequenzen ein vermeintlich harmloses Thema wie Machine Learning haben kann.

-

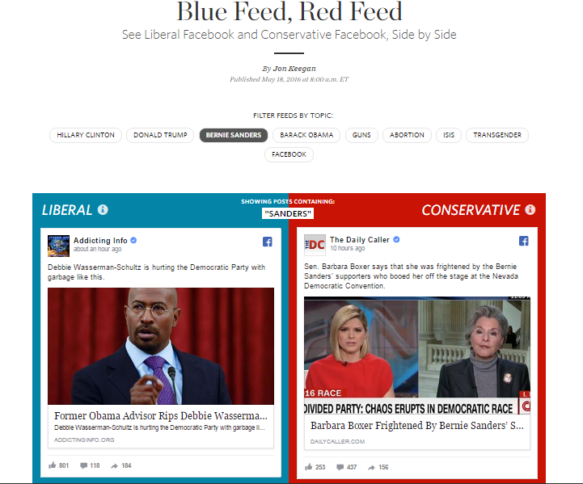

: Neues Tool zeigt konservative und liberale Filterbubbles bei Facebook

Screenshot des "Blue Feed, Red Feed" Tools der Washington Post : Neues Tool zeigt konservative und liberale Filterbubbles bei Facebook Facebook wird immer mehr zur primären Informationsquelle für seine fast 1,7 Milliarden Nutzer. Sei es Sport, Klatsch und Tratsch oder Politik – viele Nutzer erfahren Neues vorwiegend über den Facebook Newsfeed. Ein Tool des Wall Street Journals zeigt, wie unterschiedlich liberale und konservative Filterbubbles in den USA aussehen.