Wer ein wenig Zeit hat, dem sei ein lesenswerter Artikel empfohlen, der sich mit den Fragen der Roboterethik beschäftigt. Was passiert, wenn ein Roboter oder ein Algorithmus Gesetze bricht, wer trägt dafür die Verantwortung? Wie gehen wir in naher Zukunft mit Robotern um, die eine Intelligenz haben, die der menschlichen nahekommt, und wie geben wir ihnen eine gewisse Ethik mit: The Good, The Bad and The Robot.

Wer ein wenig Zeit hat, dem sei ein lesenswerter Artikel empfohlen, der sich mit den Fragen der Roboterethik beschäftigt. Was passiert, wenn ein Roboter oder ein Algorithmus Gesetze bricht, wer trägt dafür die Verantwortung? Wie gehen wir in naher Zukunft mit Robotern um, die eine Intelligenz haben, die der menschlichen nahekommt, und wie geben wir ihnen eine gewisse Ethik mit: The Good, The Bad and The Robot.

Wie man moralisches Handeln in mitdenkende und Entscheidungen treffende Roboter und Algorithmen einpflanzt, wird nicht erst diskutiert, seit der Random Botnet Shopper beinahe festgenommen werden sollte, weil er im Rahmen einer Kunstausstellung in der Schweiz im Netz jede Woche für einhundert Dollar in bitcoin einkaufen gegangen war und unter den dort erworbenen Schnäppchen eine Tüte Ecstasy war. Roboter sind insgesamt auf dem Vormarsch, ersetzen menschliche Arbeiter und werden intelligenter.

Die Diskussion geschieht bisher meist in akademischen Kreisen. Einige, wie etwa Stuart Russell, Informatik-Professor aus Berkeley, fürchten um die Existenz der Menschheit, wenn wir den Maschinen keine Wertmaßstäbe programmieren:

The survival of our species may depend on installing values in AI.

Russell schlägt aber auch Methoden vor, wie man mit dem Dilemma umgehen könnte, etwa bestimmte Lernstrategien, die über die Beobachtung und das Nachmachen hinausgehen:

Russell schlägt aber auch Methoden vor, wie man mit dem Dilemma umgehen könnte, etwa bestimmte Lernstrategien, die über die Beobachtung und das Nachmachen hinausgehen:

A robot observes the behavior of some other entity (such as a human or even another robot), and rather than simply emulating the actions, it tries to figure out what the underlying objective is.

Wer sich für den Stand der wissenschaftlichen Diskussion interessiert, dem kann der Artikel einen guten Überblick geben.

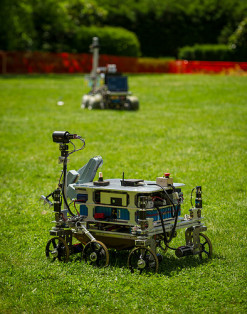

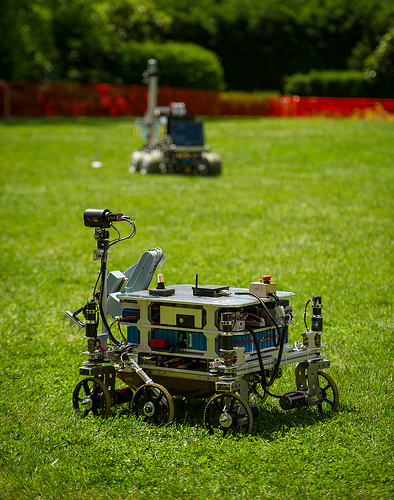

Bild-Lizenz der Roboter: CC BY-NC 2.0 via flickr

NASA HQ PHotos