„Popeln würde ich hier lieber nicht“, sagt Svenja. Die Enddreißigerin steht auf dem Mannheimer Marktplatz und beäugt argwöhnisch eine Dachkante. Dort sind sechs Kameras installiert. Fünf davon zeigen ungefähr in ihre Richtung. Die sechste ist eine dreh‑, kipp- und zoomfähige Kuppelkamera, bei der nur die kameraführende Person in der Polizei-Leitstelle weiß, was sie gerade filmt. Svenja dreht sich um und sieht eine weitere Kuppelkamera. „Das ist ja überhaupt nicht gruselig“, sagt sie und lacht trocken.

Svenja wusste bis eben nicht, dass sie gefilmt wird. Und auch nicht, dass eine Software ihr Verhalten analysiert und bei bestimmten Bewegungen Alarm auslöst. Ein Reporter von netzpolitik.org hat sie darauf aufmerksam gemacht. Es ist nicht so, dass sie regelmäßig in der Nase popeln würde, wie sie beteuert. Aber als sie die Kameras sieht, spürt sie direkt den Drang zur Selbstbeschränkung. Dass ihr erster Gedanke dabei der Nasenreinigung galt, ist ihr unangenehm. Sie bittet uns, für diesen Artikel ihren Vornamen zu ändern.

70 Kameras filmen den öffentlichen Raum in Mannheim. Bei 46 dieser Kameras untersucht eine Software die Bewegungsmuster der überwachten Menschen. Dafür verwandelt sie die Personen in Strichmännchen mit Knotenpunkten an den Gelenken und erfasst, wie sich die Gliedmaßen bewegen. So soll die Software vor allem Schläge, Tritte, Schubse, Rempler und Würgegriffe erkennen, aber auch andere Bewegungen wie Stehen, Gehen, Rennen, Rad- und Rollerfahren, Taumeln, Tanzen, Sitzen, etwas Tragen und jemanden Umarmen. Auch aggressive oder defensive Körperhaltungen soll die Software detektieren, so die Mannheimer Polizei.

„Mannheimer Modell“ haben die Verantwortlichen das Projekt genannt, das seit 2018 im Einsatz ist. Die Software soll dabei nicht nur Bewegungsmuster von mutmaßlich kriminellen Handlungen erfassen, sondern auch „Normalsituationen“, so die Mannheimer Polizei. Das sei erforderlich, „um diese von den polizeilich relevanten Sachverhalten abzugrenzen.“

Eine sogenannte KI schaut also mit 46 Augen permanent zu, was Menschen in Mannheim so treiben. Die Stadt ist ein Reallabor – und Passant*innen wie Svenja sind so etwas wie Labormäuse.

So arbeiten die Überwachenden

Die Aufnahmen der Mannheimer Kameras laufen im Führungs- und Lagezentrum des Polizeipräsidiums Mannheim zusammen. Dort beobachten Polizist*innen das Geschehen in der Stadt permanent auf einer Vielzahl von Bildschirmen. Wenn die Software ein verdächtiges Bewegungsmuster erkennt, ertönt ein Alarm. Auf einem der Bildschirme erscheint ein Hinweisfenster. In diesem sehen die Beamt*innen die Situation, die den Alarm ausgelöst hat, umrahmt von einem gelben Rechteck; daneben das Livebild der entsprechenden Überwachungskamera. Die zuständige Person entscheidet dann, ob die Polizei einschreitet, erklärt die Mannheimer Polizei weiter.

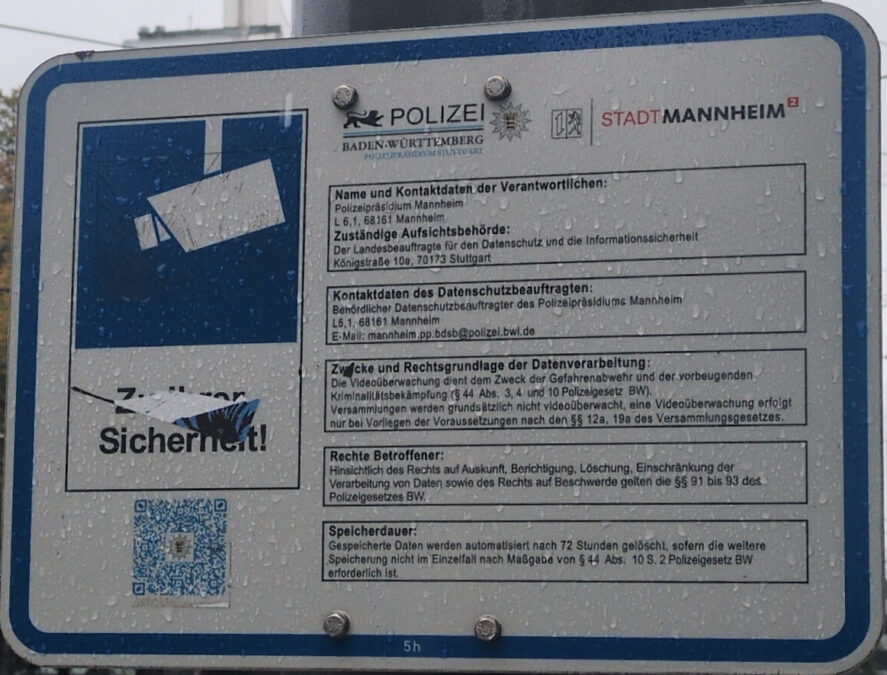

Mindestens 72 Stunden, also drei Tage lang, werden die Bilder gespeichert. Bei polizeilicher Relevanz bleiben sie sogar bis zu 28 Tage im System; bei Verwendung als Beweismittel noch länger. Die Mannheimer Polizei will mit der Software ihre Einsatzbelastung senken und Effizienz steigern.

Die gruselige Anziehungskraft der KI-Überwachung

Das Mannheimer Modell löst bei vielen Sicherheitsbehörden und ‑politiker*innen Begehrlichkeiten aus. Seit dem ersten September 2025 läuft es auch hinter Hamburger Kameras. Laut dem Fraunhofer-Institut für Optronik, Systemtechnik und Bildauswertung (Fraunhofer IOSB), das die Technologie entwickelt, haben weitere Städte und Kommunen Interesse bekundet. In Berlin wollen die Regierungsparteien das Polizeigesetz ändern, um den Einsatz der Technologie zu erlauben. In Hessen liegt diese Erlaubnis bereits vor; Innenminister Roman Poseck (CDU) nennt das Mannheimer Modell „vorbildhaft“. In Baden-Württemberg hat die grün-schwarze Landesregierung angekündigt, es ausweiten zu wollen, das nächste Testgelände ist Heidelberg.

Thomas Strobl (CDU), Innenminister des grün-schwarz regierten Baden-Württemberg, nannte das Mannheimer Modell im Mai 2025 einen „nationalen Leuchtturm“. Anlässlich der Verlängerung der Trainingsphase im Jahr 2023 sagte er, es sei „Vorbild für Maßnahmen an Kriminalitätsschwerpunkten im ganzen Land, wenn nicht europaweit.“ Christian Specht (CDU), heute Mannheims Oberbürgermeister, hat die KI-Überwachung im Jahr 2018 als Sicherheitsdezernent auf den Weg gebracht. Er fügte hinzu: „Viele sicherheitspolitische Augen sind gespannt auf uns gerichtet.“

Zu Beginn der automatisierten Verhaltenskontrolle in Mannheim gab es einigen Protest. Eine Gruppe namens „George-Orwell-Ultras“ riet in einem satirischen Video dazu, sich hinter Frachtcontainern auf dem Alten Messplatz vor der Erfassung durch die Kameras zu schützen. Ein Bündnis linker Gruppen lud zum Silent Dance gegen Überwachung; die lokalen Grünen unterstützten eine Petition dagegen. Heute sagt die Grünen-Kreisvorsitzende Tamara Beckh: „Mehr Kameras sollen es nicht werden“. Die Videoüberwachung könne ergänzend sinnvoll sein, „wir wollen aber eher auf eine personelle Stärkung der Polizei setzen“. Sie kritisiert, dass die KI-Überwachung bislang nicht evaluiert wurde und diskriminierend wirken könne.

Die Gefahr der Ausweitung

Jackenwetter, Dauerregen. Die Mannheimer Innenstadt ist dennoch sehr belebt an diesem Mittwochvormittag im September 2025. Menschen, die Kapuzen tragen, eilen mit gesenkten Köpfen über den Bahnhofsvorplatz. Tobias Roser steht zwischen ihnen unter seinem Regenschirm und zeigt um sich. „Da, da, da und da“, sagt er. Roser weiß genau, wo die Kameras hängen. Er lebt hier in der Gegend um den Hauptbahnhof und muss sie täglich passieren.

Roser ist Mitglied der Linksjugend solid, der Jugendorganisation der Partei Die Linke. Er fürchtet, dass die automatisierte Verhaltensanalyse ein großer Schritt hin zu einem Überwachungsstaat ist, „den man dann schlüsselfertig übergibt, wenn die Radikalen an die Macht kommen“. Wenn man einmal mit KI-gestützter Überwachung angefangen habe, läge es nahe, weiter aufzurüsten: etwa mit Technologie, die Gesichter erkennt, Lippen liest oder Menschen am Gang identifiziert.

Zwei Erweiterungen des Mannheimer Modells sind bereits geplant: Die Software soll in Zukunft bestimmte Gegenstände, etwa Waffen, erkennen. Und wenn sie eine mutmaßliche Straftat entdeckt, können die gefilmten Gesichter bald vom Landeskriminalamt durch eine Gesichtersuchmaschine gejagt werden. Im September 2024 hat die Landesregierung beschlossen, Lizenzen für eine solche Software zu kaufen.

Die Polizei hat auch nach sieben Jahren keine Ahnung, was die Verhaltenskontrolle bringt

Das Mannheimer Modell ist auch nach sieben Jahren weit von einem evidenzbasierten Betrieb entfernt. Die Vision seiner Fans sind schwarze Bildschirme, die nur anspringen, wenn die Software einen Alarm generiert. Tatsächlich wird dieses Konzept in der Mannheimer Videoüberwachungszentrale bisher nur auf einem einzelnen Bildschirm erprobt. Daneben gibt es zahlreiche weitere Monitore, auf denen weiter Beamt*innen das Geschehen in der Stadt beobachten. Der versprochene Vorteil für die Privatsphäre ist in der Praxis also nicht gegeben.

Die Mannheimer Polizei kann oder will auf Anfrage zudem nicht sagen, wie oft die Software angeschlagen hat und wie oft dadurch eine strafbare Handlung entdeckt wurde. „Der für das Projekt ablesbare Erfolg besteht in der stetigen Weiterentwicklung des Systems und kann zum derzeitigen Projektstand nicht mit Kennzahlen dargestellt werden“, schreibt sie.

Zu Beginn des Projekts hoffte die Mannheimer Polizei noch, das System könne irgendwann auch die Bewegungen bei einem Drogendeal oder Taschendiebstahl erkennen. Das zeigt die auf dem Kanal der Filmakademie Baden-Württemberg veröffentlichte Dokumentation „all eyes on you“. Heute schreibt die Polizei: „Ob das Ziel der Detektion von feinmotorischen Handlungsweisen erreicht werden kann, kann derzeit nicht beantwortet werden.“

Nach aktuellem Stand läuft das Projekt bis 2026. Eine unabhängige Evaluation ist nicht geplant. Nur das Landespolizeipräsidium im Innenministerium soll das Projekt nach seinem Abschluss begutachten. Der Landesdatenschutzbeauftragte Baden-Württemberg schreibt auf Anfrage von netzpolitik.org, dass die Maßnahme wegen der hohen Eingriffsintensität in Grundrechte eigentlich regelmäßig evaluiert werden müsse.

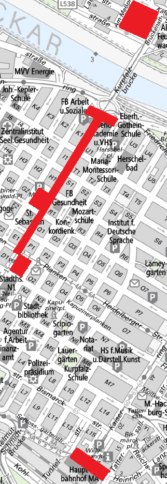

Noch steht die Überwachung rechtlich auf dünnem Eis

Die softwarebasierte Verhaltenserkennung begann mit Kameras am Willy-Brandt-Platz vor dem Mannheimer Hauptbahnhof und am Paradeplatz und wurde dann auf die Kurpfalzstraße – meist Breite Straße genannt –, den Marktplatz und zuletzt den Alten Messplatz ausgedehnt. Die Verwaltung hatte zudem geprüft, ob es nach dem aktuellen Polizeigesetz erlaubt ist, auch am Plankenkopf und auf dem südlichen Bahnhofsvorplatz Kameras aufzustellen, musste die Pläne jedoch verwerfen. „Bei beiden Bereichen konnte kein Kriminalitätsbrennpunkt begründet werden, weshalb die rechtlichen Möglichkeiten für einen Videoschutz nicht vorliegen“, schreibt die Mannheimer Polizei auf Anfrage von netzpolitik.org.

Rechtliche Voraussetzung für die Überwachung ist ein im Vergleich zum restlichen Stadtgebiet erhöhtes Aufkommen von Straftaten. Sinkt die relative Kriminalitätsbelastung deutlich, müssen die KI-Kameras nach baden-württembergischem Polizeigesetz wieder abgebaut werden. Deshalb musste die Stadt auch die Kameras, die sie ab 2001 aufgestellt hatte, im Jahr 2007 wieder entfernen. Nur der nördliche Bahnhofsvorplatz ist bis heute durchgängig videoüberwacht.

Die von der Polizei erfasste Straßenkriminalität in den überwachten Gebieten liegt nach einem zwischenzeitlichen Tief wieder auf der Höhe des Jahres vor der Einführung der Videoüberwachung. Die Drogendelikte sind nach Angaben der Polizei zum Teil deutlich zurückgegangen; das entspricht dem Trend in der gesamten Stadt. Besonders aussagekräftig ist die Kriminalitätsbelastung allerdings nicht. Denn die Zahl der erfassten Straftaten steigt automatisch dort, wo die Polizei genauer hinschaut.

Videoüberwachung nach Gefühl

Künftig will sich die Polizei in Mannheim bei der Überwachung des öffentlichen Raums durch Kameras nicht einmal mehr an den eigenen Kennzahlen orientieren müssen, sondern sie von der Kriminalitätsentwicklung entkoppeln. Laut Polizei soll ein Rechtsgutachten untersuchen, ob auch „strukturelle Kriminalitätsbrennpunkte“ per Video überwacht werden dürfen. Gemeint sind Orte, die aus Sicht der Polizei durch soziale, wirtschaftliche und infrastrukturelle Faktoren eine „erhöhte Tatgelegenheitsstruktur“ aufweisen – unabhängig davon, ob dort tatsächlich solche Taten erfasst wurden. Das würde der Polizei viel Spielraum geben, um Überwachung an immer mehr Orten zu legitimieren.

Laut einer Antwort der Stadt Mannheim auf eine Anfrage der Grünen aus dem Jahr 2024 arbeitet die Stadt an einer Novellierung des Polizeigesetzes von Baden-Württemberg mit, um solche „strukturellen Kriminalitätsbrennpunkte“ auch landesweit einzuführen. Somit wäre Videoüberwachung selbst dann möglich, wenn die Zahl der erfassten Straftaten sinkt.

Dieser Ansatz erinnert an das hessische Polizeigesetz. Dort ist die Rede von„Angsträumen“ und „gefühlten Kriminalitätsschwerpunkten“. Sie zeichnen sich ebenfalls durch „Tatgelegenheitsstrukturen“ aus und würden von der Bevölkerung gemieden, so die Begründung der entsprechenden Änderung des Polizeigesetzes, die im Dezember 2024 verabschiedet wurde.

Der baden-württembergische Datenschutzbeauftragte warnt davor, Gesetze zu verabschieden, die Gefühle zur Grundlage polizeilicher Maßnahmen machen. Die Aufsichtsbehörde verstehe zwar den Drang, das Sicherheitsgefühl der Bürger*innen ernst zu nehmen. Sie sehe aber Gefahren, wenn der Staat Maßnahmen mit hoher Eingriffsintensität für die Grundrechte mit Gefühlen begründe. „Der Staat muss für seine Bürger_innen berechenbar und sein Handeln nachvollziehbar und vorhersehbar sein. Vor diesem Hintergrund erschließt sich uns nicht, wie man mit der Intention in Freiheitsrechte einzugreifen, Gefühle oder Eindrücke objektivieren und rationalisieren könnte.“

Worauf die Kameras zielen, will die Polizei geheimhalten

Während die Polizei in Mannheim den öffentlichen Raum zunehmend durchleuchten möchte, will sie sich selbst nicht in die Karten schauen lassen. Eine Karte mit den genauen Positionen und Ausrichtungen der Kameras will die Behörde auf Anfrage nicht herausgeben – aus „polizeitaktischen Gründen“. Es gibt zwar eine Karte mit rot markierten Überwachungszonen auf der Website der Stadt und eine leicht abweichende mit blau markierten Überwachungszonen auf der Website der Polizei, aber beide weichen von der Realität ab.

So ist dort beispielsweise die Kurpfalzbrücke nicht markiert. Dabei wurde diese mindestens zeitweise von einer Kamera überwacht. Das hat der Prozess eines Mannes gezeigt, der mit Hilfe der Überwachungsbilder eine Verurteilung wegen Widerstand gegen Vollstreckungsbeamte abwehren konnte. Wieso die Kamera einen Bereich abgebildet hat, der nicht entsprechend gekennzeichnet ist, hat die Polizei bis Redaktionsschluss nicht beantwortet.

Die Kurpfalzstraße auf Höhe des Paradeplatzes ist auf der Karte der Stadt ebenfalls nicht als überwacht markiert, dabei zeigen mehrere Kameras deutlich darauf. Die Karte der Polizei zählt dieses Areal zur überwachten Zone; ebenso das südliche Ende des Alten Messplatzes. Laut der Karte der Stadt Mannheim ist dieser Bereich von der Überwachung ausgenommen; dabei sagte ein Polizist 2024, dass er zumindest teilweise von Kameras erfasst wird. Eine Sprecherin der Stadt schreibt auf Anfrage, die Karte solle nur einen „groben Überblick“ geben.

Eine detaillierte Karte mit den Kamera-Ausrichtungen und erfassten Arealen hätte vermutlich auch nur eine kurze Gültigkeit. Im Zuge von Optimierungen komme es gelegentlich vor, dass Kameras nachjustiert werden, schreibt die Polizei auf netzpolitik.org-Anfrage. Protokolle dazu gebe es nicht. Private Immobilien, sowie Areale „die nicht in den videogeschützten Bereich fallen“, würden aber verpixelt.

Die Software braucht viele Schlägereien

Eine Hürde bei der Entwicklung der Verhaltenserkennung ist der Mangel an Beispielen für reale Straftaten. Die Software kann nur dann einen Schlag von einem Fistbump unterscheiden, wenn sie beides häufig zu sehen bekommt.

In der Praxis gibt es in deutschen Innenstädten viel weniger Schlägereien als für KI-Forschende wünschenswert wäre. „Wie sich im Verlauf des Projektes zeigte, stehen leider nur sehr begrenzt öffentliche Daten zur Verfügung“, schreibt die Mannheimer Polizei. Wohl auch deshalb haben Polizist*innen Schlägereien zum KI-Training simuliert. Gestellte Situationen spielen „eine wichtige Rolle“, schreibt das Fraunhofer IOSB, das die Software entwickelt.

Der Datenwissenschaftler Heiko Paulheim von der Universität Mannheim sieht das kritisch. Wenn die Datengrundlage der Software zum großen Teil aus inszenierten Kämpfen zwischen meist weißen und männlich gelesenen Polizisten bestünde, könne das darauf hinauslaufen, dass die KI bei Frauen und BIPoC weniger zuverlässig funktioniert und öfter zu Unrecht anschlägt.

Wir sind ein spendenfinanziertes Medium.

Unterstütze auch Du unsere Arbeit mit einer Spende.

Auch auf anderem Wege können marginalisierte Gruppen vermehrt ins Visier der KI-basierten Überwachung geraten. Die Mannheimer Software erkennt beispielsweise auch liegende Menschen – und wer in der Öffentlichkeit liegt, ist oft obdachlos. Bislang darf die Software nur bei Hinweisen auf eine Straftat Alarm schlagen. Die Landesregierung plant aber, den Einsatz der Verhaltenserkennung auch gegen Menschen in einer mutmaßlich hilflosen Lage zu erlauben.

Wer das Mannheimer Modell zahlt – und wem die Software gehört

In der Kooperation zwischen Stadt und Polizei Mannheim und dem Fraunhofer IOSB teilen sich die Parteien die Kosten. Die Polizei zahlte 190.000 Euro für Videoarbeitsplätze und Videomanagementsoftware, Speicher- und Serverstruktur. „Personalkosten wurden nicht erhoben“, schreibt sie. Die Stadt zahlte 860.000 Euro für Erwerb, Montage und Verkabelung der Kameras. Das Fraunhofer IOSB finanziert die Software-Entwicklung.

Die Software des Mannheimer Modells gehört dem Fraunhofer IOSB. Es habe sich vertraglich verpflichtet, auf eine kommerzielle Verwertung „vorerst zu verzichten“, schreibt das Institut an netzpolitik.org. Die Polizei Baden-Württemberg könne die Software, wenn sie marktreif werden sollte, kostenfrei nutzen, schreibt die Mannheimer Polizei.

Die Trainingsdaten für das Mannheimer Modell liefern Menschen in Mannheim – oftmals nichtsahnend – kostenlos.

Drogendeals knapp außerhalb des Videobilds

Der Wilde Wein, der die Fassade der Alten Feuerwache am Alten Messplatz erobert hat, umrankt acht Kameras. Vor ihren Linsen springen und gleiten Skateboarder über selbstgebaute Rampen und Rails, Kinder planschen in den Fontänen eines Brunnens, Menschen konsumieren offen Cannabis und Lachgas – und den Spritzen auf dem Boden zufolge wohl auch mehr.

So berichtet es der Journalist Manuel Schülke bei einem Spaziergang über den Platz. Er ist Redakteur beim hyperlokalen Nachrichtenportal Neckarstadtblog und hat sich ausgiebig mit der Mannheimer Videoüberwachung beschäftigt. Schülke sagt: „Ich habe meine Zweifel, dass die bringt, was sie soll.“ Zu häufig lese er im Polizeibericht von Straftaten im Überwachungsbereich, bei denen keine Streife rechtzeitig vor Ort war und trotz Videoaufzeichnung Zeug*innen gesucht werden. „Da hat die Abschreckung nicht funktioniert und die anschließende Strafverfolgung ist auch mau“, sagt er.

Damit die Kameras potenzielle Kriminelle nicht einfach in die Nebenstraßen verdrängen, sind bestimmte Polizist*innen dazu abgestellt, um die videoüberwachten Areale zu patrouillieren. Sie sollen auch eingreifen, wenn eine Kamera eine Straftat filmt.

Schülke zufolge spielen sich Drogendelikte auf dem Platz oftmals knapp außerhalb des überwachten Bereichs ab, etwa in einem anliegenden Parkhaus oder dort, wo der Platz an die Neckarwiese grenzt. Im November 2024 hat die Polizei in diesem Teilareal eine Razzia gegen Drogenhändler*innen durchgeführt.

Schülke hatte zur Einführung der Kameras versucht, Beispielbilder zu bekommen, die zeigen, welche Bereiche die Kameras am Platz aufnehmen; die Polizei habe die Antwort aus ermittlungstaktischen Gründen verweigert. „Es gibt da uneinsehbare Areale und die wollen nicht, dass das jemand weiß“, sagt der Journalist.

Gut einsehbar für die Kameras seien dagegen die Eingänge zu sensitiven Einrichtungen aus dem Gesundheitsbereich, darunter Praxen für Psychotherapie, ein Zentrum für sexuelle Gesundheit und eine psychologische Beratungsstelle für queere Menschen.

Das denken die Mannheimer*innen über die Überwachung

Nino (56) steht auf der Kurpfalzstraße nahe des Marktplatzes und meint, die Mannheimer Kameras gut zu kennen. Dann kreist sein Zeigefinger aber doch erst einmal orientierungslos, während er mit der anderen Hand sein Bier festhält. „Ah da“, sagt Nino nach einer Weile und deutet auf eines der Geräte. „Ich finds scheiße“, sagt er. Da ist Nino nicht allein. Fünf Prozent der Mannheimer*innen versuchen laut einer Untersuchung von 2022/23, die überwachten Areale möglichst zu vermeiden.

Manuela (52) und Karin (77) wollen gerade den Marktplatz überqueren. Manuela sagt, als “Monnemerinnen“ seien sie inzwischen an die Überwachung gewöhnt, aber für sie sei sie nicht nötig. Sie und Karin fühlten sich hier sicher, auch nachts. „Und wenn die noch 1.000 Kameras aufhängen, macht das die Welt auch nicht besser“, sagt Karin. Manuela erinnert an den Polizisten Rouven Laur, der 2024 hier auf dem Marktplatz erstochen wurde. „Wer was machen will, der macht das auch mit Kameras“, sagt sie.

Manuela, Karin und Nino sind drei von insgesamt zwölf Passant*innen, die wir in Mannheim auf die Kameras angesprochen haben. Die drei wussten von den Kameras, die sie beobachten – die anderen neun aber nicht.

Das könnte auch an der zurückhaltenden Beschilderung liegen. Die weißen Warntafeln sind so groß wie ein DIN-A3-Papier und hängen ziemlich hoch. Sie sind unauffällig gefärbt und mit viel Text in kleiner Schriftgröße bestückt. Dort stehen Kontaktdaten der Polizei, ihres Datenschutzbeauftragten und der zuständigen Aufsichtsbehörde; Zweck und Rechtsgrundlage der Datenverarbeitung, Betroffenenrechte und Speicherdauer. Daneben ist ein Kamerasymbol im Bierdeckelformat zu sehen. Kein Wort von softwarebasierter Verhaltenskontrolle.

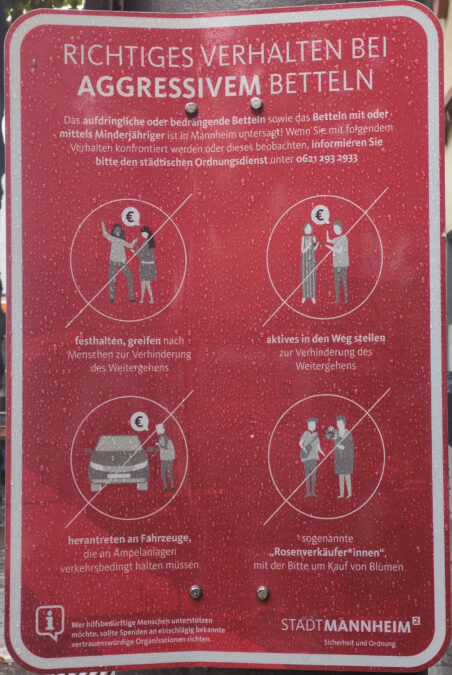

Interessant ist der Kontrast zu den Schildern „Richtiges Verhalten bei aggressivem Betteln“, die Passant*innen dazu aufrufen, bettelnde Menschen dem Ordnungsamt zu melden. Diese Schilder sind doppelt so groß wie die Kamera-Warnschilder und knallrot.

Update, 20.10.2025, 10.28 Uhr: Zitat von Tamara Beckh erweitert.

Schreibe eine Ergänzung!