Die Debatte darum, wie mit der Medienmacht von großen Intermediären wie Facebook oder Google umzugehen ist, hat sich mit der Verabschiedung des Netzwerkdurchsetzungsgesetzes noch lange nicht erledigt. Auf der Media Convention im Rahmen der re:publica hat Frank Pasquale zu diesem Thema einen vielbeachteten Vortrag unter dem Titel „Die automatisierte Öffentlichkeit“ gehalten. Wir haben mit ihm darüber gesprochen, wie algorithmische Systeme die digitale Öffentlichkeit strukturieren und warum die Intermediäre stärker reguliert werden sollten. Pasquale ist Professor für Öffentliches Recht an der University of Maryland.

Leben in der Black Box

netzpolitik.org: Sie haben in Ihrem Vortrag „The automated public sphere“ beschrieben, wie Algorithmen die digitale Öffentlichkeit strukturieren und warum die Unternehmen, die sie kontrollieren, stärker reguliert werden sollten. Bevor wir ins Detail gehen: Was meinen Sie, wenn Sie von „Algorithmen“ sprechen?

Frank Pasquale: Im Fokus standen für mich die computerisierte Sortierung von Newsfeeds in Sozialen Netzwerken und von Suchergebnissen. Dabei geht es mir vor allem um Facebook und Google, denn sie dominieren, wie viele Menschen Nachrichten wahrnehmen und die Welt verstehen. „Algorithmus“ meint hier jegliche computerbasierte Methode, einen Daten-Input in einen bestimmten Output zu verwandeln. Der Input ist dann beispielsweise das vorangegangene Verhalten einer Person in einem Sozialen Netzwerk, welches den zukünftigen Nachrichtenkonsum der Person beeinflusst.

netzpolitik.org: Was finden Sie an diesen Systemen problematisch?

Frank Pasquale: Diese Algorithmen sind deshalb ein Thema, weil sie extrem mächtig sind. Sie wären selbst dann bedenklich, wenn sie komplett transparent wären – weil einige wenige US-Konzerne die Öffentlichkeiten überall auf der Welt prägen. Aber sie sind zum zweiten deshalb besonders bedenklich, weil sie geheim sind. Das müssen sie zu einem gewissen Maße sein, damit sie nicht ohne Ende ausgespielt werden können, doch derzeit sind sie eine totale Black Box. Zu viele Menschen haben kein Verständnis davon, wie Google, Facebook und andere große Intermediäre unseren Daten in die eben beschriebenen Outputs verwandeln und unsere Wahrnehmung von der Welt prägen.

Facebook und Google: Marge über Mission

netzpolitik.org: Wir sehen im Bereich dieser Intermediäre eine große Tendenz zur Monopolbildung [Youtube]. Was bedeutet das für die digitale Öffentlichkeit?

Frank Pasquale: Auch in der Vergangenheit gab es große Medienkonzerne, die die politische Agenda bestimmen konnten, beispielsweise die oft ebenfalls monopolartigen Rundfunkkonzerne. Dies geschah aber in einer Mischung aus dem Streben nach Profit auf der einen Seite und dem Bewusstsein für öffentliche Verantwortung und journalistische Sorgfaltspflicht auf der anderen. Da gab es eine gewisse Balance zwischen Marge und Mission. In der neuen, automatisierten Öffentlichkeit, die von wenigen Silicon-Valley-Unternehmen dominiert wird, wurde die Mission für viele Jahre dem Gewinnstreben komplett untergeordnet. Die übliche Erzählung ist, dass das eine gute Sache ist, weil der Gewinn zeige, dass diese Unternehmen ihre Kunden zufriedenstellen. Und je mehr Menschen ihre Dienste nutzen, desto besser würden sie werden. Wir sehen aber häufig, dass dieses Drängen auf Profit dazu führt, dass sie auch Inhalte verbreiten, die toxisch sind, sensationalistisch; Inhalte, die nicht zwangsläufig eine Faktenbasis haben – und die durch Microtargeting zugeschnitten sind.

netzpolitik.org: Auch die meisten journalistischen Medien sind profitorientiert. Was ist die neue Dimension, die die Intermediäre mit sich bringen?

Frank Pasquale: Natürlich waren auch die alten Medien sensationsheischend und verantwortungslos – und sind es manchmal bis heute, wie der Blick auf die großen Nachrichtenkanäle zeigt. Aber der Unterschied ist, dass dieses klassische Symptom der Verantwortungslosigkeit in der automatisierten Öffentlichkeit mit algorithmisch getriebenen Microtargeting kombiniert wird. Man kann also wirklich extremistische Inhalte erzeugen, die nur an die Leute ausgespielt werden, für die sie annehmbar erscheinen. Andere Leute, die diese Inhalte in Frage stellen könnten, werden sie gar nicht zu sehen bekommen. Wenn alle das Gleiche sehen, kann ich jemanden zum Beispiel darauf hinweisen, dass etwas schlicht unwahr ist. Microtargeting führt zu einem Mangel an Anfechtungsmöglichkeiten bestimmter Inhalte und an argumentativer Deliberation, die für eine Demokratie unabdingbar sind.

Bedenkliche Konzentration finanzieller und psychologischer Macht

netzpolitik.org: Sie weisen darauf hin, dass die Problematik der automatisierten Öffentlichkeit eng mit den Geschäftsmodellen der genannten Firmen zusammenhängt. Inwiefern?

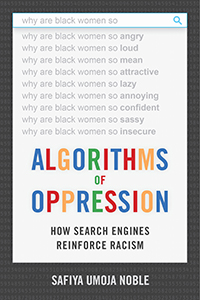

Frank Pasquale: Zwei Beispiele veranschaulichen das: In ihrem [kommenden] Buch „Algorithms of Oppression“ zeigt Safiya Noble auf, wie die Auto-Complete-Funktion von Suchmaschinen gesellschaftliche Minderheiten oft mit negativen Eigenschaften assoziiert. Das passiert, weil die Suchmaschine hier in Teilen wie eine Wahlmaschine funktioniert, die leicht manipuliert werden kann: Weiße Rassisten, Antisemiten oder andere Minderheiten-feindliche Gruppen können das Auto-Complete in ihrem Sinne manipulieren, indem sie häufig bestimmte Begriffe gemeinsam suchen. Aus einer ausschließlichen wirtschaftlichen Perspektive könnte man sagen: Die Suchmaschine gibt den Kunden, was sie wollen. Dem zugrunde liegt aber eben ein sehr limitiertes Verständnis davon, was Menschen wollen.

Für das Facebook-Beispiel hat Jodi Dean in ihrem Buch „Blog Theory“ die „Circuits of Drive“ der Sozialen Medien beschrieben: In der automatisierten Öffentlichkeit stehen nicht die Inhalte an erster Stelle, die am nützlichsten, am wahrhaftigsten oder gemeinwohlorientiertesten sind, sondern Inhalte, die die größte Interaktion auslösen. Diese wiederum werden genutzt um psychologische Profile der Nutzer zu erstellen. Es geht dabei nicht mehr nur um die Binarität von Like oder nicht-Like, sondern um die Analyse emotionaler Reaktionen durch Affective Computing: Fröhliches Gesicht, trauriges Gesicht, weinendes Gesicht und so weiter. Das ist vor allem hilfreich für Werbetreibende, die Menschen an ihren verletzlichsten und emotionalsten Punkten treffen wollen. Die Ausrichtung auf Inhalte, die die größten Emotionen auslösen, ist also in erster Linie ein Weg, unsere emotionale Arbeit in Kapital umzuwandeln.

netzpolitik.org: Anschaulich wird das unter anderem daran, dass vor wenigen Wochen öffentlich wurde, dass Facebook sein Targeted-Advertising-Tool bei einer australischen Großbank damit beworben hat, dass diese mit ihrer Werbung auf der Plattform gezielt emotional verletzliche Teenager ansprechen könnte. Für Ihre Analyse der digitalen Öffentlichkeit greifen Sie auch auf die Arbeit der Frankfurter Schule zurück. Wie kann sie helfen, die Macht der Intermediäre zu verstehen?

Frank Pasquale: Ich spreche ja über den Zusammenhang von Kapitalakkumulation und emotionaler Manipulation – und ich entschuldige mich schon mal für meine intellektuellen Verkürzungen an dieser Stelle -, dafür sind die Arbeiten der Frankfurter Schule sehr hilfreich, weil sie Einsichten von Marx und Freud über das Ökonomische und das Psychologische kombiniert haben. Sie taten das, um zu zeigen, wie gewisse Formen der Macht von Unternehmen das Bewusstsein der Menschen so prägen können, dass diese bestimmte Aspekte des Lebens nicht mehr hinterfragen, in denen ihnen Emanzipation versagt wird. Das hilft zu erkennen, dass die Kombination aus großer Finanzkraft auf der einen und dem Schlüssel zur Psyche der Menschen, zu dem, was sie begehren, auf der anderen Seite, ein mächtiges Werkzeug für Manipulation und Kontrolle ist. Die Ideen der Frankfurter Schule mögen manchen in der heutigen Situation als unangemessen vorkommen, weil sie im abscheulichen Angesicht des Totalitarismus entwickelt wurden. Aber da immer mehr Menschen in der digitalen Öffentlichkeit leben und in der Mediatisierung ihrer Wertvorstellungen von diesen großen US-Unternehmen abhängen, müssen wir erkennen, dass deren Konzentration sowohl monetärer als auch psychologischer Macht ein Grund zur Sorge ist.

Microtargeting im Wahlkampf ist missbrauchsanfällig

netzpolitik.org: Eine gutes Beispiel für die Bedeutung dieser Kombination ist vielleicht auch der Einsatz Microtargeting im Wahlkampf. Wir haben in den USA gesehen, wie die Trump-Kampagne Negativinformationen über Hillary Clinton sehr gezielt an bestimmte Wählergruppen ausgespielt hat, um ihre Motivation zu schwächen, für seine Konkurrentin zu stimmen – sogenanntes „Voter Suppression“. Die Parteien in Deutschland sagen bislang einhellig, dass Microtargeting eine gute Möglichkeit sei, mit Wählerinnen und Wählern in Kontakt zu kommen.

Frank Pasquale: Ich würde dem entgegnen, dass es viele Studien gibt, in denen Menschen eindeutig gesagt haben, dass sie kein verhaltensbasiertes Targeting wollen, speziell von politischen Parteien. Aber gab es dazu in Deutschland nicht eigentlich auch ein Abkommen?

netzpolitik.org: Es gibt mehr oder weniger klare Selbstverpflichtungen der demokratischen Parteien, auf Fake News und Manipulation durch Social Bots zu verzichten. Microtargeting ist da nicht miteingeschlossen.

Frank Pasquale: Oh, das ist interessant. Ich finde, dass es eine demokratische Minimalanforderung ist, ein Register der zugeschnittenen Werbung einzurichten, um Microtargeting öffentlich nachvollziehbar zu machen. Wenn es einen Missbrauch dieser Technik gibt, haben wir zumindest einen Nachweis dieser Tätigkeit und könnten notfalls widersprechen. Ich würde aber lieber in einer Welt ganz ohne Microtargeting leben. In den USA kommt beispielsweise noch das Problem der Parteienfinanzierung hinzu: Wenn alle politischen Akteure in etwa die gleichen Mittel für Targeting zur Verfügung haben, ist das okay. In den USA aber gibt es die einflussreichen Milliardäre, die ihr Geld in den Wahlkampf werfen und das Gewicht des Microtargeting potenzieren können.

Keine Angst vor Regulierung

netzpolitik.org: Zurück zu den Black Boxes: Sie diskutieren die Intermediäre in einer Reihe mit klassischen journalistischen Medien. Facebook hat für sich lange Zeit in Anspruch genommen, eine neutrale Plattform zu sein. Welche Regulierung braucht die digitale Öffentlichkeit Ihrer Meinung nach?

Frank Pasquale: Facebook versucht jetzt, sich als globale Community und globale Öffentlichkeit zu verkaufen. Somit ist inzwischen unbestreitbar, dass damit Verantwortung einhergeht. Meine größte Sorge ist, dass die Verteidiger der Meinungsfreiheit pauschal davor warnen, das Internet durch Regulierung kaputt zu machen. Ich glaube nicht, dass es nur eine einzige Form des Internets mit einem einzigen globalen Regel-Set geben muss und dass wir uns deshalb immer lediglich auf den kleinsten gemeinsamen Nenner einigen müssen. Technisch ist es sehr wohl möglich, die Funktionsweise der Plattformen an nationale oder gerade supra-nationale Regulierungen wie der EU anzupassen.

netzpolitik.org: Wo würden Sie konkret ansetzen?

Frank Pasquale: Ein grundlegender Punkt ist, dass Menschen verstehen können, wie die automatisierte Öffentlichkeit funktioniert. Also welche Daten gehen als Input in die Maschine und was führt zu dem, was ich am Ende in meinem Newsfeed oder in der Suchmaschine sehe. Ein anderer Aspekt muss auf jeden Fall eine größere Aufmerksamkeit der Plattformen für „Hate Speech“ sein. Mindestens braucht es hier ein vernünftiges Monitoring und extrem hasserfüllte Inhalte sollten konsequenter gebannt werden. Aggressives Verhalten von Social Bots, etwa Hashtag-Flooding, sollte zudem unterbunden oder mindestens kenntlich gemacht werden. Ein weiter Punkt ist Verbraucherschutz: Es braucht ein ganz klares Labelling von Werbung und die Möglichkeit, zu verstehen, wer welche Werbung zu welchem Zweck gekauft hat.

netzpolitik.org: Wir erleben in Hinblick auf die Regulierung der digitalen Öffentlichkeit eine große Ambivalenz. Auf der einen Seite die von Ihnen angesprochene Scheu vor Eingriffen, weil dies „Innovation bremsen“ könnte. Auf der anderen Seite gibt es aber auch fundierte Ängste vor Overblocking. Auch NGOs kritisieren in Deutschland beispielsweise das neue Netzwerkdurchsetzungsgesetz, weil es die inhaltliche Dominanz der digitalen Öffentlichkeit durch die Betreiber der Social-Media-Plattform zementiert, indem diese gesetzlich verpflichtet werden, allein und schnell zu entscheiden, welche Inhalte gewünscht beziehungsweise legal sind und welche nicht.

Frank Pasquale: Es gibt die berechtigte Sorge vor Collateral Censorship, also eine wahllose Zensur durch die Intermediäre, die Strafen entgehen wollen und deshalb zu viel löschen. Die Antwort kann nur sein: Regierungen, Zivilgesellschaft und Plattformen müssen zusammenarbeiten und Governance-Strukturen schaffen, die die Qualität der Öffentlichkeitsregulierung sicherstellen.

Ich halte zum Beispiel extreme Strafen für Fake News nicht für die Lösung. Aber vielleicht brauchen wir auch hier eine neue externe Institution, die auf bestimmte gefährliche und falsche Inhalte hinweist. Selbst wer sich um Zensur sorgen macht, sollte keine Angst vor einem Hinweis neben einer Nachricht haben, der zu einer Rekonstruktion führt, woher eine Story ursprünglich stammt. Der Pizzagate-Fall ist dafür ein gutes Beispiel, weil die Geschichte wirklich absolut keine Faktenbasis hatte, aber sich unglaublich verbreitete. Hier hätte ein Verweis auf die Wurzeln der Geschichte auf einer Webseite weißer Rassisten geholfen.

Wir können also gerne einen Dialog über die Vorbehalte gegen Regulierung führen, aber Meinungsfreiheitsfundamentalismus hilft auch nicht weiter. Weder brauchen wir eine schwerfällige staatliche Überregulierung der Öffentlichkeit, noch sollten wir weiterhin sagen, dass Google und Facebook schon von alleine alles richtigmachen werden. Wir müssen einen Mittelweg finden. Ein Weg wären korporatistische Einigungen, wie sie in der Vergangenheit in Verhandlungen zwischen Arbeitskräften und Arbeitgebern gelungen ist. Wir riskieren sonst die totale Fragmentierung der Öffentlichkeit.

Tracking, Tracing abstellen. Nicht dauernd eingloggt surfen, alles Blocken bis hin zu DNS Request.

Dann kann man auch ohne Filterbubble surfen.

Viel Spass ^^

So einfach ist die Welt nicht, denn es ist unerheblich, wenn Du Dich anonymisieren kannst (ginge eh nur via VPN, Tor, eigene DNS-Server, ansonsten greift die VDS). Entscheidend ist eher die Frage, ob es die Masse kann. Definitiv nein. Und das ist letztlich die große Gefahr. Das Wissen kann jederzeit politisch / wirtschaftlich genutzt und ggf. gegen den Nutzer eingesetzt werden (Siehe die ganzen Fälle in der Türkei). Je länger das deanonymisierte Netz besteht und desto größer die Anzahl der Teilnehmenden ist, desto mehr Nutzer bzw. Gruppierungen werden ausgegrenzt, gefiltert, auf Sperrlisten gesetzt usw.. Dazu Finanzscores, Socialscores oder sonstige Scores die Dich einfach so abstempeln und sagen wer Du bist (So ein Blödsinn). Das System schadet letztlich der gesamten Menschheit. Denn Menschen sind nicht wirklich diejenigen, so wie sie Facebook oder Google idealisieren. Jeder Mensch ist fehlbar, einem Auswertungscode jedoch ist das vollkommen egal. Ein Fehler folglich keine Wohnung, keinen Job kein Irgendwas, wenn diese Entwicklung weitergeht und die Hose voller Angst irgendetwas falsch zu machen. Das ganze Ding ist ein digitales Monster und nachhaltig schädlich für die gesamte Gesellschaft. Denn jeder will alles wissen, die Regierungen dieser Welt, die Kreditgeber dieser Welt, die Vermieter dieser Welt und wenn Du nicht durchgenormt bist, bist Du raus und darfst in 10 Jahren auf der Parkbank schlafen. Und für diese Wahrheit im Netz geht man bereits ein großes Risiko ein, denn das Auge schläft nie.

In Bezug auf Googles Suchmaschine volle Zustimmung. Vorallem wenn Google genutzt wird um sich über bestimmte Themen zu informieren ist es ganz entscheidend, welche Ergebnisse zuerst angezeigt werden.

Bei Facebook stimme ich weniger zu. Der Einfluss von Werbung wird in meinen Augen sehr überschätzt. Ob das jetzt Microtargeting ist oder nicht -> ich sehe welcher Post in meinem Newsfeed von einem Kontakt kommt und welcher (gesponserte) Werbung ist. Und das Werbung mit Vorsicht zu genießen ist wissen die Meisten Menschen dann doch. Oder anders gesagt: wenn sie es nicht wissen werden sie auch auf klassische Werbung „reinfallen“.

Danke für den Beitrag!

Der Selbstverzicht scheint dabei aber noch immer die schwerste aller

Übungen zu sein. Ebenso wie das Vermeiden von „Bequemlichkeiten“,

mit denen diese Konzerne uns immer wieder an „neuralgischen“

Punkten zu erwischen scheinen.

Slightly offtopic, aber im größeren Zusammenhang durchaus genauso

interessant, ist der heute auf Heise erschienene Artikel:

https://www.heise.de/newsticker/meldung/Lenke-ab-und-herrsche-Zensur-und-Propaganda-in-China-3770197.html?artikelseite=all ,

der uns ahnen lässt, wie sich auch eine „andere“ Form der Zukunft

ausrollen lassen könnte.

Gemeinsam scheint aber beiden zu sein, dass „Vereinzelung“ das

Mittel zum Machterhalt in den wie auch immer gearteten Gesellschaften

ist.

(vgl. dazu auch: https://netzpolitik.org/2017/im-bann-der-plattformen-die-naechste-etappe-in-der-coming-of-age-geschichte-des-users/)

@von den Chinesen lernen

Ganz so weit ist es hier noch nicht. In China kann man recht schnell für mißliebige Äußerungen im Knast landen oder schlimmer. Das „Punktesystem“ der Chinesen ist auch nicht so richtig verlockend.

Aber die Miesere sinnierte schon über elektronische Fußfesseln für Typen, die zu Anlässen, wie in Hamburg, nur verdächtig wären, an derartigen Ausschreitungen teilnehmen zu wollen. Drohbrindt ging mit seinen dümmlichen Vorschlägen noch etwas weiter. Beide Artikel auch auf Heise oder Golem.

Als wenn es nicht die Regierung gewesen wäre, die die Polizisten dort regelrecht verheizt hätte. Für jeden Blindflansch war vorher klar, dass der Austragungsort ein Festspiel der Chaoten garantierte.

Letztlich kann jeder selbst entscheiden, ob er die CDU oder SPD und ihre Vasallen wieder als Regierung haben will. Das ist der feine Unterschied zu China.

Wer sich mal die Mühe macht news.google.de mit n-tv.de zu vergleichen, stellt sehr schnell fest, dass Google die Nachrichten nicht macht. Interessanterweise sind die Nachrichten auf allen Kanälen einschließlich von Zeitungen identisch. Nur das schmückende Beiwerk unterscheidet sich etwas. Zensur findet schon durch die Medienmonopole statt. Deren Konkurrenz sind nun mal auch Google und Facebook und die sind zur Zeit erheblich profitabler als Zeitungen, Rundfunk und Fernsehen zusammen. Das finden die Medienmogule nicht toll. Aber auch BTX, Yahoo und AOL hatten die Zeichen der Zeit nicht erkannt und sind zurecht verschwunden. Auch Google und Facebook werden irgendwann mal die Zeichen der Zeit falsch deuten und auf ein deutlich gesünderes Maß als heute geschrumpft werden. Von daher gibt es kein wirkliches Problem mit ihnen. Wenn Konzerne wie Google Steuerprivilegien nutzen, ist das ausschließlich die Schuld der betreffenden Regierungen.

@Netzpolitik: Vielen Dank für das Interview!

@So So

Hej, ich warte auch gerne, aber auf Fehler von Google und Facebook? Das dauert mir zu lange. Du kannst ja gerne absolut in die Kraft des Marktes vertrauen, aber Pasquale sagt doch, dass sich Demokratien einen Verzicht auf Öffentlichkeit nicht leisten können, weil sie dann am Ende eben keine Demokratien mehr sind. Ich hoffe, dass diese Ansicht inzwischen mehrheitsfähig ist.

Und überhaupt, welche Fehler sollten das sein, dass sie ihre absolute Informationshoheit und -kontrolle verlieren? Dieser Informationsmonopolismus ist einmalig in der Geschichte und nicht vergleichbar mit früheren großen Medienkonzernen. Diese Macht lässt sich nicht mehr auf normalem Marktwege korrigieren, allein schon deswegen, weil diesen Konzernen auch die größten finanziellen Mittel zur Verfügung stehen und sie sehr wahrscheinlich auch die größten Summen in die Forschung für weitere technische „Fortschritte“ stecken. Sollte irgendein unabhängiges Start-Up die technischen Möglichkeiten haben, dagegen ernsthaft anzustinken, fehlt dem schlicht der Content, der sich eben nicht von heute auf morgen zusammentragen lässt. Das wird dann entweder einfach geschluckt oder der ganze Tross wandert tatsächlich dahin. Aber was ändert das für das Individuum – nichts? Mal ganz ehrlich, was würde eigentlich passieren – ernsthaft passieren, wenn Google morgen ersatzlos weg wäre? Nichts, wäre schade um Maps, aber das war’s auch schon, die Welt und die Wirtschaft würde einfach weitergehen. Einige hätten Datenverluste wegen deren Cloud, aber sonst? Das würde in kürzester Zeit ersetzt durch beliebige Anbieter. Umso erstaunlicher, welche Macht diese schlichte Konzentration trotzdem heute hat.

@Überhaupt

„Dieser Informationsmonopolismus ist einmalig in der Geschichte und nicht vergleichbar mit früheren großen Medienkonzernen.“ Autsch, die Gnade der späten Geburt? Sie hätten mal die Springer-Presse in West-Berlin sehen sollen. Morgens am Zeitungskiosk: „Eine Bild, eine BZ.“ Das war Filter-Bubble vom Allerfeinsten. Damit konnte „die Politik“ Alleinherrschaft begründen und aufrecht erhalten (erst SPD, dann CDU, dann SPD/CDU, dann wieder SPD), die letztlich eine ganze Stadt in über 60 Mrd. € Verschuldung geführt hat (also in der Größenordnung von Griechenland). Von der selbst an den Verhältnissen von Bananenrepubliken gemessenen unglaublichen Anzahl von Skandalen und schamlosen, ungeahndeten Bereicherungen, um dorthin zu kommen, mal ganz abgesehen.

Nun könnte man sagen, das war noch lokal begrenzt, mit Auswirkungen auf gerade mal 3,5 Millionen Menschen. Aber Berlin kassiert heute noch 45% des Länderfinanzausgleichs und wirkt damit finanziell auf über 80 Millionen. Keine schlechte „Bilanz“, wenn man bedenkt, dass man Zeitungen ja drucken und verteilen muss, ein geradezu unglaublicher produktionstechnischer und logistischer Aufwand im Vergleich zu sozialen Medien. Und trotzdem, es ging. Die Bevölkerung einer kompletten Großstadt über Jahrzehnte mit gut gewaschenen Gehirnen versehen, das war die Mission von „eine Bild, eine BZ“, und sie hat wunderbar funktioniert, lange vor dem Internet-Zeitalter, aber mit Wirkungen weit in dieses hinein.

@Stefan Hinz

Also die Finanzprobleme Berlins nun ganz alleine Springer anzulasten, das spricht m.E. dafür, dass Sie in einer ganz eigenen Bubble unterwegs sind. Und dass der Vergleich Springer/Google hinkt, das haben Sie schon selbst bemerkt. Es spricht m. E. einiges dafür, dass die gegenwärtige Tendenz zu Informationsmonopolen neu und – wie Pasquale sagt – grundsätzlich problematisch für Demokratien ist.

Eine Alternative zu Google ist:

https://deusu.de/

Werebefrei, eigener Suchindex, trackt nicht und der code ist transparent.

Andere Projekte greifen oft nur wieder auf den Suchindex von Google zurück oder sind Metasuchmaschienen.

Aber es ist wie bei netzpolitik.org. Profite lassen sich damit nicht generieren, deshalb muss man Spenden wenn man die Alternativen haben möchte.